باحثون من مايكروسوفت وجامعة الصين المركزية طريقة جديدة عالية الأداء لتتبع كائنات متعددة في الفيديو باستخدام تقنيات التعلم الآلي - FairMOT (التتبع العادل للكائنات المتعددة). كود مع طريقة التنفيذ بناءً على Pytorch والنماذج المدربة على جيثب.

تستخدم معظم طرق تتبع الكائنات الحالية مرحلتين، يتم تنفيذ كل منهما بواسطة شبكة عصبية منفصلة. تستخدم المرحلة الأولى نموذجًا لتحديد موقع الكائنات موضع الاهتمام، وتستخدم المرحلة الثانية نموذج بحث الارتباط المستخدم لإعادة تعريف الكائنات وإرفاق نقاط ارتساء بها.

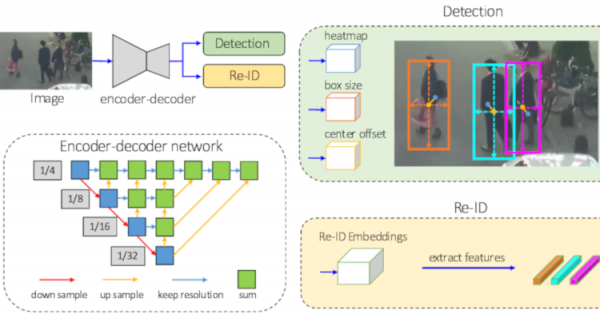

يستخدم FairMOT تنفيذًا على مرحلة واحدة يعتمد على شبكة عصبية تلافيفية قابلة للتشوه (، شبكة تلافيفية قابلة للتشوه)، والتي تتيح لك تحقيق زيادة ملحوظة في سرعة تتبع الكائنات. يعمل FairMOT بدون أدوات تثبيت، وذلك باستخدام آلية إعادة التعريف لتحديد إزاحات مراكز الكائنات على خريطة كائنات عالية الدقة. بالتوازي، يتم تنفيذ معالج يقوم بتقييم الميزات الفردية للكائنات التي يمكن استخدامها للتنبؤ بهويتها، وتقوم الوحدة الرئيسية بتقارب هذه الميزات لمعالجة الكائنات بمقاييس مختلفة.

لتدريب النموذج في FairMOT، تم استخدام مجموعة من ست مجموعات بيانات عامة للكشف عن الأشخاص والبحث عنهم (ETH، CityPerson، CalTech، MOT17، CUHK-SYSU). تم اختبار النموذج باستخدام مجموعات اختبار من مقاطع الفيديو , , и التي يقدمها المشروع وتغطي المواقف المختلفة، حركة الكاميرا أو دورانها، زوايا مشاهدة مختلفة. أظهر الاختبار ذلك

FairMOT أسرع النماذج المنافسة и عند اختباره على 30 إطارًا في الثانية من تدفقات الفيديو، مما يوضح الأداء الكافي لتحليل تدفقات الفيديو العادية بسرعة.

المصدر: opennet.ru