S vremena na vrijeme javlja se zadatak pretraživanja povezanih podataka pomoću skupa ključeva, dok ne dostignemo potreban ukupan broj zapisa.

Naj"realniji" primjer je zaključiti 20 najstarijih zadataka, na popisu na popisu zaposlenika (Na primjer, unutar jednog odjela). Za razne upravljačke nadzorne ploče s kratkim sažecima radnih područja često je potrebna slična tema.

U ovom članku razmotrit ćemo implementaciju „naivnog“ rješenja ovog problema u PostgreSQL-u, „pametnijeg“ i vrlo složenog algoritma. "petlja" u SQL-u s uvjetom izlaza na temelju pronađenih podataka, što može biti korisno i za opći razvoj i za primjenu u drugim sličnim slučajevima.

Uzmimo testni skup podataka iz Kako bi se spriječilo da izlazni zapisi "skaču" s jednog vremenskog razdoblja na drugo kada se sortirane vrijednosti podudaraju, Proširimo indeks predmeta dodavanjem primarnog ključaTo će ga odmah učiniti jedinstvenim i jamčiti jasan redoslijed sortiranja:

CREATE INDEX ON task(owner_id, task_date, id);

-- а старый - удалим

DROP INDEX task_owner_id_task_date_idx;Napisano je kako zvuči.

Prvo, skicirajmo najjednostavniju verziju zahtjeva, prosljeđujući ID-ove izvođača :

SELECT

*

FROM

task

WHERE

owner_id = ANY('{1,2,4,8,16,32,64,128,256,512}'::integer[])

ORDER BY

task_date, id

LIMIT 20;

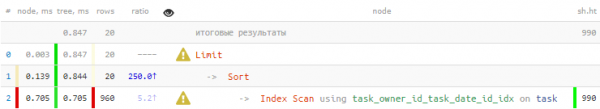

Malo je tužno - naručili smo samo 20 ploča, a Index Scan nam ih je vratio 960 redaka, što je onda trebalo srediti... Pokušajmo manje čitati.

unnest + ARRAY

Prvo što ćemo uzeti u obzir je trebamo li samo 20 sortiranih zapise, onda je dovoljno pročitati ne više od 20 sortiranih istim redoslijedom za svaku ključ. Srećom, prikladan indeks (id_vlasnika, datum_zadatka, id) imamo.

Koristimo isti mehanizam ekstrakcije i "rasklapanja u stupce" integralni unos u tablicu, kao u Također ćemo primijeniti savijanje u niz pomoću funkcije ARRAY():

WITH T AS (

SELECT

unnest(ARRAY(

SELECT

t

FROM

task t

WHERE

owner_id = unnest

ORDER BY

task_date, id

LIMIT 20 -- ограничиваем тут...

)) r

FROM

unnest('{1,2,4,8,16,32,64,128,256,512}'::integer[])

)

SELECT

(r).*

FROM

T

ORDER BY

(r).task_date, (r).id

LIMIT 20; -- ... и тут - тоже

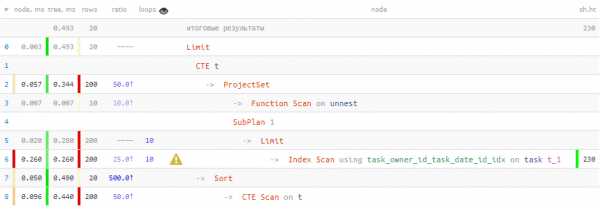

O, to je puno bolje! 40% brže i 4.5 puta manje podataka Morao sam to pročitati.

Materijalizacija zapisa u tablici putem CTE-aŽelio bih vam skrenuti pozornost na činjenicu da u nekim slučajevima Pokušaj rada s poljima zapisa odmah nakon pretraživanja u podupitu, bez "omotavanja" u CTE, može dovesti do "množenje" InitPlana proporcionalno broju tih istih polja:

SELECT

((

SELECT

t

FROM

task t

WHERE

owner_id = 1

ORDER BY

task_date, id

LIMIT 1

).*);Result (cost=4.77..4.78 rows=1 width=16) (actual time=0.063..0.063 rows=1 loops=1)

Buffers: shared hit=16

InitPlan 1 (returns $0)

-> Limit (cost=0.42..1.19 rows=1 width=48) (actual time=0.031..0.032 rows=1 loops=1)

Buffers: shared hit=4

-> Index Scan using task_owner_id_task_date_id_idx on task t (cost=0.42..387.57 rows=500 width=48) (actual time=0.030..0.030 rows=1 loops=1)

Index Cond: (owner_id = 1)

Buffers: shared hit=4

InitPlan 2 (returns $1)

-> Limit (cost=0.42..1.19 rows=1 width=48) (actual time=0.008..0.009 rows=1 loops=1)

Buffers: shared hit=4

-> Index Scan using task_owner_id_task_date_id_idx on task t_1 (cost=0.42..387.57 rows=500 width=48) (actual time=0.008..0.008 rows=1 loops=1)

Index Cond: (owner_id = 1)

Buffers: shared hit=4

InitPlan 3 (returns $2)

-> Limit (cost=0.42..1.19 rows=1 width=48) (actual time=0.008..0.008 rows=1 loops=1)

Buffers: shared hit=4

-> Index Scan using task_owner_id_task_date_id_idx on task t_2 (cost=0.42..387.57 rows=500 width=48) (actual time=0.008..0.008 rows=1 loops=1)

Index Cond: (owner_id = 1)

Buffers: shared hit=4"

InitPlan 4 (returns $3)

-> Limit (cost=0.42..1.19 rows=1 width=48) (actual time=0.009..0.009 rows=1 loops=1)

Buffers: shared hit=4

-> Index Scan using task_owner_id_task_date_id_idx on task t_3 (cost=0.42..387.57 rows=500 width=48) (actual time=0.009..0.009 rows=1 loops=1)

Index Cond: (owner_id = 1)

Buffers: shared hit=4

Isti zapis je "pretražen" 4 puta... Do PostgreSQL-a 11, ovo se ponašanje redovito susretalo, a rješenje je bilo "zamotati" ga u CTE, što je apsolutno ograničenje za optimizator u tim verzijama.

Rekurzivni akumulator

U prethodnoj verziji čitali smo ukupno 200 redaka radi potrebnih 20. Više ne 960, nego još manje - je li to moguće?

Pokušajmo iskoristiti znanje koje nam je potrebno ukupno 20 zapise. To jest, ponavljat ćemo samo čitanje podataka dok ne dođemo do potrebnog broja.

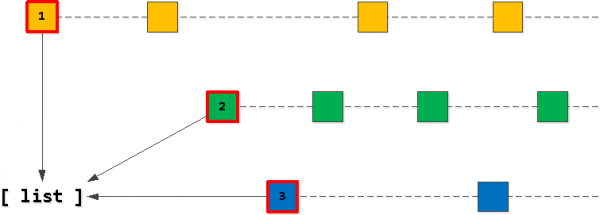

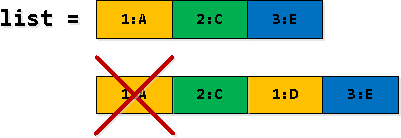

Korak 1: Početni popis

Očito je da bi naš "ciljni" popis od 20 zapisa trebao započeti s "prvim" zapisima za jedan od naših ključeva owner_id. Dakle, prvo ćemo ih pronaći "prvi" za svaki od ključeva i dodamo ga na popis, sortirajući ga željenim redoslijedom - (datum_zadatka, ID).

Korak 2: Pronađite "sljedeće" zapise

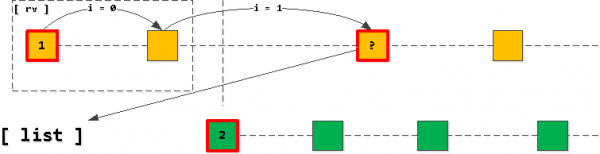

Ako sada uzmemo prvi unos s našeg popisa i počnemo "korak" dalje po indeksu s očuvanim ključem owner_id, tada su svi pronađeni zapisi upravo sljedeći u rezultirajućem odabiru. Naravno, samo dok ne pređemo preko primijenjenog ključa drugi unos na popisu.

Ako se ispostavi da smo "prekrižili" drugi unos, onda Posljednji pročitani unos treba dodati na popis umjesto prvog (s istim owner_id-om), nakon čega ponovno sortiramo popis.

To jest, uvijek završimo s činjenicom da popis nema više od jednog unosa za svaki od ključeva (ako se unosi potroše, a nismo ih "prekrižili", tada će prvi unos jednostavno nestati s popisa i ništa se neće dodati), i oni uvijek sortirano uzlaznim redoslijedom ključa aplikacije (task_date, id).

Korak 3: Filtrirajte i proširite zapise

U nekim retcima našeg rekurzivnog odabira, neki zapisi rv Duplicirani unosi – prvo pronalazimo unose poput "prelazi granicu drugog unosa na popisu", a zatim ih zamjenjujemo kao prvi unos na popisu. Dakle, prvo pojavljivanje treba filtrirati.

Strašno posljednje pitanje

WITH RECURSIVE T AS (

-- #1 : заносим в список "первые" записи по каждому из ключей набора

WITH wrap AS ( -- "материализуем" record'ы, чтобы обращение к полям не вызывало умножения InitPlan/SubPlan

WITH T AS (

SELECT

(

SELECT

r

FROM

task r

WHERE

owner_id = unnest

ORDER BY

task_date, id

LIMIT 1

) r

FROM

unnest('{1,2,4,8,16,32,64,128,256,512}'::integer[])

)

SELECT

array_agg(r ORDER BY (r).task_date, (r).id) list -- сортируем список в нужном порядке

FROM

T

)

SELECT

list

, list[1] rv

, FALSE not_cross

, 0 size

FROM

wrap

UNION ALL

-- #2 : вычитываем записи 1-го по порядку ключа, пока не перешагнем через запись 2-го

SELECT

CASE

-- если ничего не найдено для ключа 1-й записи

WHEN X._r IS NOT DISTINCT FROM NULL THEN

T.list[2:] -- убираем ее из списка

-- если мы НЕ пересекли прикладной ключ 2-й записи

WHEN X.not_cross THEN

T.list -- просто протягиваем тот же список без модификаций

-- если в списке уже нет 2-й записи

WHEN T.list[2] IS NULL THEN

-- просто возвращаем пустой список

'{}'

-- пересортировываем словарь, убирая 1-ю запись и добавляя последнюю из найденных

ELSE (

SELECT

coalesce(T.list[2] || array_agg(r ORDER BY (r).task_date, (r).id), '{}')

FROM

unnest(T.list[3:] || X._r) r

)

END

, X._r

, X.not_cross

, T.size + X.not_cross::integer

FROM

T

, LATERAL(

WITH wrap AS ( -- "материализуем" record

SELECT

CASE

-- если все-таки "перешагнули" через 2-ю запись

WHEN NOT T.not_cross

-- то нужная запись - первая из спписка

THEN T.list[1]

ELSE ( -- если не пересекли, то ключ остался как в предыдущей записи - отталкиваемся от нее

SELECT

_r

FROM

task _r

WHERE

owner_id = (rv).owner_id AND

(task_date, id) > ((rv).task_date, (rv).id)

ORDER BY

task_date, id

LIMIT 1

)

END _r

)

SELECT

_r

, CASE

-- если 2-й записи уже нет в списке, но мы хоть что-то нашли

WHEN list[2] IS NULL AND _r IS DISTINCT FROM NULL THEN

TRUE

ELSE -- ничего не нашли или "перешагнули"

coalesce(((_r).task_date, (_r).id) < ((list[2]).task_date, (list[2]).id), FALSE)

END not_cross

FROM

wrap

) X

WHERE

T.size < 20 AND -- ограничиваем тут количество

T.list IS DISTINCT FROM '{}' -- или пока список не кончился

)

-- #3 : "разворачиваем" записи - порядок гарантирован по построению

SELECT

(rv).*

FROM

T

WHERE

not_cross; -- берем только "непересекающие" записи

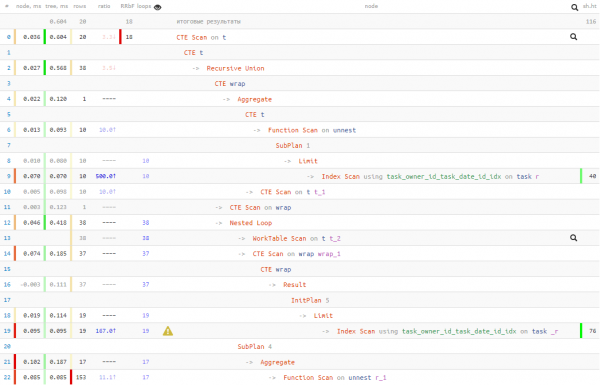

Dakle, mi zamijenio 50% očitanih podataka za 20% vremena izvršavanjaTo jest, ako imate razloga vjerovati da bi čitanje moglo biti sporo (na primjer, podaci često nisu u predmemoriji i moraju se dohvatiti s diska), tada ova metoda može smanjiti vaše oslanjanje na čitanje.

U svakom slučaju, vrijeme izvršenja bilo je bolje nego s "naivnom" prvom opcijom. Ali koju od ove tri opcije koristiti, ovisi o vama.

Izvor: www.habr.com