TL;DR: Yfirlitsgrein - leiðarvísir til að bera saman umhverfi til að keyra forrit í gámum. Farið verður yfir möguleika Docker og annarra sambærilegra kerfa.

Smá saga um hvaðan þetta allt kom

Story

Fyrsta vel þekkta leiðin til að einangra forrit er chroot. Kerfiskallið með sama nafni veitir breytingu á rótarskránni - þannig aðgangur að forritinu sem kallaði það, aðgangur aðeins að skrám inni í þessari möppu. En ef forritið fær ofurnotendaréttindi inni getur það hugsanlega "sloppið" frá chroot og fengið aðgang að aðalstýrikerfinu. Auk þess að breyta rótarskránni eru önnur úrræði (vinnsluminni, örgjörvi), sem og aðgangur að netinu, ekki takmörkuð.

Næsta aðferð er að keyra fullbúið stýrikerfi inni í íláti, með því að nota kjarna stýrikerfisins. Þessi aðferð hefur mismunandi nöfn í mismunandi stýrikerfum, en kjarninn er sá sami: að keyra mörg sjálfstæð stýrikerfi, þar sem hvert stýrikerfi keyrir sama kjarna og aðalstýrikerfið. Þetta felur í sér FreeBSD Jails, Solaris Zones, OpenVZ og LXC fyrir... LinuxEinangrun er ekki aðeins veitt af diskplássi, heldur einnig af öðrum auðlindum; sérstaklega getur hvert ílát haft takmarkanir á örgjörvatíma, vinnsluminni og netbandvídd. Í samanburði við chroot er erfiðara að hætta í íláti, þar sem ofurnotandinn í ílátinu hefur aðeins aðgang að innri hugbúnaði ílátsins. Hins vegar, vegna þess að þörf er á að halda stýrikerfinu inni í ílátinu uppfærðu og notkun eldri kjarnaútgáfna (sem skiptir máli fyrir... Linux, í minna mæli FreeBSD) eru líkur sem eru ekki núll á að „brjótast í gegnum“ kjarnaeinangrunarkerfið og fá aðgang að aðalstýrikerfinu.

Í stað þess að ræsa fullbúið stýrikerfi í gám (með frumstillingarkerfi, pakkastjóra o.s.frv.) er hægt að ræsa forrit strax, aðalatriðið er að veita forritum þetta tækifæri (tilvist nauðsynlegra bókasöfna og aðrar skrár). Þessi hugmynd þjónaði sem grundvöllur fyrir sýndarvæðingu forrita í gáma, en mest áberandi og þekktasti fulltrúi þeirra er Docker. Í samanburði við fyrri kerfi leiddi sveigjanlegri einangrunaraðferðir, ásamt innbyggðum stuðningi fyrir sýndarnet á milli gáma og stöðuleika forrita inni í gámi, til þess að hægt væri að byggja upp eitt heildrænt umhverfi úr miklum fjölda líkamlegra netþjóna til að keyra gáma - án þörf fyrir handvirka auðlindastjórnun.

Docker

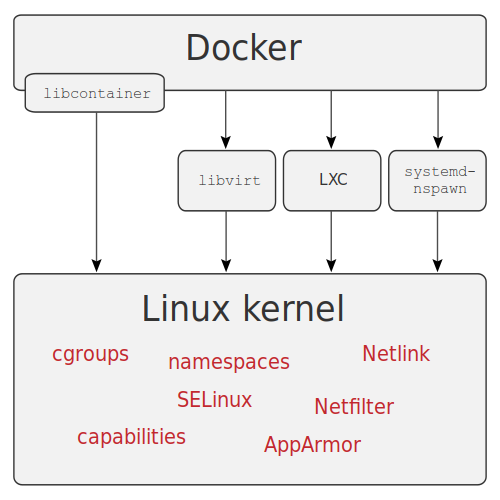

Docker er þekktasti hugbúnaðurinn fyrir gámavæðingu forrita. Hann er skrifaður í Go forritunarmálinu og notar innbyggða kjarnaeiginleika. Linux — skráarhópar, nafnrými, eiginleikar o.s.frv., sem og Aufs skráarkerfi og önnur svipuð til að spara pláss á diski.

Heimild: Wikimedia

arkitektúr

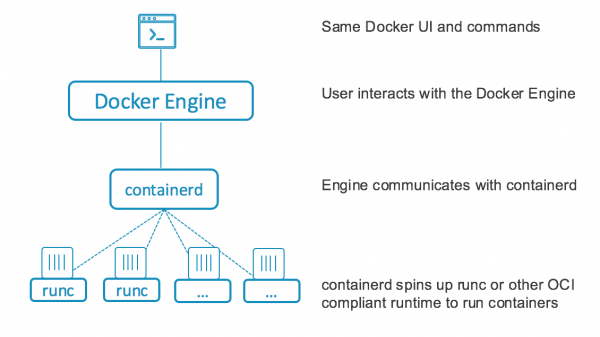

Fyrir útgáfu 1.11 starfaði Docker sem ein þjónusta sem annaðist allar gámaaðgerðir: niðurhal gámamynda, ræsingu gáma og meðhöndlun API-beiðna. Frá og með útgáfu 1.11 var Docker skipt í nokkra samverkandi hluta: containerd, sem sér um allan líftíma gámsins (úthlutun diska, niðurhal mynda, nettengingu, ræsingu, uppsetningu og eftirlit með stöðu gáma), og runC, keyrsluumhverfi gáma sem byggir á cgroups og öðrum kjarnaeiginleikum. LinuxDocker þjónustan sjálf er enn til staðar, en nú þjónar hún aðeins til að vinna úr API beiðnum sem sendar eru til containerd.

Uppsetning og stillingar

Uppáhalds leiðin mín til að setja upp docker er docker-machine, sem, auk þess að setja upp og stilla docker beint á ytri netþjóna (þar á meðal ýmis ský), gerir þér kleift að vinna með skráarkerfi ytri netþjóna og getur einnig keyrt ýmsar skipanir.

Hins vegar hefur verkefnið varla verið þróað síðan 2018, svo við munum setja það upp með hefðbundinni aðferð fyrir flestar dreifingar. Linux aðferð - með því að bæta við geymslu og setja upp nauðsynleg pakka.

Þessi aðferð er einnig notuð fyrir sjálfvirka uppsetningu, til dæmis með því að nota Ansible eða önnur svipuð kerfi, en ég mun ekki íhuga það í þessari grein.

Uppsetningin verður framkvæmd á Centos 7, ég mun nota sýndarvél sem netþjón, til uppsetningar er nóg að keyra skipanirnar hér að neðan:

# yum install -y yum-utils

# yum-config-manager --add-repo https://download.docker.com/linux/centos/docker-ce.repo

# yum install docker-ce docker-ce-cli containerd.ioEftir uppsetningu þarftu að ræsa þjónustuna, setja hana í sjálfvirka hleðslu:

# systemctl enable docker

# systemctl start docker

# firewall-cmd --zone=public --add-port=2377/tcp --permanentAð auki geturðu búið til docker hóp, þar sem notendur geta unnið með docker án sudo, sett upp skráningu, virkjað aðgang að API utan frá, ekki gleyma að fínstilla eldvegginn (allt sem er ekki leyfilegt er bönnuð í dæmunum hér að ofan og hér að neðan - ég sleppti þessu til einföldunar og myndunar), en ég ætla ekki að fara nánar út í það hér.

Aðrir eiginleikar

Til viðbótar við ofangreinda bryggjuvél er einnig til bryggjuskrá, tól til að geyma myndir fyrir gáma, svo og bryggjusamsetning - tól til að gera sjálfvirkan dreifingu forrita í gámum, YAML skrár eru notaðar til að byggja og stilla gáma og önnur tengd atriði (td netkerfi, viðvarandi skráarkerfi til að geyma gögn).

Það er einnig hægt að nota til að skipuleggja leiðslur fyrir CICD. Annar áhugaverður eiginleiki er að vinna í klasaham, svokölluðum swarm ham (fyrir útgáfu 1.12 var það þekkt sem docker swarm), sem gerir þér kleift að setja saman einn innviði frá nokkrum netþjónum til að keyra gáma. Það er stuðningur við sýndarnet ofan á alla netþjóna, það er innbyggður álagsjafnari, auk stuðningur við leyndarmál fyrir gáma.

YAML skrárnar frá docker compose er hægt að nota fyrir slíka klasa með smávægilegum breytingum, sem gerir viðhald lítilla og meðalstórra klasa að fullu sjálfvirkan í ýmsum tilgangi. Fyrir stóra klasa er Kubernetes æskilegt vegna þess að viðhaldskostnaður kvikhamar getur vegið þyngra en Kubernetes. Til viðbótar við runC, sem framkvæmdarumhverfi fyrir gáma, geturðu sett upp td

Að vinna með Docker

Eftir uppsetningu og stillingar munum við reyna að byggja upp þyrping þar sem við munum dreifa GitLab og Docker Registry fyrir þróunarteymið. Sem netþjónar mun ég nota þrjár sýndarvélar, sem ég mun að auki nota GlusterFS dreifða FS á, ég mun nota það sem geymslu fyrir docker bindi, til dæmis, til að keyra bilunarörugga útgáfu af docker registry. Lykilþættir til að keyra: Docker Registry, Postgresql, Redis, GitLab með stuðningi fyrir GitLab Runner ofan á Swarm. Postgresql verður hleypt af stokkunum með þyrpingum , svo þú þarft ekki að nota GlusterFS til að geyma Postgresql gögn. Restin af mikilvægum gögnum verða geymd á GlusterFS.

Til að dreifa GlusterFS á alla netþjóna (þeir eru kallaðir node1, node2, node3), þarftu að setja upp pakka, virkja eldvegginn, búa til nauðsynlegar möppur:

# yum -y install centos-release-gluster7

# yum -y install glusterfs-server

# systemctl enable glusterd

# systemctl start glusterd

# firewall-cmd --add-service=glusterfs --permanent

# firewall-cmd --reload

# mkdir -p /srv/gluster

# mkdir -p /srv/docker

# echo "$(hostname):/docker /srv/docker glusterfs defaults,_netdev 0 0" >> /etc/fstabEftir uppsetningu verður að halda áfram vinnu við að stilla GlusterFS frá einum hnút, til dæmis hnút1:

# gluster peer probe node2

# gluster peer probe node3

# gluster volume create docker replica 3 node1:/srv/gluster node2:/srv/gluster node3:/srv/gluster force

# gluster volume start dockerÞá þarftu að tengja hljóðstyrkinn sem myndast (skipunin verður að vera keyrð á öllum netþjónum):

# mount /srv/dockerSwarm mode er stillt á einum af netþjónunum, sem verður Leader, restin verður að ganga í þyrpinguna, þannig að niðurstaðan af því að keyra skipunina á fyrsta þjóninum þarf að afrita og framkvæma á hinum.

Upphafleg klasauppsetning, ég keyri skipunina á hnút1:

# docker swarm init

Swarm initialized: current node (a5jpfrh5uvo7svzz1ajduokyq) is now a manager.

To add a worker to this swarm, run the following command:

docker swarm join --token SWMTKN-1-0c5mf7mvzc7o7vjk0wngno2dy70xs95tovfxbv4tqt9280toku-863hyosdlzvd76trfptd4xnzd xx.xx.xx.xx:2377

To add a manager to this swarm, run 'docker swarm join-token manager' and follow the instructions.

# docker swarm join-token managerAfritaðu niðurstöðu seinni skipunarinnar, keyrðu á hnút2 og hnút3:

# docker swarm join --token SWMTKN-x-xxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxx-xxxxxxxxx xx.xx.xx.xx:2377

This node joined a swarm as a manager.Þetta lýkur bráðabirgðastillingu netþjónanna, við skulum byrja að stilla þjónusturnar, skipanirnar sem á að framkvæma verða ræstar frá hnút1, nema annað sé tekið fram.

Í fyrsta lagi skulum við búa til net fyrir gáma:

# docker network create --driver=overlay etcd

# docker network create --driver=overlay pgsql

# docker network create --driver=overlay redis

# docker network create --driver=overlay traefik

# docker network create --driver=overlay gitlabSíðan merkjum við netþjónana, þetta er nauðsynlegt til að binda einhverjar þjónustur við netþjónana:

# docker node update --label-add nodename=node1 node1

# docker node update --label-add nodename=node2 node2

# docker node update --label-add nodename=node3 node3Næst búum við til möppur til að geyma etcd gögn, KV geymsluna sem Traefik og Stolon þurfa. Svipað og Postgresql verða þetta gámar sem eru bundnir við netþjóna, þannig að við framkvæmum þessa skipun á öllum netþjónum:

# mkdir -p /srv/etcdNæst skaltu búa til skrá til að stilla etcd og nota hana:

00etcd.yml

version: '3.7'

services:

etcd1:

image: quay.io/coreos/etcd:latest

hostname: etcd1

command:

- etcd

- --name=etcd1

- --data-dir=/data.etcd

- --advertise-client-urls=http://etcd1:2379

- --listen-client-urls=http://0.0.0.0:2379

- --initial-advertise-peer-urls=http://etcd1:2380

- --listen-peer-urls=http://0.0.0.0:2380

- --initial-cluster=etcd1=http://etcd1:2380,etcd2=http://etcd2:2380,etcd3=http://etcd3:2380

- --initial-cluster-state=new

- --initial-cluster-token=etcd-cluster

networks:

- etcd

volumes:

- etcd1vol:/data.etcd

deploy:

replicas: 1

placement:

constraints: [node.labels.nodename == node1]

etcd2:

image: quay.io/coreos/etcd:latest

hostname: etcd2

command:

- etcd

- --name=etcd2

- --data-dir=/data.etcd

- --advertise-client-urls=http://etcd2:2379

- --listen-client-urls=http://0.0.0.0:2379

- --initial-advertise-peer-urls=http://etcd2:2380

- --listen-peer-urls=http://0.0.0.0:2380

- --initial-cluster=etcd1=http://etcd1:2380,etcd2=http://etcd2:2380,etcd3=http://etcd3:2380

- --initial-cluster-state=new

- --initial-cluster-token=etcd-cluster

networks:

- etcd

volumes:

- etcd2vol:/data.etcd

deploy:

replicas: 1

placement:

constraints: [node.labels.nodename == node2]

etcd3:

image: quay.io/coreos/etcd:latest

hostname: etcd3

command:

- etcd

- --name=etcd3

- --data-dir=/data.etcd

- --advertise-client-urls=http://etcd3:2379

- --listen-client-urls=http://0.0.0.0:2379

- --initial-advertise-peer-urls=http://etcd3:2380

- --listen-peer-urls=http://0.0.0.0:2380

- --initial-cluster=etcd1=http://etcd1:2380,etcd2=http://etcd2:2380,etcd3=http://etcd3:2380

- --initial-cluster-state=new

- --initial-cluster-token=etcd-cluster

networks:

- etcd

volumes:

- etcd3vol:/data.etcd

deploy:

replicas: 1

placement:

constraints: [node.labels.nodename == node3]

volumes:

etcd1vol:

driver: local

driver_opts:

type: none

o: bind

device: "/srv/etcd"

etcd2vol:

driver: local

driver_opts:

type: none

o: bind

device: "/srv/etcd"

etcd3vol:

driver: local

driver_opts:

type: none

o: bind

device: "/srv/etcd"

networks:

etcd:

external: true# docker stack deploy --compose-file 00etcd.yml etcdEftir smá stund athugum við hvort etcd þyrpingin hafi hækkað:

# docker exec $(docker ps | awk '/etcd/ {print $1}') etcdctl member list

ade526d28b1f92f7: name=etcd1 peerURLs=http://etcd1:2380 clientURLs=http://etcd1:2379 isLeader=false

bd388e7810915853: name=etcd3 peerURLs=http://etcd3:2380 clientURLs=http://etcd3:2379 isLeader=false

d282ac2ce600c1ce: name=etcd2 peerURLs=http://etcd2:2380 clientURLs=http://etcd2:2379 isLeader=true

# docker exec $(docker ps | awk '/etcd/ {print $1}') etcdctl cluster-health

member ade526d28b1f92f7 is healthy: got healthy result from http://etcd1:2379

member bd388e7810915853 is healthy: got healthy result from http://etcd3:2379

member d282ac2ce600c1ce is healthy: got healthy result from http://etcd2:2379

cluster is healthyBúðu til möppur fyrir Postgresql, framkvæmdu skipunina á öllum netþjónum:

# mkdir -p /srv/pgsqlNæst skaltu búa til skrá til að stilla Postgresql:

01pgsql.yml

version: '3.7'

services:

pgsentinel:

image: sorintlab/stolon:master-pg10

command:

- gosu

- stolon

- stolon-sentinel

- --cluster-name=stolon-cluster

- --store-backend=etcdv3

- --store-endpoints=http://etcd1:2379,http://etcd2:2379,http://etcd3:2379

- --log-level=debug

networks:

- etcd

- pgsql

deploy:

replicas: 3

update_config:

parallelism: 1

delay: 30s

order: stop-first

failure_action: pause

pgkeeper1:

image: sorintlab/stolon:master-pg10

hostname: pgkeeper1

command:

- gosu

- stolon

- stolon-keeper

- --pg-listen-address=pgkeeper1

- --pg-repl-username=replica

- --uid=pgkeeper1

- --pg-su-username=postgres

- --pg-su-passwordfile=/run/secrets/pgsql

- --pg-repl-passwordfile=/run/secrets/pgsql_repl

- --data-dir=/var/lib/postgresql/data

- --cluster-name=stolon-cluster

- --store-backend=etcdv3

- --store-endpoints=http://etcd1:2379,http://etcd2:2379,http://etcd3:2379

networks:

- etcd

- pgsql

environment:

- PGDATA=/var/lib/postgresql/data

volumes:

- pgkeeper1:/var/lib/postgresql/data

secrets:

- pgsql

- pgsql_repl

deploy:

replicas: 1

placement:

constraints: [node.labels.nodename == node1]

pgkeeper2:

image: sorintlab/stolon:master-pg10

hostname: pgkeeper2

command:

- gosu

- stolon

- stolon-keeper

- --pg-listen-address=pgkeeper2

- --pg-repl-username=replica

- --uid=pgkeeper2

- --pg-su-username=postgres

- --pg-su-passwordfile=/run/secrets/pgsql

- --pg-repl-passwordfile=/run/secrets/pgsql_repl

- --data-dir=/var/lib/postgresql/data

- --cluster-name=stolon-cluster

- --store-backend=etcdv3

- --store-endpoints=http://etcd1:2379,http://etcd2:2379,http://etcd3:2379

networks:

- etcd

- pgsql

environment:

- PGDATA=/var/lib/postgresql/data

volumes:

- pgkeeper2:/var/lib/postgresql/data

secrets:

- pgsql

- pgsql_repl

deploy:

replicas: 1

placement:

constraints: [node.labels.nodename == node2]

pgkeeper3:

image: sorintlab/stolon:master-pg10

hostname: pgkeeper3

command:

- gosu

- stolon

- stolon-keeper

- --pg-listen-address=pgkeeper3

- --pg-repl-username=replica

- --uid=pgkeeper3

- --pg-su-username=postgres

- --pg-su-passwordfile=/run/secrets/pgsql

- --pg-repl-passwordfile=/run/secrets/pgsql_repl

- --data-dir=/var/lib/postgresql/data

- --cluster-name=stolon-cluster

- --store-backend=etcdv3

- --store-endpoints=http://etcd1:2379,http://etcd2:2379,http://etcd3:2379

networks:

- etcd

- pgsql

environment:

- PGDATA=/var/lib/postgresql/data

volumes:

- pgkeeper3:/var/lib/postgresql/data

secrets:

- pgsql

- pgsql_repl

deploy:

replicas: 1

placement:

constraints: [node.labels.nodename == node3]

postgresql:

image: sorintlab/stolon:master-pg10

command: gosu stolon stolon-proxy --listen-address 0.0.0.0 --cluster-name stolon-cluster --store-backend=etcdv3 --store-endpoints http://etcd1:2379,http://etcd2:2379,http://etcd3:2379

networks:

- etcd

- pgsql

deploy:

replicas: 3

update_config:

parallelism: 1

delay: 30s

order: stop-first

failure_action: rollback

volumes:

pgkeeper1:

driver: local

driver_opts:

type: none

o: bind

device: "/srv/pgsql"

pgkeeper2:

driver: local

driver_opts:

type: none

o: bind

device: "/srv/pgsql"

pgkeeper3:

driver: local

driver_opts:

type: none

o: bind

device: "/srv/pgsql"

secrets:

pgsql:

file: "/srv/docker/postgres"

pgsql_repl:

file: "/srv/docker/replica"

networks:

etcd:

external: true

pgsql:

external: trueVið búum til leyndarmál, notum skrána:

# </dev/urandom tr -dc 234567890qwertyuopasdfghjkzxcvbnmQWERTYUPASDFGHKLZXCVBNM | head -c $(((RANDOM%3)+15)) > /srv/docker/replica

# </dev/urandom tr -dc 234567890qwertyuopasdfghjkzxcvbnmQWERTYUPASDFGHKLZXCVBNM | head -c $(((RANDOM%3)+15)) > /srv/docker/postgres

# docker stack deploy --compose-file 01pgsql.yml pgsqlNokkru síðar (horfðu á úttak skipunarinnar hafnarþjónusta lsað öll þjónusta hafi hækkað) frumstilla Postgresql þyrpinguna:

# docker exec $(docker ps | awk '/pgkeeper/ {print $1}') stolonctl --cluster-name=stolon-cluster --store-backend=etcdv3 --store-endpoints=http://etcd1:2379,http://etcd2:2379,http://etcd3:2379 initAthugaðu viðbúnað Postgresql klasans:

# docker exec $(docker ps | awk '/pgkeeper/ {print $1}') stolonctl --cluster-name=stolon-cluster --store-backend=etcdv3 --store-endpoints=http://etcd1:2379,http://etcd2:2379,http://etcd3:2379 status

=== Active sentinels ===

ID LEADER

26baa11d false

74e98768 false

a8cb002b true

=== Active proxies ===

ID

4d233826

9f562f3b

b0c79ff1

=== Keepers ===

UID HEALTHY PG LISTENADDRESS PG HEALTHY PG WANTEDGENERATION PG CURRENTGENERATION

pgkeeper1 true pgkeeper1:5432 true 2 2

pgkeeper2 true pgkeeper2:5432 true 2 2

pgkeeper3 true pgkeeper3:5432 true 3 3

=== Cluster Info ===

Master Keeper: pgkeeper3

===== Keepers/DB tree =====

pgkeeper3 (master)

├─pgkeeper2

└─pgkeeper1

Við stillum traefik til að opna aðgang að gámum að utan:

03traefik.yml

version: '3.7'

services:

traefik:

image: traefik:latest

command: >

--log.level=INFO

--providers.docker=true

--entryPoints.web.address=:80

--providers.providersThrottleDuration=2

--providers.docker.watch=true

--providers.docker.swarmMode=true

--providers.docker.swarmModeRefreshSeconds=15s

--providers.docker.exposedbydefault=false

--accessLog.bufferingSize=0

--api=true

--api.dashboard=true

--api.insecure=true

networks:

- traefik

ports:

- 80:80

volumes:

- /var/run/docker.sock:/var/run/docker.sock

deploy:

replicas: 3

placement:

constraints:

- node.role == manager

preferences:

- spread: node.id

labels:

- traefik.enable=true

- traefik.http.routers.traefik.rule=Host(`traefik.example.com`)

- traefik.http.services.traefik.loadbalancer.server.port=8080

- traefik.docker.network=traefik

networks:

traefik:

external: true# docker stack deploy --compose-file 03traefik.yml traefikVið byrjum Redis Cluster, til þess búum við til geymsluskrá á öllum hnútum:

# mkdir -p /srv/redis05redis.yml

version: '3.7'

services:

redis-master:

image: 'bitnami/redis:latest'

networks:

- redis

ports:

- '6379:6379'

environment:

- REDIS_REPLICATION_MODE=master

- REDIS_PASSWORD=xxxxxxxxxxx

deploy:

mode: global

restart_policy:

condition: any

volumes:

- 'redis:/opt/bitnami/redis/etc/'

redis-replica:

image: 'bitnami/redis:latest'

networks:

- redis

ports:

- '6379'

depends_on:

- redis-master

environment:

- REDIS_REPLICATION_MODE=slave

- REDIS_MASTER_HOST=redis-master

- REDIS_MASTER_PORT_NUMBER=6379

- REDIS_MASTER_PASSWORD=xxxxxxxxxxx

- REDIS_PASSWORD=xxxxxxxxxxx

deploy:

mode: replicated

replicas: 3

update_config:

parallelism: 1

delay: 10s

restart_policy:

condition: any

redis-sentinel:

image: 'bitnami/redis:latest'

networks:

- redis

ports:

- '16379'

depends_on:

- redis-master

- redis-replica

entrypoint: |

bash -c 'bash -s <<EOF

"/bin/bash" -c "cat <<EOF > /opt/bitnami/redis/etc/sentinel.conf

port 16379

dir /tmp

sentinel monitor master-node redis-master 6379 2

sentinel down-after-milliseconds master-node 5000

sentinel parallel-syncs master-node 1

sentinel failover-timeout master-node 5000

sentinel auth-pass master-node xxxxxxxxxxx

sentinel announce-ip redis-sentinel

sentinel announce-port 16379

EOF"

"/bin/bash" -c "redis-sentinel /opt/bitnami/redis/etc/sentinel.conf"

EOF'

deploy:

mode: global

restart_policy:

condition: any

volumes:

redis:

driver: local

driver_opts:

type: 'none'

o: 'bind'

device: "/srv/redis"

networks:

redis:

external: true# docker stack deploy --compose-file 05redis.yml redisBæta við Docker Registry:

06registry.yml

version: '3.7'

services:

registry:

image: registry:2.6

networks:

- traefik

volumes:

- registry_data:/var/lib/registry

deploy:

replicas: 1

placement:

constraints: [node.role == manager]

restart_policy:

condition: on-failure

labels:

- traefik.enable=true

- traefik.http.routers.registry.rule=Host(`registry.example.com`)

- traefik.http.services.registry.loadbalancer.server.port=5000

- traefik.docker.network=traefik

volumes:

registry_data:

driver: local

driver_opts:

type: none

o: bind

device: "/srv/docker/registry"

networks:

traefik:

external: true# mkdir /srv/docker/registry

# docker stack deploy --compose-file 06registry.yml registryOg að lokum - GitLab:

08gitlab-runner.yml

version: '3.7'

services:

gitlab:

image: gitlab/gitlab-ce:latest

networks:

- pgsql

- redis

- traefik

- gitlab

ports:

- 22222:22

environment:

GITLAB_OMNIBUS_CONFIG: |

postgresql['enable'] = false

redis['enable'] = false

gitlab_rails['registry_enabled'] = false

gitlab_rails['db_username'] = "gitlab"

gitlab_rails['db_password'] = "XXXXXXXXXXX"

gitlab_rails['db_host'] = "postgresql"

gitlab_rails['db_port'] = "5432"

gitlab_rails['db_database'] = "gitlab"

gitlab_rails['db_adapter'] = 'postgresql'

gitlab_rails['db_encoding'] = 'utf8'

gitlab_rails['redis_host'] = 'redis-master'

gitlab_rails['redis_port'] = '6379'

gitlab_rails['redis_password'] = 'xxxxxxxxxxx'

gitlab_rails['smtp_enable'] = true

gitlab_rails['smtp_address'] = "smtp.yandex.ru"

gitlab_rails['smtp_port'] = 465

gitlab_rails['smtp_user_name'] = "noreply@example.com"

gitlab_rails['smtp_password'] = "xxxxxxxxx"

gitlab_rails['smtp_domain'] = "example.com"

gitlab_rails['gitlab_email_from'] = 'noreply@example.com'

gitlab_rails['smtp_authentication'] = "login"

gitlab_rails['smtp_tls'] = true

gitlab_rails['smtp_enable_starttls_auto'] = true

gitlab_rails['smtp_openssl_verify_mode'] = 'peer'

external_url 'http://gitlab.example.com/'

gitlab_rails['gitlab_shell_ssh_port'] = 22222

volumes:

- gitlab_conf:/etc/gitlab

- gitlab_logs:/var/log/gitlab

- gitlab_data:/var/opt/gitlab

deploy:

mode: replicated

replicas: 1

placement:

constraints:

- node.role == manager

labels:

- traefik.enable=true

- traefik.http.routers.gitlab.rule=Host(`gitlab.example.com`)

- traefik.http.services.gitlab.loadbalancer.server.port=80

- traefik.docker.network=traefik

gitlab-runner:

image: gitlab/gitlab-runner:latest

networks:

- gitlab

volumes:

- gitlab_runner_conf:/etc/gitlab

- /var/run/docker.sock:/var/run/docker.sock

deploy:

mode: replicated

replicas: 1

placement:

constraints:

- node.role == manager

volumes:

gitlab_conf:

driver: local

driver_opts:

type: none

o: bind

device: "/srv/docker/gitlab/conf"

gitlab_logs:

driver: local

driver_opts:

type: none

o: bind

device: "/srv/docker/gitlab/logs"

gitlab_data:

driver: local

driver_opts:

type: none

o: bind

device: "/srv/docker/gitlab/data"

gitlab_runner_conf:

driver: local

driver_opts:

type: none

o: bind

device: "/srv/docker/gitlab/runner"

networks:

pgsql:

external: true

redis:

external: true

traefik:

external: true

gitlab:

external: true# mkdir -p /srv/docker/gitlab/conf

# mkdir -p /srv/docker/gitlab/logs

# mkdir -p /srv/docker/gitlab/data

# mkdir -p /srv/docker/gitlab/runner

# docker stack deploy --compose-file 08gitlab-runner.yml gitlabLokastaða klasans og þjónustu:

# docker service ls

ID NAME MODE REPLICAS IMAGE PORTS

lef9n3m92buq etcd_etcd1 replicated 1/1 quay.io/coreos/etcd:latest

ij6uyyo792x5 etcd_etcd2 replicated 1/1 quay.io/coreos/etcd:latest

fqttqpjgp6pp etcd_etcd3 replicated 1/1 quay.io/coreos/etcd:latest

hq5iyga28w33 gitlab_gitlab replicated 1/1 gitlab/gitlab-ce:latest *:22222->22/tcp

dt7s6vs0q4qc gitlab_gitlab-runner replicated 1/1 gitlab/gitlab-runner:latest

k7uoezno0h9n pgsql_pgkeeper1 replicated 1/1 sorintlab/stolon:master-pg10

cnrwul4r4nse pgsql_pgkeeper2 replicated 1/1 sorintlab/stolon:master-pg10

frflfnpty7tr pgsql_pgkeeper3 replicated 1/1 sorintlab/stolon:master-pg10

x7pqqchi52kq pgsql_pgsentinel replicated 3/3 sorintlab/stolon:master-pg10

mwu2wl8fti4r pgsql_postgresql replicated 3/3 sorintlab/stolon:master-pg10

9hkbe2vksbzb redis_redis-master global 3/3 bitnami/redis:latest *:6379->6379/tcp

l88zn8cla7dc redis_redis-replica replicated 3/3 bitnami/redis:latest *:30003->6379/tcp

1utp309xfmsy redis_redis-sentinel global 3/3 bitnami/redis:latest *:30002->16379/tcp

oteb824ylhyp registry_registry replicated 1/1 registry:2.6

qovrah8nzzu8 traefik_traefik replicated 3/3 traefik:latest *:80->80/tcp, *:443->443/tcpHvað annað er hægt að bæta? Vertu viss um að stilla Traefik til að vinna með https gámum, bættu við tls dulkóðun fyrir Postgresql og Redis. En almennt séð geturðu nú þegar gefið forriturum það sem PoC. Við skulum nú skoða valkosti við Docker.

Podman

Önnur nokkuð þekkt vél til að keyra gáma flokkaða eftir belgjum (belg, gámahópar settir saman). Ólíkt Docker, það þarf enga þjónustu til að keyra gáma, öll vinna fer fram í gegnum libpod bókasafnið. Einnig skrifað í Go, þarf OCI samhæfðan keyrslutíma til að keyra gáma eins og runC.

Að vinna með Podman líkist almennt vinnu með Docker, að því marki sem þú getur gert það svona (sem margir sem hafa reynt það halda fram, þar á meðal höfundur þessarar greinar):

$ alias docker=podmanog þú getur haldið áfram að vinna. Almennt séð er staðan með Podman mjög áhugaverð, því ef fyrstu útgáfur Kubernetes virkuðu með Docker, síðan um 2015, eftir að hafa staðlað gámaheiminn (OCI - Open Container Initiative) og skipt Docker í containerd og runC, valkost við Verið er að þróa Docker til að keyra í Kubernetes: CRI-O. Podman í þessu sambandi er valkostur við Docker, byggður á meginreglum Kubernetes, þar á meðal gámaflokkun, en meginmarkmið verkefnisins er að keyra Docker-stíl gáma án viðbótarþjónustu. Af augljósum ástæðum er enginn kvikhamur, þar sem verktaki segja greinilega að ef þú þarft þyrping skaltu taka Kubernetes.

Uppsetning

Til uppsetningar í Centos 7, virkjaðu bara Extras geymsluna og settu síðan allt upp með skipuninni:

# yum -y install podmanAðrir eiginleikar

Podman getur búið til einingar fyrir systemd og þannig leyst vandamálið við að ræsa gáma eftir endurræsingu netþjónsins. Að auki er lýst yfir að systemd virki rétt sem pid 1 í ílátinu. Til að smíða gáma er sérstakt buildah tól, það eru líka verkfæri frá þriðja aðila - hliðstæður af docker-compose, sem einnig býr til Kubernetes-samhæfðar stillingarskrár, þannig að umskiptin frá Podman til Kubernetes eru eins einföld og mögulegt er.

Að vinna með Podman

Þar sem það er engin kvikhamur (það á að skipta yfir í Kubernetes ef þörf er á klasa) munum við setja hann saman í aðskilda ílát.

Settu upp podman-compose:

# yum -y install python3-pip

# pip3 install podman-composeStillingarskráin sem myndast fyrir podman er aðeins öðruvísi, þar sem við þurftum til dæmis að færa sérstakan bindihluta beint í þjónustuhlutann.

gitlab-podman.yml

version: '3.7'

services:

gitlab:

image: gitlab/gitlab-ce:latest

hostname: gitlab.example.com

restart: unless-stopped

environment:

GITLAB_OMNIBUS_CONFIG: |

gitlab_rails['gitlab_shell_ssh_port'] = 22222

ports:

- "80:80"

- "22222:22"

volumes:

- /srv/podman/gitlab/conf:/etc/gitlab

- /srv/podman/gitlab/data:/var/opt/gitlab

- /srv/podman/gitlab/logs:/var/log/gitlab

networks:

- gitlab

gitlab-runner:

image: gitlab/gitlab-runner:alpine

restart: unless-stopped

depends_on:

- gitlab

volumes:

- /srv/podman/gitlab/runner:/etc/gitlab-runner

- /var/run/docker.sock:/var/run/docker.sock

networks:

- gitlab

networks:

gitlab:# podman-compose -f gitlab-runner.yml -d upNiðurstaða vinnu:

# podman ps

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

da53da946c01 docker.io/gitlab/gitlab-runner:alpine run --user=gitlab... About a minute ago Up About a minute ago 0.0.0.0:22222->22/tcp, 0.0.0.0:80->80/tcp root_gitlab-runner_1

781c0103c94a docker.io/gitlab/gitlab-ce:latest /assets/wrapper About a minute ago Up About a minute ago 0.0.0.0:22222->22/tcp, 0.0.0.0:80->80/tcp root_gitlab_1Við skulum sjá hvað það mun búa til fyrir systemd og kubernetes, til þess þurfum við að finna út nafn eða auðkenni fræbelgs:

# podman pod ls

POD ID NAME STATUS CREATED # OF CONTAINERS INFRA ID

71fc2b2a5c63 root Running 11 minutes ago 3 db40ab8bf84bKubernetes:

# podman generate kube 71fc2b2a5c63

# Generation of Kubernetes YAML is still under development!

#

# Save the output of this file and use kubectl create -f to import

# it into Kubernetes.

#

# Created with podman-1.6.4

apiVersion: v1

kind: Pod

metadata:

creationTimestamp: "2020-07-29T19:22:40Z"

labels:

app: root

name: root

spec:

containers:

- command:

- /assets/wrapper

env:

- name: PATH

value: /opt/gitlab/embedded/bin:/opt/gitlab/bin:/assets:/usr/local/sbin:/usr/local/bin:/usr/sbin:/usr/bin:/sbin:/bin

- name: TERM

value: xterm

- name: HOSTNAME

value: gitlab.example.com

- name: container

value: podman

- name: GITLAB_OMNIBUS_CONFIG

value: |

gitlab_rails['gitlab_shell_ssh_port'] = 22222

- name: LANG

value: C.UTF-8

image: docker.io/gitlab/gitlab-ce:latest

name: rootgitlab1

ports:

- containerPort: 22

hostPort: 22222

protocol: TCP

- containerPort: 80

hostPort: 80

protocol: TCP

resources: {}

securityContext:

allowPrivilegeEscalation: true

capabilities: {}

privileged: false

readOnlyRootFilesystem: false

volumeMounts:

- mountPath: /var/opt/gitlab

name: srv-podman-gitlab-data

- mountPath: /var/log/gitlab

name: srv-podman-gitlab-logs

- mountPath: /etc/gitlab

name: srv-podman-gitlab-conf

workingDir: /

- command:

- run

- --user=gitlab-runner

- --working-directory=/home/gitlab-runner

env:

- name: PATH

value: /usr/local/sbin:/usr/local/bin:/usr/sbin:/usr/bin:/sbin:/bin

- name: TERM

value: xterm

- name: HOSTNAME

- name: container

value: podman

image: docker.io/gitlab/gitlab-runner:alpine

name: rootgitlab-runner1

resources: {}

securityContext:

allowPrivilegeEscalation: true

capabilities: {}

privileged: false

readOnlyRootFilesystem: false

volumeMounts:

- mountPath: /etc/gitlab-runner

name: srv-podman-gitlab-runner

- mountPath: /var/run/docker.sock

name: var-run-docker.sock

workingDir: /

volumes:

- hostPath:

path: /srv/podman/gitlab/runner

type: Directory

name: srv-podman-gitlab-runner

- hostPath:

path: /var/run/docker.sock

type: File

name: var-run-docker.sock

- hostPath:

path: /srv/podman/gitlab/data

type: Directory

name: srv-podman-gitlab-data

- hostPath:

path: /srv/podman/gitlab/logs

type: Directory

name: srv-podman-gitlab-logs

- hostPath:

path: /srv/podman/gitlab/conf

type: Directory

name: srv-podman-gitlab-conf

status: {}systemd:

# podman generate systemd 71fc2b2a5c63

# pod-71fc2b2a5c6346f0c1c86a2dc45dbe78fa192ea02aac001eb8347ccb8c043c26.service

# autogenerated by Podman 1.6.4

# Thu Jul 29 15:23:28 EDT 2020

[Unit]

Description=Podman pod-71fc2b2a5c6346f0c1c86a2dc45dbe78fa192ea02aac001eb8347ccb8c043c26.service

Documentation=man:podman-generate-systemd(1)

Requires=container-781c0103c94aaa113c17c58d05ddabf8df4bf39707b664abcf17ed2ceff467d3.service container-da53da946c01449f500aa5296d9ea6376f751948b17ca164df438b7df6607864.service

Before=container-781c0103c94aaa113c17c58d05ddabf8df4bf39707b664abcf17ed2ceff467d3.service container-da53da946c01449f500aa5296d9ea6376f751948b17ca164df438b7df6607864.service

[Service]

Restart=on-failure

ExecStart=/usr/bin/podman start db40ab8bf84bf35141159c26cb6e256b889c7a98c0418eee3c4aa683c14fccaa

ExecStop=/usr/bin/podman stop -t 10 db40ab8bf84bf35141159c26cb6e256b889c7a98c0418eee3c4aa683c14fccaa

KillMode=none

Type=forking

PIDFile=/var/run/containers/storage/overlay-containers/db40ab8bf84bf35141159c26cb6e256b889c7a98c0418eee3c4aa683c14fccaa/userdata/conmon.pid

[Install]

WantedBy=multi-user.target

# container-da53da946c01449f500aa5296d9ea6376f751948b17ca164df438b7df6607864.service

# autogenerated by Podman 1.6.4

# Thu Jul 29 15:23:28 EDT 2020

[Unit]

Description=Podman container-da53da946c01449f500aa5296d9ea6376f751948b17ca164df438b7df6607864.service

Documentation=man:podman-generate-systemd(1)

RefuseManualStart=yes

RefuseManualStop=yes

BindsTo=pod-71fc2b2a5c6346f0c1c86a2dc45dbe78fa192ea02aac001eb8347ccb8c043c26.service

After=pod-71fc2b2a5c6346f0c1c86a2dc45dbe78fa192ea02aac001eb8347ccb8c043c26.service

[Service]

Restart=on-failure

ExecStart=/usr/bin/podman start da53da946c01449f500aa5296d9ea6376f751948b17ca164df438b7df6607864

ExecStop=/usr/bin/podman stop -t 10 da53da946c01449f500aa5296d9ea6376f751948b17ca164df438b7df6607864

KillMode=none

Type=forking

PIDFile=/var/run/containers/storage/overlay-containers/da53da946c01449f500aa5296d9ea6376f751948b17ca164df438b7df6607864/userdata/conmon.pid

[Install]

WantedBy=multi-user.target

# container-781c0103c94aaa113c17c58d05ddabf8df4bf39707b664abcf17ed2ceff467d3.service

# autogenerated by Podman 1.6.4

# Thu Jul 29 15:23:28 EDT 2020

[Unit]

Description=Podman container-781c0103c94aaa113c17c58d05ddabf8df4bf39707b664abcf17ed2ceff467d3.service

Documentation=man:podman-generate-systemd(1)

RefuseManualStart=yes

RefuseManualStop=yes

BindsTo=pod-71fc2b2a5c6346f0c1c86a2dc45dbe78fa192ea02aac001eb8347ccb8c043c26.service

After=pod-71fc2b2a5c6346f0c1c86a2dc45dbe78fa192ea02aac001eb8347ccb8c043c26.service

[Service]

Restart=on-failure

ExecStart=/usr/bin/podman start 781c0103c94aaa113c17c58d05ddabf8df4bf39707b664abcf17ed2ceff467d3

ExecStop=/usr/bin/podman stop -t 10 781c0103c94aaa113c17c58d05ddabf8df4bf39707b664abcf17ed2ceff467d3

KillMode=none

Type=forking

PIDFile=/var/run/containers/storage/overlay-containers/781c0103c94aaa113c17c58d05ddabf8df4bf39707b664abcf17ed2ceff467d3/userdata/conmon.pid

[Install]

WantedBy=multi-user.targetÞví miður, fyrir utan að ræsa gáma, gerir útbúna einingin fyrir systemd ekkert annað (til dæmis að þrífa upp gamla gáma þegar slík þjónusta er endurræst), svo þú verður að bæta slíkum hlutum við sjálfur.

Í grundvallaratriðum er Podman nóg til að prófa hvað gámar eru, flytja gamlar stillingar fyrir docker-compose, og fara síðan í átt að Kubernetes, ef nauðsyn krefur, á þyrping, eða fá auðveldari í notkun valkost við Docker.

rkt

Project fyrir um hálfu ári vegna þess að RedHat keypti það, svo ég mun ekki fjölyrða um það nánar. Almennt séð skildi það eftir mjög góð áhrif, en miðað við Docker, og jafnvel frekar Podman, lítur það út eins og sameina. Það var líka CoreOS dreifing byggð ofan á rkt (þó þeir hafi upphaflega haft Docker), en það endaði líka eftir RedHat kaupin.

Flash

Meira , höfundur sem vildi bara byggja og reka gáma. Af skjölum og kóða að dæma fylgdi höfundurinn ekki stöðlunum heldur ákvað hann einfaldlega að skrifa sína eigin útfærslu, sem hann gerði í grundvallaratriðum.

Niðurstöður

Staðan með Kubernetes er mjög áhugaverð: annars vegar, með Docker, geturðu sett saman þyrping (í kvikham), sem þú getur jafnvel keyrt framleiðsluumhverfi fyrir viðskiptavini, þetta á sérstaklega við um lítil teymi (3-5 manns) ), eða með lítið heildarálag , eða skortur á löngun til að skilja ranghala við að setja upp Kubernetes, þar á meðal fyrir mikið álag.

Podman veitir ekki fullan eindrægni, en það hefur einn mikilvægan kost - eindrægni við Kubernetes, þar á meðal viðbótarverkfæri (buildah og aðrir). Þess vegna mun ég nálgast val á verkfæri fyrir vinnu sem hér segir: fyrir lítil teymi, eða með takmarkað fjárhagsáætlun - Docker (með mögulegum kvikham), til að þróa fyrir sjálfan mig á persónulegum staðbundnum gestgjafa - Podman félagar og fyrir alla aðra - Kubernetes.

Ég er ekki viss um að ástandið með Docker muni ekki breytast í framtíðinni, þeir eru jú brautryðjendur og smám saman eru þeir að verða staðlaðir, en Podman, þrátt fyrir alla sína galla (vinnur aðeins á Linux, engin þyrping, samsetning og aðrar aðgerðir eru framkvæmdar af lausnum frá þriðja aðila) framtíðin er skýrari, svo ég býð alla að ræða þessar niðurstöður í athugasemdunum.

PS Þann 3. ágúst kynnum við "þar sem þú getur lært meira um verk hans. Við munum greina öll verkfæri þess: frá grunnútdrætti til netbreyta, blæbrigði þess að vinna með ýmis stýrikerfi og forritunarmál. Þú munt kynnast tækninni og skilja hvar og hvernig best er að nota Docker. Við munum einnig deila bestu starfsvenjum.

Forpöntunarkostnaður fyrir útgáfu: 5000 rúblur. Forritið "Docker Video Course" er að finna .

Heimild: www.habr.com