ログ、メトリック、イベント データを収集、変換、送信するように設計されています。

→

Rust 言語で書かれているため、類似言語と比較してパフォーマンスが高く、RAM 消費量が少ないことが特徴です。 さらに、正確性に関連する機能、特に未送信のイベントをディスク上のバッファに保存し、ファイルをローテーションする機能にも多くの注意が払われています。

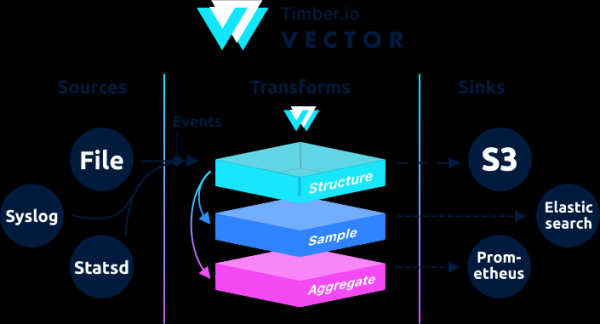

アーキテクチャ的には、Vector は XNUMX つ以上のメッセージを受信するイベント ルーターです。 ソースの、オプションでこれらのメッセージに適用されます 変換、それらを XNUMX つ以上に送信します 排水溝.

VectorはFilebeatとLogstashの代替品であり、ログの受信と送信の両方の役割を果たすことができます。詳細については、 .

Logstashでは入力→フィルター→出力というチェーンが構築されますが、Vectorでは → →

例はドキュメントに記載されています。

この指示は、 。元の手順には geoip 処理が含まれています。内部ネットワークから geoip をテストしたところ、vector でエラーが発生しました。

Aug 05 06:25:31.889 DEBUG transform{name=nginx_parse_rename_fields type=rename_fields}: vector::transforms::rename_fields: Field did not exist field=«geoip.country_name» rate_limit_secs=30ジオIPを処理する必要がある場合は、元の手順を参照してください。 .

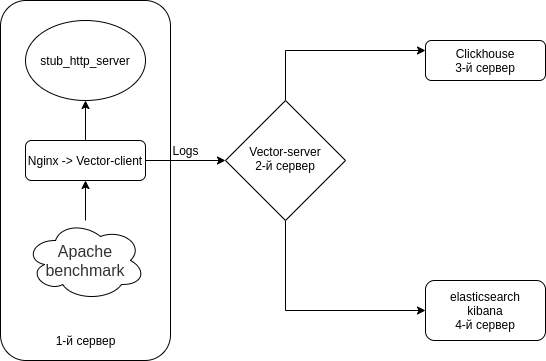

Nginx (アクセス ログ) → Vector (クライアント | Filebeat) → Vector (サーバー | Logstash) バンドル → Clickhouse と Elasticsearch で個別に設定していきます。サーバーを4台設置します。ただし、3 つのサーバーでバイパスすることは可能です。

概略は以下のとおりです。

すべてのサーバーでSelinuxを無効にする

sed -i 's/^SELINUX=.*/SELINUX=disabled/g' /etc/selinux/config

rebootすべてのサーバーにHTTPサーバーエミュレーターとユーティリティをインストールします

HTTPサーバーエミュレータとして使用します から

Nodejs-stub-server には rpm がありません。 そのための rpm を作成します。 rpm は次を使用してコンパイルされます

リポジトリ antonpatsev/nodejs-stub-server の追加

yum -y install yum-plugin-copr epel-release

yes | yum copr enable antonpatsev/nodejs-stub-serverすべてのサーバーにnodejs-stub-server、Apacheベンチマーク、ターミナルマルチプレクサ画面をインストールします。

yum -y install stub_http_server screen mc httpd-tools screenより多くのログが存在するように、ファイル /var/lib/stub_http_server/stub_http_server.js 内の stub_http_server 応答時間を修正しました。

var max_sleep = 10;stub_http_serverを起動しましょう。

systemctl start stub_http_server

systemctl enable stub_http_serverサーバー3

ClickHouse は SSE 4.2 命令セットを使用するため、特に明記されていない限り、使用するプロセッサでのサポートが追加のシステム要件になります。現在のプロセッサが SSE 4.2 をサポートしているかどうかを確認するコマンドは次のとおりです。

grep -q sse4_2 /proc/cpuinfo && echo "SSE 4.2 supported" || echo "SSE 4.2 not supported"まず、公式リポジトリに接続する必要があります。

sudo yum install -y yum-utils

sudo rpm --import https://repo.clickhouse.tech/CLICKHOUSE-KEY.GPG

sudo yum-config-manager --add-repo https://repo.clickhouse.tech/rpm/stable/x86_64パッケージをインストールするには、次のコマンドを実行する必要があります。

sudo yum install -y clickhouse-server clickhouse-client/etc/clickhouse-server/config.xmlファイルでclickhouse-serverがネットワークカードをリッスンできるようにします。

<listen_host>0.0.0.0</listen_host>ログレベルをトレースからデバッグに変更する

debug

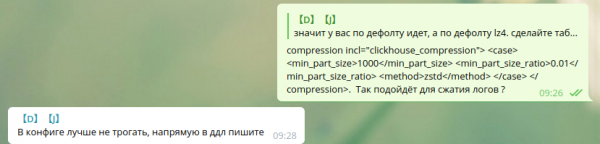

圧縮設定は標準です:

min_compress_block_size 65536

max_compress_block_size 1048576Zstd を有効にするには、構成を変更するのではなく、DDL を使用することが推奨されました。

Google で DDL 経由で zstd 圧縮を適用する方法を見つけることができませんでした。だからそのままにしました。

Clickhouse で zstd 圧縮を使用している同僚の皆さん、手順を共有してください。

サーバーをデーモンとして起動するには、次のコマンドを実行します。

service clickhouse-server startそれではClickhouseの設定に移りましょう

クリックハウスへ行こう

clickhouse-client -h 172.26.10.109 -m172.26.10.109 — Clickhouse がインストールされているサーバーの IP。

ベクターDBを作成してみましょう

CREATE DATABASE vector;データベースが存在するか確認してみましょう。

show databases;vector.logs テーブルを作成します。

/* Это таблица где хранятся логи как есть */

CREATE TABLE vector.logs

(

`node_name` String,

`timestamp` DateTime,

`server_name` String,

`user_id` String,

`request_full` String,

`request_user_agent` String,

`request_http_host` String,

`request_uri` String,

`request_scheme` String,

`request_method` String,

`request_length` UInt64,

`request_time` Float32,

`request_referrer` String,

`response_status` UInt16,

`response_body_bytes_sent` UInt64,

`response_content_type` String,

`remote_addr` IPv4,

`remote_port` UInt32,

`remote_user` String,

`upstream_addr` IPv4,

`upstream_port` UInt32,

`upstream_bytes_received` UInt64,

`upstream_bytes_sent` UInt64,

`upstream_cache_status` String,

`upstream_connect_time` Float32,

`upstream_header_time` Float32,

`upstream_response_length` UInt64,

`upstream_response_time` Float32,

`upstream_status` UInt16,

`upstream_content_type` String,

INDEX idx_http_host request_http_host TYPE set(0) GRANULARITY 1

)

ENGINE = MergeTree()

PARTITION BY toYYYYMMDD(timestamp)

ORDER BY timestamp

TTL timestamp + toIntervalMonth(1)

SETTINGS index_granularity = 8192;テーブルが作成されたことを確認しましょう。さあ始めましょう clickhouse-client そして私たちはリクエストを出します。

ベクターデータベースに行きましょう。

use vector;

Ok.

0 rows in set. Elapsed: 0.001 sec.表を見てみましょう。

show tables;

┌─name────────────────┐

│ logs │

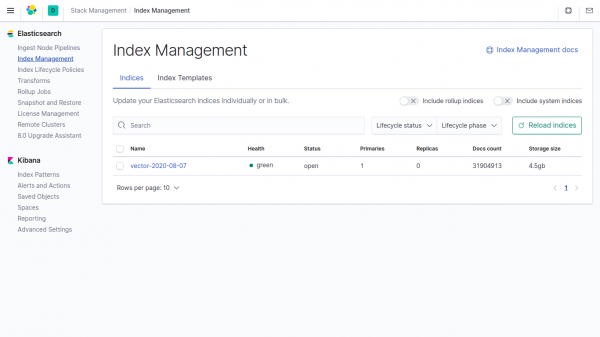

└─────────────────────┘Clickhouseと比較するために、4番目のサーバーにelasticsearchをインストールして、同じデータをElasticsearchに送信します。

公開rpmキーを追加しましょう

rpm --import https://artifacts.elastic.co/GPG-KEY-elasticsearch2 つのリポジトリを作成しましょう:

/etc/yum.repos.d/elasticsearch.repo

[elasticsearch]

name=Elasticsearch repository for 7.x packages

baseurl=https://artifacts.elastic.co/packages/7.x/yum

gpgcheck=1

gpgkey=https://artifacts.elastic.co/GPG-KEY-elasticsearch

enabled=0

autorefresh=1

type=rpm-mdリポジトリ

[kibana-7.x]

name=Kibana repository for 7.x packages

baseurl=https://artifacts.elastic.co/packages/7.x/yum

gpgcheck=1

gpgkey=https://artifacts.elastic.co/GPG-KEY-elasticsearch

enabled=1

autorefresh=1

type=rpm-mdelasticsearchとkibanaをインストールする

yum install -y kibana elasticsearchコピーは 1 つなので、/etc/elasticsearch/elasticsearch.yml ファイルに以下を追加する必要があります。

discovery.type: single-nodevector が別のサーバーから elasticsearch にデータを送信できるようにするには、network.host を変更します。

network.host: 0.0.0.0Kibanaに接続するには、/etc/kibana/kibana.ymlファイルのserver.hostパラメータを変更します。

server.host: "0.0.0.0"私たちは古く、elasticsearchを自動起動で有効にしています

systemctl enable elasticsearch

systemctl start elasticsearchキバナ

systemctl enable kibana

systemctl start kibanaシングルノード モード 1 シャード、0 レプリカ用に Elasticsearch を構成します。おそらく、多数のサーバーのクラスターが存在するため、これを行う必要はありません。

将来のインデックス用に、デフォルトのテンプレートを更新します。

curl -X PUT http://localhost:9200/_template/default -H 'Content-Type: application/json' -d '{"index_patterns": ["*"],"order": -1,"settings": {"number_of_shards": "1","number_of_replicas": "0"}}' インストール サーバー2のLogstashの代わりとして

yum install -y https://packages.timber.io/vector/0.9.X/vector-x86_64.rpm mc httpd-tools screenLogstash の代わりに Vector を設定しましょう。ファイル /etc/vector/vector.toml を編集する

# /etc/vector/vector.toml

data_dir = "/var/lib/vector"

[sources.nginx_input_vector]

# General

type = "vector"

address = "0.0.0.0:9876"

shutdown_timeout_secs = 30

[transforms.nginx_parse_json]

inputs = [ "nginx_input_vector" ]

type = "json_parser"

[transforms.nginx_parse_add_defaults]

inputs = [ "nginx_parse_json" ]

type = "lua"

version = "2"

hooks.process = """

function (event, emit)

function split_first(s, delimiter)

result = {};

for match in (s..delimiter):gmatch("(.-)"..delimiter) do

table.insert(result, match);

end

return result[1];

end

function split_last(s, delimiter)

result = {};

for match in (s..delimiter):gmatch("(.-)"..delimiter) do

table.insert(result, match);

end

return result[#result];

end

event.log.upstream_addr = split_first(split_last(event.log.upstream_addr, ', '), ':')

event.log.upstream_bytes_received = split_last(event.log.upstream_bytes_received, ', ')

event.log.upstream_bytes_sent = split_last(event.log.upstream_bytes_sent, ', ')

event.log.upstream_connect_time = split_last(event.log.upstream_connect_time, ', ')

event.log.upstream_header_time = split_last(event.log.upstream_header_time, ', ')

event.log.upstream_response_length = split_last(event.log.upstream_response_length, ', ')

event.log.upstream_response_time = split_last(event.log.upstream_response_time, ', ')

event.log.upstream_status = split_last(event.log.upstream_status, ', ')

if event.log.upstream_addr == "" then

event.log.upstream_addr = "127.0.0.1"

end

if (event.log.upstream_bytes_received == "-" or event.log.upstream_bytes_received == "") then

event.log.upstream_bytes_received = "0"

end

if (event.log.upstream_bytes_sent == "-" or event.log.upstream_bytes_sent == "") then

event.log.upstream_bytes_sent = "0"

end

if event.log.upstream_cache_status == "" then

event.log.upstream_cache_status = "DISABLED"

end

if (event.log.upstream_connect_time == "-" or event.log.upstream_connect_time == "") then

event.log.upstream_connect_time = "0"

end

if (event.log.upstream_header_time == "-" or event.log.upstream_header_time == "") then

event.log.upstream_header_time = "0"

end

if (event.log.upstream_response_length == "-" or event.log.upstream_response_length == "") then

event.log.upstream_response_length = "0"

end

if (event.log.upstream_response_time == "-" or event.log.upstream_response_time == "") then

event.log.upstream_response_time = "0"

end

if (event.log.upstream_status == "-" or event.log.upstream_status == "") then

event.log.upstream_status = "0"

end

emit(event)

end

"""

[transforms.nginx_parse_remove_fields]

inputs = [ "nginx_parse_add_defaults" ]

type = "remove_fields"

fields = ["data", "file", "host", "source_type"]

[transforms.nginx_parse_coercer]

type = "coercer"

inputs = ["nginx_parse_remove_fields"]

types.request_length = "int"

types.request_time = "float"

types.response_status = "int"

types.response_body_bytes_sent = "int"

types.remote_port = "int"

types.upstream_bytes_received = "int"

types.upstream_bytes_send = "int"

types.upstream_connect_time = "float"

types.upstream_header_time = "float"

types.upstream_response_length = "int"

types.upstream_response_time = "float"

types.upstream_status = "int"

types.timestamp = "timestamp"

[sinks.nginx_output_clickhouse]

inputs = ["nginx_parse_coercer"]

type = "clickhouse"

database = "vector"

healthcheck = true

host = "http://172.26.10.109:8123" # Адрес Clickhouse

table = "logs"

encoding.timestamp_format = "unix"

buffer.type = "disk"

buffer.max_size = 104900000

buffer.when_full = "block"

request.in_flight_limit = 20

[sinks.elasticsearch]

type = "elasticsearch"

inputs = ["nginx_parse_coercer"]

compression = "none"

healthcheck = true

# 172.26.10.116 - сервер где установен elasticsearch

host = "http://172.26.10.116:9200"

index = "vector-%Y-%m-%d"transforms.nginx_parse_add_defaults セクションを調整できます。

として これらの設定は小規模なCDNに使用されており、upstream_*に複数の値が到着する可能性があります。

たとえば、次のように

"upstream_addr": "128.66.0.10:443, 128.66.0.11:443, 128.66.0.12:443"

"upstream_bytes_received": "-, -, 123"

"upstream_status": "502, 502, 200"これが当てはまらない場合は、このセクションを簡略化できます。

systemdのサービス設定を作成しましょう /etc/systemd/system/vector.service

# /etc/systemd/system/vector.service

[Unit]

Description=Vector

After=network-online.target

Requires=network-online.target

[Service]

User=vector

Group=vector

ExecStart=/usr/bin/vector

ExecReload=/bin/kill -HUP $MAINPID

Restart=no

StandardOutput=syslog

StandardError=syslog

SyslogIdentifier=vector

[Install]

WantedBy=multi-user.targetテーブルが作成されると、Vector を実行できます。

systemctl enable vector

systemctl start vectorベクターログは次のように表示されます

journalctl -f -u vectorログには次のようなエントリが含まれているはずです

INFO vector::topology::builder: Healthcheck: Passed.

INFO vector::topology::builder: Healthcheck: Passed.クライアント側(Webサーバー) - 1台目のサーバー

nginxのサーバーでは、clickhouseのログテーブルがフィールドを使用するため、ipv6を無効にする必要があります。 upstream_addr ネットワーク内で IPv4 を使用しないため、 IPv6 です。 ipv6 が無効になっていない場合、エラーが発生します:

DB::Exception: Invalid IPv4 value.: (while read the value of key upstream_addr)読者の皆さん、IPv6 サポートを追加してください。

/etc/sysctl.d/98-disable-ipv6.confファイルを作成します。

net.ipv6.conf.all.disable_ipv6 = 1

net.ipv6.conf.default.disable_ipv6 = 1

net.ipv6.conf.lo.disable_ipv6 = 1設定を適用する

sysctl --systemnginxをインストールしましょう。

nginx リポジトリ ファイル /etc/yum.repos.d/nginx.repo を追加しました

[nginx-stable]

name=nginx stable repo

baseurl=http://nginx.org/packages/centos/$releasever/$basearch/

gpgcheck=1

enabled=1

gpgkey=https://nginx.org/keys/nginx_signing.key

module_hotfixes=truenginxパッケージをインストールする

yum install -y nginxまず、/etc/nginx/nginx.confファイルでNginxのログ形式を設定する必要があります。

user nginx;

# you must set worker processes based on your CPU cores, nginx does not benefit from setting more than that

worker_processes auto; #some last versions calculate it automatically

# number of file descriptors used for nginx

# the limit for the maximum FDs on the server is usually set by the OS.

# if you don't set FD's then OS settings will be used which is by default 2000

worker_rlimit_nofile 100000;

error_log /var/log/nginx/error.log warn;

pid /var/run/nginx.pid;

# provides the configuration file context in which the directives that affect connection processing are specified.

events {

# determines how much clients will be served per worker

# max clients = worker_connections * worker_processes

# max clients is also limited by the number of socket connections available on the system (~64k)

worker_connections 4000;

# optimized to serve many clients with each thread, essential for linux -- for testing environment

use epoll;

# accept as many connections as possible, may flood worker connections if set too low -- for testing environment

multi_accept on;

}

http {

include /etc/nginx/mime.types;

default_type application/octet-stream;

log_format main '$remote_addr - $remote_user [$time_local] "$request" '

'$status $body_bytes_sent "$http_referer" '

'"$http_user_agent" "$http_x_forwarded_for"';

log_format vector escape=json

'{'

'"node_name":"nginx-vector",'

'"timestamp":"$time_iso8601",'

'"server_name":"$server_name",'

'"request_full": "$request",'

'"request_user_agent":"$http_user_agent",'

'"request_http_host":"$http_host",'

'"request_uri":"$request_uri",'

'"request_scheme": "$scheme",'

'"request_method":"$request_method",'

'"request_length":"$request_length",'

'"request_time": "$request_time",'

'"request_referrer":"$http_referer",'

'"response_status": "$status",'

'"response_body_bytes_sent":"$body_bytes_sent",'

'"response_content_type":"$sent_http_content_type",'

'"remote_addr": "$remote_addr",'

'"remote_port": "$remote_port",'

'"remote_user": "$remote_user",'

'"upstream_addr": "$upstream_addr",'

'"upstream_bytes_received": "$upstream_bytes_received",'

'"upstream_bytes_sent": "$upstream_bytes_sent",'

'"upstream_cache_status":"$upstream_cache_status",'

'"upstream_connect_time":"$upstream_connect_time",'

'"upstream_header_time":"$upstream_header_time",'

'"upstream_response_length":"$upstream_response_length",'

'"upstream_response_time":"$upstream_response_time",'

'"upstream_status": "$upstream_status",'

'"upstream_content_type":"$upstream_http_content_type"'

'}';

access_log /var/log/nginx/access.log main;

access_log /var/log/nginx/access.json.log vector; # Новый лог в формате json

sendfile on;

#tcp_nopush on;

keepalive_timeout 65;

#gzip on;

include /etc/nginx/conf.d/*.conf;

}現在の構成が壊れないように、Nginx では複数の access_log ディレクティブを使用できます。

access_log /var/log/nginx/access.log main; # Стандартный лог

access_log /var/log/nginx/access.json.log vector; # Новый лог в формате json新しいログの logrotate にルールを追加することを忘れないでください (ログ ファイルが .log で終わらない場合)

/etc/nginx/conf.d/ から default.conf を削除します。

rm -f /etc/nginx/conf.d/default.conf仮想ホスト /etc/nginx/conf.d/vhost1.conf を追加します。

server {

listen 80;

server_name vhost1;

location / {

proxy_pass http://172.26.10.106:8080;

}

}仮想ホスト /etc/nginx/conf.d/vhost2.conf を追加します。

server {

listen 80;

server_name vhost2;

location / {

proxy_pass http://172.26.10.108:8080;

}

}仮想ホスト /etc/nginx/conf.d/vhost3.conf を追加します。

server {

listen 80;

server_name vhost3;

location / {

proxy_pass http://172.26.10.109:8080;

}

}仮想ホスト /etc/nginx/conf.d/vhost4.conf を追加します。

server {

listen 80;

server_name vhost4;

location / {

proxy_pass http://172.26.10.116:8080;

}

}すべてのサーバーの /etc/hosts ファイル (nginx がインストールされているサーバーの IP 172.26.10.106) に仮想ホストを追加します。

172.26.10.106 vhost1

172.26.10.106 vhost2

172.26.10.106 vhost3

172.26.10.106 vhost4そして準備が整ったら

nginx -t

systemctl restart nginxさあ、自分でインストールしてみましょう

yum install -y https://packages.timber.io/vector/0.9.X/vector-x86_64.rpmsystemdの設定ファイルを作成しましょう /etc/systemd/system/vector.service

[Unit]

Description=Vector

After=network-online.target

Requires=network-online.target

[Service]

User=vector

Group=vector

ExecStart=/usr/bin/vector

ExecReload=/bin/kill -HUP $MAINPID

Restart=no

StandardOutput=syslog

StandardError=syslog

SyslogIdentifier=vector

[Install]

WantedBy=multi-user.targetそして、/etc/vector/vector.toml 構成で Filebeat の置換を構成します。 IPアドレス172.26.10.108はログサーバー(Vector-Server)のIPアドレスです。

data_dir = "/var/lib/vector"

[sources.nginx_file]

type = "file"

include = [ "/var/log/nginx/access.json.log" ]

start_at_beginning = false

fingerprinting.strategy = "device_and_inode"

[sinks.nginx_output_vector]

type = "vector"

inputs = [ "nginx_file" ]

address = "172.26.10.108:9876"Не забудте добавить юзера vector в нужную группу что бы он мог читать log файлы. Например, nginx в centos создает логи с правами группы adm.

usermod -a -G adm vectorベクターサービスを開始しましょう

systemctl enable vector

systemctl start vectorベクターログは次のように表示されます

journalctl -f -u vectorログにはこのようなエントリがあるはずです

INFO vector::topology::builder: Healthcheck: Passed.ストレステスト

Apacheベンチマークを使用してテストを実施します。

httpd-tools パッケージがすべてのサーバーにインストールされました。

画面内の 4 つの異なるサーバーから Apache ベンチマークを使用してテストを実行します。まず、スクリーン ターミナル マルチプレクサを起動し、次に Apache ベンチマークを使用してテストを実行します。画面の操作方法については、 .

1番目のサーバーから

while true; do ab -H "User-Agent: 1server" -c 100 -n 10 -t 10 http://vhost1/; sleep 1; done2番目のサーバーから

while true; do ab -H "User-Agent: 2server" -c 100 -n 10 -t 10 http://vhost2/; sleep 1; done3番目のサーバーから

while true; do ab -H "User-Agent: 3server" -c 100 -n 10 -t 10 http://vhost3/; sleep 1; done4番目のサーバーから

while true; do ab -H "User-Agent: 4server" -c 100 -n 10 -t 10 http://vhost4/; sleep 1; doneClickhouseでデータをチェックしてみましょう

クリックハウスへ行こう

clickhouse-client -h 172.26.10.109 -mSQLクエリを作成します

SELECT * FROM vector.logs;

┌─node_name────┬───────────timestamp─┬─server_name─┬─user_id─┬─request_full───┬─request_user_agent─┬─request_http_host─┬─request_uri─┬─request_scheme─┬─request_method─┬─request_length─┬─request_time─┬─request_referrer─┬─response_status─┬─response_body_bytes_sent─┬─response_content_type─┬───remote_addr─┬─remote_port─┬─remote_user─┬─upstream_addr─┬─upstream_port─┬─upstream_bytes_received─┬─upstream_bytes_sent─┬─upstream_cache_status─┬─upstream_connect_time─┬─upstream_header_time─┬─upstream_response_length─┬─upstream_response_time─┬─upstream_status─┬─upstream_content_type─┐

│ nginx-vector │ 2020-08-07 04:32:42 │ vhost1 │ │ GET / HTTP/1.0 │ 1server │ vhost1 │ / │ http │ GET │ 66 │ 0.028 │ │ 404 │ 27 │ │ 172.26.10.106 │ 45886 │ │ 172.26.10.106 │ 0 │ 109 │ 97 │ DISABLED │ 0 │ 0.025 │ 27 │ 0.029 │ 404 │ │

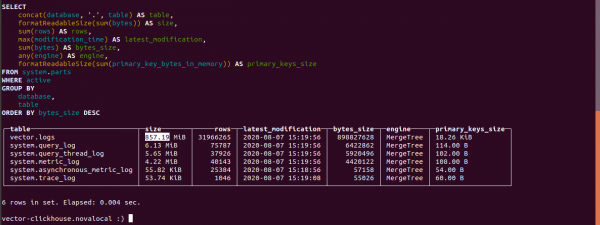

└──────────────┴─────────────────────┴─────────────┴─────────┴────────────────┴────────────────────┴───────────────────┴─────────────┴────────────────┴────────────────┴────────────────┴──────────────┴──────────────────┴─────────────────┴──────────────────────────┴───────────────────────┴───────────────┴─────────────┴─────────────┴───────────────┴───────────────┴─────────────────────────┴─────────────────────┴───────────────────────┴───────────────────────┴──────────────────────┴──────────────────────────┴────────────────────────┴─────────────────┴───────────────────────Clickhouseのテーブルのサイズを確認する

select concat(database, '.', table) as table,

formatReadableSize(sum(bytes)) as size,

sum(rows) as rows,

max(modification_time) as latest_modification,

sum(bytes) as bytes_size,

any(engine) as engine,

formatReadableSize(sum(primary_key_bytes_in_memory)) as primary_keys_size

from system.parts

where active

group by database, table

order by bytes_size desc;Clickhouse でログが占めるスペースの量を確認してみましょう。

ログ テーブルのサイズは 857.19 MB です。

Elasticsearch のインデックス内の同じデータのサイズは 4,5 GB です。

パラメータでベクトルを指定しない場合、Clickhouse のデータは Elasticsearch の 4500/857.19 = 5.24 倍少なくなります。

ベクターでは、圧縮フィールドがデフォルトで使用されます。

Telegramチャット

Telegramチャット

Telegramチャット「"

出所: habr.com