Klompok peneliti saka Universitas Stanford nyinaoni pengaruh nggunakake asisten cerdas nalika nulis kode babagan muncule kerentanan ing kode kasebut. Solusi adhedhasar platform pembelajaran mesin OpenAI Codex dianggep, kayata GitHub Copilot, sing ngidini sampeyan nggawe blok kode sing cukup rumit, nganti fungsi sing wis siap. Keprigelan ana hubungane karo kasunyatan amarga kode nyata saka repositori GitHub umum digunakake kanggo nglatih model pembelajaran mesin, kalebu kode sing ngemot kerentanan, kode sing disintesis bisa mbaleni kesalahan lan nawakake kode sing ngemot kerentanan, uga ora nggatekake kabutuhan kanggo nindakake pemeriksaan tambahan nalika ngolah data eksternal.

Panaliten kasebut melu 47 sukarelawan kanthi tingkat pengalaman program sing beda-beda, saka siswa nganti profesional kanthi pengalaman sepuluh taun. Peserta dibagi dadi rong klompok: eksperimen (33 wong) lan kontrol (14 wong). Klompok loro kasebut nduweni akses menyang perpustakaan lan sumber daya Internet, kalebu conto sing wis digawe saka Stack Overflow. Klompok eksperimen diwenehi kesempatan kanggo nggunakake asisten AI.

Saben peserta diwenehi 5 tugas sing ana gandhengane karo nulis kode sing bisa uga gampang nggawe kesalahan sing nyebabake kerentanan. Contone, ana tugas nulis fungsi enkripsi lan dekripsi, nggunakake teken digital, ngolah data sing ana ing pambentukan path file utawa pitakon SQL, manipulasi nomer akeh ing kode C, lan ngolah input sing ditampilake ing kaca web. Kanggo nimbang pengaruh basa pamrograman ing keamanan kode sing dipikolehi nalika nggunakake asisten AI, tugas kasebut kalebu Python, C, lan JavaScript.

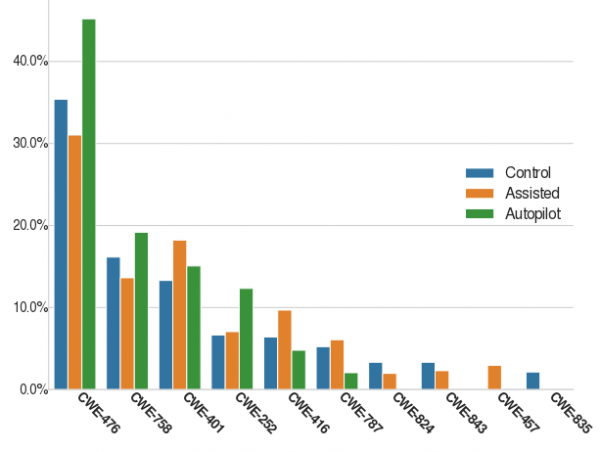

Asil kasebut nuduhake yen peserta sing nggunakake asisten AI sing cerdas adhedhasar model codex-davinci-002 ngasilake kode sing kurang aman tinimbang peserta sing ora nggunakake asisten AI. Sakabèhé, mung 67% peserta ing grup asisten AI sing bisa nyedhiyakake kode sing bener lan aman, dene ing grup liyane, angka iki 79%.

Ing wektu sing padha, indikator evaluasi diri padha sebaliknya - peserta sing nggunakake asisten AI percaya yen kode kasebut bakal luwih aman tinimbang peserta saka grup liyane. Kajaba iku, dicathet yen peserta sing kurang percaya marang asisten AI lan luwih akeh wektu kanggo nganalisa pituduh lan nggawe owah-owahan, ngidini kerentanan luwih sithik ing kode kasebut.

Contone, kode sing disalin saka perpustakaan kriptografi ngemot nilai parameter standar sing luwih aman tinimbang kode sing disaranake dening asisten AI. Kajaba iku, nalika nggunakake asisten AI, pilihan algoritma enkripsi sing kurang dipercaya lan ora ana mriksa kanggo keaslian nilai bali dicathet. Ing tugas sing ana gandhengane karo manipulasi angka ing basa C, kode sing ditulis nggunakake asisten AI ngemot luwih akeh kesalahan sing nyebabake overflow integer.

Kajaba iku, panaliten sing padha dening klompok ing Universitas New York ing wulan Nopember nglibatake 58 siswa sing dijaluk ngetrapake struktur kanggo ngolah dhaptar blanja ing C. Asil kasebut nuduhake manawa asisten AI ora duwe pengaruh kanggo keamanan kode - pangguna sing nggunakake asisten AI nggawe rata-rata 10% luwih akeh kesalahan sing gegandhengan karo keamanan.

Source: opennet.ru