، د لاګ ډیټا ، میټریکونو او پیښو راټولولو ، بدلولو او لیږلو لپاره ډیزاین شوی.

→

د زنګ په ژبه لیکل کیږي، دا د دې انالوګونو په پرتله د لوړ فعالیت او ټیټ RAM مصرف لخوا مشخص شوی. سربیره پردې ، د سموالي پورې اړوند دندو ته خورا پاملرنه ورکول کیږي ، په ځانګړي توګه ، په ډیسک کې بفر ته د نه لیږل شوي پیښو خوندي کولو وړتیا او فایلونه ګرځول.

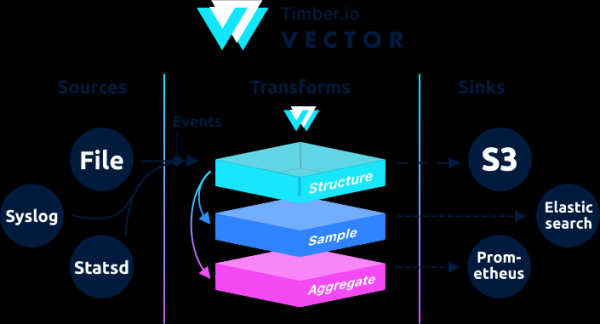

په معمارۍ کې، ویکتور د پیښې روټر دی چې د یو یا ډیرو څخه پیغامونه ترلاسه کوي سرچینېپه اختیاري توګه په دې پیغامونو کې پلي کول بدلونونه، او یو یا ډیرو ته یې لیږل ډنډونه.

ویکتور د فایل بیټ او لوګسټاش لپاره بدیل دی، دا کولی شي په دواړو رولونو کې عمل وکړي (لاګ ترلاسه کول او لیږل)، د دوی په اړه نور توضیحات .

که په Logstash کې زنځیر د انپټ → فلټر → آوټ پوټ په توګه جوړ شوی وي نو په ویکتور کې دا دی → →

مثالونه په اسنادو کې موندل کیدی شي.

دا لارښونه د بیاکتنې لارښوونې دي . اصلي لارښوونې د جیوپ پروسس لري. کله چې د داخلي شبکې څخه geoip ازموینه کول، ویکتور یوه تېروتنه وکړه.

Aug 05 06:25:31.889 DEBUG transform{name=nginx_parse_rename_fields type=rename_fields}: vector::transforms::rename_fields: Field did not exist field=«geoip.country_name» rate_limit_secs=30که څوک د جیوپ پروسس کولو ته اړتیا ولري، نو بیا اصلي لارښوونو ته مراجعه وکړئ .

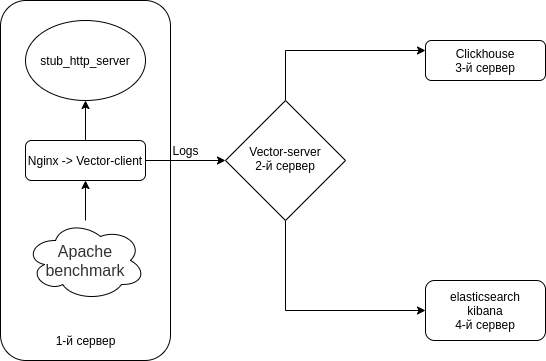

موږ به د نګینکس ترکیب ترتیب کړو (د لاسرسي لاګ) → ویکتور (پیرودونکي | فایل بیټ) → ویکتور (سرور | لوګسټاش) → په جلا توګه په کلیک هاؤس کې او په جلا توګه په ایلیسټیک لټون کې. موږ به 4 سرورونه نصب کړو. که څه هم تاسو کولی شئ دا د 3 سرورونو سره بای پاس کړئ.

سکیم یو څه داسې دی.

په خپلو ټولو سرورونو کې Selinux غیر فعال کړئ

sed -i 's/^SELINUX=.*/SELINUX=disabled/g' /etc/selinux/config

rebootموږ په ټولو سرورونو کې د HTTP سرور ایمولیټر + اسانتیاوې نصب کوو

د HTTP سرور ایمولیټر په توګه موږ به وکاروو от

Nodejs-stub-server rpm نلري. د دې لپاره rpm جوړ کړئ. rpm به په کارولو سره تالیف شي

د انتونپاتسوف / نوډز-سټب-سرور ذخیره اضافه کړئ

yum -y install yum-plugin-copr epel-release

yes | yum copr enable antonpatsev/nodejs-stub-serverپه ټولو سرورونو کې nodejs-stub-server، Apache بنچمارک او د سکرین ټرمینل ملټي پلیکسر نصب کړئ

yum -y install stub_http_server screen mc httpd-tools screenما په /var/lib/stub_http_server/stub_http_server.js فایل کې د stub_http_server غبرګون وخت سم کړ ترڅو نور لاګونه شتون ولري.

var max_sleep = 10;راځئ چې stub_http_server پیل کړو.

systemctl start stub_http_server

systemctl enable stub_http_serverپه سرور 3 کې

ClickHouse د SSE 4.2 لارښوونې سیټ کاروي، نو پرته لدې چې بل ډول مشخص شي، په کارول شوي پروسیسر کې د دې لپاره ملاتړ د اضافي سیسټم اړتیا کیږي. دلته د چیک کولو قومانده ده چې ایا اوسنی پروسیسر د SSE 4.2 ملاتړ کوي:

grep -q sse4_2 /proc/cpuinfo && echo "SSE 4.2 supported" || echo "SSE 4.2 not supported"لومړی تاسو اړتیا لرئ رسمي ذخیره وصل کړئ:

sudo yum install -y yum-utils

sudo rpm --import https://repo.clickhouse.tech/CLICKHOUSE-KEY.GPG

sudo yum-config-manager --add-repo https://repo.clickhouse.tech/rpm/stable/x86_64د کڅوړو نصبولو لپاره تاسو اړتیا لرئ لاندې کمانډونه پرمخ بوځي:

sudo yum install -y clickhouse-server clickhouse-clientClickhouse-server ته اجازه ورکړئ چې په فایل کې د شبکې کارت ته غوږ ونیسي /etc/clickhouse-server/config.xml

<listen_host>0.0.0.0</listen_host>د ټریس څخه ډیبګ ته د ننوتلو کچه بدلول

ډوب

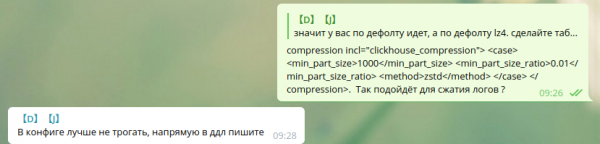

د معیاري کمپریشن ترتیبات:

min_compress_block_size 65536

max_compress_block_size 1048576د Zstd کمپریشن فعالولو لپاره، دا مشوره ورکړل شوې وه چې ترتیب ته لاس ورنکړي، بلکه د DDL کارولو لپاره.

زه نشم موندلی چې څنګه په ګوګل کې د DDL له لارې zstd کمپریشن وکاروم. نو ما دا پریښوده لکه څنګه چې ده.

همکاران چې په Clickhouse کې د zstd کمپریشن کاروي، مهرباني وکړئ لارښوونې شریک کړئ.

د ډیمون په توګه د سرور پیل کولو لپاره، چلول:

service clickhouse-server startاوس راځئ چې د کلک هاؤس تنظیم کولو ته لاړ شو

کلیک هاوس ته لاړ شئ

clickhouse-client -h 172.26.10.109 -m172.26.10.109 - د سرور IP چیرته چې کلیک هاوس نصب شوی.

راځئ چې د ویکتور ډیټابیس جوړ کړو

CREATE DATABASE vector;راځئ وګورو چې ډیټابیس شتون لري.

show databases;د vector.logs جدول جوړ کړئ.

/* Это таблица где хранятся логи как есть */

CREATE TABLE vector.logs

(

`node_name` String,

`timestamp` DateTime,

`server_name` String,

`user_id` String,

`request_full` String,

`request_user_agent` String,

`request_http_host` String,

`request_uri` String,

`request_scheme` String,

`request_method` String,

`request_length` UInt64,

`request_time` Float32,

`request_referrer` String,

`response_status` UInt16,

`response_body_bytes_sent` UInt64,

`response_content_type` String,

`remote_addr` IPv4,

`remote_port` UInt32,

`remote_user` String,

`upstream_addr` IPv4,

`upstream_port` UInt32,

`upstream_bytes_received` UInt64,

`upstream_bytes_sent` UInt64,

`upstream_cache_status` String,

`upstream_connect_time` Float32,

`upstream_header_time` Float32,

`upstream_response_length` UInt64,

`upstream_response_time` Float32,

`upstream_status` UInt16,

`upstream_content_type` String,

INDEX idx_http_host request_http_host TYPE set(0) GRANULARITY 1

)

ENGINE = MergeTree()

PARTITION BY toYYYYMMDD(timestamp)

ORDER BY timestamp

TTL timestamp + toIntervalMonth(1)

SETTINGS index_granularity = 8192;موږ ګورو چې میزونه جوړ شوي دي. راځئ چې پیل کړو clickhouse-client او غوښتنه وکړئ.

راځئ چې د ویکتور ډیټابیس ته لاړ شو.

use vector;

Ok.

0 rows in set. Elapsed: 0.001 sec.راځئ چې میزونه وګورو.

show tables;

┌─name────────────────┐

│ logs │

└─────────────────────┘په څلورم سرور کې د elasticsearch نصب کول د Clickhouse سره پرتله کولو لپاره Elasticsearch ته ورته ډاټا لیږلو لپاره

د عامه rpm کیلي اضافه کړئ

rpm --import https://artifacts.elastic.co/GPG-KEY-elasticsearchراځئ چې 2 ریپو جوړ کړو:

/etc/yum.repos.d/elasticsearch.repo

[elasticsearch]

name=Elasticsearch repository for 7.x packages

baseurl=https://artifacts.elastic.co/packages/7.x/yum

gpgcheck=1

gpgkey=https://artifacts.elastic.co/GPG-KEY-elasticsearch

enabled=0

autorefresh=1

type=rpm-md/etc/yum.repos.d/kibana.repo

[kibana-7.x]

name=Kibana repository for 7.x packages

baseurl=https://artifacts.elastic.co/packages/7.x/yum

gpgcheck=1

gpgkey=https://artifacts.elastic.co/GPG-KEY-elasticsearch

enabled=1

autorefresh=1

type=rpm-mdelasticsearch او kibana نصب کړئ

yum install -y kibana elasticsearchڅرنګه چې دا به په 1 کاپي کې وي، تاسو اړتیا لرئ چې لاندې /etc/elasticsearch/elasticsearch.yml فایل کې اضافه کړئ:

discovery.type: single-nodeنو دا ویکتور کولی شي ډیټا له بل سرور څخه elasticsearch ته واستوي ، راځئ چې network.host بدل کړو.

network.host: 0.0.0.0د کیبانا سره د نښلولو لپاره، په فایل کې د سرور.host پیرامیټر بدل کړئ /etc/kibana/kibana.yml

server.host: "0.0.0.0"زوړ او په اتوماتیک پیل کې elasticsearch شامل کړئ

systemctl enable elasticsearch

systemctl start elasticsearchاو کبانا

systemctl enable kibana

systemctl start kibanaد واحد نوډ حالت 1 شارډ، 0 نقل لپاره د ایلیسټیک لټون ترتیب کول. ډیری احتمال تاسو به د ډیری سرورونو کلستر ولرئ او تاسو دې ته اړتیا نلرئ.

د راتلونکو شاخصونو لپاره، ډیفالټ ټیمپلیټ تازه کړئ:

curl -X PUT http://localhost:9200/_template/default -H 'Content-Type: application/json' -d '{"index_patterns": ["*"],"order": -1,"settings": {"number_of_shards": "1","number_of_replicas": "0"}}' د جوړولو په سرور 2 کې د Logstash لپاره د بدیل په توګه

yum install -y https://packages.timber.io/vector/0.9.X/vector-x86_64.rpm mc httpd-tools screenراځئ چې ویکتور د Logstash لپاره د بدیل په توګه تنظیم کړو. د فایل ترمیم کول /etc/vector/vector.toml

# /etc/vector/vector.toml

data_dir = "/var/lib/vector"

[sources.nginx_input_vector]

# General

type = "vector"

address = "0.0.0.0:9876"

shutdown_timeout_secs = 30

[transforms.nginx_parse_json]

inputs = [ "nginx_input_vector" ]

type = "json_parser"

[transforms.nginx_parse_add_defaults]

inputs = [ "nginx_parse_json" ]

type = "lua"

version = "2"

hooks.process = """

function (event, emit)

function split_first(s, delimiter)

result = {};

for match in (s..delimiter):gmatch("(.-)"..delimiter) do

table.insert(result, match);

end

return result[1];

end

function split_last(s, delimiter)

result = {};

for match in (s..delimiter):gmatch("(.-)"..delimiter) do

table.insert(result, match);

end

return result[#result];

end

event.log.upstream_addr = split_first(split_last(event.log.upstream_addr, ', '), ':')

event.log.upstream_bytes_received = split_last(event.log.upstream_bytes_received, ', ')

event.log.upstream_bytes_sent = split_last(event.log.upstream_bytes_sent, ', ')

event.log.upstream_connect_time = split_last(event.log.upstream_connect_time, ', ')

event.log.upstream_header_time = split_last(event.log.upstream_header_time, ', ')

event.log.upstream_response_length = split_last(event.log.upstream_response_length, ', ')

event.log.upstream_response_time = split_last(event.log.upstream_response_time, ', ')

event.log.upstream_status = split_last(event.log.upstream_status, ', ')

if event.log.upstream_addr == "" then

event.log.upstream_addr = "127.0.0.1"

end

if (event.log.upstream_bytes_received == "-" or event.log.upstream_bytes_received == "") then

event.log.upstream_bytes_received = "0"

end

if (event.log.upstream_bytes_sent == "-" or event.log.upstream_bytes_sent == "") then

event.log.upstream_bytes_sent = "0"

end

if event.log.upstream_cache_status == "" then

event.log.upstream_cache_status = "DISABLED"

end

if (event.log.upstream_connect_time == "-" or event.log.upstream_connect_time == "") then

event.log.upstream_connect_time = "0"

end

if (event.log.upstream_header_time == "-" or event.log.upstream_header_time == "") then

event.log.upstream_header_time = "0"

end

if (event.log.upstream_response_length == "-" or event.log.upstream_response_length == "") then

event.log.upstream_response_length = "0"

end

if (event.log.upstream_response_time == "-" or event.log.upstream_response_time == "") then

event.log.upstream_response_time = "0"

end

if (event.log.upstream_status == "-" or event.log.upstream_status == "") then

event.log.upstream_status = "0"

end

emit(event)

end

"""

[transforms.nginx_parse_remove_fields]

inputs = [ "nginx_parse_add_defaults" ]

type = "remove_fields"

fields = ["data", "file", "host", "source_type"]

[transforms.nginx_parse_coercer]

type = "coercer"

inputs = ["nginx_parse_remove_fields"]

types.request_length = "int"

types.request_time = "float"

types.response_status = "int"

types.response_body_bytes_sent = "int"

types.remote_port = "int"

types.upstream_bytes_received = "int"

types.upstream_bytes_send = "int"

types.upstream_connect_time = "float"

types.upstream_header_time = "float"

types.upstream_response_length = "int"

types.upstream_response_time = "float"

types.upstream_status = "int"

types.timestamp = "timestamp"

[sinks.nginx_output_clickhouse]

inputs = ["nginx_parse_coercer"]

type = "clickhouse"

database = "vector"

healthcheck = true

host = "http://172.26.10.109:8123" # Адрес Clickhouse

table = "logs"

encoding.timestamp_format = "unix"

buffer.type = "disk"

buffer.max_size = 104900000

buffer.when_full = "block"

request.in_flight_limit = 20

[sinks.elasticsearch]

type = "elasticsearch"

inputs = ["nginx_parse_coercer"]

compression = "none"

healthcheck = true

# 172.26.10.116 - сервер где установен elasticsearch

host = "http://172.26.10.116:9200"

index = "vector-%Y-%m-%d"تاسو کولی شئ د transforms.nginx_parse_add_defaults برخه تنظیم کړئ.

راهیسې دا تشکیلات د کوچني CDN لپاره کاروي او په اپسټریم_* کې ډیری ارزښتونه شتون لري

د مثال په توګه:

"upstream_addr": "128.66.0.10:443, 128.66.0.11:443, 128.66.0.12:443"

"upstream_bytes_received": "-, -, 123"

"upstream_status": "502, 502, 200"که دا ستاسو وضعیت نه وي، نو دا برخه ساده کیدی شي

راځئ چې د systemd /etc/systemd/system/vector.service لپاره د خدماتو ترتیبات جوړ کړو

# /etc/systemd/system/vector.service

[Unit]

Description=Vector

After=network-online.target

Requires=network-online.target

[Service]

User=vector

Group=vector

ExecStart=/usr/bin/vector

ExecReload=/bin/kill -HUP $MAINPID

Restart=no

StandardOutput=syslog

StandardError=syslog

SyslogIdentifier=vector

[Install]

WantedBy=multi-user.targetد جدولونو د جوړولو وروسته، تاسو کولی شئ ویکتور چل کړئ

systemctl enable vector

systemctl start vectorد ویکتور لاګونه په دې ډول لیدل کیدی شي:

journalctl -f -u vectorپه لاګونو کې باید دا ډول ننوتل شتون ولري

INFO vector::topology::builder: Healthcheck: Passed.

INFO vector::topology::builder: Healthcheck: Passed.په پیرودونکي کې (ویب سرور) - لومړی سرور

د نګینکس سره په سرور کې ، تاسو اړتیا لرئ ipv6 غیر فعال کړئ ، ځکه چې په کلیک هاوس کې د لاګ جدول ساحه کاروي upstream_addr IPv4، ځکه چې زه په شبکه کې ipv6 نه کاروم. که چیرې ipv6 بند نه وي، نو غلطۍ به وي:

DB::Exception: Invalid IPv4 value.: (while read the value of key upstream_addr)شاید لوستونکي، د ipv6 ملاتړ اضافه کړئ.

فایل جوړ کړئ /etc/sysctl.d/98-disable-ipv6.conf

net.ipv6.conf.all.disable_ipv6 = 1

net.ipv6.conf.default.disable_ipv6 = 1

net.ipv6.conf.lo.disable_ipv6 = 1د ترتیباتو پلي کول

sysctl --systemراځئ چې nginx نصب کړو.

د nginx ذخیره فایل اضافه شوی /etc/yum.repos.d/nginx.repo

[nginx-stable]

name=nginx stable repo

baseurl=http://nginx.org/packages/centos/$releasever/$basearch/

gpgcheck=1

enabled=1

gpgkey=https://nginx.org/keys/nginx_signing.key

module_hotfixes=trueد نګینکس کڅوړه نصب کړئ

yum install -y nginxلومړی، موږ اړتیا لرو چې په نګینکس کې د لاګ بڼه په فایل کې تنظیم کړو /etc/nginx/nginx.conf

user nginx;

# you must set worker processes based on your CPU cores, nginx does not benefit from setting more than that

worker_processes auto; #some last versions calculate it automatically

# number of file descriptors used for nginx

# the limit for the maximum FDs on the server is usually set by the OS.

# if you don't set FD's then OS settings will be used which is by default 2000

worker_rlimit_nofile 100000;

error_log /var/log/nginx/error.log warn;

pid /var/run/nginx.pid;

# provides the configuration file context in which the directives that affect connection processing are specified.

events {

# determines how much clients will be served per worker

# max clients = worker_connections * worker_processes

# max clients is also limited by the number of socket connections available on the system (~64k)

worker_connections 4000;

# optimized to serve many clients with each thread, essential for linux -- for testing environment

use epoll;

# accept as many connections as possible, may flood worker connections if set too low -- for testing environment

multi_accept on;

}

http {

include /etc/nginx/mime.types;

default_type application/octet-stream;

log_format main '$remote_addr - $remote_user [$time_local] "$request" '

'$status $body_bytes_sent "$http_referer" '

'"$http_user_agent" "$http_x_forwarded_for"';

log_format vector escape=json

'{'

'"node_name":"nginx-vector",'

'"timestamp":"$time_iso8601",'

'"server_name":"$server_name",'

'"request_full": "$request",'

'"request_user_agent":"$http_user_agent",'

'"request_http_host":"$http_host",'

'"request_uri":"$request_uri",'

'"request_scheme": "$scheme",'

'"request_method":"$request_method",'

'"request_length":"$request_length",'

'"request_time": "$request_time",'

'"request_referrer":"$http_referer",'

'"response_status": "$status",'

'"response_body_bytes_sent":"$body_bytes_sent",'

'"response_content_type":"$sent_http_content_type",'

'"remote_addr": "$remote_addr",'

'"remote_port": "$remote_port",'

'"remote_user": "$remote_user",'

'"upstream_addr": "$upstream_addr",'

'"upstream_bytes_received": "$upstream_bytes_received",'

'"upstream_bytes_sent": "$upstream_bytes_sent",'

'"upstream_cache_status":"$upstream_cache_status",'

'"upstream_connect_time":"$upstream_connect_time",'

'"upstream_header_time":"$upstream_header_time",'

'"upstream_response_length":"$upstream_response_length",'

'"upstream_response_time":"$upstream_response_time",'

'"upstream_status": "$upstream_status",'

'"upstream_content_type":"$upstream_http_content_type"'

'}';

access_log /var/log/nginx/access.log main;

access_log /var/log/nginx/access.json.log vector; # Новый лог в формате json

sendfile on;

#tcp_nopush on;

keepalive_timeout 65;

#gzip on;

include /etc/nginx/conf.d/*.conf;

}د دې لپاره چې ستاسو اوسنی ترتیب مات نه کړئ، نګینکس تاسو ته اجازه درکوي څو د لاسرسي_لاګ لارښوونې ولرئ

access_log /var/log/nginx/access.log main; # Стандартный лог

access_log /var/log/nginx/access.json.log vector; # Новый лог в формате jsonد نوي لاګونو لپاره د logrotate لپاره د قاعدې اضافه کول مه هیروئ (که د لاګ فایل په .log سره پای ته ونه رسیږي)

default.conf له /etc/nginx/conf.d/ څخه لرې کړئ

rm -f /etc/nginx/conf.d/default.confمجازی کوربه اضافه کړئ /etc/nginx/conf.d/vhost1.conf

server {

listen 80;

server_name vhost1;

location / {

proxy_pass http://172.26.10.106:8080;

}

}مجازی کوربه اضافه کړئ /etc/nginx/conf.d/vhost2.conf

server {

listen 80;

server_name vhost2;

location / {

proxy_pass http://172.26.10.108:8080;

}

}مجازی کوربه اضافه کړئ /etc/nginx/conf.d/vhost3.conf

server {

listen 80;

server_name vhost3;

location / {

proxy_pass http://172.26.10.109:8080;

}

}مجازی کوربه اضافه کړئ /etc/nginx/conf.d/vhost4.conf

server {

listen 80;

server_name vhost4;

location / {

proxy_pass http://172.26.10.116:8080;

}

}مجازی کوربه اضافه کړئ (د سرور 172.26.10.106 ip چیرې چې نګینکس نصب شوی وي) ټولو سرورونو ته /etc/hosts فایل ته:

172.26.10.106 vhost1

172.26.10.106 vhost2

172.26.10.106 vhost3

172.26.10.106 vhost4او که هر څه چمتو وي نو

nginx -t

systemctl restart nginxاوس راځئ چې دا پخپله نصب کړو

yum install -y https://packages.timber.io/vector/0.9.X/vector-x86_64.rpmراځئ چې د systemd /etc/systemd/system/vector.service لپاره د ترتیباتو فایل جوړ کړو

[Unit]

Description=Vector

After=network-online.target

Requires=network-online.target

[Service]

User=vector

Group=vector

ExecStart=/usr/bin/vector

ExecReload=/bin/kill -HUP $MAINPID

Restart=no

StandardOutput=syslog

StandardError=syslog

SyslogIdentifier=vector

[Install]

WantedBy=multi-user.targetاو د فایل بیټ ځای په ځای کول په /etc/vector/vector.toml ترتیب کې تنظیم کړئ. IP پته 172.26.10.108 د لاګ سرور IP پته ده (ویکٹر-سرور)

data_dir = "/var/lib/vector"

[sources.nginx_file]

type = "file"

include = [ "/var/log/nginx/access.json.log" ]

start_at_beginning = false

fingerprinting.strategy = "device_and_inode"

[sinks.nginx_output_vector]

type = "vector"

inputs = [ "nginx_file" ]

address = "172.26.10.108:9876"مه هېروئ چې د کارونکي ویکتور مناسب ګروپ ته اضافه کړئ ترڅو دا د لاګ فایلونه ولولي. د مثال په توګه، nginx in centos د adm ګروپ حقونو سره لاګونه جوړوي.

usermod -a -G adm vectorراځئ چې د ویکتور خدمت پیل کړو

systemctl enable vector

systemctl start vectorد ویکتور لاګونه په دې ډول لیدل کیدی شي:

journalctl -f -u vectorپه لاګونو کې باید د دې په څیر ننوتل وي

INFO vector::topology::builder: Healthcheck: Passed.د فشار ازموینه

موږ د اپاچي بنچمارک په کارولو سره ازموینه ترسره کوو.

د httpd-tools کڅوړه په ټولو سرورونو کې نصب شوې

موږ په سکرین کې د 4 مختلف سرورونو څخه د اپاچي بنچمارک کارولو ازموینه پیل کوو. لومړی ، موږ د سکرین ټرمینل ملټي پلیکسر لانچ کوو ، او بیا موږ د اپاچي بنچمارک په کارولو ازموینه پیل کوو. د سکرین سره څنګه کار کول چې تاسو یې موندلی شئ .

د 1st سرور څخه

while true; do ab -H "User-Agent: 1server" -c 100 -n 10 -t 10 http://vhost1/; sleep 1; doneد 2st سرور څخه

while true; do ab -H "User-Agent: 2server" -c 100 -n 10 -t 10 http://vhost2/; sleep 1; doneد 3st سرور څخه

while true; do ab -H "User-Agent: 3server" -c 100 -n 10 -t 10 http://vhost3/; sleep 1; doneد 4st سرور څخه

while true; do ab -H "User-Agent: 4server" -c 100 -n 10 -t 10 http://vhost4/; sleep 1; doneراځئ چې په Clickhouse کې ډاټا وګورو

کلیک هاوس ته لاړ شئ

clickhouse-client -h 172.26.10.109 -mد SQL پوښتنې جوړول

SELECT * FROM vector.logs;

┌─node_name────┬───────────timestamp─┬─server_name─┬─user_id─┬─request_full───┬─request_user_agent─┬─request_http_host─┬─request_uri─┬─request_scheme─┬─request_method─┬─request_length─┬─request_time─┬─request_referrer─┬─response_status─┬─response_body_bytes_sent─┬─response_content_type─┬───remote_addr─┬─remote_port─┬─remote_user─┬─upstream_addr─┬─upstream_port─┬─upstream_bytes_received─┬─upstream_bytes_sent─┬─upstream_cache_status─┬─upstream_connect_time─┬─upstream_header_time─┬─upstream_response_length─┬─upstream_response_time─┬─upstream_status─┬─upstream_content_type─┐

│ nginx-vector │ 2020-08-07 04:32:42 │ vhost1 │ │ GET / HTTP/1.0 │ 1server │ vhost1 │ / │ http │ GET │ 66 │ 0.028 │ │ 404 │ 27 │ │ 172.26.10.106 │ 45886 │ │ 172.26.10.106 │ 0 │ 109 │ 97 │ DISABLED │ 0 │ 0.025 │ 27 │ 0.029 │ 404 │ │

└──────────────┴─────────────────────┴─────────────┴─────────┴────────────────┴────────────────────┴───────────────────┴─────────────┴────────────────┴────────────────┴────────────────┴──────────────┴──────────────────┴─────────────────┴──────────────────────────┴───────────────────────┴───────────────┴─────────────┴─────────────┴───────────────┴───────────────┴─────────────────────────┴─────────────────────┴───────────────────────┴───────────────────────┴──────────────────────┴──────────────────────────┴────────────────────────┴─────────────────┴───────────────────────په کلک هاؤس کې د میزونو اندازه ومومئ

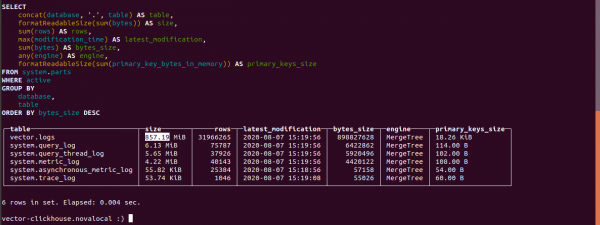

select concat(database, '.', table) as table,

formatReadableSize(sum(bytes)) as size,

sum(rows) as rows,

max(modification_time) as latest_modification,

sum(bytes) as bytes_size,

any(engine) as engine,

formatReadableSize(sum(primary_key_bytes_in_memory)) as primary_keys_size

from system.parts

where active

group by database, table

order by bytes_size desc;راځئ چې معلومه کړو چې په کلک هاؤس کې څومره لاګونه پورته شوي.

د لاګ جدول اندازه 857.19 MB ده.

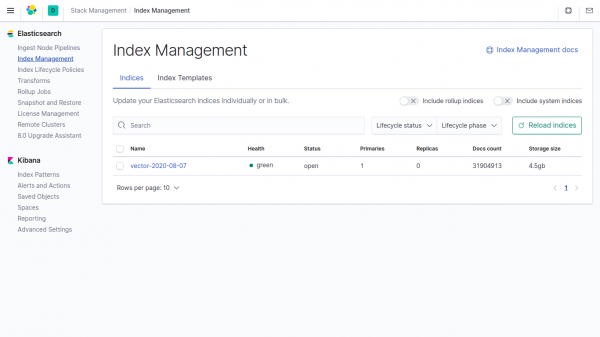

په Elasticsearch کې په شاخص کې د ورته ډیټا اندازه 4,5GB ده.

که تاسو په ویکٹر کې په پیرامیټونو کې ډاټا مشخص نه کړئ، کلیک هاوس د Elasticsearch په پرتله 4500/857.19 = 5.24 ځله کم اخلي.

په ویکتور کې، د کمپریشن ساحه د ډیفالټ لخوا کارول کیږي.

د ټیلیګرام چیٹ لخوا

د ټیلیګرام چیٹ لخوا

د ټیلیګرام چیټ لخوا ""

سرچینه: www.habr.com