د سټینفورډ پوهنتون د څیړونکو یوې ډلې د هوښیار کوډ کولو معاونینو کارولو اغیزې د زیان منونکو په معرفي کولو کې مطالعه کړې. دوی د OpenAI کوډیکس ماشین زده کړې پلیټ فارم پراساس حلونه په پام کې ونیول، لکه GitHub Copilot، کوم چې کولی شي د بشپړ دندو په ګډون خورا پیچلي کوډ بلاکونه تولید کړي. اندیښنې د دې حقیقت څخه راپورته کیږي چې، څرنګه چې د عامه GitHub زیرمو څخه اصلي کوډ، په شمول د هغو چې زیان منونکي لري، د ماشین زده کړې ماډل روزلو لپاره کارول شوی و، ترکیب شوی کوډ ممکن غلطۍ بیا تولید کړي او زیان منونکي کوډ وړاندیز کړي، او همدارنګه د بهرني معلوماتو پروسس کولو پرمهال د اضافي چکونو اړتیا په پام کې ونه نیسي.

په دې څیړنه کې ۴۷ رضاکاران شامل وو چې د پروګرام کولو مختلفې کچې تجربه یې درلوده، له زده کونکو څخه تر مسلکي کسانو پورې چې لس کاله تجربه لري. ګډونوال په دوو ډلو ویشل شوي وو: یوه تجربوي ډله (۳۳) او یوه کنټرول ډله (۱۴). دواړو ډلو ټولو کتابتونونو او آنلاین سرچینو ته لاسرسی درلود، په شمول د سټیک اوور فلو څخه چمتو شوي مثالونه. تجربوي ډلې ته د AI مرستیال کارولو اختیار ورکړل شو.

هر ګډونوال ته پنځه دندې ورکړل شوې وې چې پکې د کوډ لیکل شامل وو چې کولی شي په اسانۍ سره د زیان منونکو غلطیو لامل شي. پدې کې د لیکلو کوډ کولو او ډیکریپشن دندې، د ډیجیټل لاسلیکونو کارول، د فایل لارې یا SQL پوښتنو جوړولو کې دخیل ډیټا پروسس کول، په C کوډ کې د لویو شمیرو اداره کول، او په ویب پاڼو کې ښودل شوي ان پټ پروسس کول شامل وو. د AI معاونینو لخوا رامینځته شوي کوډ امنیت باندې د پروګرامینګ ژبو اغیزې معاینه کولو لپاره، دندې پایتون، C، او جاواسکریپټ پوښلي.

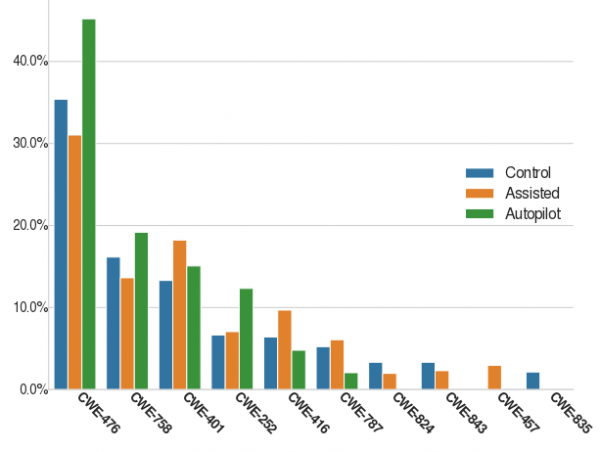

په پای کې، دا وموندل شوه چې هغه ګډونوالو چې د کوډیکس-ډاوینسي-002 ماډل پر بنسټ د هوښیار مصنوعي ذهانت معاون یې کارولی و، د هغو کسانو په پرتله چې د مصنوعي ذهانت معاون یې نه کارولی و، د پام وړ کم خوندي کوډ تولید کړ. په ټولیز ډول، د مصنوعي ذهانت معاون ګروپ کې یوازې 67٪ برخه اخیستونکي وکولی شول سم او خوندي کوډ تولید کړي، د بلې ډلې د 79٪ په پرتله.

سربېره پردې، د ځان ارزونې شاخصونه برعکس شول: هغه ګډونوالو چې د AI مرستیال یې کارولی و باور درلود چې د دوی کوډ به د بلې ډلې په پرتله ډیر خوندي وي. سربیره پردې، دا یادونه وشوه چې هغه ګډونوالو چې د AI مرستیال باندې لږ باور درلود او ډیر وخت یې د چمتو شوي اشارو تحلیل او تعدیل کولو کې تیر کړ، د دوی په کوډ کې لږ زیانونه رامینځته کړل.

د مثال په توګه، د کریپټوګرافیک کتابتونونو څخه کاپي شوي کوډ د AI مرستیال لخوا وړاندیز شوي کوډ په پرتله ډیر خوندي ډیفالټ پیرامیټر ارزښتونه درلودل. د AI مرستیال کارولو پرمهال لږ خوندي کوډ کولو الګوریتمونه هم غوره شوي وو، لکه څنګه چې د بیرته راستنیدو ارزښتونو کې د اعتبار چیکونو نشتوالی و. په یوه دنده کې چې د C شمیرې لاسوهنه پکې شامله وه، د AI مرستیال په کارولو سره لیکل شوي کوډ کې د انټیجر اوور فلو غلطۍ ډیرې وې.

برسېره پردې، د نیویارک پوهنتون د یوې ډلې لخوا په ورته څیړنه کې، چې په نومبر کې ترسره شوه، ۵۸ زده کونکي شامل وو چې غوښتل شوي وو چې په C کې د پیرود لیست پروسس کولو لپاره یو جوړښت پلي کړي. پایلو وښودله چې د AI مرستیال د کوډ امنیت باندې د پام وړ اغیزه درلوده: هغه کاروونکي چې د AI مرستیال یې کارولی، په اوسط ډول، نږدې ۱۰٪ ډیرې امنیتي اړوند غلطۍ کړې.

سرچینه: opennet.ru