, дизајниран за прикупљање, трансформацију и слање података евиденције, метрике и догађаја.

→

Будући да је написан на Руст језику, одликује се високим перформансама и малом потрошњом РАМ-а у поређењу са својим аналогама. Поред тога, велика пажња се поклања функцијама које се односе на исправност, посебно могућности чувања непослатих догађаја у бафер на диску и ротирања датотека.

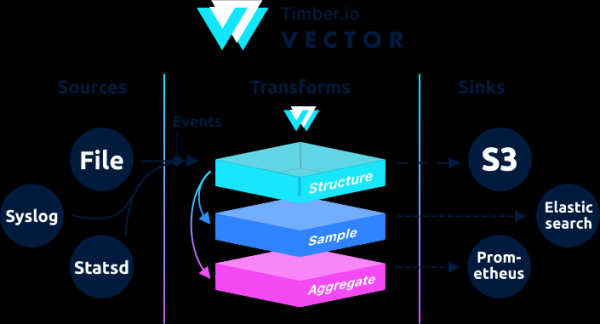

Архитектонски, Вецтор је рутер догађаја који прима поруке од једног или више извори, опционо се примењује на ове поруке трансформације, и послати их једном или више њих одводи.

Вецтор је замена за филебеат и логстасх, може да делује у обе улоге (примање и слање логова), више детаља о њима .

Ако је у Логстасх-у ланац изграђен као улаз → филтер → излаз онда је у Вецтор-у → →

Примери се могу наћи у документацији.

Ово упутство је ревидирано упутство од . Оригинална упутства садрже геоип обраду. Приликом тестирања геоип-а из интерне мреже, вектор је дао грешку.

Aug 05 06:25:31.889 DEBUG transform{name=nginx_parse_rename_fields type=rename_fields}: vector::transforms::rename_fields: Field did not exist field=«geoip.country_name» rate_limit_secs=30Ако неко треба да обради геоип, онда погледајте оригинална упутства из .

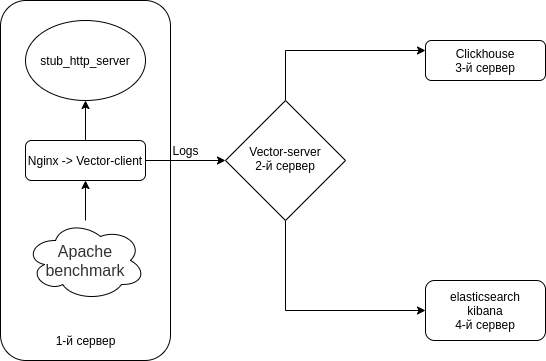

Конфигурисаћемо комбинацију Нгинк-а (Евиденције приступа) → Вектор (Клијент | Филебеат) → Вектор (Сервер | Логстасх) → одвојено у Цлицкхоусе-у и посебно у Еластицсеарцх-у. Инсталираћемо 4 сервера. Иако га можете заобићи са 3 сервера.

Шема је отприлике оваква.

Онемогућите Селинук на свим вашим серверима

sed -i 's/^SELINUX=.*/SELINUX=disabled/g' /etc/selinux/config

rebootИнсталирамо емулатор ХТТП сервера + услужне програме на свим серверима

Као емулатор ХТТП сервера користићемо из

Нодејс-стуб-сервер нема рпм. креирајте рпм за то. рпм ће бити изграђен помоћу

Додајте спремиште антонпатсев/нодејс-стуб-сервер

yum -y install yum-plugin-copr epel-release

yes | yum copr enable antonpatsev/nodejs-stub-serverИнсталирајте нодејс-стуб-сервер, Апацхе бенцхмарк и сцреен терминал мултиплексер на свим серверима

yum -y install stub_http_server screen mc httpd-tools screenИсправио сам време одговора стуб_хттп_сервер у /вар/либ/стуб_хттп_сервер/стуб_хттп_сервер.јс датотеци тако да је било више евиденција.

var max_sleep = 10;Хајде да покренемо стуб_хттп_сервер.

systemctl start stub_http_server

systemctl enable stub_http_serverна серверу 3

ЦлицкХоусе користи скуп инструкција ССЕ 4.2, тако да осим ако није другачије назначено, подршка за њега у процесору који се користи постаје додатни системски захтев. Ево наредбе за проверу да ли тренутни процесор подржава ССЕ 4.2:

grep -q sse4_2 /proc/cpuinfo && echo "SSE 4.2 supported" || echo "SSE 4.2 not supported"Прво морате да повежете званично складиште:

sudo yum install -y yum-utils

sudo rpm --import https://repo.clickhouse.tech/CLICKHOUSE-KEY.GPG

sudo yum-config-manager --add-repo https://repo.clickhouse.tech/rpm/stable/x86_64Да бисте инсталирали пакете, потребно је да покренете следеће команде:

sudo yum install -y clickhouse-server clickhouse-clientДозволите цлицкхоусе-серверу да слуша мрежну картицу у датотеци /етц/цлицкхоусе-сервер/цонфиг.кмл

<listen_host>0.0.0.0</listen_host>Промена нивоа евидентирања са праћења на отклањање грешака

отклонити неисправност

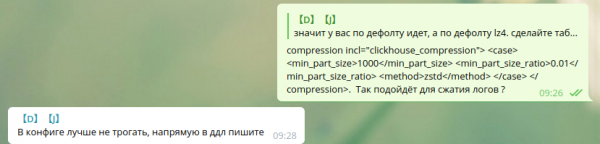

Стандардна подешавања компресије:

min_compress_block_size 65536

max_compress_block_size 1048576Да бисте активирали Зстд компресију, саветовано је да се не додирује конфигурација, већ да се користи ДДЛ.

Нисам могао да пронађем како да користим зстд компресију преко ДДЛ-а у Гоогле-у. Па сам оставио како јесте.

Колеге које користе зстд компресију у Цлицкхоусе-у, поделите упутства.

Да бисте покренули сервер као демон, покрените:

service clickhouse-server startСада пређимо на подешавање Цлицкхоусе-а

Идите на Цлицкхоусе

clickhouse-client -h 172.26.10.109 -m172.26.10.109 — ИП сервера на коме је инсталиран Цлицкхоусе.

Хајде да направимо векторску базу података

CREATE DATABASE vector;Хајде да проверимо да ли база података постоји.

show databases;Направите векторску табелу.логс.

/* Это таблица где хранятся логи как есть */

CREATE TABLE vector.logs

(

`node_name` String,

`timestamp` DateTime,

`server_name` String,

`user_id` String,

`request_full` String,

`request_user_agent` String,

`request_http_host` String,

`request_uri` String,

`request_scheme` String,

`request_method` String,

`request_length` UInt64,

`request_time` Float32,

`request_referrer` String,

`response_status` UInt16,

`response_body_bytes_sent` UInt64,

`response_content_type` String,

`remote_addr` IPv4,

`remote_port` UInt32,

`remote_user` String,

`upstream_addr` IPv4,

`upstream_port` UInt32,

`upstream_bytes_received` UInt64,

`upstream_bytes_sent` UInt64,

`upstream_cache_status` String,

`upstream_connect_time` Float32,

`upstream_header_time` Float32,

`upstream_response_length` UInt64,

`upstream_response_time` Float32,

`upstream_status` UInt16,

`upstream_content_type` String,

INDEX idx_http_host request_http_host TYPE set(0) GRANULARITY 1

)

ENGINE = MergeTree()

PARTITION BY toYYYYMMDD(timestamp)

ORDER BY timestamp

TTL timestamp + toIntervalMonth(1)

SETTINGS index_granularity = 8192;Проверавамо да ли су табеле направљене. Хајде да покренемо clickhouse-client и поднети захтев.

Идемо на векторску базу података.

use vector;

Ok.

0 rows in set. Elapsed: 0.001 sec.Погледајмо табеле.

show tables;

┌─name────────────────┐

│ logs │

└─────────────────────┘Инсталирање еластицсеарцх на 4. сервер за слање истих података у Еластицсеарцх ради поређења са Цлицкхоусе

Додајте јавни кључ обртаја у минути

rpm --import https://artifacts.elastic.co/GPG-KEY-elasticsearchХајде да направимо 2 репо:

/етц/иум.репос.д/еластицсеарцх.репо

[elasticsearch]

name=Elasticsearch repository for 7.x packages

baseurl=https://artifacts.elastic.co/packages/7.x/yum

gpgcheck=1

gpgkey=https://artifacts.elastic.co/GPG-KEY-elasticsearch

enabled=0

autorefresh=1

type=rpm-md/етц/иум.репос.д/кибана.репо

[kibana-7.x]

name=Kibana repository for 7.x packages

baseurl=https://artifacts.elastic.co/packages/7.x/yum

gpgcheck=1

gpgkey=https://artifacts.elastic.co/GPG-KEY-elasticsearch

enabled=1

autorefresh=1

type=rpm-mdИнсталирајте еластицсеарцх и кибана

yum install -y kibana elasticsearchПошто ће бити у 1 копији, потребно је да додате следеће у датотеку /етц/еластицсеарцх/еластицсеарцх.имл:

discovery.type: single-nodeДа би тај вектор могао да шаље податке еластицсеарцх са другог сервера, хајде да променимо нетворк.хост.

network.host: 0.0.0.0Да бисте се повезали са кибаном, промените параметар сервер.хост у датотеци /етц/кибана/кибана.имл

server.host: "0.0.0.0"Стари и укључи еластичну претрагу у аутостарт

systemctl enable elasticsearch

systemctl start elasticsearchи кибана

systemctl enable kibana

systemctl start kibanaКонфигурисање Еластицсеарцх-а за режим са једним чвором 1 део, 0 реплика. Највероватније ћете имати кластер великог броја сервера и не морате то да радите.

За будуће индексе, ажурирајте подразумевани шаблон:

curl -X PUT http://localhost:9200/_template/default -H 'Content-Type: application/json' -d '{"index_patterns": ["*"],"order": -1,"settings": {"number_of_shards": "1","number_of_replicas": "0"}}' Инсталација као замена за Логстасх на серверу 2

yum install -y https://packages.timber.io/vector/0.9.X/vector-x86_64.rpm mc httpd-tools screenХајде да поставимо Вецтор као замену за Логстасх. Уређивање датотеке /етц/вецтор/вецтор.томл

# /etc/vector/vector.toml

data_dir = "/var/lib/vector"

[sources.nginx_input_vector]

# General

type = "vector"

address = "0.0.0.0:9876"

shutdown_timeout_secs = 30

[transforms.nginx_parse_json]

inputs = [ "nginx_input_vector" ]

type = "json_parser"

[transforms.nginx_parse_add_defaults]

inputs = [ "nginx_parse_json" ]

type = "lua"

version = "2"

hooks.process = """

function (event, emit)

function split_first(s, delimiter)

result = {};

for match in (s..delimiter):gmatch("(.-)"..delimiter) do

table.insert(result, match);

end

return result[1];

end

function split_last(s, delimiter)

result = {};

for match in (s..delimiter):gmatch("(.-)"..delimiter) do

table.insert(result, match);

end

return result[#result];

end

event.log.upstream_addr = split_first(split_last(event.log.upstream_addr, ', '), ':')

event.log.upstream_bytes_received = split_last(event.log.upstream_bytes_received, ', ')

event.log.upstream_bytes_sent = split_last(event.log.upstream_bytes_sent, ', ')

event.log.upstream_connect_time = split_last(event.log.upstream_connect_time, ', ')

event.log.upstream_header_time = split_last(event.log.upstream_header_time, ', ')

event.log.upstream_response_length = split_last(event.log.upstream_response_length, ', ')

event.log.upstream_response_time = split_last(event.log.upstream_response_time, ', ')

event.log.upstream_status = split_last(event.log.upstream_status, ', ')

if event.log.upstream_addr == "" then

event.log.upstream_addr = "127.0.0.1"

end

if (event.log.upstream_bytes_received == "-" or event.log.upstream_bytes_received == "") then

event.log.upstream_bytes_received = "0"

end

if (event.log.upstream_bytes_sent == "-" or event.log.upstream_bytes_sent == "") then

event.log.upstream_bytes_sent = "0"

end

if event.log.upstream_cache_status == "" then

event.log.upstream_cache_status = "DISABLED"

end

if (event.log.upstream_connect_time == "-" or event.log.upstream_connect_time == "") then

event.log.upstream_connect_time = "0"

end

if (event.log.upstream_header_time == "-" or event.log.upstream_header_time == "") then

event.log.upstream_header_time = "0"

end

if (event.log.upstream_response_length == "-" or event.log.upstream_response_length == "") then

event.log.upstream_response_length = "0"

end

if (event.log.upstream_response_time == "-" or event.log.upstream_response_time == "") then

event.log.upstream_response_time = "0"

end

if (event.log.upstream_status == "-" or event.log.upstream_status == "") then

event.log.upstream_status = "0"

end

emit(event)

end

"""

[transforms.nginx_parse_remove_fields]

inputs = [ "nginx_parse_add_defaults" ]

type = "remove_fields"

fields = ["data", "file", "host", "source_type"]

[transforms.nginx_parse_coercer]

type = "coercer"

inputs = ["nginx_parse_remove_fields"]

types.request_length = "int"

types.request_time = "float"

types.response_status = "int"

types.response_body_bytes_sent = "int"

types.remote_port = "int"

types.upstream_bytes_received = "int"

types.upstream_bytes_send = "int"

types.upstream_connect_time = "float"

types.upstream_header_time = "float"

types.upstream_response_length = "int"

types.upstream_response_time = "float"

types.upstream_status = "int"

types.timestamp = "timestamp"

[sinks.nginx_output_clickhouse]

inputs = ["nginx_parse_coercer"]

type = "clickhouse"

database = "vector"

healthcheck = true

host = "http://172.26.10.109:8123" # Адрес Clickhouse

table = "logs"

encoding.timestamp_format = "unix"

buffer.type = "disk"

buffer.max_size = 104900000

buffer.when_full = "block"

request.in_flight_limit = 20

[sinks.elasticsearch]

type = "elasticsearch"

inputs = ["nginx_parse_coercer"]

compression = "none"

healthcheck = true

# 172.26.10.116 - сервер где установен elasticsearch

host = "http://172.26.10.116:9200"

index = "vector-%Y-%m-%d"Можете да прилагодите одељак трансформс.нгинк_парсе_адд_дефаултс.

Као користи ове конфигурације за мали ЦДН и може бити неколико вредности у упстреам_*

На пример:

"upstream_addr": "128.66.0.10:443, 128.66.0.11:443, 128.66.0.12:443"

"upstream_bytes_received": "-, -, 123"

"upstream_status": "502, 502, 200"Ако ово није ваша ситуација, онда овај одељак може бити поједностављен

Хајде да направимо сервисна подешавања за системд /етц/системд/систем/вецтор.сервице

# /etc/systemd/system/vector.service

[Unit]

Description=Vector

After=network-online.target

Requires=network-online.target

[Service]

User=vector

Group=vector

ExecStart=/usr/bin/vector

ExecReload=/bin/kill -HUP $MAINPID

Restart=no

StandardOutput=syslog

StandardError=syslog

SyslogIdentifier=vector

[Install]

WantedBy=multi-user.targetНакон креирања табела, можете покренути Вецтор

systemctl enable vector

systemctl start vectorВекторски дневники се могу видети овако:

journalctl -f -u vectorТребало би да има оваквих уноса у евиденцији

INFO vector::topology::builder: Healthcheck: Passed.

INFO vector::topology::builder: Healthcheck: Passed.На клијенту (Веб сервер) - 1. сервер

На серверу са нгинк-ом, морате да онемогућите ипв6, пошто табела евиденције у цлицкхоусе-у користи поље upstream_addr ИПв4, пошто не користим ипв6 интерно. Ако ипв6 није искључен, појавиће се грешке:

DB::Exception: Invalid IPv4 value.: (while read the value of key upstream_addr)Можда читаоци, додајте подршку за ипв6.

Креирајте датотеку /етц/сисцтл.д/98-дисабле-ипв6.цонф

net.ipv6.conf.all.disable_ipv6 = 1

net.ipv6.conf.default.disable_ipv6 = 1

net.ipv6.conf.lo.disable_ipv6 = 1Примена подешавања

sysctl --systemХајде да инсталирамо нгинк.

Додата датотека нгинк спремишта /етц/иум.репос.д/нгинк.репо

[nginx-stable]

name=nginx stable repo

baseurl=http://nginx.org/packages/centos/$releasever/$basearch/

gpgcheck=1

enabled=1

gpgkey=https://nginx.org/keys/nginx_signing.key

module_hotfixes=trueИнсталирајте нгинк пакет

yum install -y nginxПрво, морамо да конфигуришемо формат дневника у Нгинк-у у датотеци /етц/нгинк/нгинк.цонф

user nginx;

# you must set worker processes based on your CPU cores, nginx does not benefit from setting more than that

worker_processes auto; #some last versions calculate it automatically

# number of file descriptors used for nginx

# the limit for the maximum FDs on the server is usually set by the OS.

# if you don't set FD's then OS settings will be used which is by default 2000

worker_rlimit_nofile 100000;

error_log /var/log/nginx/error.log warn;

pid /var/run/nginx.pid;

# provides the configuration file context in which the directives that affect connection processing are specified.

events {

# determines how much clients will be served per worker

# max clients = worker_connections * worker_processes

# max clients is also limited by the number of socket connections available on the system (~64k)

worker_connections 4000;

# optimized to serve many clients with each thread, essential for linux -- for testing environment

use epoll;

# accept as many connections as possible, may flood worker connections if set too low -- for testing environment

multi_accept on;

}

http {

include /etc/nginx/mime.types;

default_type application/octet-stream;

log_format main '$remote_addr - $remote_user [$time_local] "$request" '

'$status $body_bytes_sent "$http_referer" '

'"$http_user_agent" "$http_x_forwarded_for"';

log_format vector escape=json

'{'

'"node_name":"nginx-vector",'

'"timestamp":"$time_iso8601",'

'"server_name":"$server_name",'

'"request_full": "$request",'

'"request_user_agent":"$http_user_agent",'

'"request_http_host":"$http_host",'

'"request_uri":"$request_uri",'

'"request_scheme": "$scheme",'

'"request_method":"$request_method",'

'"request_length":"$request_length",'

'"request_time": "$request_time",'

'"request_referrer":"$http_referer",'

'"response_status": "$status",'

'"response_body_bytes_sent":"$body_bytes_sent",'

'"response_content_type":"$sent_http_content_type",'

'"remote_addr": "$remote_addr",'

'"remote_port": "$remote_port",'

'"remote_user": "$remote_user",'

'"upstream_addr": "$upstream_addr",'

'"upstream_bytes_received": "$upstream_bytes_received",'

'"upstream_bytes_sent": "$upstream_bytes_sent",'

'"upstream_cache_status":"$upstream_cache_status",'

'"upstream_connect_time":"$upstream_connect_time",'

'"upstream_header_time":"$upstream_header_time",'

'"upstream_response_length":"$upstream_response_length",'

'"upstream_response_time":"$upstream_response_time",'

'"upstream_status": "$upstream_status",'

'"upstream_content_type":"$upstream_http_content_type"'

'}';

access_log /var/log/nginx/access.log main;

access_log /var/log/nginx/access.json.log vector; # Новый лог в формате json

sendfile on;

#tcp_nopush on;

keepalive_timeout 65;

#gzip on;

include /etc/nginx/conf.d/*.conf;

}Да не би нарушио вашу тренутну конфигурацију, Нгинк вам омогућава да имате неколико аццесс_лог директива

access_log /var/log/nginx/access.log main; # Стандартный лог

access_log /var/log/nginx/access.json.log vector; # Новый лог в формате jsonНе заборавите да додате правило за логоротирање за нове евиденције (ако се датотека евиденције не завршава са .лог)

Уклони дефаулт.цонф из /етц/нгинк/цонф.д/

rm -f /etc/nginx/conf.d/default.confДодајте виртуелни хост /етц/нгинк/цонф.д/вхост1.цонф

server {

listen 80;

server_name vhost1;

location / {

proxy_pass http://172.26.10.106:8080;

}

}Додајте виртуелни хост /етц/нгинк/цонф.д/вхост2.цонф

server {

listen 80;

server_name vhost2;

location / {

proxy_pass http://172.26.10.108:8080;

}

}Додајте виртуелни хост /етц/нгинк/цонф.д/вхост3.цонф

server {

listen 80;

server_name vhost3;

location / {

proxy_pass http://172.26.10.109:8080;

}

}Додајте виртуелни хост /етц/нгинк/цонф.д/вхост4.цонф

server {

listen 80;

server_name vhost4;

location / {

proxy_pass http://172.26.10.116:8080;

}

}Додајте виртуелне хостове (172.26.10.106 ип сервера на којем је инсталиран нгинк) свим серверима у /етц/хостс датотеку:

172.26.10.106 vhost1

172.26.10.106 vhost2

172.26.10.106 vhost3

172.26.10.106 vhost4И ако је све спремно онда

nginx -t

systemctl restart nginxСада хајде да га сами инсталирамо

yum install -y https://packages.timber.io/vector/0.9.X/vector-x86_64.rpmХајде да направимо датотеку за подешавања за системд /етц/системд/систем/вецтор.сервице

[Unit]

Description=Vector

After=network-online.target

Requires=network-online.target

[Service]

User=vector

Group=vector

ExecStart=/usr/bin/vector

ExecReload=/bin/kill -HUP $MAINPID

Restart=no

StandardOutput=syslog

StandardError=syslog

SyslogIdentifier=vector

[Install]

WantedBy=multi-user.targetИ конфигуришите замену за Филебеат у /етц/вецтор/вецтор.томл конфигурацији. ИП адреса 172.26.10.108 је ИП адреса сервера евиденције (Вектор-Сервер)

data_dir = "/var/lib/vector"

[sources.nginx_file]

type = "file"

include = [ "/var/log/nginx/access.json.log" ]

start_at_beginning = false

fingerprinting.strategy = "device_and_inode"

[sinks.nginx_output_vector]

type = "vector"

inputs = [ "nginx_file" ]

address = "172.26.10.108:9876"Не заборавите да додате user vector у одговарајућу групу како би могао да чита лог датотеке. На пример, nginx у centos креира логове са правима администраторске групе.

usermod -a -G adm vectorПокренимо векторску услугу

systemctl enable vector

systemctl start vectorВекторски дневники се могу видети овако:

journalctl -f -u vectorТребало би да постоји овакав унос у евиденцији

INFO vector::topology::builder: Healthcheck: Passed.Тестирање на стрес

Тестирање се врши помоћу Апацхе бенцхмарк-а.

Пакет хттпд-тоолс је инсталиран на свим серверима

Почињемо тестирање користећи Апацхе бенцхмарк са 4 различита сервера на екрану. Прво покрећемо мултиплексер терминала екрана, а затим почињемо тестирање користећи Апацхе бенцхмарк. Како радити са екраном можете пронаћи у .

Од 1. сервера

while true; do ab -H "User-Agent: 1server" -c 100 -n 10 -t 10 http://vhost1/; sleep 1; doneОд 2. сервера

while true; do ab -H "User-Agent: 2server" -c 100 -n 10 -t 10 http://vhost2/; sleep 1; doneОд 3. сервера

while true; do ab -H "User-Agent: 3server" -c 100 -n 10 -t 10 http://vhost3/; sleep 1; doneОд 4. сервера

while true; do ab -H "User-Agent: 4server" -c 100 -n 10 -t 10 http://vhost4/; sleep 1; doneХајде да проверимо податке у Цлицкхоусе-у

Идите на Цлицкхоусе

clickhouse-client -h 172.26.10.109 -mПрављење СКЛ упита

SELECT * FROM vector.logs;

┌─node_name────┬───────────timestamp─┬─server_name─┬─user_id─┬─request_full───┬─request_user_agent─┬─request_http_host─┬─request_uri─┬─request_scheme─┬─request_method─┬─request_length─┬─request_time─┬─request_referrer─┬─response_status─┬─response_body_bytes_sent─┬─response_content_type─┬───remote_addr─┬─remote_port─┬─remote_user─┬─upstream_addr─┬─upstream_port─┬─upstream_bytes_received─┬─upstream_bytes_sent─┬─upstream_cache_status─┬─upstream_connect_time─┬─upstream_header_time─┬─upstream_response_length─┬─upstream_response_time─┬─upstream_status─┬─upstream_content_type─┐

│ nginx-vector │ 2020-08-07 04:32:42 │ vhost1 │ │ GET / HTTP/1.0 │ 1server │ vhost1 │ / │ http │ GET │ 66 │ 0.028 │ │ 404 │ 27 │ │ 172.26.10.106 │ 45886 │ │ 172.26.10.106 │ 0 │ 109 │ 97 │ DISABLED │ 0 │ 0.025 │ 27 │ 0.029 │ 404 │ │

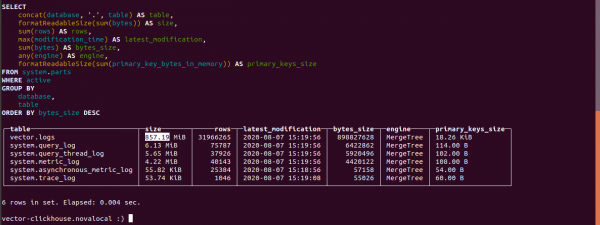

└──────────────┴─────────────────────┴─────────────┴─────────┴────────────────┴────────────────────┴───────────────────┴─────────────┴────────────────┴────────────────┴────────────────┴──────────────┴──────────────────┴─────────────────┴──────────────────────────┴───────────────────────┴───────────────┴─────────────┴─────────────┴───────────────┴───────────────┴─────────────────────────┴─────────────────────┴───────────────────────┴───────────────────────┴──────────────────────┴──────────────────────────┴────────────────────────┴─────────────────┴───────────────────────Сазнајте величину столова у Цлицкхоусе-у

select concat(database, '.', table) as table,

formatReadableSize(sum(bytes)) as size,

sum(rows) as rows,

max(modification_time) as latest_modification,

sum(bytes) as bytes_size,

any(engine) as engine,

formatReadableSize(sum(primary_key_bytes_in_memory)) as primary_keys_size

from system.parts

where active

group by database, table

order by bytes_size desc;Хајде да сазнамо колико су трупци заузели у Цлицкхоусе-у.

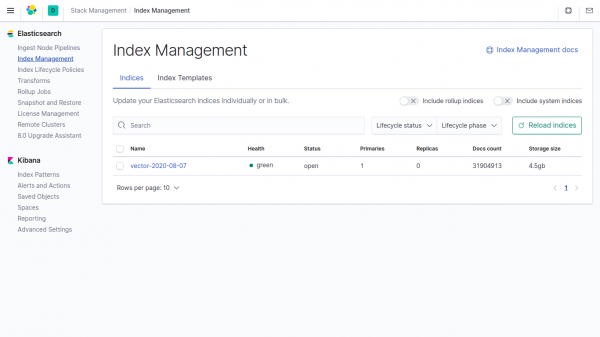

Величина табеле дневника је 857.19 МБ.

Величина истих података у индексу у Еластицсеарцх-у је 4,5 ГБ.

Ако не наведете податке у вектору у параметрима, Цлицкхоусе узима 4500/857.19 = 5.24 пута мање него у Еластицсеарцх-у.

У вектору, поље компресије се подразумевано користи.

Телеграм ћаскање од

Телеграм ћаскање од

Телеграм ћаскање од ""

Извор: ввв.хабр.цом