, பதிவு தரவு, அளவீடுகள் மற்றும் நிகழ்வுகளை சேகரிக்க, மாற்ற மற்றும் அனுப்ப வடிவமைக்கப்பட்டுள்ளது.

→

ரஸ்ட் மொழியில் எழுதப்பட்டதால், அதன் ஒப்புமைகளுடன் ஒப்பிடும்போது அதிக செயல்திறன் மற்றும் குறைந்த ரேம் நுகர்வு ஆகியவற்றால் வகைப்படுத்தப்படுகிறது. கூடுதலாக, சரியானது தொடர்பான செயல்பாடுகளுக்கு அதிக கவனம் செலுத்தப்படுகிறது, குறிப்பாக, அனுப்பப்படாத நிகழ்வுகளை வட்டில் ஒரு இடையகத்திற்குச் சேமிக்கும் திறன் மற்றும் கோப்புகளை சுழற்றும் திறன்.

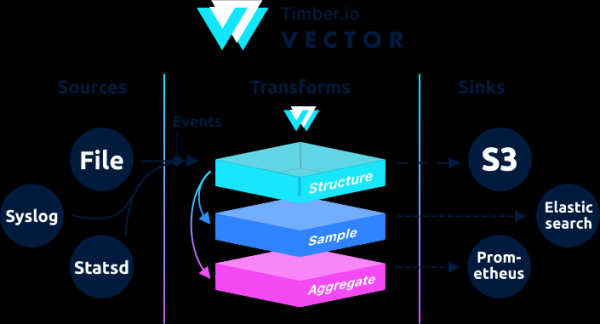

கட்டடக்கலை ரீதியாக, வெக்டர் என்பது ஒன்று அல்லது அதற்கு மேற்பட்டவர்களிடமிருந்து செய்திகளைப் பெறும் நிகழ்வு திசைவி ஆகும் ஆதாரங்கள், விருப்பமாக இந்த செய்திகளுக்கு மேல் விண்ணப்பிக்கலாம் மாற்றங்கள், மற்றும் அவற்றை ஒன்று அல்லது அதற்கு மேற்பட்டவர்களுக்கு அனுப்புதல் வடிகால்.

வெக்டர் என்பது ஃபைல்பீட் மற்றும் லாக்ஸ்டாஷுக்கு மாற்றாகும், இது இரண்டு பாத்திரங்களிலும் செயல்பட முடியும் (பதிவுகளைப் பெறுதல் மற்றும் அனுப்புதல்), அவற்றைப் பற்றிய கூடுதல் விவரங்கள் .

லாக்ஸ்டாஷில் சங்கிலி உள்ளீடு → வடிகட்டி → வெளியீடாக கட்டப்பட்டிருந்தால், அது வெக்டரில் → →

எடுத்துக்காட்டுகளை ஆவணத்தில் காணலாம்.

இந்த அறிவுறுத்தல் திருத்தப்பட்ட அறிவுறுத்தலாகும் . அசல் வழிமுறைகளில் ஜியோப் செயலாக்கம் உள்ளது. உள் நெட்வொர்க்கிலிருந்து ஜியோப்பைச் சோதிக்கும் போது, திசையன் ஒரு பிழையைக் கொடுத்தது.

Aug 05 06:25:31.889 DEBUG transform{name=nginx_parse_rename_fields type=rename_fields}: vector::transforms::rename_fields: Field did not exist field=«geoip.country_name» rate_limit_secs=30யாராவது geoip ஐ செயலாக்க வேண்டும் என்றால், அசல் வழிமுறைகளைப் பார்க்கவும் .

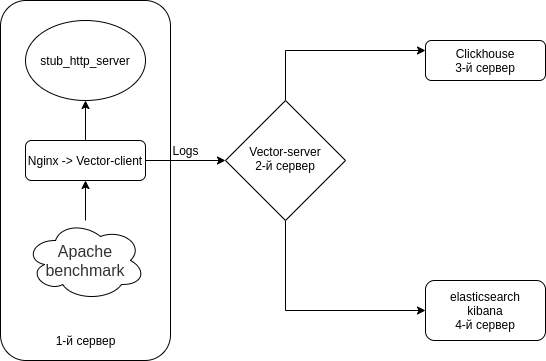

Nginx (அணுகல் பதிவுகள்) → Vector (Client | Filebeat) → Vector (Server | Logstash) → ஆகியவற்றின் கலவையை Clickhouse இல் தனித்தனியாகவும், Elasticsearch இல் தனித்தனியாகவும் உள்ளமைப்போம். நாங்கள் 4 சேவையகங்களை நிறுவுவோம். நீங்கள் அதை 3 சர்வர்கள் மூலம் கடந்து செல்ல முடியும் என்றாலும்.

திட்டம் இது போன்றது.

உங்கள் அனைத்து சேவையகங்களிலும் Selinux ஐ முடக்கவும்

sed -i 's/^SELINUX=.*/SELINUX=disabled/g' /etc/selinux/config

rebootஅனைத்து சேவையகங்களிலும் HTTP சர்வர் முன்மாதிரி + பயன்பாடுகளை நிறுவுகிறோம்

ஒரு HTTP சர்வர் எமுலேட்டராக நாம் பயன்படுத்துவோம் இருந்து

Nodejs-stub-server இல் rpm இல்லை. அதற்கான rpm ஐ உருவாக்கவும். rpm ஐப் பயன்படுத்தி தொகுக்கப்படும்

antonpatsev/nodejs-stub-server repository ஐச் சேர்க்கவும்

yum -y install yum-plugin-copr epel-release

yes | yum copr enable antonpatsev/nodejs-stub-serverஅனைத்து சர்வர்களிலும் nodejs-stub-server, Apache பெஞ்ச்மார்க் மற்றும் ஸ்கிரீன் டெர்மினல் மல்டிபிளெக்சர் ஆகியவற்றை நிறுவவும்

yum -y install stub_http_server screen mc httpd-tools screenநான் stub_http_server மறுமொழி நேரத்தை /var/lib/stub_http_server/stub_http_server.js கோப்பில் சரிசெய்தேன், அதனால் அதிக பதிவுகள் இருந்தன.

var max_sleep = 10;stub_http_server ஐ துவக்குவோம்.

systemctl start stub_http_server

systemctl enable stub_http_serverசர்வரில் 3

கிளிக்ஹவுஸ் SSE 4.2 அறிவுறுத்தல் தொகுப்பைப் பயன்படுத்துகிறது, எனவே குறிப்பிடப்படாவிட்டால், பயன்படுத்தப்படும் செயலியில் அதற்கான ஆதரவு கூடுதல் கணினித் தேவையாகிறது. தற்போதைய செயலி SSE 4.2 ஐ ஆதரிக்கிறதா என்பதைச் சரிபார்க்க இங்கே கட்டளை உள்ளது:

grep -q sse4_2 /proc/cpuinfo && echo "SSE 4.2 supported" || echo "SSE 4.2 not supported"முதலில் நீங்கள் அதிகாரப்பூர்வ களஞ்சியத்தை இணைக்க வேண்டும்:

sudo yum install -y yum-utils

sudo rpm --import https://repo.clickhouse.tech/CLICKHOUSE-KEY.GPG

sudo yum-config-manager --add-repo https://repo.clickhouse.tech/rpm/stable/x86_64தொகுப்புகளை நிறுவ, நீங்கள் பின்வரும் கட்டளைகளை இயக்க வேண்டும்:

sudo yum install -y clickhouse-server clickhouse-client/etc/clickhouse-server/config.xml கோப்பில் உள்ள பிணைய அட்டையைக் கேட்க கிளிக்ஹவுஸ்-சர்வரை அனுமதிக்கவும்

<listen_host>0.0.0.0</listen_host>லாக்கிங் லெவலை ட்ரேஸில் இருந்து பிழைத்திருத்தத்திற்கு மாற்றுகிறது

சரிசெய்வதற்கான

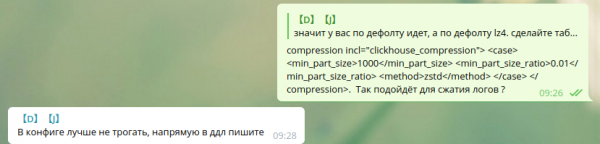

நிலையான சுருக்க அமைப்புகள்:

min_compress_block_size 65536

max_compress_block_size 1048576Zstd சுருக்கத்தை செயல்படுத்த, கட்டமைப்பைத் தொட வேண்டாம், மாறாக DDL ஐப் பயன்படுத்துமாறு அறிவுறுத்தப்பட்டது.

கூகுளில் DDL வழியாக zstd கம்ப்ரஷனை எப்படி பயன்படுத்துவது என்று என்னால் கண்டுபிடிக்க முடியவில்லை. அதனால் அப்படியே விட்டுவிட்டேன்.

கிளிக்ஹவுஸில் zstd சுருக்கத்தைப் பயன்படுத்தும் சக ஊழியர்கள், தயவுசெய்து வழிமுறைகளைப் பகிரவும்.

சர்வரை டீமானாகத் தொடங்க, இயக்கவும்:

service clickhouse-server startஇப்போது Clickhouse அமைப்பிற்கு செல்லலாம்

கிளிக்ஹவுஸுக்குச் செல்லவும்

clickhouse-client -h 172.26.10.109 -m172.26.10.109 — Clickhouse நிறுவப்பட்ட சர்வரின் IP.

வெக்டர் தரவுத்தளத்தை உருவாக்குவோம்

CREATE DATABASE vector;தரவுத்தளம் இருக்கிறதா என்று பார்க்கலாம்.

show databases;vector.logs அட்டவணையை உருவாக்கவும்.

/* Это таблица где хранятся логи как есть */

CREATE TABLE vector.logs

(

`node_name` String,

`timestamp` DateTime,

`server_name` String,

`user_id` String,

`request_full` String,

`request_user_agent` String,

`request_http_host` String,

`request_uri` String,

`request_scheme` String,

`request_method` String,

`request_length` UInt64,

`request_time` Float32,

`request_referrer` String,

`response_status` UInt16,

`response_body_bytes_sent` UInt64,

`response_content_type` String,

`remote_addr` IPv4,

`remote_port` UInt32,

`remote_user` String,

`upstream_addr` IPv4,

`upstream_port` UInt32,

`upstream_bytes_received` UInt64,

`upstream_bytes_sent` UInt64,

`upstream_cache_status` String,

`upstream_connect_time` Float32,

`upstream_header_time` Float32,

`upstream_response_length` UInt64,

`upstream_response_time` Float32,

`upstream_status` UInt16,

`upstream_content_type` String,

INDEX idx_http_host request_http_host TYPE set(0) GRANULARITY 1

)

ENGINE = MergeTree()

PARTITION BY toYYYYMMDD(timestamp)

ORDER BY timestamp

TTL timestamp + toIntervalMonth(1)

SETTINGS index_granularity = 8192;அட்டவணைகள் உருவாக்கப்பட்டன என்பதை நாங்கள் சரிபார்க்கிறோம். துவக்குவோம் clickhouse-client மற்றும் கோரிக்கை விடுங்கள்.

வெக்டர் தரவுத்தளத்திற்கு செல்வோம்.

use vector;

Ok.

0 rows in set. Elapsed: 0.001 sec.அட்டவணைகளைப் பார்ப்போம்.

show tables;

┌─name────────────────┐

│ logs │

└─────────────────────┘கிளிக்ஹவுஸுடன் ஒப்பிடுவதற்கு அதே தரவை Elasticsearch க்கு அனுப்ப 4வது சர்வரில் elasticsearch ஐ நிறுவுகிறது

பொது rpm விசையைச் சேர்க்கவும்

rpm --import https://artifacts.elastic.co/GPG-KEY-elasticsearch2 ரெப்போவை உருவாக்குவோம்:

/etc/yum.repos.d/elasticsearch.repo

[elasticsearch]

name=Elasticsearch repository for 7.x packages

baseurl=https://artifacts.elastic.co/packages/7.x/yum

gpgcheck=1

gpgkey=https://artifacts.elastic.co/GPG-KEY-elasticsearch

enabled=0

autorefresh=1

type=rpm-md/etc/yum.repos.d/kibana.repo

[kibana-7.x]

name=Kibana repository for 7.x packages

baseurl=https://artifacts.elastic.co/packages/7.x/yum

gpgcheck=1

gpgkey=https://artifacts.elastic.co/GPG-KEY-elasticsearch

enabled=1

autorefresh=1

type=rpm-mdமீள் தேடல் மற்றும் கிபானாவை நிறுவவும்

yum install -y kibana elasticsearchஇது 1 பிரதியில் இருப்பதால், பின்வருவனவற்றை /etc/elasticsearch/elasticsearch.yml கோப்பில் சேர்க்க வேண்டும்:

discovery.type: single-nodeஎனவே அந்த வெக்டார் வேறொரு சர்வரில் இருந்து மீள் தேடலுக்கு தரவை அனுப்ப முடியும், நாம் network.host ஐ மாற்றுவோம்.

network.host: 0.0.0.0கிபானாவுடன் இணைக்க, /etc/kibana/kibana.yml கோப்பில் உள்ள server.host அளவுருவை மாற்றவும்

server.host: "0.0.0.0"பழையது மற்றும் ஆட்டோஸ்டார்ட்டில் மீள் தேடலைச் சேர்க்கவும்

systemctl enable elasticsearch

systemctl start elasticsearchமற்றும் கிபானா

systemctl enable kibana

systemctl start kibanaஒற்றை முனை பயன்முறை 1 ஷார்ட், 0 பிரதிக்கான எலாஸ்டிக் தேடலை உள்ளமைக்கிறது. பெரும்பாலும் நீங்கள் அதிக எண்ணிக்கையிலான சேவையகங்களின் தொகுப்பைக் கொண்டிருப்பீர்கள், இதை நீங்கள் செய்ய வேண்டியதில்லை.

எதிர்கால குறியீடுகளுக்கு, இயல்புநிலை டெம்ப்ளேட்டைப் புதுப்பிக்கவும்:

curl -X PUT http://localhost:9200/_template/default -H 'Content-Type: application/json' -d '{"index_patterns": ["*"],"order": -1,"settings": {"number_of_shards": "1","number_of_replicas": "0"}}' நிறுவல் சேவையகம் 2 இல் Logstash க்கு மாற்றாக

yum install -y https://packages.timber.io/vector/0.9.X/vector-x86_64.rpm mc httpd-tools screenலாக்ஸ்டாஷுக்கு மாற்றாக வெக்டரை அமைப்போம். /etc/vector/vector.toml கோப்பைத் திருத்துகிறது

# /etc/vector/vector.toml

data_dir = "/var/lib/vector"

[sources.nginx_input_vector]

# General

type = "vector"

address = "0.0.0.0:9876"

shutdown_timeout_secs = 30

[transforms.nginx_parse_json]

inputs = [ "nginx_input_vector" ]

type = "json_parser"

[transforms.nginx_parse_add_defaults]

inputs = [ "nginx_parse_json" ]

type = "lua"

version = "2"

hooks.process = """

function (event, emit)

function split_first(s, delimiter)

result = {};

for match in (s..delimiter):gmatch("(.-)"..delimiter) do

table.insert(result, match);

end

return result[1];

end

function split_last(s, delimiter)

result = {};

for match in (s..delimiter):gmatch("(.-)"..delimiter) do

table.insert(result, match);

end

return result[#result];

end

event.log.upstream_addr = split_first(split_last(event.log.upstream_addr, ', '), ':')

event.log.upstream_bytes_received = split_last(event.log.upstream_bytes_received, ', ')

event.log.upstream_bytes_sent = split_last(event.log.upstream_bytes_sent, ', ')

event.log.upstream_connect_time = split_last(event.log.upstream_connect_time, ', ')

event.log.upstream_header_time = split_last(event.log.upstream_header_time, ', ')

event.log.upstream_response_length = split_last(event.log.upstream_response_length, ', ')

event.log.upstream_response_time = split_last(event.log.upstream_response_time, ', ')

event.log.upstream_status = split_last(event.log.upstream_status, ', ')

if event.log.upstream_addr == "" then

event.log.upstream_addr = "127.0.0.1"

end

if (event.log.upstream_bytes_received == "-" or event.log.upstream_bytes_received == "") then

event.log.upstream_bytes_received = "0"

end

if (event.log.upstream_bytes_sent == "-" or event.log.upstream_bytes_sent == "") then

event.log.upstream_bytes_sent = "0"

end

if event.log.upstream_cache_status == "" then

event.log.upstream_cache_status = "DISABLED"

end

if (event.log.upstream_connect_time == "-" or event.log.upstream_connect_time == "") then

event.log.upstream_connect_time = "0"

end

if (event.log.upstream_header_time == "-" or event.log.upstream_header_time == "") then

event.log.upstream_header_time = "0"

end

if (event.log.upstream_response_length == "-" or event.log.upstream_response_length == "") then

event.log.upstream_response_length = "0"

end

if (event.log.upstream_response_time == "-" or event.log.upstream_response_time == "") then

event.log.upstream_response_time = "0"

end

if (event.log.upstream_status == "-" or event.log.upstream_status == "") then

event.log.upstream_status = "0"

end

emit(event)

end

"""

[transforms.nginx_parse_remove_fields]

inputs = [ "nginx_parse_add_defaults" ]

type = "remove_fields"

fields = ["data", "file", "host", "source_type"]

[transforms.nginx_parse_coercer]

type = "coercer"

inputs = ["nginx_parse_remove_fields"]

types.request_length = "int"

types.request_time = "float"

types.response_status = "int"

types.response_body_bytes_sent = "int"

types.remote_port = "int"

types.upstream_bytes_received = "int"

types.upstream_bytes_send = "int"

types.upstream_connect_time = "float"

types.upstream_header_time = "float"

types.upstream_response_length = "int"

types.upstream_response_time = "float"

types.upstream_status = "int"

types.timestamp = "timestamp"

[sinks.nginx_output_clickhouse]

inputs = ["nginx_parse_coercer"]

type = "clickhouse"

database = "vector"

healthcheck = true

host = "http://172.26.10.109:8123" # Адрес Clickhouse

table = "logs"

encoding.timestamp_format = "unix"

buffer.type = "disk"

buffer.max_size = 104900000

buffer.when_full = "block"

request.in_flight_limit = 20

[sinks.elasticsearch]

type = "elasticsearch"

inputs = ["nginx_parse_coercer"]

compression = "none"

healthcheck = true

# 172.26.10.116 - сервер где установен elasticsearch

host = "http://172.26.10.116:9200"

index = "vector-%Y-%m-%d"Transforms.nginx_parse_add_defaults பிரிவை நீங்கள் சரிசெய்யலாம்.

முதல் ஒரு சிறிய CDNக்கு இந்த கட்டமைப்புகளைப் பயன்படுத்துகிறது மற்றும் அப்ஸ்ட்ரீமில் பல மதிப்புகள் இருக்கலாம்_*

உதாரணமாக:

"upstream_addr": "128.66.0.10:443, 128.66.0.11:443, 128.66.0.12:443"

"upstream_bytes_received": "-, -, 123"

"upstream_status": "502, 502, 200"இது உங்கள் நிலைமை இல்லையென்றால், இந்த பகுதியை எளிதாக்கலாம்

systemd /etc/systemd/system/vector.service க்கான சேவை அமைப்புகளை உருவாக்குவோம்

# /etc/systemd/system/vector.service

[Unit]

Description=Vector

After=network-online.target

Requires=network-online.target

[Service]

User=vector

Group=vector

ExecStart=/usr/bin/vector

ExecReload=/bin/kill -HUP $MAINPID

Restart=no

StandardOutput=syslog

StandardError=syslog

SyslogIdentifier=vector

[Install]

WantedBy=multi-user.targetஅட்டவணையை உருவாக்கிய பிறகு, நீங்கள் வெக்டரை இயக்கலாம்

systemctl enable vector

systemctl start vectorதிசையன் பதிவுகளை இப்படிப் பார்க்கலாம்:

journalctl -f -u vectorபதிவுகளில் இது போன்ற உள்ளீடுகள் இருக்க வேண்டும்

INFO vector::topology::builder: Healthcheck: Passed.

INFO vector::topology::builder: Healthcheck: Passed.கிளையண்டில் (வலை சேவையகம்) - 1 வது சர்வர்

nginx உடன் சர்வரில், கிளிக்ஹவுஸில் உள்ள பதிவுகள் அட்டவணை புலத்தைப் பயன்படுத்துவதால், நீங்கள் ipv6 ஐ முடக்க வேண்டும். upstream_addr IPv4, ஏனெனில் நான் பிணையத்தில் ipv6 ஐப் பயன்படுத்தவில்லை. ipv6 அணைக்கப்படவில்லை என்றால், பிழைகள் இருக்கும்:

DB::Exception: Invalid IPv4 value.: (while read the value of key upstream_addr)ஒருவேளை வாசகர்கள், ipv6 ஆதரவைச் சேர்க்கவும்.

/etc/sysctl.d/98-disable-ipv6.conf கோப்பை உருவாக்கவும்

net.ipv6.conf.all.disable_ipv6 = 1

net.ipv6.conf.default.disable_ipv6 = 1

net.ipv6.conf.lo.disable_ipv6 = 1அமைப்புகளைப் பயன்படுத்துதல்

sysctl --systemnginx ஐ நிறுவுவோம்.

nginx களஞ்சியக் கோப்பு சேர்க்கப்பட்டது /etc/yum.repos.d/nginx.repo

[nginx-stable]

name=nginx stable repo

baseurl=http://nginx.org/packages/centos/$releasever/$basearch/

gpgcheck=1

enabled=1

gpgkey=https://nginx.org/keys/nginx_signing.key

module_hotfixes=truenginx தொகுப்பை நிறுவவும்

yum install -y nginxமுதலில், பதிவு வடிவத்தை Nginx இல் /etc/nginx/nginx.conf கோப்பில் உள்ளமைக்க வேண்டும்.

user nginx;

# you must set worker processes based on your CPU cores, nginx does not benefit from setting more than that

worker_processes auto; #some last versions calculate it automatically

# number of file descriptors used for nginx

# the limit for the maximum FDs on the server is usually set by the OS.

# if you don't set FD's then OS settings will be used which is by default 2000

worker_rlimit_nofile 100000;

error_log /var/log/nginx/error.log warn;

pid /var/run/nginx.pid;

# provides the configuration file context in which the directives that affect connection processing are specified.

events {

# determines how much clients will be served per worker

# max clients = worker_connections * worker_processes

# max clients is also limited by the number of socket connections available on the system (~64k)

worker_connections 4000;

# optimized to serve many clients with each thread, essential for linux -- for testing environment

use epoll;

# accept as many connections as possible, may flood worker connections if set too low -- for testing environment

multi_accept on;

}

http {

include /etc/nginx/mime.types;

default_type application/octet-stream;

log_format main '$remote_addr - $remote_user [$time_local] "$request" '

'$status $body_bytes_sent "$http_referer" '

'"$http_user_agent" "$http_x_forwarded_for"';

log_format vector escape=json

'{'

'"node_name":"nginx-vector",'

'"timestamp":"$time_iso8601",'

'"server_name":"$server_name",'

'"request_full": "$request",'

'"request_user_agent":"$http_user_agent",'

'"request_http_host":"$http_host",'

'"request_uri":"$request_uri",'

'"request_scheme": "$scheme",'

'"request_method":"$request_method",'

'"request_length":"$request_length",'

'"request_time": "$request_time",'

'"request_referrer":"$http_referer",'

'"response_status": "$status",'

'"response_body_bytes_sent":"$body_bytes_sent",'

'"response_content_type":"$sent_http_content_type",'

'"remote_addr": "$remote_addr",'

'"remote_port": "$remote_port",'

'"remote_user": "$remote_user",'

'"upstream_addr": "$upstream_addr",'

'"upstream_bytes_received": "$upstream_bytes_received",'

'"upstream_bytes_sent": "$upstream_bytes_sent",'

'"upstream_cache_status":"$upstream_cache_status",'

'"upstream_connect_time":"$upstream_connect_time",'

'"upstream_header_time":"$upstream_header_time",'

'"upstream_response_length":"$upstream_response_length",'

'"upstream_response_time":"$upstream_response_time",'

'"upstream_status": "$upstream_status",'

'"upstream_content_type":"$upstream_http_content_type"'

'}';

access_log /var/log/nginx/access.log main;

access_log /var/log/nginx/access.json.log vector; # Новый лог в формате json

sendfile on;

#tcp_nopush on;

keepalive_timeout 65;

#gzip on;

include /etc/nginx/conf.d/*.conf;

}உங்கள் தற்போதைய உள்ளமைவை உடைக்காமல் இருக்க, Nginx ஆனது பல access_log வழிமுறைகளைப் பெற உங்களை அனுமதிக்கிறது

access_log /var/log/nginx/access.log main; # Стандартный лог

access_log /var/log/nginx/access.json.log vector; # Новый лог в формате jsonபுதிய பதிவுகளுக்கு லாக்ரோடேட் செய்வதற்கான விதியைச் சேர்க்க மறக்காதீர்கள் (பதிவுக் கோப்பு .log உடன் முடிவடையவில்லை என்றால்)

/etc/nginx/conf.d/ இலிருந்து default.conf ஐ அகற்று

rm -f /etc/nginx/conf.d/default.confமெய்நிகர் ஹோஸ்ட் /etc/nginx/conf.d/vhost1.conf ஐச் சேர்க்கவும்

server {

listen 80;

server_name vhost1;

location / {

proxy_pass http://172.26.10.106:8080;

}

}மெய்நிகர் ஹோஸ்ட் /etc/nginx/conf.d/vhost2.conf ஐச் சேர்க்கவும்

server {

listen 80;

server_name vhost2;

location / {

proxy_pass http://172.26.10.108:8080;

}

}மெய்நிகர் ஹோஸ்ட் /etc/nginx/conf.d/vhost3.conf ஐச் சேர்க்கவும்

server {

listen 80;

server_name vhost3;

location / {

proxy_pass http://172.26.10.109:8080;

}

}மெய்நிகர் ஹோஸ்ட் /etc/nginx/conf.d/vhost4.conf ஐச் சேர்க்கவும்

server {

listen 80;

server_name vhost4;

location / {

proxy_pass http://172.26.10.116:8080;

}

}/etc/hosts கோப்பில் அனைத்து சேவையகங்களுக்கும் மெய்நிகர் ஹோஸ்ட்களை (nginx நிறுவப்பட்ட சர்வரின் 172.26.10.106 ip) சேர்க்கவும்:

172.26.10.106 vhost1

172.26.10.106 vhost2

172.26.10.106 vhost3

172.26.10.106 vhost4மற்றும் எல்லாம் தயாராக இருந்தால்

nginx -t

systemctl restart nginxஇப்போது அதை நாமே நிறுவுவோம்

yum install -y https://packages.timber.io/vector/0.9.X/vector-x86_64.rpmsystemd /etc/systemd/system/vector.service க்கான அமைப்புகள் கோப்பை உருவாக்குவோம்

[Unit]

Description=Vector

After=network-online.target

Requires=network-online.target

[Service]

User=vector

Group=vector

ExecStart=/usr/bin/vector

ExecReload=/bin/kill -HUP $MAINPID

Restart=no

StandardOutput=syslog

StandardError=syslog

SyslogIdentifier=vector

[Install]

WantedBy=multi-user.targetFilebeat மாற்றீட்டை /etc/vector/vector.toml config இல் உள்ளமைக்கவும். ஐபி முகவரி 172.26.10.108 என்பது பதிவு சேவையகத்தின் (வெக்டர்-சர்வர்) ஐபி முகவரி

data_dir = "/var/lib/vector"

[sources.nginx_file]

type = "file"

include = [ "/var/log/nginx/access.json.log" ]

start_at_beginning = false

fingerprinting.strategy = "device_and_inode"

[sinks.nginx_output_vector]

type = "vector"

inputs = [ "nginx_file" ]

address = "172.26.10.108:9876"பதிவுக் கோப்புகளைப் படிப்பதற்காக, பயனர் வெக்டரை பொருத்தமான குழுவில் சேர்க்க மறக்காதீர்கள். எடுத்துக்காட்டாக, nginx-இல் centos நிர்வாகி குழு உரிமைகளுடன் பதிவேடுகளை உருவாக்குகிறது.

usermod -a -G adm vectorவெக்டர் சேவையைத் தொடங்குவோம்

systemctl enable vector

systemctl start vectorதிசையன் பதிவுகளை இப்படிப் பார்க்கலாம்:

journalctl -f -u vectorபதிவுகளில் இப்படி ஒரு பதிவு இருக்க வேண்டும்

INFO vector::topology::builder: Healthcheck: Passed.மன அழுத்த சோதனை

நாங்கள் அப்பாச்சி பெஞ்ச்மார்க்கைப் பயன்படுத்தி சோதனை செய்கிறோம்.

httpd-tools தொகுப்பு அனைத்து சேவையகங்களிலும் நிறுவப்பட்டுள்ளது

திரையில் உள்ள 4 வெவ்வேறு சர்வர்களில் இருந்து அப்பாச்சி பெஞ்ச்மார்க்கைப் பயன்படுத்தி சோதிக்கத் தொடங்குகிறோம். முதலில், ஸ்கிரீன் டெர்மினல் மல்டிபிளெக்சரைத் தொடங்குகிறோம், பின்னர் அப்பாச்சி பெஞ்ச்மார்க்கைப் பயன்படுத்தி சோதனையைத் தொடங்குகிறோம். திரையில் எவ்வாறு வேலை செய்வது என்பதை நீங்கள் காணலாம் .

1 வது சர்வரில் இருந்து

while true; do ab -H "User-Agent: 1server" -c 100 -n 10 -t 10 http://vhost1/; sleep 1; done2 வது சர்வரில் இருந்து

while true; do ab -H "User-Agent: 2server" -c 100 -n 10 -t 10 http://vhost2/; sleep 1; done3 வது சர்வரில் இருந்து

while true; do ab -H "User-Agent: 3server" -c 100 -n 10 -t 10 http://vhost3/; sleep 1; done4 வது சர்வரில் இருந்து

while true; do ab -H "User-Agent: 4server" -c 100 -n 10 -t 10 http://vhost4/; sleep 1; doneகிளிக்ஹவுஸில் தரவைச் சரிபார்ப்போம்

கிளிக்ஹவுஸுக்குச் செல்லவும்

clickhouse-client -h 172.26.10.109 -mSQL வினவலை உருவாக்குதல்

SELECT * FROM vector.logs;

┌─node_name────┬───────────timestamp─┬─server_name─┬─user_id─┬─request_full───┬─request_user_agent─┬─request_http_host─┬─request_uri─┬─request_scheme─┬─request_method─┬─request_length─┬─request_time─┬─request_referrer─┬─response_status─┬─response_body_bytes_sent─┬─response_content_type─┬───remote_addr─┬─remote_port─┬─remote_user─┬─upstream_addr─┬─upstream_port─┬─upstream_bytes_received─┬─upstream_bytes_sent─┬─upstream_cache_status─┬─upstream_connect_time─┬─upstream_header_time─┬─upstream_response_length─┬─upstream_response_time─┬─upstream_status─┬─upstream_content_type─┐

│ nginx-vector │ 2020-08-07 04:32:42 │ vhost1 │ │ GET / HTTP/1.0 │ 1server │ vhost1 │ / │ http │ GET │ 66 │ 0.028 │ │ 404 │ 27 │ │ 172.26.10.106 │ 45886 │ │ 172.26.10.106 │ 0 │ 109 │ 97 │ DISABLED │ 0 │ 0.025 │ 27 │ 0.029 │ 404 │ │

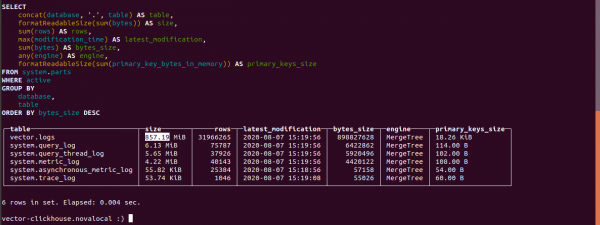

└──────────────┴─────────────────────┴─────────────┴─────────┴────────────────┴────────────────────┴───────────────────┴─────────────┴────────────────┴────────────────┴────────────────┴──────────────┴──────────────────┴─────────────────┴──────────────────────────┴───────────────────────┴───────────────┴─────────────┴─────────────┴───────────────┴───────────────┴─────────────────────────┴─────────────────────┴───────────────────────┴───────────────────────┴──────────────────────┴──────────────────────────┴────────────────────────┴─────────────────┴───────────────────────கிளிக்ஹவுஸில் அட்டவணைகளின் அளவைக் கண்டறியவும்

select concat(database, '.', table) as table,

formatReadableSize(sum(bytes)) as size,

sum(rows) as rows,

max(modification_time) as latest_modification,

sum(bytes) as bytes_size,

any(engine) as engine,

formatReadableSize(sum(primary_key_bytes_in_memory)) as primary_keys_size

from system.parts

where active

group by database, table

order by bytes_size desc;கிளிக்ஹவுஸில் எவ்வளவு பதிவுகள் எடுக்கப்பட்டன என்பதைக் கண்டுபிடிப்போம்.

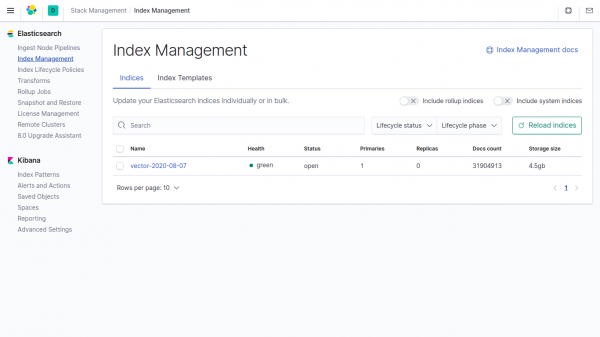

பதிவுகள் அட்டவணை அளவு 857.19 எம்பி.

Elasticsearch இல் உள்ள குறியீட்டில் உள்ள அதே தரவின் அளவு 4,5GB ஆகும்.

அளவுருக்களில் வெக்டரில் தரவைக் குறிப்பிடவில்லை என்றால், Clickhouse ஆனது Elasticsearchஐ விட 4500/857.19 = 5.24 மடங்கு குறைவாக எடுக்கும்.

திசையனில், சுருக்க புலம் இயல்பாகவே பயன்படுத்தப்படுகிறது.

மூலம் டெலிகிராம் அரட்டை

மூலம் டெலிகிராம் அரட்டை

தந்தி அரட்டை ""

ஆதாரம்: www.habr.com