บทความนี้เป็นความต่อเนื่องของบทความก่อนหน้า - “'

โดยจะครอบคลุมกระบวนการติดตั้งพื้นฐานและการกำหนดค่าคลัสเตอร์ oVirt 4.3 สำหรับการโฮสต์เครื่องเสมือนที่มีความพร้อมใช้งานสูง โดยคำนึงถึงข้อเท็จจริงที่ว่าขั้นตอนเบื้องต้นทั้งหมดสำหรับการเตรียมโครงสร้างพื้นฐานได้เสร็จสิ้นไปแล้วก่อนหน้านี้

prodrome

วัตถุประสงค์หลักของบทความนี้คือการให้คำแนะนำทีละขั้นตอนเช่น “ถัดไป -> ใช่ -> เสร็จสิ้น"จะแสดงคุณสมบัติบางอย่างเมื่อติดตั้งและกำหนดค่าได้อย่างไร กระบวนการปรับใช้คลัสเตอร์ของคุณอาจไม่ตรงกับที่อธิบายไว้ในนั้นเสมอไป เนื่องจากลักษณะของโครงสร้างพื้นฐานและสภาพแวดล้อม แต่หลักการทั่วไปจะเหมือนกัน

จากมุมมองส่วนตัว ฟังก์ชันการทำงานคล้ายกับ VMware vSphere เวอร์ชัน 5.x แต่แน่นอนว่ามีคุณสมบัติการกำหนดค่าและการทำงานเป็นของตัวเอง

สำหรับผู้ที่สนใจความแตกต่างทั้งหมดระหว่าง RHEV (aka oVirt) และ VMware vSphere สามารถพบได้บนอินเทอร์เน็ต แต่ฉันจะยังคงสังเกตความแตกต่างหรือความคล้ายคลึงกันบางประการเป็นครั้งคราวเมื่อบทความดำเนินไป

แยกกันฉันต้องการเปรียบเทียบงานกับเครือข่ายสำหรับเครื่องเสมือนเล็กน้อย oVirt ใช้หลักการที่คล้ายกันของการจัดการเครือข่ายสำหรับเครื่องเสมือน (ต่อไปนี้จะเรียกว่า VM) เช่นเดียวกับใน VMware vSphere:

- с помощью стандартного Linux bridge (в VMware — vSwitch มาตรฐาน) ทำงานบนโฮสต์การจำลองเสมือน

- ใช้ Open vSwitch (OVS) (ใน VMware - vSwitch แบบกระจาย) คือสวิตช์เสมือนแบบกระจายที่ประกอบด้วยสององค์ประกอบหลัก: เซิร์ฟเวอร์ OVN ส่วนกลาง และตัวควบคุม OVN บนโฮสต์ที่ได้รับการจัดการ

Необходимо отметить, что из-за простоты реализации, в статье будет описана настройка сетей в oVirt’е для ВМ с помощью стандартного Linux bridge, который является стандартным выбором, при использовании гипервизора KVM.

ในเรื่องนี้ มีกฎพื้นฐานหลายประการสำหรับการทำงานกับเครือข่ายในคลัสเตอร์ ซึ่งเป็นวิธีที่ดีที่สุดที่จะไม่ละเมิด:

- การตั้งค่าเครือข่ายทั้งหมดบนโฮสต์ก่อนที่จะเพิ่มลงใน oVirt จะต้องเหมือนกัน ยกเว้นที่อยู่ IP

- เมื่อโฮสต์อยู่ภายใต้การควบคุมของ oVirt ไม่แนะนำอย่างยิ่งให้เปลี่ยนแปลงสิ่งใด ๆ ด้วยตนเองในการตั้งค่าเครือข่ายโดยไม่มั่นใจในการกระทำของคุณ เนื่องจากตัวแทน oVirt จะย้อนกลับไปยังค่าก่อนหน้าหลังจากรีสตาร์ทโฮสต์หรือ ตัวแทน.

- การเพิ่มเครือข่ายใหม่สำหรับ VM รวมถึงการทำงานด้วยนั้นควรทำจากคอนโซลการจัดการ oVirt เท่านั้น

อื่น โน๊ตสำคัญ — สำหรับสภาพแวดล้อมที่สำคัญมาก (อ่อนไหวต่อการสูญเสียทางการเงินมาก) ยังคงแนะนำให้ใช้การสนับสนุนและการใช้งานแบบชำระเงิน . ในระหว่างการทำงานของคลัสเตอร์ oVirt ปัญหาบางอย่างอาจเกิดขึ้นซึ่งขอแนะนำให้รับความช่วยเหลือที่มีคุณสมบัติเหมาะสมโดยเร็วที่สุด แทนที่จะจัดการกับปัญหาเหล่านั้นด้วยตนเอง

ในที่สุด, แนะนำ ก่อนที่จะปรับใช้คลัสเตอร์ oVirt โปรดทำความคุ้นเคยกับ เพื่อจะได้ทราบถึงแนวคิดและคำจำกัดความพื้นฐานเป็นอย่างน้อย ไม่เช่นนั้นบทความที่เหลือจะอ่านได้ยากสักหน่อย

พื้นฐานในการทำความเข้าใจบทความและหลักการทำงานของคลัสเตอร์ oVirt คือเอกสารคำแนะนำเหล่านี้:

ปริมาณไม่มากในหนึ่งหรือสองชั่วโมงคุณสามารถเชี่ยวชาญหลักการพื้นฐานได้ค่อนข้างดี แต่สำหรับผู้ที่ชื่นชอบรายละเอียดแนะนำให้อ่าน — RHEV และ oVirt เป็นสิ่งเดียวกันโดยพื้นฐานแล้ว

ดังนั้น หากการตั้งค่าพื้นฐานทั้งหมดบนโฮสต์ สวิตช์ และระบบจัดเก็บข้อมูลเสร็จสมบูรณ์ เราจะดำเนินการปรับใช้ oVirt โดยตรง

ส่วนที่ 2 การติดตั้งและกำหนดค่าคลัสเตอร์ oVirt 4.3

เพื่อความสะดวกในการปฐมนิเทศ ฉันจะแสดงรายการส่วนหลักในบทความนี้ซึ่งจะต้องกรอกทีละส่วน:

- การติดตั้งเซิร์ฟเวอร์การจัดการ oVirt

- การสร้างศูนย์ข้อมูลใหม่

- การสร้างคลัสเตอร์ใหม่

- การติดตั้งโฮสต์เพิ่มเติมในสภาพแวดล้อมแบบโฮสต์เอง

- การสร้างพื้นที่จัดเก็บข้อมูลหรือโดเมนการจัดเก็บข้อมูล

- การสร้างและกำหนดค่าเครือข่ายสำหรับเครื่องเสมือน

- การสร้างอิมเมจการติดตั้งสำหรับการปรับใช้เครื่องเสมือน

- สร้างเครื่องเสมือน

การติดตั้งเซิร์ฟเวอร์การจัดการ oVirt

เซิร์ฟเวอร์การจัดการ oVirt เป็นองค์ประกอบที่สำคัญที่สุดในโครงสร้างพื้นฐาน oVirt ในรูปแบบของเครื่องเสมือน โฮสต์ หรืออุปกรณ์เสมือนที่จัดการโครงสร้างพื้นฐาน oVirt ทั้งหมด

ความคล้ายคลึงกันอย่างใกล้ชิดจากโลกแห่งการจำลองเสมือนคือ:

- VMware vSphere - เซิร์ฟเวอร์ vCenter

- Microsoft Hyper-V - ตัวจัดการเครื่องเสมือนศูนย์ระบบ (VMM)

ในการติดตั้งเซิร์ฟเวอร์การจัดการ oVirt เรามีสองตัวเลือก:

ตัวเลือก 1

การปรับใช้เซิร์ฟเวอร์ในรูปแบบของ VM หรือโฮสต์เฉพาะ

ตัวเลือกนี้ใช้งานได้ค่อนข้างดี แต่หาก VM ดังกล่าวทำงานโดยไม่ขึ้นอยู่กับคลัสเตอร์ เช่น ไม่ได้ทำงานบนโฮสต์คลัสเตอร์ใดๆ เหมือนกับเครื่องเสมือนทั่วไปที่ใช้ KVM

เหตุใดจึงไม่สามารถปรับใช้ VM ดังกล่าวบนโฮสต์คลัสเตอร์ได้

В самом начале процесса развёртывания управляющего сервера oVirt, у нас имеется дилемма — управляющую ВМ ставить нужно, но самого кластера фактически ещё нет, и поэтому что можно с ходу придумать? Правильно – установить KVM на будущий узел кластера, далее на нём создать виртуальную машину, например, с ОС CentOS и в ней развернуть oVirt engine. Это может делаться обычно из соображений полного контроля над такой ВМ, но это ошибочное намерение, потому что в таком случае, в дальнейшем 100% будут проблемы с такой управляющей ВМ:

- ไม่สามารถย้ายในคอนโซล oVirt ระหว่างโฮสต์ (โหนด) ของคลัสเตอร์

- เมื่อทำการย้ายโดยใช้ KVM ผ่าน virsh อพยพVM นี้จะไม่พร้อมใช้งานสำหรับการจัดการจากคอนโซล oVirt

- ไม่สามารถแสดงโฮสต์คลัสเตอร์ได้ โหมดการบำรุงรักษา (โหมดการบำรุงรักษา) หากคุณย้าย VM นี้จากโฮสต์หนึ่งไปยังอีกโฮสต์โดยใช้ virsh อพยพ.

ดังนั้นทำทุกอย่างตามกฎ - ใช้โฮสต์แยกต่างหากสำหรับเซิร์ฟเวอร์การจัดการ oVirt หรือ VM อิสระที่ทำงานบนนั้น หรือดีกว่านั้น ให้ทำตามที่เขียนไว้ในตัวเลือกที่สอง

ตัวเลือก 2

การติดตั้ง oVirt Engine Appliance บนโฮสต์คลัสเตอร์ที่จัดการโดยมัน

เป็นตัวเลือกนี้จะได้รับการพิจารณาเพิ่มเติมว่าถูกต้องและเหมาะสมกว่าในกรณีของเรา

ข้อกำหนดสำหรับ VM ดังกล่าวอธิบายไว้ด้านล่าง ฉันจะเพิ่มเฉพาะว่าขอแนะนำให้มีโฮสต์อย่างน้อยสองโฮสต์ในโครงสร้างพื้นฐานที่ VM ควบคุมสามารถทำงานได้เพื่อให้ทนทานต่อข้อผิดพลาด ที่นี่ฉันอยากจะเสริมว่าตามที่ฉันได้เขียนไว้ในความคิดเห็นในบทความที่แล้วฉันไม่เคยได้รับเลย สมองแตกแยก บนคลัสเตอร์ oVirt ของสองโฮสต์ พร้อมความสามารถในการรัน VM ของเอ็นจิ้นที่โฮสต์บนโฮสต์เหล่านั้น

การติดตั้ง oVirt Engine Appliance บนโฮสต์แรกของคลัสเตอร์

ลิงค์ไปยังเอกสารอย่างเป็นทางการ - บท "»

เอกสารระบุข้อกำหนดเบื้องต้นที่ต้องปฏิบัติตามก่อนที่จะปรับใช้ VM ของเอ็นจิ้นที่โฮสต์ และยังอธิบายรายละเอียดกระบวนการติดตั้งด้วย ดังนั้นจึงแทบไม่มีประโยชน์เลยในการทำซ้ำแบบคำต่อคำ ดังนั้นเราจะมุ่งเน้นไปที่รายละเอียดที่สำคัญบางประการ

- ก่อนที่จะเริ่มดำเนินการทั้งหมด ตรวจสอบให้แน่ใจว่าได้เปิดใช้งานการสนับสนุนการจำลองเสมือนในการตั้งค่า BIOS บนโฮสต์

- ติดตั้งแพ็คเกจสำหรับตัวติดตั้งเอ็นจิ้นโฮสต์บนโฮสต์:

yum -y install http://resources.ovirt.org/pub/yum-repo/ovirt-release43.rpm

yum -y install epel-release

yum install screen ovirt-hosted-engine-setup- เราเริ่มขั้นตอนการปรับใช้ oVirt Hosted Engine ในหน้าจอบนโฮสต์ (คุณสามารถออกได้โดยใช้ Ctrl-A + D ปิดด้วย Ctrl-D):

screen

hosted-engine --deployหากต้องการ คุณสามารถเรียกใช้การติดตั้งด้วยไฟล์คำตอบที่เตรียมไว้ล่วงหน้าได้:

hosted-engine --deploy --config-append=/var/lib/ovirt-hosted-engine-setup/answers/answers-ohe.conf- เมื่อปรับใช้โฮสต์เอ็นจิ้น เราจะระบุพารามิเตอร์ที่จำเป็นทั้งหมด:

- имя кластера

- количество vCPU и vRAM (рекомендуется 4 vCPU и 16 Гб)

- пароли

- тип хранилища для hosted engine ВМ – в нашем случае FC

- номер LUN для установки hosted engine

- где будет находиться база данных для hosted engine – рекомендую для простоты выбрать Local (это БД PostgreSQL работающая внутри этой ВМ)

и др. параметры. - ในการติดตั้ง VM ที่พร้อมใช้งานสูงด้วยเอ็นจิ้นที่โฮสต์ ก่อนหน้านี้เราได้สร้าง LUN พิเศษบนระบบจัดเก็บข้อมูล ขนาดหมายเลข 4 และ 150 GB ซึ่งจากนั้นนำเสนอต่อโฮสต์คลัสเตอร์ - ดู .

ก่อนหน้านี้ เรายังตรวจสอบการเปิดเผยข้อมูลบนโฮสต์ด้วย:

multipath -ll

…

3600a098000e4b4b3000003c95d171065 dm-3 DELL , MD38xxf

size=150G features='3 queue_if_no_path pg_init_retries 50' hwhandler='1 rdac' wp=rw

|-+- policy='service-time 0' prio=14 status=active

| `- 15:0:0:4 sdc 8:32 active ready running

`-+- policy='service-time 0' prio=9 status=enabled

`- 18:0:0:4 sdj 8:144 active ready running- กระบวนการปรับใช้โฮสต์เอ็นจิ้นนั้นไม่ซับซ้อน ในตอนท้าย เราควรได้รับสิ่งนี้:

[ INFO ] Generating answer file '/var/lib/ovirt-hosted-engine-setup/answers/answers-20191129131846.conf'

[ INFO ] Generating answer file '/etc/ovirt-hosted-engine/answers.conf'

[ INFO ] Stage: Pre-termination

[ INFO ] Stage: Termination

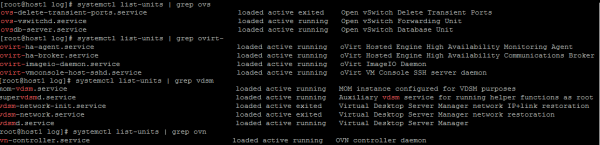

[ INFO ] Hosted Engine successfully deployedเราตรวจสอบการมีอยู่ของบริการ oVirt บนโฮสต์:

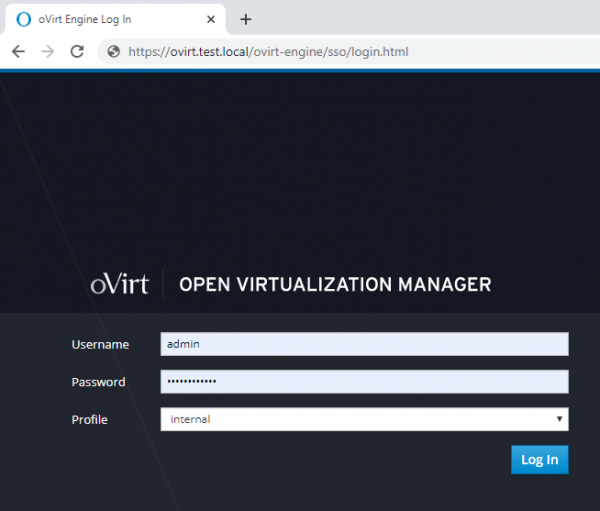

หากทุกอย่างถูกต้องแล้ว หลังจากการติดตั้งเสร็จสิ้น ให้ใช้เว็บเบราว์เซอร์เพื่อไป จากคอมพิวเตอร์ของผู้ดูแลระบบ และคลิก [พอร์ทัลการบริหาร].

ภาพหน้าจอของ “พอร์ทัลการบริหารระบบ”

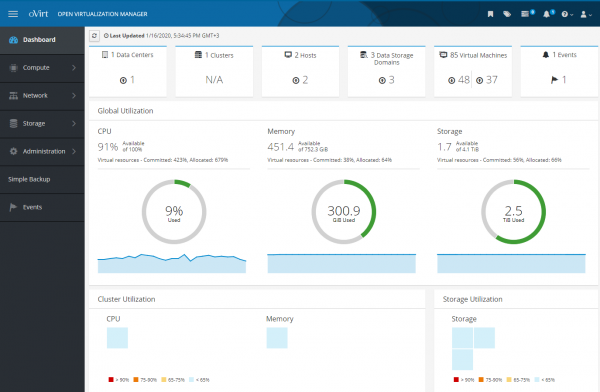

ด้วยการเข้าสู่ระบบและรหัสผ่าน (ตั้งค่าระหว่างกระบวนการติดตั้ง) ลงในหน้าต่างเช่นเดียวกับในภาพหน้าจอเราจะไปที่แผงควบคุม Open Virtualization Manager ซึ่งคุณสามารถดำเนินการทั้งหมดด้วยโครงสร้างพื้นฐานเสมือน:

- เพิ่มศูนย์ข้อมูล

- เพิ่มและกำหนดค่าคลัสเตอร์

- เพิ่มและจัดการโฮสต์

- เพิ่มพื้นที่จัดเก็บข้อมูลหรือโดเมนการจัดเก็บสำหรับดิสก์เครื่องเสมือน

- เพิ่มและกำหนดค่าเครือข่ายสำหรับเครื่องเสมือน

- เพิ่มและจัดการเครื่องเสมือน อิมเมจการติดตั้ง เทมเพลต VM

การดำเนินการทั้งหมดนี้จะมีการหารือเพิ่มเติม บางส่วนในเซลล์ขนาดใหญ่ การดำเนินการอื่นๆ ในรายละเอียดเพิ่มเติมและมีความแตกต่าง

แต่ก่อนอื่นฉันขอแนะนำให้อ่านส่วนเสริมนี้ซึ่งอาจเป็นประโยชน์กับหลาย ๆ คน

การเพิ่ม

1) โดยหลักการแล้ว หากมีความจำเป็น จะไม่มีสิ่งใดขัดขวางไม่ให้คุณติดตั้งไฮเปอร์ไวเซอร์ KVM บนโหนดคลัสเตอร์ล่วงหน้าโดยใช้แพ็คเกจ libvirt и คิวมู-ตร.ม (หรือ qemu-kvm-ev) ของเวอร์ชันที่ต้องการ แม้ว่าเมื่อปรับใช้โหนดคลัสเตอร์ oVirt แต่ก็สามารถทำได้ด้วยตัวเอง

แต่ถ้า libvirt и คิวมู-ตร.ม หากคุณไม่ได้ติดตั้งเวอร์ชันล่าสุด คุณอาจได้รับข้อผิดพลาดต่อไปนี้เมื่อปรับใช้เอ็นจิ้นที่โฮสต์:

error: unsupported configuration: unknown CPU feature: md-clearเหล่านั้น. จำเป็นต้องมี libvirt พร้อมความคุ้มครองจาก ซึ่งสนับสนุนนโยบายนี้:

<feature policy='require' name='md-clear'/>ติดตั้ง libvirt v.4.5.0-10.el7_6.12 พร้อมรองรับ md-clear:

yum-config-manager --disable mirror.centos.org_centos-7_7_virt_x86_64_libvirt-latest_

yum install centos-release-qemu-ev

yum update

yum install qemu-kvm qemu-img virt-manager libvirt libvirt-python libvirt-client virt-install virt-viewer libguestfs libguestfs-tools dejavu-lgc-sans-fonts virt-top libvirt libvirt-python libvirt-client

systemctl enable libvirtd

systemctl restart libvirtd && systemctl status libvirtdตรวจสอบการสนับสนุน 'md-clear':

virsh domcapabilities kvm | grep require

<feature policy='require' name='ss'/>

<feature policy='require' name='hypervisor'/>

<feature policy='require' name='tsc_adjust'/>

<feature policy='require' name='clflushopt'/>

<feature policy='require' name='pku'/>

<feature policy='require' name='md-clear'/>

<feature policy='require' name='stibp'/>

<feature policy='require' name='ssbd'/>

<feature policy='require' name='invtsc'/>หลังจากนี้ คุณสามารถทำการติดตั้งเอ็นจิ้นที่โฮสต์ต่อไปได้

2) ใน oVirt 4.3 การมีอยู่และการใช้งานไฟร์วอลล์ firewalld เป็นข้อกำหนดบังคับ

หากในระหว่างการปรับใช้ VM สำหรับโฮสต์เอ็นจิ้น เราได้รับข้อผิดพลาดต่อไปนี้:

[ ERROR ] fatal: [localhost]: FAILED! => {"changed": false, "msg": "firewalld is required to be enabled and active in order to correctly deploy hosted-engine. Please check, fix accordingly and re-deploy.n"}

[ ERROR ] Failed to execute stage 'Closing up': Failed executing ansible-playbook

[https://bugzilla.redhat.com/show_bug.cgi?id=1608467จากนั้นคุณจะต้องปิดไฟร์วอลล์อื่น (หากใช้งาน) และติดตั้งและรัน firewalld:

yum install firewalld

systemctl enable firewalld

systemctl start firewalld

firewall-cmd --state

firewall-cmd --get-default-zone

firewall-cmd --get-active-zones

firewall-cmd --get-zonesในภายหลัง เมื่อติดตั้ง ovirt agent บนโฮสต์ใหม่สำหรับคลัสเตอร์ คลัสเตอร์จะกำหนดค่าพอร์ตที่จำเป็น firewalld อัตโนมัติ

3) การรีบูตโฮสต์ด้วย VM ที่ทำงานบนนั้นด้วยเอ็นจิ้นที่โฮสต์

โดยปกติ и เพื่อควบคุมเอกสาร

การจัดการโฮสต์เอ็นจิ้น VM ทั้งหมดทำได้โดยใช้คำสั่งเท่านั้น โฮสต์เครื่องยนต์ บนโฮสต์ที่มันทำงานประมาณ เวียร์ เราต้องลืมเช่นเดียวกับความจริงที่ว่าคุณสามารถเชื่อมต่อกับ VM นี้ผ่าน SSH และรันคำสั่ง “การปิด'

ขั้นตอนในการทำให้ VM เข้าสู่โหมดการบำรุงรักษา:

hosted-engine --set-maintenance --mode=global

hosted-engine --vm-status

!! Cluster is in GLOBAL MAINTENANCE mode !!

--== Host host1.test.local (id: 1) status ==--

conf_on_shared_storage : True

Status up-to-date : True

Hostname : host1.test.local

Host ID : 1

Engine status : {"health": "good", "vm": "up", "detail": "Up"}

Score : 3400

stopped : False

Local maintenance : False

crc32 : dee1a774

local_conf_timestamp : 1821

Host timestamp : 1821

Extra metadata (valid at timestamp):

metadata_parse_version=1

metadata_feature_version=1

timestamp=1821 (Sat Nov 29 14:25:19 2019)

host-id=1

score=3400

vm_conf_refresh_time=1821 (Sat Nov 29 14:25:19 2019)

conf_on_shared_storage=True

maintenance=False

state=GlobalMaintenance

stopped=False

hosted-engine --vm-shutdownเรารีบูทโฮสต์ด้วยเอเจนต์เอ็นจิ้นโฮสต์ และทำสิ่งที่เราต้องการด้วย

หลังจากรีบูต ให้ตรวจสอบสถานะของ VM ด้วยเอ็นจิ้นที่โฮสต์:

hosted-engine --vm-statusหาก VM ของเราที่มีโฮสต์เอ็นจิ้นไม่เริ่มทำงาน และหากเราพบข้อผิดพลาดที่คล้ายกันในบันทึกบริการ:

ข้อผิดพลาดในบันทึกการบริการ:

journalctl -u ovirt-ha-agent

...

Jun 29 14:34:44 host1 journal: ovirt-ha-agent ovirt_hosted_engine_ha.agent.hosted_engine.HostedEngine ERROR Failed to start necessary monitors

Jun 29 14:34:44 host1 journal: ovirt-ha-agent ovirt_hosted_engine_ha.agent.agent.Agent ERROR Traceback (most recent call last):#012 File "/usr/lib/python2.7/site-packages/ovirt_hosted_engine_ha/agent/agent.py", line 131, in _run_agent#012 return action(he)#012 File "/usr/lib/python2.7/site-packages/ovirt_hosted_engine_ha/agent/agent.py", line 55, in action_proper#012 return he.start_monitoring()#012 File "/usr/lib/python2.7/site-packages/ovirt_hosted_engine_ha/agent/hosted_engine.py", line 413, in start_monitoring#012 self._initialize_broker()#012 File "/usr/lib/python2.7/site-packages/ovirt_hosted_engine_ha/agent/hosted_engine.py", line 537, in _initialize_broker#012 m.get('options', {}))#012 File "/usr/lib/python2.7/site-packages/ovirt_hosted_engine_ha/lib/brokerlink.py", line 86, in start_monitor#012 ).format(t=type, o=options, e=e)#012RequestError: brokerlink - failed to start monitor via ovirt-ha-broker: [Errno 2] No such file or directory, [monitor: 'ping', options: {'addr': '172.20.32.32'}]

Jun 29 14:34:44 host1 journal: ovirt-ha-agent ovirt_hosted_engine_ha.agent.agent.Agent ERROR Trying to restart agentจากนั้นเราเชื่อมต่อที่เก็บข้อมูลและรีสตาร์ทตัวแทน:

hosted-engine --connect-storage

systemctl restart ovirt-ha-agent

systemctl status ovirt-ha-agent

hosted-engine --vm-start

hosted-engine --vm-statusหลังจากสตาร์ท VM ด้วยเอ็นจิ้นที่โฮสต์แล้ว เราจะนำมันออกจากโหมดการบำรุงรักษา:

ขั้นตอนในการลบ VM ออกจากโหมดการบำรุงรักษา:

hosted-engine --check-liveliness

hosted-engine --set-maintenance --mode=none

hosted-engine --vm-status

--== Host host1.test.local (id: 1) status ==--

conf_on_shared_storage : True

Status up-to-date : True

Hostname : host1.test.local

Host ID : 1

Engine status : {"health": "good", "vm": "up", "detail": "Up"}

Score : 3400

stopped : False

Local maintenance : False

crc32 : 6d1eb25f

local_conf_timestamp : 6222296

Host timestamp : 6222296

Extra metadata (valid at timestamp):

metadata_parse_version=1

metadata_feature_version=1

timestamp=6222296 (Fri Jan 17 11:40:43 2020)

host-id=1

score=3400

vm_conf_refresh_time=6222296 (Fri Jan 17 11:40:43 2020)

conf_on_shared_storage=True

maintenance=False

state=EngineUp

stopped=False4) การลบเอ็นจิ้นที่โฮสต์และทุกสิ่งที่เกี่ยวข้องออก

บางครั้งจำเป็นต้องลบเอ็นจิ้นที่โฮสต์ไว้ก่อนหน้านี้อย่างถูกต้อง - ไปยังเอกสารคำแนะนำ

เพียงรันคำสั่งบนโฮสต์:

/usr/sbin/ovirt-hosted-engine-cleanupต่อไป เราจะลบแพ็คเกจที่ไม่จำเป็นออก และสำรองข้อมูลการกำหนดค่าบางส่วนไว้ก่อนหน้านี้ หากจำเป็น:

yum autoremove ovirt* qemu* virt* libvirt* libguestfs การสร้างศูนย์ข้อมูลใหม่

เอกสารอ้างอิง - คู่มือการดูแลระบบ oVirt

ก่อนอื่นเรามากำหนดว่ามันคืออะไร ศูนย์ข้อมูล (ฉันอ้างอิงจากความช่วยเหลือ) เป็นเอนทิตีเชิงตรรกะที่กำหนดชุดของทรัพยากรที่ใช้ในสภาพแวดล้อมเฉพาะ

ศูนย์ข้อมูลเป็นคอนเทนเนอร์ชนิดหนึ่งที่ประกอบด้วย:

- ทรัพยากรลอจิคัลในรูปแบบของคลัสเตอร์และโฮสต์

- ทรัพยากรเครือข่ายคลัสเตอร์ในรูปแบบของเครือข่ายลอจิคัลและอะแดปเตอร์ทางกายภาพบนโฮสต์

- ทรัพยากรการจัดเก็บข้อมูล (สำหรับดิสก์ VM, เทมเพลต, รูปภาพ) ในรูปแบบของพื้นที่จัดเก็บข้อมูล (โดเมนการจัดเก็บ)

ศูนย์ข้อมูลสามารถมีหลายคลัสเตอร์ซึ่งประกอบด้วยโฮสต์หลายเครื่องที่มีเครื่องเสมือนทำงานอยู่ และยังสามารถมีพื้นที่จัดเก็บข้อมูลหลายพื้นที่เชื่อมโยงอยู่ด้วย

อาจมีศูนย์ข้อมูลได้หลายแห่ง โดยทำงานแยกจากกัน Ovirt มีการแบ่งอำนาจตามบทบาท และคุณสามารถกำหนดค่าสิทธิ์ได้ทีละรายการ ทั้งในระดับศูนย์ข้อมูลและในองค์ประกอบทางลอจิคัลแต่ละรายการ

ศูนย์ข้อมูลหรือศูนย์ข้อมูลหากมีหลายแห่ง จะได้รับการจัดการจากคอนโซลผู้ดูแลระบบหรือพอร์ทัลเดียว

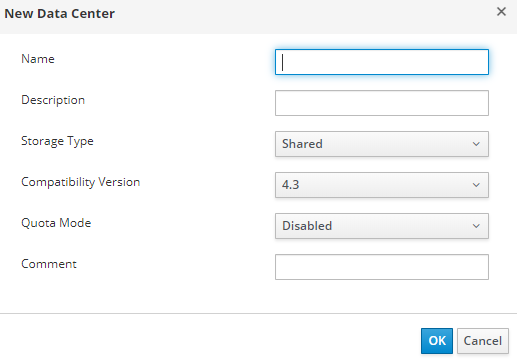

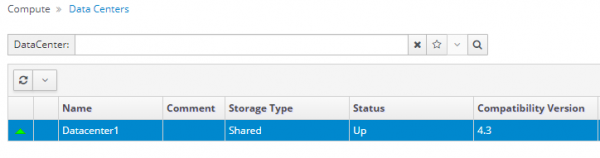

หากต้องการสร้างศูนย์ข้อมูล ให้ไปที่พอร์ทัลผู้ดูแลระบบและสร้างศูนย์ข้อมูลใหม่:

คำนวณ >> ศูนย์ข้อมูล >> ใหม่

เนื่องจากเราใช้ที่เก็บข้อมูลที่ใช้ร่วมกันบนระบบจัดเก็บข้อมูล ประเภทที่เก็บข้อมูลจึงควรถูกใช้ร่วมกัน:

สกรีนช็อตของตัวช่วยสร้างการสร้างศูนย์ข้อมูล

เมื่อติดตั้งเครื่องเสมือนด้วยโฮสต์เอ็นจิ้น ศูนย์ข้อมูลจะถูกสร้างขึ้นตามค่าเริ่มต้น - ศูนย์ข้อมูล1จากนั้นหากจำเป็น คุณสามารถเปลี่ยนประเภทการจัดเก็บข้อมูลเป็นประเภทอื่นได้

การสร้างศูนย์ข้อมูลเป็นงานง่ายๆ โดยไม่มีความแตกต่างที่ยุ่งยาก และการดำเนินการเพิ่มเติมทั้งหมดกับศูนย์ได้อธิบายไว้ในเอกสารประกอบ สิ่งเดียวที่ฉันจะทราบก็คือโฮสต์เดียวที่มีเฉพาะที่เก็บข้อมูลในเครื่อง (ดิสก์) สำหรับ VM จะไม่สามารถเข้าสู่ศูนย์ข้อมูลที่มีประเภทการจัดเก็บข้อมูล - แชร์ (ไม่สามารถเพิ่มได้ที่นั่น) และสำหรับพวกเขา คุณต้องสร้าง ศูนย์ข้อมูลแยกต่างหาก - เช่น โฮสต์แต่ละรายที่มีพื้นที่จัดเก็บในตัวเครื่องจำเป็นต้องมีศูนย์ข้อมูลแยกเป็นของตัวเอง

การสร้างคลัสเตอร์ใหม่

ลิงก์ไปยังเอกสารประกอบ - คู่มือการดูแลระบบ oVirt

โดยไม่มีรายละเอียดที่ไม่จำเป็น คลัสเตอร์ – นี่คือการจัดกลุ่มโฮสต์แบบลอจิคัลที่มีพื้นที่จัดเก็บข้อมูลทั่วไป (ในรูปแบบของดิสก์ที่ใช้ร่วมกันบนระบบจัดเก็บข้อมูล ดังในกรณีของเรา) เป็นที่พึงประสงค์ว่าโฮสต์ในคลัสเตอร์จะเหมือนกันในฮาร์ดแวร์และมีโปรเซสเซอร์ประเภทเดียวกัน (Intel หรือ AMD) เป็นการดีที่สุดที่เซิร์ฟเวอร์ในคลัสเตอร์จะเหมือนกันโดยสิ้นเชิง

คลัสเตอร์เป็นส่วนหนึ่งของศูนย์ข้อมูล (พร้อมพื้นที่เก็บข้อมูลเฉพาะ - องถิ่น หรือ ที่ใช้ร่วมกัน) และโฮสต์ทั้งหมดจะต้องอยู่ในคลัสเตอร์บางประเภท ขึ้นอยู่กับว่าพวกเขามีพื้นที่เก็บข้อมูลที่ใช้ร่วมกันหรือไม่

เมื่อติดตั้งเครื่องเสมือนด้วยโฮสต์เอ็นจิ้นบนโฮสต์ ศูนย์ข้อมูลจะถูกสร้างขึ้นตามค่าเริ่มต้น - ศูนย์ข้อมูล1ร่วมกับคลัสเตอร์ – คลัสเตอร์ 1และในอนาคตคุณสามารถกำหนดค่าพารามิเตอร์ เปิดใช้งานตัวเลือกเพิ่มเติม เพิ่มโฮสต์ได้ เป็นต้น

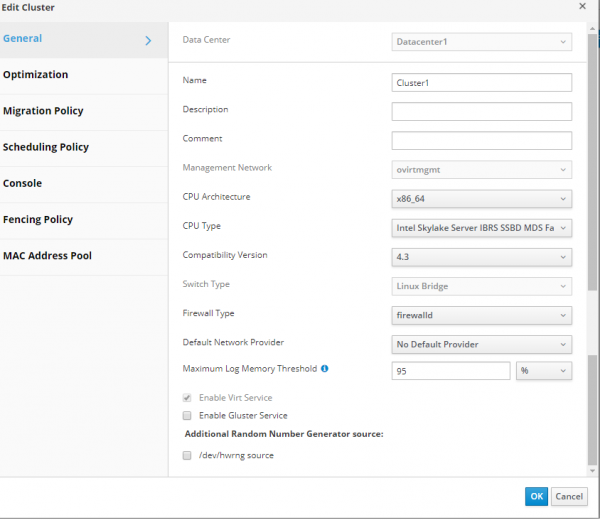

ตามปกติ ขอแนะนำให้อ่านรายละเอียดเกี่ยวกับการตั้งค่าคลัสเตอร์ทั้งหมดจากเอกสารประกอบอย่างเป็นทางการ คุณลักษณะบางอย่างของการตั้งค่าคลัสเตอร์ ฉันจะเพิ่มเฉพาะเมื่อสร้างคลัสเตอร์ การกำหนดค่าเฉพาะพารามิเตอร์พื้นฐานบนแท็บก็เพียงพอแล้ว ทั่วไป.

ฉันจะสังเกตพารามิเตอร์ที่สำคัญที่สุด:

- ประเภทโปรเซสเซอร์ — ถูกเลือกโดยพิจารณาจากโปรเซสเซอร์ที่ติดตั้งบนโฮสต์ของคลัสเตอร์ มาจากผู้ผลิตรายใด และโปรเซสเซอร์ใดบนโฮสต์นั้นเก่าที่สุด ดังนั้น คำสั่งของโปรเซสเซอร์ที่มีอยู่ทั้งหมดในคลัสเตอร์จึงขึ้นอยู่กับสิ่งนี้

- ประเภทสวิทช์ – у нас в кластере используется только Linux bridge, поэтому его и выбираем.

- ประเภทไฟร์วอลล์ – ทุกอย่างชัดเจนที่นี่ นี่คือไฟร์วอลล์ ซึ่งจะต้องเปิดใช้งานและกำหนดค่าบนโฮสต์

ภาพหน้าจอพร้อมพารามิเตอร์คลัสเตอร์

การติดตั้งโฮสต์เพิ่มเติมในสภาพแวดล้อมแบบโฮสต์เอง

สำหรับเอกสาร

โฮสต์เพิ่มเติมสำหรับสภาพแวดล้อมที่โฮสต์เองจะถูกเพิ่มในลักษณะเดียวกับโฮสต์ทั่วไป โดยมีขั้นตอนเพิ่มเติมในการปรับใช้ VM ด้วยเอ็นจิ้นที่โฮสต์ - เลือกการดำเนินการปรับใช้กลไกที่โฮสต์ >> ปรับใช้. เนื่องจากโฮสต์เพิ่มเติมจะต้องแสดงด้วย LUN สำหรับ VM ที่มีกลไกที่โฮสต์อยู่ ซึ่งหมายความว่าโฮสต์นี้สามารถใช้เพื่อโฮสต์ VM ด้วยกลไกที่โฮสต์อยู่ได้ หากจำเป็น

เพื่อวัตถุประสงค์ในการยอมรับข้อผิดพลาด ขอแนะนำอย่างยิ่งให้มีโฮสต์อย่างน้อยสองโฮสต์ซึ่งสามารถวาง VM ของกลไกที่โฮสต์ไว้ได้

บนโฮสต์เพิ่มเติม ให้ปิดการใช้งาน iptables (หากเปิดใช้งาน) เปิดใช้งานไฟร์วอลล์

systemctl stop iptables

systemctl disable iptables

systemctl enable firewalld

systemctl start firewalldติดตั้งเวอร์ชัน KVM ที่ต้องการ (หากจำเป็น):

yum-config-manager --disable mirror.centos.org_centos-7_7_virt_x86_64_libvirt-latest_

yum install centos-release-qemu-ev

yum update

yum install qemu-kvm qemu-img virt-manager libvirt libvirt-python libvirt-client virt-install virt-viewer libguestfs libguestfs-tools dejavu-lgc-sans-fonts virt-top libvirt libvirt-python libvirt-client

systemctl enable libvirtd

systemctl restart libvirtd && systemctl status libvirtd

virsh domcapabilities kvm | grep md-clearติดตั้งที่เก็บที่จำเป็นและตัวติดตั้งเอ็นจิ้นที่โฮสต์:

yum -y install http://resources.ovirt.org/pub/yum-repo/ovirt-release43.rpm

yum -y install epel-release

yum update

yum install screen ovirt-hosted-engine-setupจากนั้นไปที่คอนโซล เปิดตัวจัดการการจำลองเสมือนเพิ่มโฮสต์ใหม่และทำทุกอย่างทีละขั้นตอนตามที่เขียนไว้ .

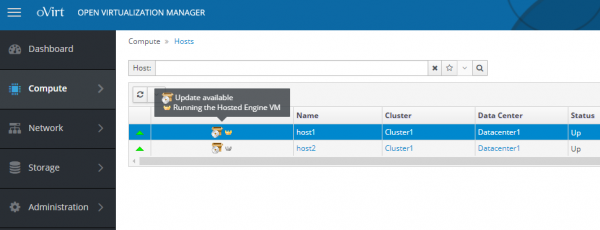

ด้วยเหตุนี้ หลังจากเพิ่มโฮสต์เพิ่มเติมแล้ว เราควรจะได้ภาพในคอนโซลผู้ดูแลระบบ ดังในภาพหน้าจอ

สกรีนช็อตของพอร์ทัลการดูแลระบบ - โฮสต์

โฮสต์ที่ VM ของโฮสต์เอ็นจิ้นใช้งานอยู่นั้นมีมงกุฎทองคำและคำจารึกว่า “ใช้งาน Hosted Engine VM" โฮสต์ที่สามารถเปิดใช้งาน VM นี้ได้หากจำเป็น - คำจารึก "สามารถเรียกใช้ Hosted Engine VM ได้'

ในกรณีที่โฮสต์ล้มเหลวซึ่ง "ใช้งาน Hosted Engine VM" มันจะรีสตาร์ทโดยอัตโนมัติบนโฮสต์ที่สอง VM นี้ยังสามารถย้ายจากโฮสต์ที่ใช้งานอยู่ไปยังโฮสต์สแตนด์บายเพื่อการบำรุงรักษา

การตั้งค่าการจัดการพลังงาน / การฟันดาบบนโฮสต์ oVirt

ลิงค์เอกสาร:

- Red Hat Virtualization 4.3 –> ข้อมูลอ้างอิงทางเทคนิค ->

- คู่มือการดูแลระบบ oVirt ->

แม้ว่าดูเหมือนว่าคุณได้เพิ่มและกำหนดค่าโฮสต์เสร็จแล้ว แต่ก็ไม่เป็นความจริงทั้งหมด

สำหรับการทำงานปกติของโฮสต์ และเพื่อระบุ/แก้ไขความล้มเหลวใดๆ ก็ตาม จำเป็นต้องมีการตั้งค่าการจัดการพลังงาน / การฟันดาบ

รั้วหรือการฟันดาบเป็นกระบวนการในการยกเว้นโฮสต์ที่ผิดพลาดหรือล้มเหลวออกจากคลัสเตอร์เป็นการชั่วคราว ในระหว่างนั้นบริการ oVirt บนคลัสเตอร์หรือตัวโฮสต์จะรีสตาร์ทใหม่

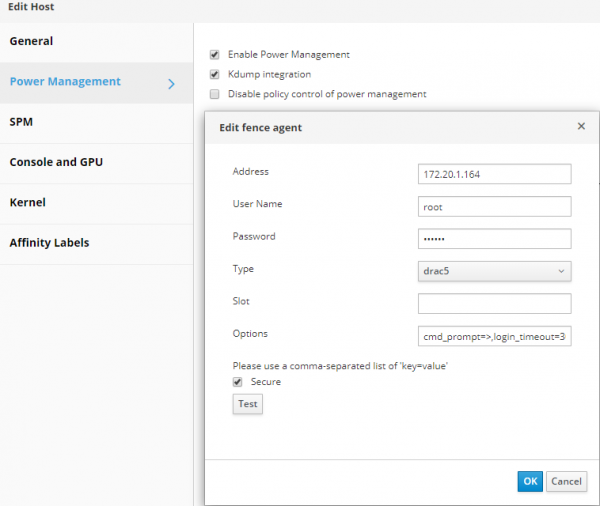

รายละเอียดทั้งหมดเกี่ยวกับคำจำกัดความและพารามิเตอร์ของการจัดการพลังงาน / การฟันดาบนั้นมีให้ตามปกติในเอกสารประกอบ ฉันจะยกตัวอย่างวิธีกำหนดค่าพารามิเตอร์ที่สำคัญนี้ตามที่ใช้กับเซิร์ฟเวอร์ Dell R640 ที่มี iDRAC 9

- ไปที่พอร์ทัลผู้ดูแลระบบคลิก คำนวณ >> เจ้าภาพ เลือกโฮสต์

- เราคลิก Edit.

- คลิกที่แท็บ การจัดการพลังงาน.

- ทำเครื่องหมายที่ช่องถัดจากตัวเลือก เปิดใช้งานการจัดการพลังงาน.

- ทำเครื่องหมายที่ช่องถัดจากตัวเลือก บูรณาการ Kdumpเพื่อป้องกันไม่ให้โฮสต์เข้าสู่โหมดฟันดาบขณะบันทึกการถ่ายโอนข้อมูลความผิดพลาดของเคอร์เนล

หมายเหตุ

หลังจากเปิดใช้งานการรวม Kdump บนโฮสต์ที่ทำงานอยู่แล้ว จะต้องติดตั้งใหม่ตามขั้นตอนในคู่มือการดูแลระบบ oVirt -> -> การติดตั้งโฮสต์ใหม่

- คุณสามารถเลือกทำเครื่องหมายในช่องได้ ปิดใช้งานการควบคุมนโยบายการจัดการพลังงานหากเราไม่ต้องการให้การจัดการพลังงานของโฮสต์ถูกควบคุมโดยนโยบายการจัดกำหนดการของคลัสเตอร์

- คลิกปุ่ม (+) เพื่อเพิ่มอุปกรณ์การจัดการพลังงานใหม่ หน้าต่างแก้ไขคุณสมบัติเอเจนต์จะเปิดขึ้น

สำหรับ iDRAC9 ให้กรอกข้อมูลในช่อง:- ที่อยู่ – ที่อยู่ iDRAC9

- ชื่อผู้ใช้รหัสผ่าน – เข้าสู่ระบบและรหัสผ่านสำหรับการเข้าสู่ iDRAC9 ตามลำดับ

- ประเภท —drac5

- เครื่องหมาย ปลอดภัย

- เพิ่มตัวเลือกต่อไปนี้: cmd_prompt=>,login_timeout=30

ภาพหน้าจอพร้อมพารามิเตอร์ "การจัดการพลังงาน" ในคุณสมบัติของโฮสต์

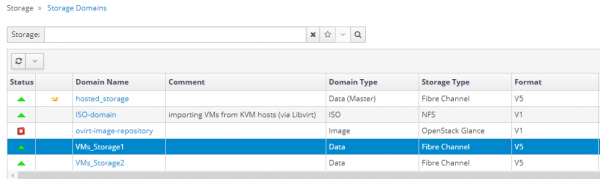

การสร้างพื้นที่จัดเก็บข้อมูลหรือโดเมนการจัดเก็บข้อมูล

ลิงก์ไปยังเอกสารประกอบ - คู่มือการดูแลระบบ oVirt .

โดเมนการจัดเก็บข้อมูลหรือพื้นที่จัดเก็บข้อมูลคือตำแหน่งส่วนกลางสำหรับจัดเก็บดิสก์เครื่องเสมือน อิมเมจการติดตั้ง เทมเพลต และสแน็ปช็อต

พื้นที่จัดเก็บข้อมูลสามารถเชื่อมต่อกับศูนย์ข้อมูลได้โดยใช้โปรโตคอล คลัสเตอร์ และระบบไฟล์เครือข่ายที่หลากหลาย

oVirt มีพื้นที่จัดเก็บข้อมูลสามประเภท:

- โดเมนข้อมูล – เพื่อจัดเก็บข้อมูลทั้งหมดที่เกี่ยวข้องกับเครื่องเสมือน (ดิสก์ เทมเพลต) โดเมนข้อมูลไม่สามารถใช้ร่วมกันระหว่างศูนย์ข้อมูลที่แตกต่างกัน

- โดเมน ISO (พื้นที่เก็บข้อมูลประเภทล้าสมัย) - สำหรับจัดเก็บอิมเมจการติดตั้งระบบปฏิบัติการ สามารถแชร์โดเมน ISO ระหว่างศูนย์ข้อมูลต่างๆ ได้

- ส่งออกโดเมน (พื้นที่จัดเก็บข้อมูลประเภทล้าสมัย) – สำหรับการจัดเก็บรูปภาพชั่วคราวที่ย้ายระหว่างศูนย์ข้อมูล

ในกรณีเฉพาะของเรา พื้นที่จัดเก็บข้อมูลที่มีประเภทโดเมนข้อมูลจะใช้ Fibre Channel Protocol (FCP) เพื่อเชื่อมต่อกับ LUN บนระบบจัดเก็บข้อมูล

จากมุมมองของ oVirt เมื่อใช้ระบบจัดเก็บข้อมูล (FC หรือ iSCSI) แต่ละดิสก์เสมือน สแน็ปช็อต หรือเทมเพลตจะเป็นดิสก์แบบลอจิคัล

อุปกรณ์บล็อกจะถูกประกอบเป็นหน่วยเดียว (บนโฮสต์คลัสเตอร์) โดยใช้ Volume Group จากนั้นแบ่งโดยใช้ LVM ออกเป็นโลจิคัลวอลุ่ม ซึ่งใช้เป็นดิสก์เสมือนสำหรับ VM

กลุ่มทั้งหมดเหล่านี้และวอลุ่ม LVM จำนวนมากสามารถเห็นได้บนโฮสต์คลัสเตอร์โดยใช้คำสั่ง ฯลฯ и เลเวล. โดยปกติแล้ว การดำเนินการทั้งหมดกับดิสก์ดังกล่าวควรทำจากคอนโซล oVirt เท่านั้น ยกเว้นในกรณีพิเศษ

ดิสก์เสมือนสำหรับ VM สามารถมีได้สองประเภท - QCOW2 หรือ RAW แผ่นดิสก์อาจเป็น "บาง" หรือ "หนา" สแนปชอตจะถูกสร้างขึ้นเสมอเป็น "บาง".

วิธีการจัดการโดเมนพื้นที่เก็บข้อมูลหรือพื้นที่จัดเก็บข้อมูลที่เข้าถึงผ่าน FC นั้นค่อนข้างสมเหตุสมผล - สำหรับดิสก์เสมือน VM แต่ละดิสก์จะมีโลจิคัลวอลุ่มแยกต่างหากที่สามารถเขียนได้โดยโฮสต์เดียวเท่านั้น สำหรับการเชื่อมต่อ FC นั้น oVirt จะใช้บางอย่างเช่น LVM แบบคลัสเตอร์

เครื่องเสมือนที่อยู่ในพื้นที่จัดเก็บข้อมูลเดียวกันสามารถย้ายระหว่างโฮสต์ที่อยู่ในคลัสเตอร์เดียวกันได้

ดังที่เราเห็นจากคำอธิบาย คลัสเตอร์ใน oVirt เช่นคลัสเตอร์ใน VMware vSphere หรือ Hyper-V มีความหมายเดียวกันโดยพื้นฐาน - เป็นการจัดกลุ่มโฮสต์เชิงตรรกะ โดยเฉพาะอย่างยิ่งจะเหมือนกันในองค์ประกอบฮาร์ดแวร์ และมีพื้นที่เก็บข้อมูลทั่วไปสำหรับเสมือน ดิสก์เครื่อง

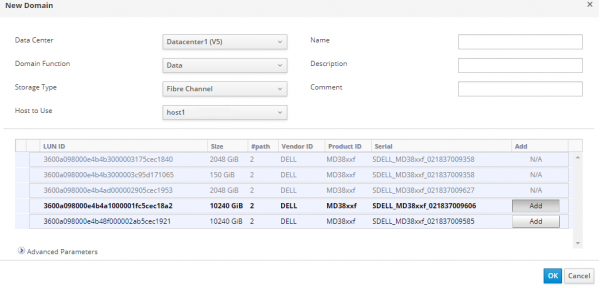

มาเริ่มสร้างพื้นที่จัดเก็บข้อมูล (ดิสก์ VM) โดยตรงเลย เนื่องจากหากไม่มีพื้นที่ดังกล่าว ศูนย์ข้อมูลก็จะไม่สามารถเริ่มต้นได้

ฉันขอเตือนคุณว่า LUN ทั้งหมดที่แสดงต่อโฮสต์คลัสเตอร์บนระบบจัดเก็บข้อมูลจะต้องมองเห็นได้โดยใช้คำสั่ง “หลายเส้นทาง -ll'

ตามที่ ไปที่พอร์ทัลไปที่ พื้นที่จัดเก็บ >> โดเมน -> โดเมนใหม่ และปฏิบัติตามคำแนะนำจากส่วน "การเพิ่มที่เก็บข้อมูล FCP"

หลังจากเปิดตัววิซาร์ดแล้ว ให้กรอกข้อมูลในช่องที่จำเป็น:

- ชื่อ — ตั้งชื่อคลัสเตอร์

- ฟังก์ชั่นโดเมน -ข้อมูล

- ประเภทพื้นที่เก็บข้อมูล - ไฟเบอร์แชนแนล

- โฮสต์ที่จะใช้ — เลือกโฮสต์ที่ LUN ที่เราต้องการพร้อมใช้งาน

ในรายการ LUN ทำเครื่องหมายรายการที่เราต้องการคลิก เพิ่ม แล้ว ตกลง. หากจำเป็น คุณสามารถปรับพารามิเตอร์เพิ่มเติมของพื้นที่จัดเก็บข้อมูลได้โดยคลิกที่ พารามิเตอร์ขั้นสูง.

ภาพหน้าจอของวิซาร์ดสำหรับการเพิ่ม “โดเมนที่เก็บข้อมูล”

จากผลลัพธ์ของตัวช่วยสร้าง เราควรได้รับพื้นที่จัดเก็บข้อมูลใหม่และศูนย์ข้อมูลของเราควรย้ายไปที่สถานะ UPหรือเริ่มต้น:

ภาพหน้าจอของศูนย์ข้อมูลและพื้นที่จัดเก็บข้อมูลภายใน:

การสร้างและกำหนดค่าเครือข่ายสำหรับเครื่องเสมือน

ลิงก์ไปยังเอกสารประกอบ - คู่มือการดูแลระบบ oVirt

เครือข่ายหรือเครือข่าย ทำหน้าที่จัดกลุ่มเครือข่ายลอจิคัลที่ใช้ในโครงสร้างพื้นฐานเสมือน oVirt

Для взаимодействия сетевого адаптера на виртуальной машине, с физическим адаптером на хосте, используются логические интерфейсы типа Linux สะพาน.

ในการจัดกลุ่มและแบ่งการรับส่งข้อมูลระหว่างเครือข่าย VLAN จะได้รับการกำหนดค่าบนสวิตช์

เมื่อสร้างเครือข่ายลอจิคัลสำหรับเครื่องเสมือนใน oVirt จะต้องกำหนดตัวระบุที่สอดคล้องกับหมายเลข VLAN บนสวิตช์ เพื่อให้ VM สามารถสื่อสารระหว่างกัน แม้ว่าจะทำงานบนโหนดที่แตกต่างกันของคลัสเตอร์ก็ตาม

ต้องทำการตั้งค่าอะแดปเตอร์เครือข่ายเบื้องต้นบนโฮสต์สำหรับการเชื่อมต่อเครื่องเสมือน – กำหนดค่าอินเทอร์เฟซแบบลอจิคัลแล้ว bondxnumxจากนั้นการตั้งค่าเครือข่ายทั้งหมดควรทำผ่านพอร์ทัลผู้ดูแลระบบ oVirt เท่านั้น

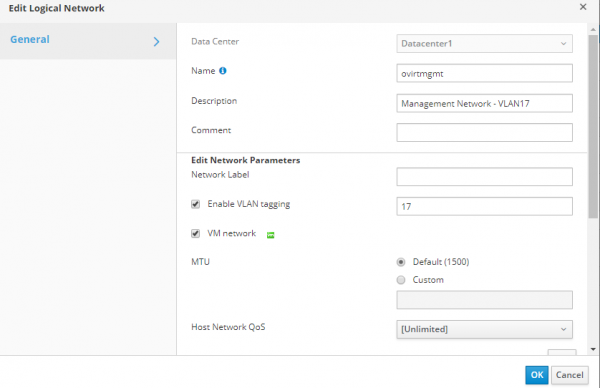

หลังจากสร้าง VM ด้วยโฮสต์เอ็นจิ้น นอกเหนือจากการสร้างศูนย์ข้อมูลและคลัสเตอร์อัตโนมัติแล้ว เครือข่ายลอจิคัลยังถูกสร้างขึ้นโดยอัตโนมัติเพื่อจัดการคลัสเตอร์ของเรา - ไข่ซึ่ง VM นี้เชื่อมต่ออยู่

หากจำเป็น คุณสามารถดูการตั้งค่าเครือข่ายแบบลอจิคัลได้ ไข่ และปรับเปลี่ยน แต่คุณต้องระวังไม่ให้สูญเสียการควบคุมโครงสร้างพื้นฐานของ oVirt

การตั้งค่าเครือข่ายแบบลอจิคัล ovritmgmt

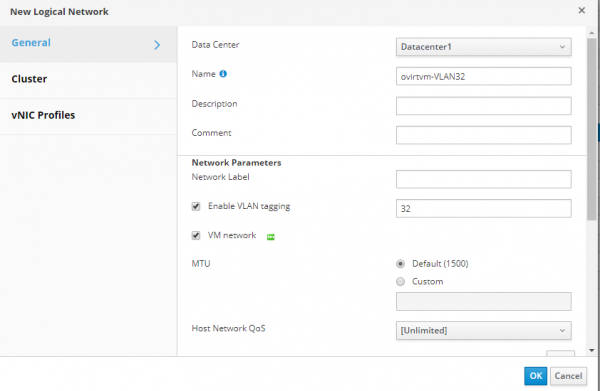

หากต้องการสร้างเครือข่ายลอจิคัลใหม่สำหรับ VM ปกติ ให้ไปที่พอร์ทัลผู้ดูแลระบบ เครือข่าย >> เครือข่าย >> ใหม่และบนแท็บ ทั่วไป เพิ่มเครือข่ายด้วย VLAN ID ที่ต้องการ และทำเครื่องหมายที่ช่องถัดจาก “เครือข่ายวีเอ็ม" ซึ่งหมายความว่าสามารถใช้เพื่อกำหนดให้กับ VM ได้

ภาพหน้าจอของเครือข่ายลอจิคัล VLAN32 ใหม่

ในแท็บ Clusterเราแนบเครือข่ายนี้เข้ากับคลัสเตอร์ของเรา คลัสเตอร์ 1.

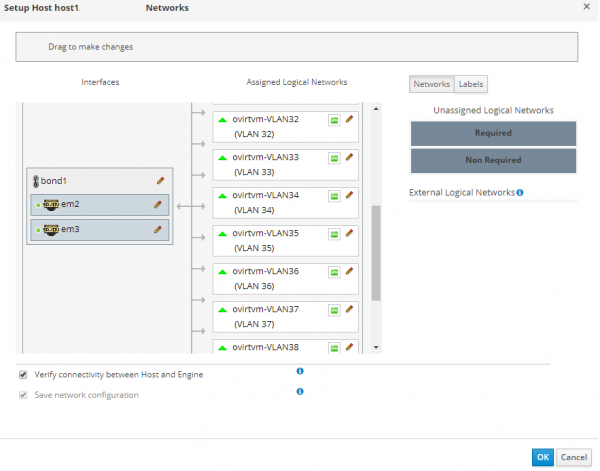

หลังจากนี้เราไปกันที่ คำนวณ >> เจ้าภาพไปที่แต่ละโฮสต์ตามลำดับไปที่แท็บ อินเทอร์เฟซเครือข่ายและเปิดตัวช่วยสร้าง ตั้งค่าเครือข่ายโฮสต์เพื่อเชื่อมโยงกับโฮสต์ของเครือข่ายลอจิคัลใหม่

สกรีนช็อตของวิซาร์ด "ตั้งค่าเครือข่ายโฮสต์"

เอเจนต์ oVirt จะทำการตั้งค่าเครือข่ายที่จำเป็นทั้งหมดบนโฮสต์โดยอัตโนมัติ - สร้าง VLAN และ BRIDGE

ตัวอย่างไฟล์การกำหนดค่าสำหรับเครือข่ายใหม่บนโฮสต์:

cat ifcfg-bond1

# Generated by VDSM version 4.30.17.1

DEVICE=bond1

BONDING_OPTS='mode=1 miimon=100'

MACADDR=00:50:56:82:57:52

ONBOOT=yes

MTU=1500

DEFROUTE=no

NM_CONTROLLED=no

IPV6INIT=no

cat ifcfg-bond1.432

# Generated by VDSM version 4.30.17.1

DEVICE=bond1.432

VLAN=yes

BRIDGE=ovirtvm-vlan432

ONBOOT=yes

MTU=1500

DEFROUTE=no

NM_CONTROLLED=no

IPV6INIT=no

cat ifcfg-ovirtvm-vlan432

# Generated by VDSM version 4.30.17.1

DEVICE=ovirtvm-vlan432

TYPE=Bridge

DELAY=0

STP=off

ONBOOT=yes

MTU=1500

DEFROUTE=no

NM_CONTROLLED=no

IPV6INIT=noฉันขอเตือนคุณอีกครั้งว่าบนโฮสต์คลัสเตอร์ ไม่จำเป็น สร้างอินเทอร์เฟซเครือข่ายด้วยตนเองล่วงหน้า ifcfg-พันธบัตร1.432 и ifcfg-ovirtvm-vlan432.

หลังจากเพิ่มเครือข่ายลอจิคัลและตรวจสอบการเชื่อมต่อระหว่างโฮสต์และ VM เอ็นจิ้นที่โฮสต์แล้ว ก็สามารถใช้งานได้ในเครื่องเสมือน

การสร้างอิมเมจการติดตั้งสำหรับการปรับใช้เครื่องเสมือน

ลิงก์ไปยังเอกสารประกอบ - คู่มือการดูแลระบบ oVirt ส่วนการอัปโหลดรูปภาพไปยังโดเมนจัดเก็บข้อมูล

หากไม่มีอิมเมจการติดตั้งระบบปฏิบัติการ จะไม่สามารถติดตั้งเครื่องเสมือนได้ แม้ว่านี่จะไม่เป็นปัญหาแน่นอนหากติดตั้งบนเครือข่าย ด้วยภาพที่สร้างไว้ล่วงหน้า

ในกรณีของเรา มันเป็นไปไม่ได้ ดังนั้นคุณจะต้องนำเข้าภาพนี้ไปยัง oVirt ด้วยตัวเอง ก่อนหน้านี้ จำเป็นต้องสร้างโดเมน ISO แต่ใน oVirt เวอร์ชันใหม่ได้เลิกใช้แล้ว ดังนั้น ตอนนี้คุณสามารถอัปโหลดรูปภาพไปยังโดเมนพื้นที่จัดเก็บข้อมูลได้โดยตรงจากพอร์ทัลผู้ดูแลระบบ

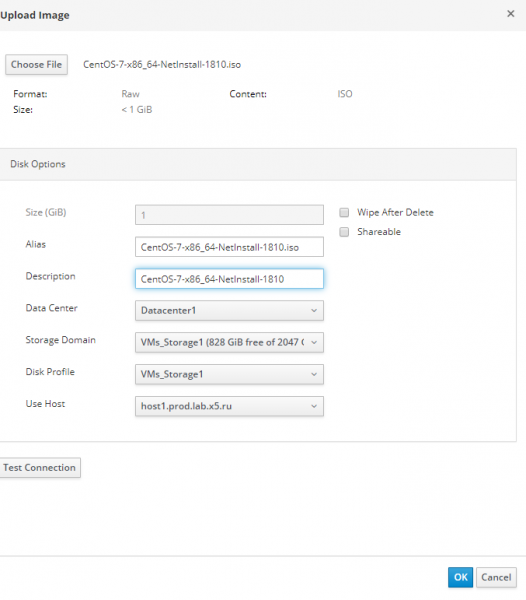

ในพอร์ทัลผู้ดูแลระบบไปที่ พื้นที่จัดเก็บ >> ดิสก์ >> อัพโหลด >> เริ่มต้น

เราเพิ่มอิมเมจระบบปฏิบัติการของเราเป็นไฟล์ ISO กรอกข้อมูลในฟิลด์ทั้งหมดในแบบฟอร์มแล้วคลิกปุ่ม "ทดสอบการเชื่อมต่อ".

สกรีนช็อตของตัวช่วยสร้างการเพิ่มอิมเมจการติดตั้ง

หากเราได้รับข้อผิดพลาดเช่นนี้:

Unable to upload image to disk d6d8fd10-c1e0-4f2d-af15-90f8e636dadc due to a network error. Ensure that ovirt-imageio-proxy service is installed and configured and that ovirt-engine's CA certificate is registered as a trusted CA in the browser. The certificate can be fetched from https://ovirt.test.local/ovirt-engine/services/pki-resource?resource=ca-certificate&format=X509-PEM-CA`

จากนั้นคุณจะต้องเพิ่มใบรับรอง oVirt ไปที่ “CA รูทที่เชื่อถือได้"(Trusted Root CA) บนสถานีควบคุมของผู้ดูแลระบบ จากจุดที่เราพยายามดาวน์โหลดอิมเมจ

หลังจากเพิ่มใบรับรองลงใน Trusted Root CA แล้ว ให้คลิกอีกครั้ง "ทดสอบการเชื่อมต่อ"ควรได้รับ:

Connection to ovirt-imageio-proxy was successful.หลังจากที่คุณดำเนินการเพิ่มใบรับรองเสร็จแล้ว คุณสามารถลองอัปโหลดอิมเมจ ISO ไปยังโดเมนพื้นที่จัดเก็บข้อมูลได้อีกครั้ง

ตามหลักการแล้ว คุณสามารถสร้างโดเมนพื้นที่เก็บข้อมูลแยกต่างหากด้วยประเภทข้อมูลเพื่อจัดเก็บรูปภาพและเทมเพลตแยกจากดิสก์ VM หรือแม้แต่จัดเก็บไว้ในโดเมนพื้นที่เก็บข้อมูลสำหรับกลไกที่โฮสต์ แต่จะขึ้นอยู่กับดุลยพินิจของผู้ดูแลระบบ

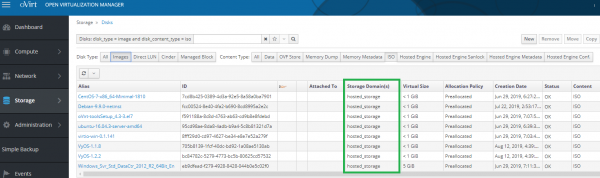

ภาพหน้าจอพร้อมอิมเมจ ISO ในโดเมนการจัดเก็บข้อมูลสำหรับเอ็นจิ้นที่โฮสต์

สร้างเครื่องเสมือน

ลิงค์เอกสาร:

คู่มือการจัดการเครื่องเสมือน oVirt ->

หลังจากโหลดอิมเมจการติดตั้งด้วยระบบปฏิบัติการลงใน oVirt คุณสามารถดำเนินการสร้างเครื่องเสมือนได้โดยตรง มีงานหลายอย่างเกิดขึ้น แต่เราอยู่ในขั้นตอนสุดท้ายแล้ว เพื่อประโยชน์ในการเริ่มต้นทั้งหมดนี้ - การได้รับโครงสร้างพื้นฐานที่ทนทานต่อข้อผิดพลาดสำหรับการโฮสต์เครื่องเสมือนที่มีความพร้อมใช้งานสูง และทั้งหมดนี้ฟรีอย่างแน่นอน ไม่มีการเสียเงินสักบาทเดียวในการซื้อลิขสิทธิ์ซอฟต์แวร์ใดๆ

Для создания виртуальной машины с CentOS 7, должен быть загружен установочный образ с ОС.

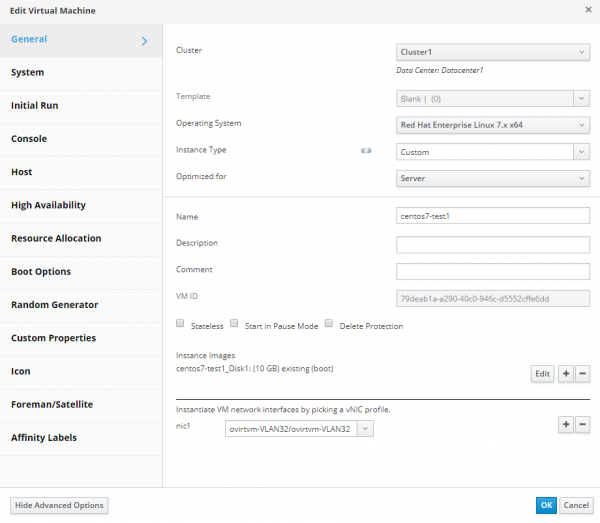

เราไปที่พอร์ทัลผู้ดูแลระบบไปที่ คำนวณ >> เครื่องเสมือนและเปิดตัวช่วยสร้าง VM กรอกพารามิเตอร์และฟิลด์ทั้งหมดแล้วคลิก ตกลง. ทุกอย่างง่ายมากหากคุณปฏิบัติตามเอกสารประกอบ

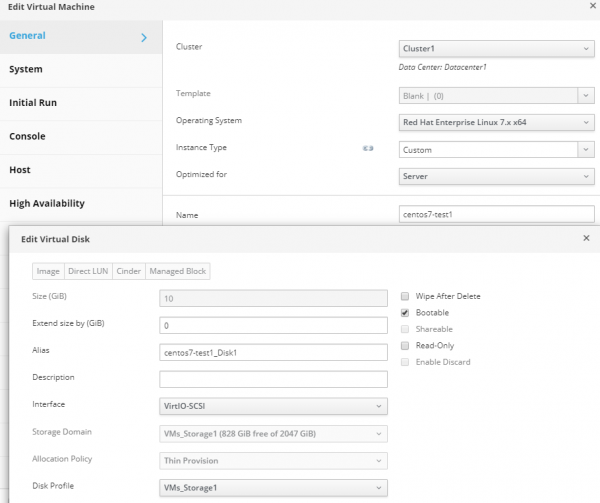

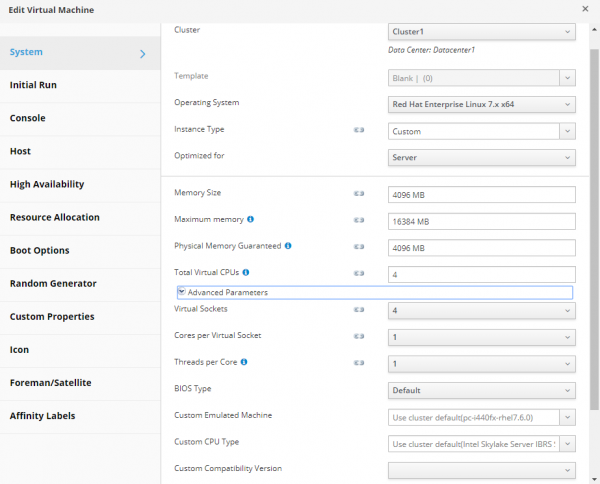

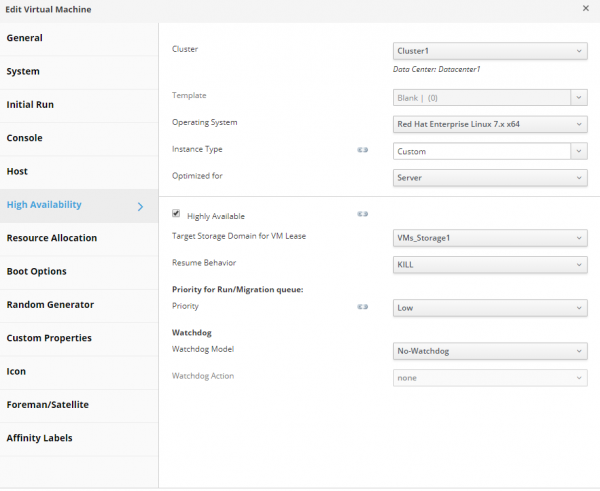

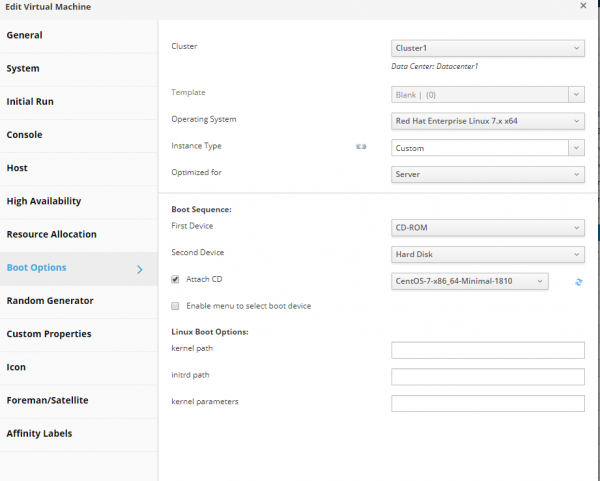

ตามตัวอย่าง ฉันจะให้การตั้งค่าพื้นฐานและการตั้งค่าเพิ่มเติมของ VM ที่พร้อมใช้งานสูง โดยมีดิสก์ที่สร้างขึ้น เชื่อมต่อกับเครือข่าย และการบูตจากอิมเมจการติดตั้ง:

ภาพหน้าจอที่มีการตั้งค่า VM ที่มีความพร้อมใช้งานสูง

หลังจากทำงานกับวิซาร์ดเสร็จแล้ว ให้ปิด เปิด VM ใหม่ และติดตั้งระบบปฏิบัติการลงไป

หากต้องการทำสิ่งนี้ ให้ไปที่คอนโซลของ VM นี้ผ่านพอร์ทัลผู้ดูแลระบบ:

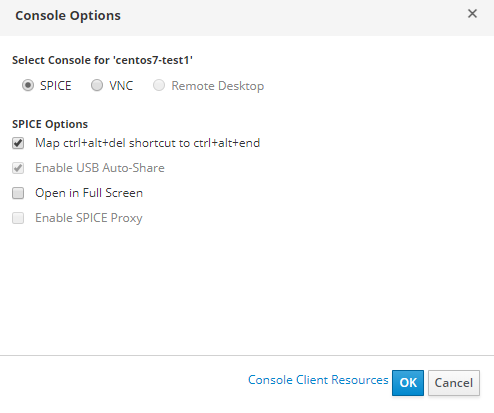

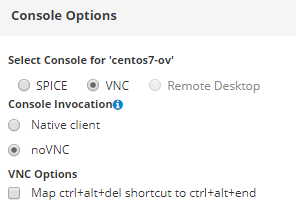

สกรีนช็อตของการตั้งค่าพอร์ทัลการดูแลระบบสำหรับการเชื่อมต่อกับคอนโซล VM

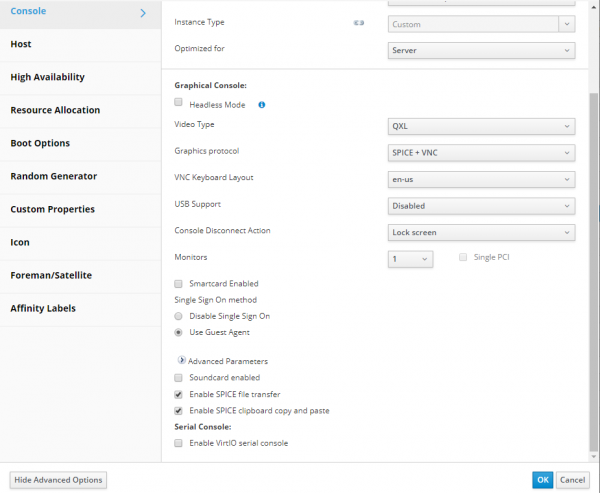

หากต้องการเชื่อมต่อกับคอนโซล VM คุณต้องกำหนดค่าคอนโซลในคุณสมบัติของเครื่องเสมือนก่อน

ภาพหน้าจอของการตั้งค่า VM แท็บ "คอนโซล"

หากต้องการเชื่อมต่อกับคอนโซล VM คุณสามารถใช้ตัวอย่างเช่น .

หากต้องการเชื่อมต่อกับคอนโซล VM โดยตรงในหน้าต่างเบราว์เซอร์ การตั้งค่าการเชื่อมต่อผ่านคอนโซลควรเป็นดังนี้:

หลังจากติดตั้งระบบปฏิบัติการบน VM ขอแนะนำให้ติดตั้ง oVirt guest agent:

yum -y install epel-release

yum install -y ovirt-guest-agent-common

systemctl enable ovirt-guest-agent.service && systemctl restart ovirt-guest-agent.service

systemctl status ovirt-guest-agent.serviceดังนั้นจากการกระทำของเรา VM ที่สร้างขึ้นจะมีความพร้อมใช้งานสูงเช่น หากโหนดคลัสเตอร์ที่รันอยู่ล้มเหลว oVirt จะรีสตาร์ทโดยอัตโนมัติบนโหนดที่สอง VM นี้ยังสามารถย้ายระหว่างโฮสต์คลัสเตอร์เพื่อการบำรุงรักษาหรือวัตถุประสงค์อื่น ๆ

ข้อสรุป

ฉันหวังว่าบทความนี้สามารถสื่อได้ว่า oVirt เป็นเครื่องมือปกติอย่างสมบูรณ์สำหรับการจัดการโครงสร้างพื้นฐานเสมือนซึ่งไม่ยากที่จะปรับใช้ - สิ่งสำคัญคือต้องปฏิบัติตามกฎและข้อกำหนดบางประการที่อธิบายไว้ในบทความและในเอกสารประกอบ

เนื่องจากบทความมีปริมาณมาก จึงไม่สามารถรวมหลายสิ่งไว้ในนั้นได้ เช่น การดำเนินการทีละขั้นตอนของวิซาร์ดต่างๆ พร้อมคำอธิบายและภาพหน้าจอโดยละเอียด การสรุปคำสั่งบางคำสั่งแบบยาว เป็นต้น ในความเป็นจริงสิ่งนี้จะต้องเขียนหนังสือทั้งเล่มซึ่งไม่สมเหตุสมผลมากนักเนื่องจากมีซอฟต์แวร์เวอร์ชันใหม่ปรากฏขึ้นพร้อมกับนวัตกรรมและการเปลี่ยนแปลงอยู่ตลอดเวลา สิ่งที่สำคัญที่สุดคือการเข้าใจหลักการของการทำงานร่วมกันทั้งหมด และเพื่อให้ได้อัลกอริธึมทั่วไปสำหรับการสร้างแพลตฟอร์มที่ทนทานต่อข้อผิดพลาดสำหรับการจัดการเครื่องเสมือน

แม้ว่าเราจะสร้างโครงสร้างพื้นฐานเสมือนจริงแล้ว แต่ตอนนี้เราจำเป็นต้องสอนให้มันโต้ตอบทั้งระหว่างองค์ประกอบแต่ละอย่าง: โฮสต์ เครื่องเสมือน เครือข่ายภายใน และกับโลกภายนอก

กระบวนการนี้เป็นหนึ่งในงานหลักของผู้ดูแลระบบหรือเครือข่ายซึ่งจะกล่าวถึงในบทความถัดไป - เกี่ยวกับการใช้เราเตอร์เสมือน VyOS ในโครงสร้างพื้นฐานที่ทนทานต่อข้อผิดพลาดขององค์กรของเรา (ตามที่คุณเดาพวกเขาจะทำงานเสมือน เครื่องบนคลัสเตอร์ oVirt ของเรา)

ที่มา: will.com