До вашої уваги туториал для генерації доступів до Kubernetes-кластеру за допомогою Dex, dex-k8s-authenticator та GitHub.

Локальний мем з російськомовного чату Kubernetes

Запровадження

Ми використовуємо Kubernetes для створення динамічних оточення команд розробників і QA. Таким чином ми хочемо надати їм доступ до кластера як для дашборду, так і для kubectl. На відміну від того ж OpenShift, ванільний Kubernetes не має нативної автентифікації, тому ми використовуємо для цього сторонні засоби.

У цій конфігурації ми використовуємо:

- — веб-додаток для створення конфігу kubectl

- - провайдер OpenID Connect

- GitHub - просто тому, що ми використовуємо GitHub в нашій компанії

Ми намагалися використовувати Google OIDC, але, на жаль, нам завести їх із групами, тому інтеграція з GitHub нас цілком влаштувала. Без мапінгу груп не вдасться створити RBAC-політики, засновані на групах.

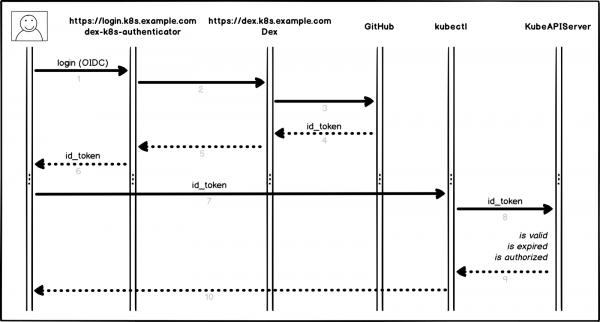

Отже, як працює наш процес авторизації в Kubernetes у візуальному поданні:

Процес авторизації

Трохи докладніше та за пунктами:

- Користувач входить до dex-k8s-authenticator (

login.k8s.example.com) - dex-k8s-authenticator перенаправляє запит у Dex (

dex.k8s.example.com) - Dex перенаправляє на сторінку авторизації в GitHub

- GitHub генерує необхідну інформацію про авторизацію та повертає її в Dex

- Dex передає отриману інформацію в dex-k8s-authenticator

- Користувач отримує OIDC token від GitHub

- dex-k8s-authenticator додає токен у kubeconfig

- kubectl передає токен у KubeAPIServer

- KubeAPIServer на основі переданого токена повертає доступи до kubectl

- Користувач отримує доступи від kubectl

підготовчі дії

Само собою у нас вже встановлено Kubernetes-кластер (k8s.example.com), а також встановлений HELM. Також у нас є організація у GitHub (super-org).

Якщо у вас немає HELM, встановлюється він .

Спершу нам необхідно налаштувати GitHub.

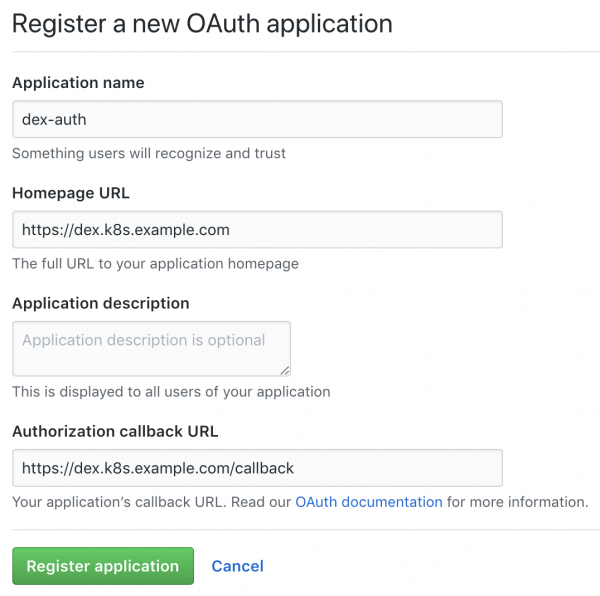

Переходимо на сторінку налаштувань організації, (https://github.com/organizations/super-org/settings/applications) і створюємо новий додаток (Authorized OAuth App):

Створення нової програми в GitHub

Заповнюємо поля необхідними URL, наприклад:

- Homepage URL:

https://dex.k8s.example.com - Authorization callback URL:

https://dex.k8s.example.com/callback

Будьте уважні з посиланнями, важливо не втратити сліші.

У відповідь на заповнену форму, GitHub згенерує Client ID и Client secret, збережіть їх у надійному місці, вони нам знадобляться (ми наприклад використовуємо для зберігання секретів):

Client ID: 1ab2c3d4e5f6g7h8

Client secret: 98z76y54x32w1 Підготуйте DNS-записи для субдоменів login.k8s.example.com и dex.k8s.example.com, а також SSL-сертифікати для інгресів.

Створимо SSL-сертифікати:

cat <<EOF | kubectl create -f -

apiVersion: certmanager.k8s.io/v1alpha1

kind: Certificate

metadata:

name: cert-auth-dex

namespace: kube-system

spec:

secretName: cert-auth-dex

dnsNames:

- dex.k8s.example.com

acme:

config:

- http01:

ingressClass: nginx

domains:

- dex.k8s.example.com

issuerRef:

name: le-clusterissuer

kind: ClusterIssuer

---

apiVersion: certmanager.k8s.io/v1alpha1

kind: Certificate

metadata:

name: cert-auth-login

namespace: kube-system

spec:

secretName: cert-auth-login

dnsNames:

- login.k8s.example.com

acme:

config:

- http01:

ingressClass: nginx

domains:

- login.k8s.example.com

issuerRef:

name: le-clusterissuer

kind: ClusterIssuer

EOF

kubectl describe certificates cert-auth-dex -n kube-system

kubectl describe certificates cert-auth-login -n kube-system ClusterIssuer з назвою le-clusterissuer вже має існувати, якщо ж ні - створимо його за допомогою HELM:

helm install --namespace kube-system -n cert-manager stable/cert-manager

cat << EOF | kubectl create -f -

apiVersion: certmanager.k8s.io/v1alpha1

kind: ClusterIssuer

metadata:

name: le-clusterissuer

namespace: kube-system

spec:

acme:

server: https://acme-v02.api.letsencrypt.org/directory

email: k8s-admin@example.com

privateKeySecretRef:

name: le-clusterissuer

http01: {}

EOFКонфігурація KubeAPIServer

Для роботи kubeAPIServer необхідно налаштувати OIDC і оновити кластер:

kops edit cluster

...

kubeAPIServer:

anonymousAuth: false

authorizationMode: RBAC

oidcClientID: dex-k8s-authenticator

oidcGroupsClaim: groups

oidcIssuerURL: https://dex.k8s.example.com/

oidcUsernameClaim: email

kops update cluster --yes

kops rolling-update cluster --yesМи використовуємо для розгортання кластерів, але це аналогічно працює і для .

Конфігурація Dex та dex-k8s-authenticator

Для роботи Dex необхідно мати сертифікат та ключ з Kubernetes-майстра, який витягне його звідти:

sudo cat /srv/kubernetes/ca.{crt,key}

-----BEGIN CERTIFICATE-----

AAAAAAAAAAABBBBBBBBBBCCCCCC

-----END CERTIFICATE-----

-----BEGIN RSA PRIVATE KEY-----

DDDDDDDDDDDEEEEEEEEEEFFFFFF

-----END RSA PRIVATE KEY-----Схиляємо репозиторій dex-k8s-authenticator:

git clone git@github.com:mintel/dex-k8s-authenticator.git

cd dex-k8s-authenticator/За допомогою values-файлів ми можемо гнучко налаштовувати змінні для наших .

Опишемо конфігурацію для Dex:

cat << EOF > values-dex.yml

global:

deployEnv: prod

tls:

certificate: |-

-----BEGIN CERTIFICATE-----

AAAAAAAAAAABBBBBBBBBBCCCCCC

-----END CERTIFICATE-----

key: |-

-----BEGIN RSA PRIVATE KEY-----

DDDDDDDDDDDEEEEEEEEEEFFFFFF

-----END RSA PRIVATE KEY-----

ingress:

enabled: true

annotations:

kubernetes.io/ingress.class: nginx

kubernetes.io/tls-acme: "true"

path: /

hosts:

- dex.k8s.example.com

tls:

- secretName: cert-auth-dex

hosts:

- dex.k8s.example.com

serviceAccount:

create: true

name: dex-auth-sa

config: |

issuer: https://dex.k8s.example.com/

storage: # https://github.com/dexidp/dex/issues/798

type: sqlite3

config:

file: /var/dex.db

web:

http: 0.0.0.0:5556

frontend:

theme: "coreos"

issuer: "Example Co"

issuerUrl: "https://example.com"

logoUrl: https://example.com/images/logo-250x25.png

expiry:

signingKeys: "6h"

idTokens: "24h"

logger:

level: debug

format: json

oauth2:

responseTypes: ["code", "token", "id_token"]

skipApprovalScreen: true

connectors:

- type: github

id: github

name: GitHub

config:

clientID: $GITHUB_CLIENT_ID

clientSecret: $GITHUB_CLIENT_SECRET

redirectURI: https://dex.k8s.example.com/callback

orgs:

- name: super-org

teams:

- team-red

staticClients:

- id: dex-k8s-authenticator

name: dex-k8s-authenticator

secret: generatedLongRandomPhrase

redirectURIs:

- https://login.k8s.example.com/callback/

envSecrets:

GITHUB_CLIENT_ID: "1ab2c3d4e5f6g7h8"

GITHUB_CLIENT_SECRET: "98z76y54x32w1"

EOF

І для dex-k8s-authenticator:

cat << EOF > values-auth.yml

global:

deployEnv: prod

dexK8sAuthenticator:

clusters:

- name: k8s.example.com

short_description: "k8s cluster"

description: "Kubernetes cluster"

issuer: https://dex.k8s.example.com/

k8s_master_uri: https://api.k8s.example.com

client_id: dex-k8s-authenticator

client_secret: generatedLongRandomPhrase

redirect_uri: https://login.k8s.example.com/callback/

k8s_ca_pem: |

-----BEGIN CERTIFICATE-----

AAAAAAAAAAABBBBBBBBBBCCCCCC

-----END CERTIFICATE-----

ingress:

enabled: true

annotations:

kubernetes.io/ingress.class: nginx

kubernetes.io/tls-acme: "true"

path: /

hosts:

- login.k8s.example.com

tls:

- secretName: cert-auth-login

hosts:

- login.k8s.example.com

EOFВстановимо Dex та dex-k8s-authenticator:

helm install -n dex --namespace kube-system --values values-dex.yml charts/dex

helm install -n dex-auth --namespace kube-system --values values-auth.yml charts/dex-k8s-authenticatorПеревіримо працездатність сервісів (Dex має повернути код 400, а dex-k8s-authenticator - код 200):

curl -sI https://dex.k8s.example.com/callback | head -1

HTTP/2 400

curl -sI https://login.k8s.example.com/ | head -1

HTTP/2 200RBAC-конфігурація

Створюємо ClusterRole для групи, в нашому випадку з read-only доступами:

cat << EOF | kubectl create -f -

apiVersion: rbac.authorization.k8s.io/v1

kind: ClusterRole

metadata:

name: cluster-read-all

rules:

-

apiGroups:

- ""

- apps

- autoscaling

- batch

- extensions

- policy

- rbac.authorization.k8s.io

- storage.k8s.io

resources:

- componentstatuses

- configmaps

- cronjobs

- daemonsets

- deployments

- events

- endpoints

- horizontalpodautoscalers

- ingress

- ingresses

- jobs

- limitranges

- namespaces

- nodes

- pods

- pods/log

- pods/exec

- persistentvolumes

- persistentvolumeclaims

- resourcequotas

- replicasets

- replicationcontrollers

- serviceaccounts

- services

- statefulsets

- storageclasses

- clusterroles

- roles

verbs:

- get

- watch

- list

- nonResourceURLs: ["*"]

verbs:

- get

- watch

- list

- apiGroups: [""]

resources: ["pods/exec"]

verbs: ["create"]

EOFСтворимо конфігурацію для ClusterRoleBinding:

cat <<EOF | kubectl create -f -

apiVersion: rbac.authorization.k8s.io/v1beta1

kind: ClusterRoleBinding

metadata:

name: dex-cluster-auth

namespace: kube-system

roleRef:

apiGroup: rbac.authorization.k8s.io

kind: ClusterRole

name: cluster-read-all

subjects:

kind: Group

name: "super-org:team-red"

EOFНаразі ми готові до тестування.

Тести

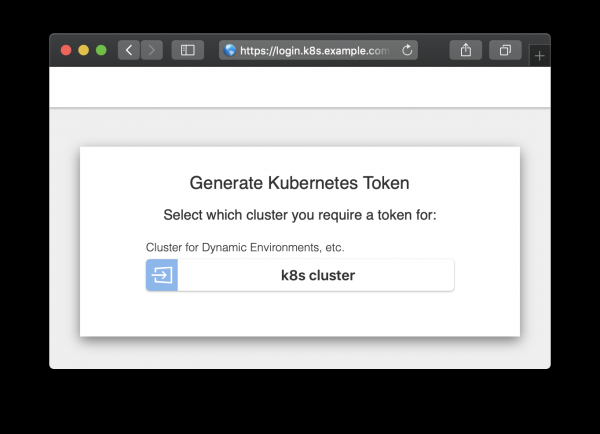

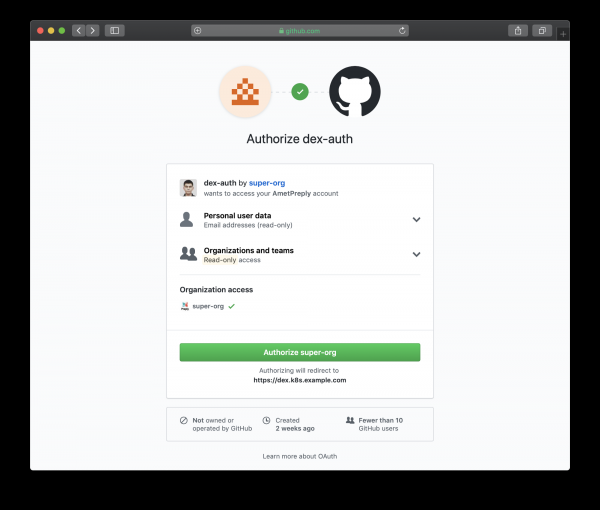

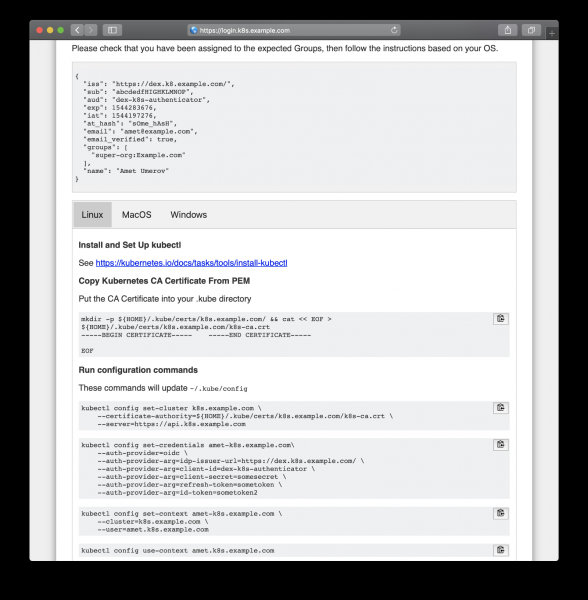

Переходимо на сторінку логіна (https://login.k8s.example.com) і авторизуємося за допомогою GitHub-акаунту:

Сторінка авторизації

Сторінка авторизації перенаправлена на GitHub

Слідуємо згенерованій інструкції для отримання доступів

Після копіпасти з веб-сторінки ми можемо використовувати kubectl для управління ресурсами кластера:

kubectl get po

NAME READY STATUS RESTARTS AGE

mypod 1/1 Running 0 3d

kubectl delete po mypod

Error from server (Forbidden): pods "mypod" is forbidden: User "amet@example.com" cannot delete pods in the namespace "default" І це працює, всі користувачі GitHub у нашій організації можуть бачити ресурси та входити в поди, однак вони не мають прав на їхню зміну.

Джерело: habr.com