Google publikigis novan familion de grandskalaj lingvomodeloj, Gemma 4, bazita sur la modelo Gemini 3. Gemma 4 estas distribuita sub la Apache-licenco en variaĵoj kun 2.3, 4.5, 25.2 kaj 30.7 miliardoj da parametroj (E2B, E4B, 31B kaj 26B A4B). La variaĵoj E2B kaj E4B taŭgas por uzo sur porteblaj aparatoj, Interreto de Aĵoj (IoT) sistemoj kaj Raspberry Pi-similaj platoj, dum la aliaj variaĵoj taŭgas por uzo sur laborstacioj kaj sistemoj kun konsumantaj GPU-oj. La kunteksta grandeco konsiderata de la modelo estas 128 000 ĵetonoj por la modeloj E2B kaj E4B, kaj 256 000 ĵetonoj por la modeloj 31B kaj 26B A4B.

La modeloj estas plurlingvaj kaj multmodalaj: 35 lingvoj estas subtenataj el la skatolo (pli ol 140 lingvoj estis uzitaj dum la trejnado), kaj teksto kaj bildoj povas esti prilaboritaj kiel enigo (la modeloj E2B kaj E4B plie subtenas aŭdio-prilaboradon). La modelo 26B A4B baziĝas sur la arkitekturo Miksaĵo-de-Fakuloj (MoE), en kiu la modelo estas dividita en serion de fakulaj retoj (respondogenerado povas uzi nur 3.8 miliardojn da parametroj, sed la rapideco estas signife pli alta ol tiu de klasikaj grandaj modeloj), dum la aliaj variaĵoj uzas klasikan monolitan arkitekturon.

La modeloj subtenas rezonadon kaj personigeblajn konsideradajn reĝimojn, kaj subtenas Sisteman Rolon por prilabori instrukciojn (regulojn, limojn) aparte de datumoj. La modeloj povas esti uzataj por skribi kodon, rekoni objektojn en bildoj, kadro-post-kadro videanalizo, analizi dokumentojn kaj PDF-ojn, optikan signorekonon (OCR) de presita kaj manskribita teksto, parolrekonon kaj tradukon inter lingvoj. Ili ankaŭ povas esti uzataj kiel sendependaj agentoj interagantaj kun diversaj iloj kaj API-oj.

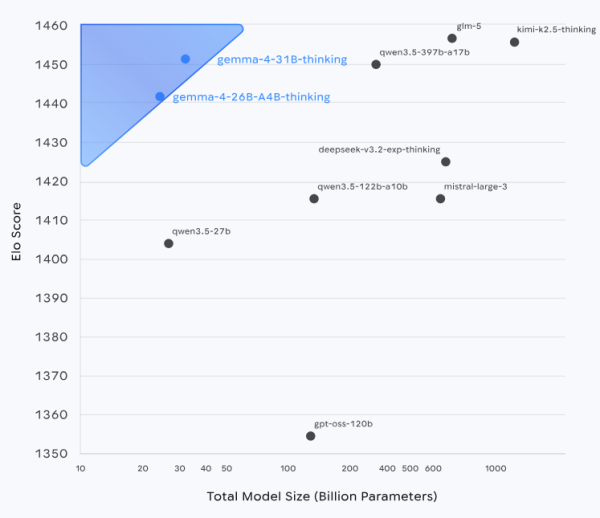

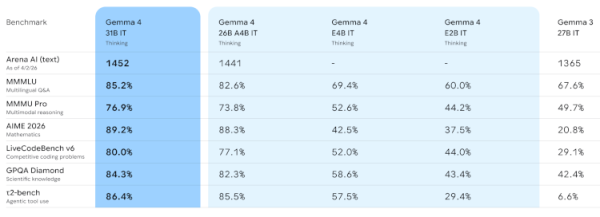

En plej multaj testoj, la modeloj de Gemma 4 signife superis la modelon de Gemma 3 kun 27 miliardoj da parametroj. Gemma 4 subtenas LiteRT-LM, vLLM, llama.cpp, MLX, Ollama, NVIDIA NIM kaj NeMo, LM Studio, Unsloth, SGLang, Cactus, Basetan, MaxText, Tunix kaj Keras.

fonto: opennet.ru