Googleは、Gemini 3モデルをベースにした大規模言語モデルの新しいファミリーであるGemma 4を公開しました。Gemma 4は、2.3億、4.5億、25.2億、30.7億のパラメータを持つバリアント(E2B、E4B、31B、26B A4B)でApacheライセンスの下で配布されています。E2BとE4Bバリアントは、モバイルデバイス、IoTシステム、Raspberry Piのようなボードでの使用に適しており、その他のバリアントはワークステーションやコンシューマー向けGPUを搭載したシステムでの使用に適しています。モデルが考慮するコンテキストサイズは、E2BとE4Bモデルでは12万8000トークン、31Bと26B A4Bモデルでは25万6000トークンです。

これらのモデルは多言語かつマルチモーダルです。35言語がすぐにサポートされ(トレーニング中は140以上の言語が使用されました)、テキストと画像を入力として処理できます(E2BおよびE4Bモデルは音声処理もサポートしています)。26B A4Bモデルは、モデルが一連のエキスパートネットワークに分割されるMixture-of-Experts(MoE)アーキテクチャに基づいています(応答生成には3.8億個のパラメータしか使用できませんが、速度は従来の大型モデルよりも大幅に高速です)。一方、他のバリアントは従来のモノリシックアーキテクチャを使用しています。

これらのモデルは、推論とカスタマイズ可能な審議モードをサポートし、データとは別に命令(ルール、制約)を処理するためのシステムロールもサポートしています。これらのモデルは、コード記述、画像内のオブジェクト認識、フレームごとのビデオ分析、文書やPDFの解析、印刷物や手書き文字の光学文字認識(OCR)、音声認識、言語間の翻訳などに使用できます。また、さまざまなツールやAPIと連携する自律エージェントとしても使用できます。

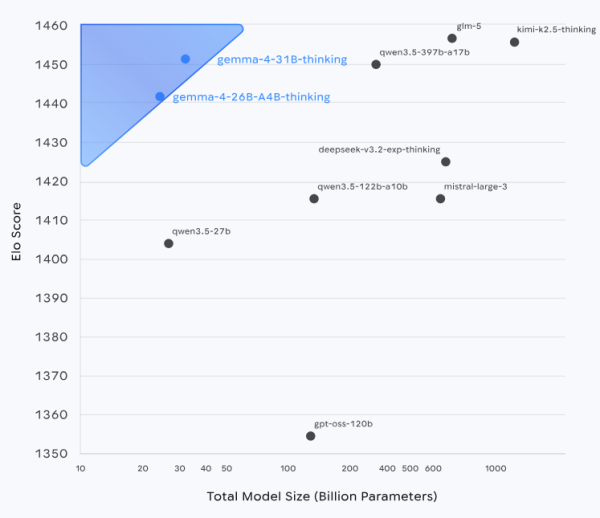

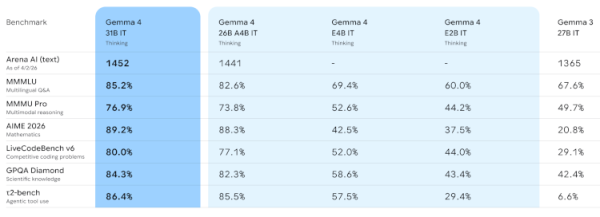

ほとんどのテストにおいて、Gemma 4 モデルは 27 億個のパラメータを持つ Gemma 3 モデルを大幅に上回る性能を示しました。Gemma 4 は、LiteRT-LM、vLLM、llama.cpp、MLX、Ollama、NVIDIA NIM および NeMo、LM Studio、Unsloth、SGLang、Cactus、Basetan、MaxText、Tunix、および Keras をサポートしています。

出所: オープンネット.ru