Оваа статија е продолжение на претходната - “".

Ќе го опфати процесот на основна инсталација и конфигурација на oVirt 4.3 кластер за хостирање на високо достапни виртуелни машини, имајќи го предвид фактот дека сите прелиминарни чекори за подготовка на инфраструктурата се веќе завршени претходно.

Вовед

Главната цел на статијата е да обезбеди чекор-по-чекор инструкции како „Следна -> Да -> Заврши„Како да се прикажат некои функции при инсталирање и конфигурирање. Процесот на распоредување на вашиот кластер можеби не секогаш се совпаѓа со оној опишан во него, поради карактеристиките на инфраструктурата и околината, но општите принципи ќе бидат исти.

Од субјективна гледна точка, неговата функционалност е слична на VMware vSphere верзијата 5.x, но секако со свои карактеристики за конфигурација и работа.

За оние кои се заинтересирани, сите разлики помеѓу RHEV (ака oVirt) и VMware vSphere може да се најдат на Интернет, на пример , но сепак повремено ќе забележам некои од нивните разлики или сличности меѓу себе како што напредува статијата.

Одделно, би сакал малку да ја споредам работата со мрежи за виртуелни машини. oVirt имплементира сличен принцип на управување со мрежата за виртуелни машини (во натамошниот текст како VMs), како во VMware vSphere:

- с помощью стандартного Linux bridge (в VMware — Стандарден vSwitch), работи на хостови за виртуелизација;

- користејќи Open vSwitch (OVS) (во VMware - Дистрибуиран vSwitch) е дистрибуиран виртуелен прекинувач кој се состои од две главни компоненти: централен OVN сервер и OVN контролери на управувани хостови.

Необходимо отметить, что из-за простоты реализации, в статье будет описана настройка сетей в oVirt’е для ВМ с помощью стандартного Linux bridge, который является стандартным выбором, при использовании гипервизора KVM.

Во овој поглед, постојат неколку основни правила за работа со мрежата во кластер, кои најдобро е да не се прекршуваат:

- Сите мрежни поставки на хостовите пред да ги додадете во oVirt мора да бидат идентични, освен IP адресите.

- Откако домаќинот ќе биде ставен под контрола на oVirt, не е препорачливо да менувате ништо рачно во мрежните поставки без целосна доверба во вашите дејства, бидејќи агентот oVirt едноставно ќе ги врати на претходните по рестартирање на домаќинот или агент.

- Додавањето нова мрежа за VM, како и работата со неа, треба да се направи само од конзолата за управување oVirt.

Друга вајное замечание — за многу критична средина (многу чувствителна на парични загуби), сепак би било препорачано да се користи платена поддршка и користење . За време на работата на кластерот oVirt, може да се појават некои прашања за кои е препорачливо да добиете квалификувана помош што е можно поскоро, наместо сами да се справувате со нив.

И, конечно се препорачува Пред да распоредите oVirt кластер, запознајте се со , за да бидете свесни барем за основните поими и дефиниции, во спротивно ќе биде малку тешко да го прочитате остатокот од статијата.

Основни за разбирање на статијата и принципите на работа на кластерот oVirt се овие упатства:

Волуменот таму не е многу голем, за час или два можете сосема да ги совладате основните принципи, но за оние кои сакаат детали, се препорачува да прочитаат - RHEV и oVirt се во суштина иста работа.

Значи, ако сите основни поставки на хостовите, прекинувачите и системите за складирање се завршени, продолжуваме директно до распоредувањето на oVirt.

Дел 2. Инсталирање и конфигурирање на кластерот oVirt 4.3

За полесно ориентација, ќе ги наведам главните делови во оваа статија, кои мора да се пополнат еден по еден:

- Инсталирање на серверот за управување со oVirt

- Креирање на нов центар за податоци

- Создавање нов кластер

- Инсталирање дополнителни хостови во околина со самодомаќин

- Создавање простор за складирање или домени за складирање

- Креирање и конфигурирање на мрежи за виртуелни машини

- Создавање слика за инсталација за распоредување на виртуелна машина

- Направете виртуелна машина

Инсталирање на серверот за управување со oVirt

Сервер за управување со oVirt - ова е најважниот елемент во oVirt инфраструктурата, во форма на виртуелна машина, домаќин или виртуелен уред кој управува со целата oVirt инфраструктура.

Неговите блиски аналози од светот на виртуелизацијата се:

- VMware vSphere - сервер vCenter

- Microsoft Hyper-V - Управувач со виртуелна машина на системски центар (VMM).

За да го инсталирате серверот за управување со oVirt, имаме две опции:

Опција 1

Распоредување на сервер во форма на специјализиран VM или домаќин.

Оваа опција работи доста добро, но под услов таков VM да работи независно од кластерот, т.е. не работи на ниту еден кластер хост како обична виртуелна машина што работи на KVM.

Зошто таков VM не може да се распореди на кластер-домаќини?

В самом начале процесса развёртывания управляющего сервера oVirt, у нас имеется дилемма — управляющую ВМ ставить нужно, но самого кластера фактически ещё нет, и поэтому что можно с ходу придумать? Правильно – установить KVM на будущий узел кластера, далее на нём создать виртуальную машину, например, с ОС CentOS и в ней развернуть oVirt engine. Это может делаться обычно из соображений полного контроля над такой ВМ, но это ошибочное намерение, потому что в таком случае, в дальнейшем 100% будут проблемы с такой управляющей ВМ:

- не може да се мигрира во конзолата oVirt помеѓу хостовите (јазлите) на кластерот;

- кога мигрирате користејќи KVM преку вирш мигрираат, овој VM нема да биде достапен за управување од конзолата oVirt.

- хостовите на кластерот не може да се прикажат во Режим за одржување (режим на одржување), ако го префрлите овој VM од домаќин на домаќин користејќи го вирш мигрираат.

Затоа, правете сè според правилата - користете или посебен хост за серверот за управување со oVirt, или независен VM што работи на него, или уште подобро, направете како што е напишано во втората опција.

Опција 2

Инсталирање на oVirt Engine Appliance на кластер домаќин управуван од него.

Токму оваа опција ќе се смета понатаму како поточна и посоодветна во нашиот случај.

Барањата за таков VM се опишани подолу, само ќе додадам дека се препорачува да има најмалку два домаќини во инфраструктурата на кои може да се работи контролната VM за да се направи толерантна за грешки. Овде би сакал да додадам дека, како што веќе напишав во коментарите во претходната статија, никогаш не успеав да добијам поделен мозок на oVirt кластер од два хостови, со можност да се извршуваат VM со хостиран мотор на нив.

Инсталирање на oVirt Engine Appliance на првиот домаќин од кластерот

Линк до официјална документација - , поглавје "»

Документот ги специфицира предусловите што мора да се исполнат пред да се имплементира VM со хостиран мотор, а исто така детално го опишува самиот процес на инсталација, така што нема смисла да се повторува дословно, па затоа ќе се фокусираме на некои важни детали.

- Пред да започнете со сите дејства, не заборавајте да ја овозможите поддршката за виртуелизација во поставките на BIOS-от на домаќинот.

- Инсталирајте го пакетот за инсталаторот со хостиран мотор на домаќинот:

yum -y install http://resources.ovirt.org/pub/yum-repo/ovirt-release43.rpm

yum -y install epel-release

yum install screen ovirt-hosted-engine-setup- Ја започнуваме процедурата за распоредување на oVirt Hosted Engine на екранот на домаќинот (можете да излезете од него преку Ctrl-A + D, затворете преку Ctrl-D):

screen

hosted-engine --deployДоколку сакате, можете да ја извршите инсталацијата со претходно подготвена датотека со одговори:

hosted-engine --deploy --config-append=/var/lib/ovirt-hosted-engine-setup/answers/answers-ohe.conf- При распоредување на хостиран мотор, ги специфицираме сите потребни параметри:

- имя кластера

- количество vCPU и vRAM (рекомендуется 4 vCPU и 16 Гб)

- пароли

- тип хранилища для hosted engine ВМ – в нашем случае FC

- номер LUN для установки hosted engine

- где будет находиться база данных для hosted engine – рекомендую для простоты выбрать Local (это БД PostgreSQL работающая внутри этой ВМ)

и др. параметры. - За да инсталираме високо достапен VM со хостиран мотор, претходно создадовме специјален LUN на системот за складирање, број 4 и големина од 150 GB, кој потоа беше претставен на домаќините на кластерот - видете .

Претходно ја проверивме и неговата видливост на домаќините:

multipath -ll

…

3600a098000e4b4b3000003c95d171065 dm-3 DELL , MD38xxf

size=150G features='3 queue_if_no_path pg_init_retries 50' hwhandler='1 rdac' wp=rw

|-+- policy='service-time 0' prio=14 status=active

| `- 15:0:0:4 sdc 8:32 active ready running

`-+- policy='service-time 0' prio=9 status=enabled

`- 18:0:0:4 sdj 8:144 active ready running- Самиот процес на распоредување на хостиран мотор не е комплициран на крајот треба да добиеме нешто како ова:

[ INFO ] Generating answer file '/var/lib/ovirt-hosted-engine-setup/answers/answers-20191129131846.conf'

[ INFO ] Generating answer file '/etc/ovirt-hosted-engine/answers.conf'

[ INFO ] Stage: Pre-termination

[ INFO ] Stage: Termination

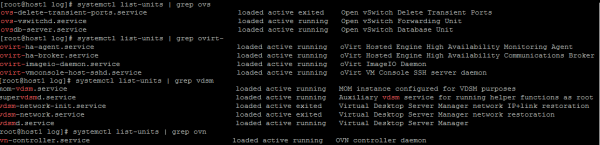

[ INFO ] Hosted Engine successfully deployedГо проверуваме присуството на услугите oVirt на домаќинот:

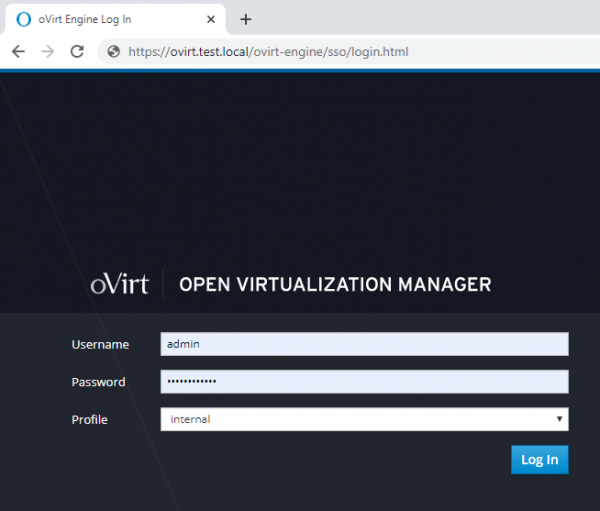

Ако сè е направено правилно, тогаш откако ќе заврши инсталацијата, користете веб-прелистувач за да отидете од компјутерот на администраторот и кликнете [Административен портал].

Слика од екранот на „Административен портал“

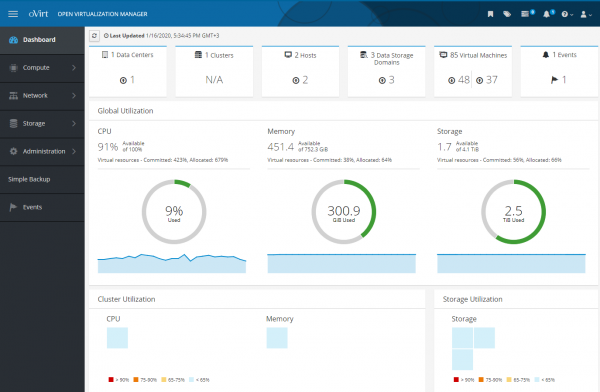

Со внесување на најавување и лозинка (поставени за време на процесот на инсталација) во прозорецот како на сликата од екранот, доаѓаме до контролната табла на Open Virtualization Manager, во која можете да ги извршите сите дејства со виртуелната инфраструктура:

- додадете центар за податоци

- додадете и конфигурирајте кластер

- додадете и управувајте со хостови

- додадете области за складирање или домени за складирање за дискови на виртуелна машина

- додадете и конфигурирајте мрежи за виртуелни машини

- додавање и управување со виртуелни машини, слики за инсталација, шаблони за VM

Сите овие дејства ќе се дискутираат понатаму, некои во големи ќелии, други подетално и со нијанси.

Но, прво би препорачал да го прочитате овој додаток, кој веројатно ќе биде корисен за многумина.

Покрај тоа

1) Во принцип, ако има таква потреба, тогаш ништо не ве спречува однапред да го инсталирате хипервизорот KVM на јазлите на кластерот користејќи пакети libvirt и ќему-квм (Или ќему-квм-ев) на саканата верзија, иако при распоредување на јазол на кластерот oVirt, тоа може да го направи самиот.

Но, ако libvirt и ќему-квм Ако не сте ја инсталирале најновата верзија, може да ја добиете следнава грешка при распоредување на хостиран мотор:

error: unsupported configuration: unknown CPU feature: md-clearОние. мора да има libvirt со заштита од , што ја поддржува оваа политика:

<feature policy='require' name='md-clear'/>Инсталирајте libvirt v.4.5.0-10.el7_6.12, со поддршка за md-clear:

yum-config-manager --disable mirror.centos.org_centos-7_7_virt_x86_64_libvirt-latest_

yum install centos-release-qemu-ev

yum update

yum install qemu-kvm qemu-img virt-manager libvirt libvirt-python libvirt-client virt-install virt-viewer libguestfs libguestfs-tools dejavu-lgc-sans-fonts virt-top libvirt libvirt-python libvirt-client

systemctl enable libvirtd

systemctl restart libvirtd && systemctl status libvirtdПроверете дали има поддршка за 'md-clear':

virsh domcapabilities kvm | grep require

<feature policy='require' name='ss'/>

<feature policy='require' name='hypervisor'/>

<feature policy='require' name='tsc_adjust'/>

<feature policy='require' name='clflushopt'/>

<feature policy='require' name='pku'/>

<feature policy='require' name='md-clear'/>

<feature policy='require' name='stibp'/>

<feature policy='require' name='ssbd'/>

<feature policy='require' name='invtsc'/>По ова, можете да продолжите со инсталирање на хостираниот мотор.

2) Во oVirt 4.3, присуството и употребата на заштитен ѕид firewalld е задолжително барање.

Ако за време на распоредувањето на VM за хостиран мотор ја добиеме следнава грешка:

[ ERROR ] fatal: [localhost]: FAILED! => {"changed": false, "msg": "firewalld is required to be enabled and active in order to correctly deploy hosted-engine. Please check, fix accordingly and re-deploy.n"}

[ ERROR ] Failed to execute stage 'Closing up': Failed executing ansible-playbook

[https://bugzilla.redhat.com/show_bug.cgi?id=1608467Потоа треба да исклучите друг заштитен ѕид (ако се користи) и да го инсталирате и стартувате firewalld:

yum install firewalld

systemctl enable firewalld

systemctl start firewalld

firewall-cmd --state

firewall-cmd --get-default-zone

firewall-cmd --get-active-zones

firewall-cmd --get-zonesПодоцна, при инсталирање на ovirt агентот на нов домаќин за кластерот, тој ќе ги конфигурира потребните порти во firewalld автоматски.

3) Рестартирање на домаќин со VM што работи на него со вграден мотор.

Како и обично, и на владејачките документи.

Целото управување со хостираниот мотор VM се врши САМО со помош на командата хостиран-мотор на домаќинот каде што работи, околу вирш мора да заборавиме, како и фактот дека можете да се поврзете со овој VM преку SSH и да ја извршите командата „исклучување".

Постапка за ставање на VM во режим на одржување:

hosted-engine --set-maintenance --mode=global

hosted-engine --vm-status

!! Cluster is in GLOBAL MAINTENANCE mode !!

--== Host host1.test.local (id: 1) status ==--

conf_on_shared_storage : True

Status up-to-date : True

Hostname : host1.test.local

Host ID : 1

Engine status : {"health": "good", "vm": "up", "detail": "Up"}

Score : 3400

stopped : False

Local maintenance : False

crc32 : dee1a774

local_conf_timestamp : 1821

Host timestamp : 1821

Extra metadata (valid at timestamp):

metadata_parse_version=1

metadata_feature_version=1

timestamp=1821 (Sat Nov 29 14:25:19 2019)

host-id=1

score=3400

vm_conf_refresh_time=1821 (Sat Nov 29 14:25:19 2019)

conf_on_shared_storage=True

maintenance=False

state=GlobalMaintenance

stopped=False

hosted-engine --vm-shutdownГо рестартираме домаќинот со хостираниот агент на моторот и го правиме она што ни треба со него.

По рестартирањето, проверете го статусот на VM со хостираниот мотор:

hosted-engine --vm-statusАко нашиот VM со хостиран мотор не стартува и ако видиме слични грешки во дневникот за услуги:

Грешка во дневникот за услуги:

journalctl -u ovirt-ha-agent

...

Jun 29 14:34:44 host1 journal: ovirt-ha-agent ovirt_hosted_engine_ha.agent.hosted_engine.HostedEngine ERROR Failed to start necessary monitors

Jun 29 14:34:44 host1 journal: ovirt-ha-agent ovirt_hosted_engine_ha.agent.agent.Agent ERROR Traceback (most recent call last):#012 File "/usr/lib/python2.7/site-packages/ovirt_hosted_engine_ha/agent/agent.py", line 131, in _run_agent#012 return action(he)#012 File "/usr/lib/python2.7/site-packages/ovirt_hosted_engine_ha/agent/agent.py", line 55, in action_proper#012 return he.start_monitoring()#012 File "/usr/lib/python2.7/site-packages/ovirt_hosted_engine_ha/agent/hosted_engine.py", line 413, in start_monitoring#012 self._initialize_broker()#012 File "/usr/lib/python2.7/site-packages/ovirt_hosted_engine_ha/agent/hosted_engine.py", line 537, in _initialize_broker#012 m.get('options', {}))#012 File "/usr/lib/python2.7/site-packages/ovirt_hosted_engine_ha/lib/brokerlink.py", line 86, in start_monitor#012 ).format(t=type, o=options, e=e)#012RequestError: brokerlink - failed to start monitor via ovirt-ha-broker: [Errno 2] No such file or directory, [monitor: 'ping', options: {'addr': '172.20.32.32'}]

Jun 29 14:34:44 host1 journal: ovirt-ha-agent ovirt_hosted_engine_ha.agent.agent.Agent ERROR Trying to restart agentПотоа го поврзуваме складиштето и го рестартираме агентот:

hosted-engine --connect-storage

systemctl restart ovirt-ha-agent

systemctl status ovirt-ha-agent

hosted-engine --vm-start

hosted-engine --vm-statusОткако ќе го вклучиме VM со хостиран мотор, го вадиме од режимот на одржување:

Постапка за отстранување на VM од режим на одржување:

hosted-engine --check-liveliness

hosted-engine --set-maintenance --mode=none

hosted-engine --vm-status

--== Host host1.test.local (id: 1) status ==--

conf_on_shared_storage : True

Status up-to-date : True

Hostname : host1.test.local

Host ID : 1

Engine status : {"health": "good", "vm": "up", "detail": "Up"}

Score : 3400

stopped : False

Local maintenance : False

crc32 : 6d1eb25f

local_conf_timestamp : 6222296

Host timestamp : 6222296

Extra metadata (valid at timestamp):

metadata_parse_version=1

metadata_feature_version=1

timestamp=6222296 (Fri Jan 17 11:40:43 2020)

host-id=1

score=3400

vm_conf_refresh_time=6222296 (Fri Jan 17 11:40:43 2020)

conf_on_shared_storage=True

maintenance=False

state=EngineUp

stopped=False4) Отстранување на хостираниот мотор и сè што е поврзано со него.

Понекогаш е неопходно правилно да се отстрани претходно инсталираниот хостиран мотор - до упатството.

Само извршете ја командата на домаќинот:

/usr/sbin/ovirt-hosted-engine-cleanupСледно, ги отстрануваме непотребните пакети, правејќи резервна копија на некои конфигурации пред ова, доколку е потребно:

yum autoremove ovirt* qemu* virt* libvirt* libguestfs Креирање на нов центар за податоци

Референтна документација - Водич за администрација на oVirt.

Прво да дефинираме што е тоа на Центарот за податоци (цитирам од помошта) е логичен ентитет кој дефинира збир на ресурси кои се користат во одредена средина.

Центарот за податоци е еден вид контејнер кој се состои од:

- логички ресурси во форма на кластери и хостови

- кластер мрежни ресурси во форма на логички мрежи и физички адаптери на домаќините,

- ресурси за складирање (за VM дискови, шаблони, слики) во форма на области за складирање (Storage Domains).

Центарот за податоци може да вклучува повеќе кластери кои се состојат од повеќе хостови со виртуелни машини кои работат на нив, а исто така може да има и повеќе области за складирање поврзани со него.

Може да има неколку центри за податоци, тие работат независно еден од друг. Ovirt има поделба на овластувањата по улоги и можете да ги конфигурирате дозволите поединечно, и на ниво на центарот за податоци и на неговите поединечни логички елементи.

Центарот за податоци, или центрите за податоци, ако има неколку од нив, се управуваат од една административна конзола или портал.

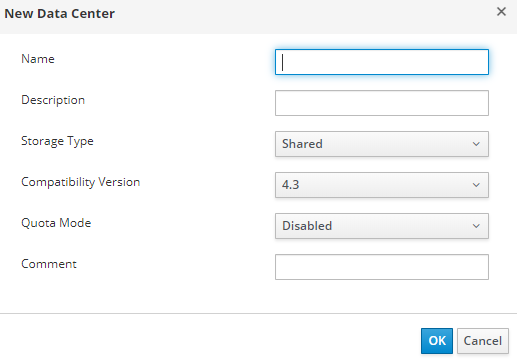

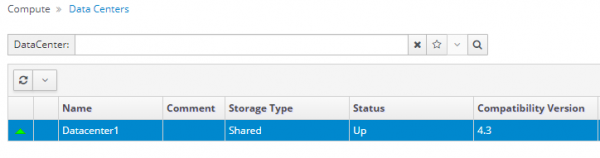

За да креирате центар за податоци, одете на административниот портал и креирајте нов центар за податоци:

Пресмета >> Центри за податоци >> Ново

Бидејќи користиме заедничко складирање на системот за складирање, типот на складирање треба да биде споделен:

Слика од екранот на Волшебникот за создавање центар за податоци

Кога инсталирате виртуелна машина со хостиран мотор, стандардно се создава центар за податоци - Центар за податоци 1, а потоа, доколку е потребно, можете да го промените неговиот тип на складирање во друг.

Создавањето центар за податоци е едноставна задача, без никакви незгодни нијанси, а сите дополнителни активности со него се опишани во документацијата. Единственото нешто што ќе забележам е дека единечните хостови кои имаат само локално складирање (диск) за VM нема да можат да влезат во центар за податоци со тип на складирање - споделено (тие не можат да се додадат таму), а за нив треба да креирате посебен центар за податоци - т.е. Секој поединечен домаќин со локално складирање има потреба од свој посебен центар за податоци.

Создавање нов кластер

Врска до документација - Водич за администрација на oVirt.

Без непотребни детали, Грозд – ова е логично групирање на хостови кои имаат заедничка област за складирање (во форма на споделени дискови на систем за складирање, како во нашиот случај). Исто така, пожелно е хостовите во кластерот да бидат идентични по хардвер и да имаат ист тип на процесор (Intel или AMD). Најдобро е, се разбира, серверите во кластерот да бидат целосно идентични.

Кластерот е дел од центарот за податоци (со специфичен тип на складирање - Локалните или Дели), и сите хостови мора да припаѓаат на некој вид кластер, во зависност од тоа дали имаат споделено складирање или не.

Кога инсталирате виртуелна машина со хостиран мотор на домаќин, стандардно се создава центар за податоци - Центар за податоци 1, заедно со кластерот - Кластер1, и во иднина можете да ги конфигурирате неговите параметри, да овозможите дополнителни опции, да додавате хостови на него итн.

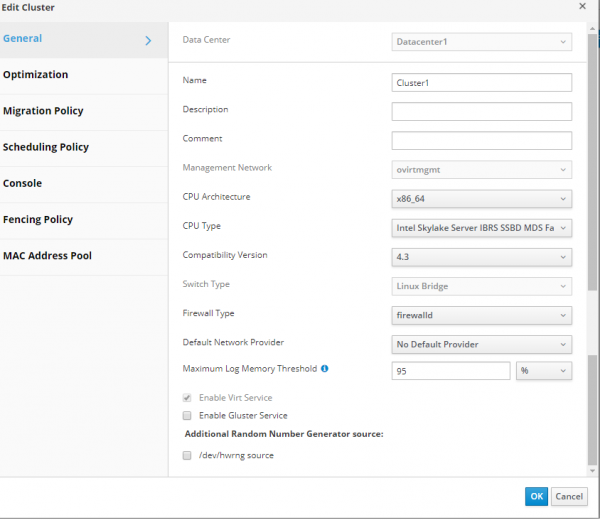

Како и обично, за детали за сите поставки на кластерот, препорачливо е да се повикате на официјалната документација. Од некои од карактеристиките на поставување кластер, само ќе додадам дека при неговото креирање, доволно е да ги конфигурирате само основните параметри на јазичето Генерално.

Ќе ги забележам најважните параметри:

- Тип на процесор — се избира врз основа на тоа кои процесори се инсталирани на хостовите на кластерот, од кој производител се и кој процесор на хостовите е најстар, така што, во зависност од тоа, се користат сите достапни инструкции за процесори во кластерот.

- Тип на прекинувач – у нас в кластере используется только Linux bridge, поэтому его и выбираем.

- Тип на заштитен ѕид – сè е јасно овде, ова е заштитен ѕид, кој мора да биде овозможен и конфигуриран на хостовите.

Слика од екранот со параметри на кластерот

Инсталирање дополнителни хостови во околина со самодомаќин

за документација.

Дополнителни хостови за опкружување со самодомаќин се додаваат на ист начин како и обичен домаќин, со дополнителен чекор за распоредување на VM со хостиран мотор - Изберете акција за распоредување на хостиран мотор >> распореди. Бидејќи дополнителниот хост мора да биде претставен и со LUN за VM со вграден мотор, тоа значи дека овој хост може, доколку е потребно, да се користи за хостирање на VM со вграден мотор на него.

За целите на толеранција на дефекти, препорачливо е да има најмалку два хостови на кои може да се постави ВМ со вдомен мотор.

На дополнителниот хост, оневозможете ги iptables (ако е овозможено), овозможете заштитен ѕид

systemctl stop iptables

systemctl disable iptables

systemctl enable firewalld

systemctl start firewalldИнсталирајте ја потребната верзија на KVM (ако е потребно):

yum-config-manager --disable mirror.centos.org_centos-7_7_virt_x86_64_libvirt-latest_

yum install centos-release-qemu-ev

yum update

yum install qemu-kvm qemu-img virt-manager libvirt libvirt-python libvirt-client virt-install virt-viewer libguestfs libguestfs-tools dejavu-lgc-sans-fonts virt-top libvirt libvirt-python libvirt-client

systemctl enable libvirtd

systemctl restart libvirtd && systemctl status libvirtd

virsh domcapabilities kvm | grep md-clearИнсталирајте ги потребните складишта и хостираниот инсталатер на моторот:

yum -y install http://resources.ovirt.org/pub/yum-repo/ovirt-release43.rpm

yum -y install epel-release

yum update

yum install screen ovirt-hosted-engine-setupСледно, одете на конзолата Отворете го менаџерот за виртуелизација, додадете нов домаќин и правете сè чекор по чекор, како што е напишано во .

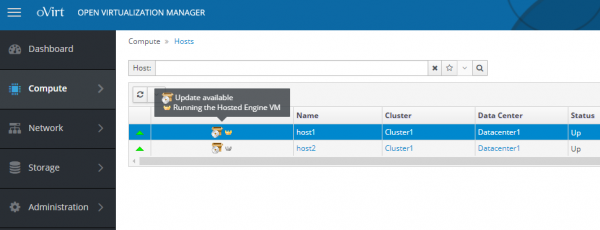

Како резултат на тоа, откако ќе додадеме дополнителен хост, треба да добиеме нешто како сликата во административната конзола, како на сликата од екранот.

Слика од екранот на административниот портал - домаќини

Домаќинот на кој моментално е активен хостираниот мотор В.М. има златна круна и натпис „Вклучување на ВМ-то со домаќински мотор", домаќинот на кој ова VM може да се лансира доколку е потребно - натписот "Може да работи на Hosted Engine VM".

Во случај на неуспех на домаќинот на кој "Вклучување на ВМ-то со домаќински мотор“, автоматски ќе се рестартира на вториот хост. Овој VM, исто така, може да се мигрира од активниот домаќин на домаќинот на подготвеност за негово одржување.

Поставување на управување со енергија / оградување на домаќините на oVirt

Линкови за документација:

- Виртуелизација на Red Hat 4.3 –> Техничка референца ->

- Водич за администрација на oVirt ->

Иако може да изгледа како да сте завршиле со додавање и конфигурирање на хост, тоа не е сосема точно.

За нормално функционирање на домаќините и за да се идентификуваат/решат неуспесите со кој било од нив, потребни се поставки за управување со енергија / ограда.

Мечување, или оградување, е процес на привремено исклучување на неисправен или неуспешен домаќин од кластерот, при што се рестартираат или услугите oVirt на него или самиот домаќин.

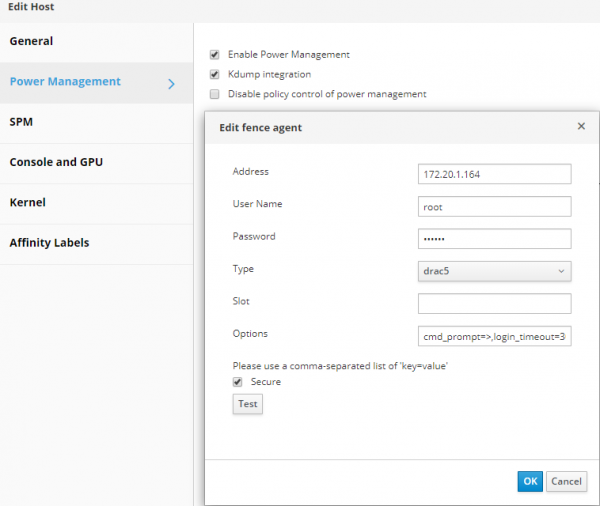

Сите детали за дефинициите и параметрите за управување со енергија / оградување се дадени, како и обично, во документацијата, ќе дадам само пример за тоа како да го конфигурирате овој важен параметар, како што се применува на серверите на Dell R640 со iDRAC 9.

- Одете на административниот портал, кликнете Пресмета >> Домаќините изберете домаќин.

- Кликнете Измени.

- Кликнете на јазичето Моќен менаџмент.

- Проверете го полето до опцијата Овозможи управување со енергија.

- Проверете го полето до опцијата Kdump интеграцијаза да се спречи домаќинот да премине во режим на мечување додека снима депонија за пад на јадрото.

Забелешка.

Откако ќе ја овозможите интеграцијата на Kdump на веќе работи домаќин, тој мора повторно да се инсталира според процедурата во Упатството за администрација на oVirt -> -> Повторно инсталирање на хостови.

- Изборно, можете да го штиклирате полето Оневозможете ја политиката за управување со енергија, ако не сакаме управувањето со енергијата на домаќинот да биде контролирано од Политиката за распоред на кластерот.

- Кликнете на копчето (+) за да додадете нов уред за управување со енергија, ќе се отвори прозорецот за уредување својства на агентот.

За iDRAC9, пополнете ги полињата:- Adresa – iDRAC9 адреса

- Корисничко име Лозинка – најава и лозинка за најавување на iDRAC9, соодветно

- тип - drac5

- марка Обезбедување

- додадете ги следните опции: cmd_prompt=>,login_timeout=30

Слика од екранот со параметри „Управување со енергија“ во својствата на домаќинот

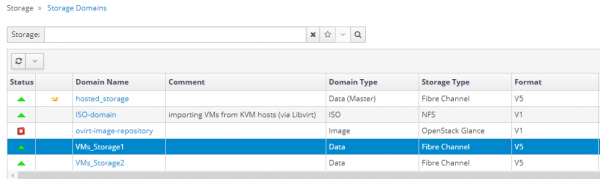

Создавање простор за складирање или домени за складирање

Врска до документација - Водич за администрација на oVirt, .

Домен за складирање, или област за складирање, е централизирана локација за складирање на дискови на виртуелната машина, слики за инсталација, шаблони и снимки.

Областите за складирање може да се поврзат со центарот за податоци користејќи различни протоколи, кластери и мрежни датотечни системи.

oVirt има три типа простор за складирање:

- Домен на податоци – за складирање на сите податоци поврзани со виртуелни машини (дискови, шаблони). Доменот на податоци не може да се дели помеѓу различни центри за податоци.

- ISO домен (застарен тип на простор за складирање) – за складирање слики за инсталација на ОС. ISO доменот може да се дели помеѓу различни центри за податоци.

- Извоз на домен (застарен тип на простор за складирање) – за привремено складирање на слики преместени помеѓу центрите за податоци.

Во нашиот конкретен случај, област за складирање со тип на домен на податоци користи протокол за канал со оптички влакна (FCP) за да се поврзе со LUN на системот за складирање.

Од гледна точка на oVirt, кога се користат системи за складирање (FC или iSCSI), секој виртуелен диск, слика или шаблон е логичен диск.

Блок-уредите се склопуваат во една единица (на кластер-домаќини) со помош на Volume Group и потоа се делат со помош на LVM на логички волумени, кои се користат како виртуелни дискови за VMs.

Сите овие групи и многу тома на LVM може да се видат на кластерот со помош на командите итн и лв. Секако, сите дејства со такви дискови треба да се прават само од конзолата oVirt, освен во посебни случаи.

Виртуелните дискови за VM може да бидат од два вида - QCOW2 или RAW. Дисковите може да бидат "тенки"или"дебели". Снимките секогаш се креираат како"тенки".

Начинот на управување со Storage домени, или областите за складирање до кои се пристапува преку FC, е сосема логичен - за секој виртуелен диск VM има посебен логички волумен што може да се запише само од еден хост. За FC конекции, oVirt користи нешто како кластерирана LVM.

Виртуелните машини лоцирани на истата област за складирање може да се мигрираат помеѓу домаќините кои припаѓаат на истиот кластер.

Како што можеме да видиме од описот, кластерот во oVirt, како кластерот во VMware vSphere или Hyper-V, во суштина значи истото - тоа е логична групација на хостови, по можност идентични во хардверскиот состав и имаат заедничко складирање за виртуелно машински дискови.

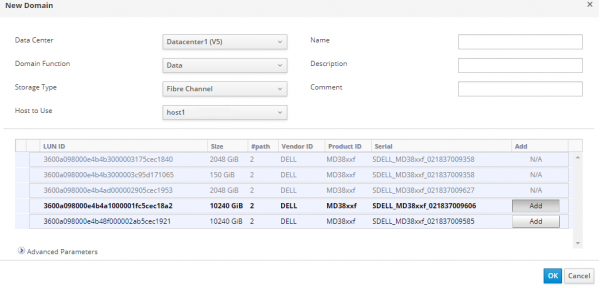

Ајде да продолжиме директно со создавање простор за складирање податоци (VM-дискови), бидејќи без него центарот за податоци нема да се иницијализира.

Дозволете ми да ве потсетам дека сите LUN претставени на хостовите на кластерот на системот за складирање мора да бидат видливи на нив со помош на командата „повеќепат -ll".

Според , оди на порталот оди на Мебел за складирање >> Домени -> Нов домен и следете ги упатствата од делот „Додавање простор за складирање FCP“.

Откако ќе го стартувате волшебникот, пополнете ги бараните полиња:

- Име — поставете го името на кластерот

- Функција на домен - Податоци

- Тип на складирање - Канал со влакна

- Домаќин за употреба — изберете домаќин на кој е достапен LUN што го бараме

Во списокот со LUN, означете го оној што ни треба, кликнете Додај и тогаш OK. Доколку е потребно, можете да прилагодите дополнителни параметри на просторот за складирање со кликнување на Напредни параметри.

Слика од екранот на волшебникот за додавање „Домен за складирање“

Врз основа на резултатите од волшебникот, треба да добиеме нова област за складирање, а нашиот центар за податоци треба да се пресели во статусот UP, или иницијализиран:

Слики од екранот на центарот за податоци и областите за складирање во него:

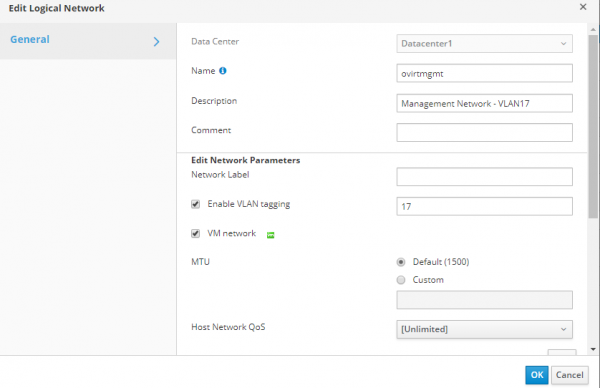

Креирање и конфигурирање на мрежи за виртуелни машини

Врска до документација - Водич за администрација на oVirt,

Мрежите или мрежите служат за групирање на логички мрежи кои се користат во виртуелната инфраструктура oVirt.

Для взаимодействия сетевого адаптера на виртуальной машине, с физическим адаптером на хосте, используются логические интерфейсы типа Linux мост

За групирање и поделба на сообраќајот помеѓу мрежите, VLAN се конфигурирани на прекинувачите.

Кога креирате логичка мрежа за виртуелни машини во oVirt, мора да ѝ се додели идентификатор што одговара на VLAN бројот на прекинувачот, така што VM-ите можат да комуницираат едни со други, дури и ако работат на различни јазли од кластерот.

Требаше да се направат прелиминарните поставки на мрежните адаптери на хостовите за поврзување на виртуелни машини - логички интерфејс е конфигуриран обврзница1, тогаш сите мрежни поставки треба да се направат само преку административниот портал oVirt.

По креирањето на VM со хостиран мотор, покрај автоматското креирање центар за податоци и кластер, автоматски се креираше и логичка мрежа за управување со нашиот кластер - овритмгмт, на кој бил поврзан овој В.М.

Доколку е потребно, можете да ги видите логичките мрежни поставки овритмгмт и приспособете ги, но мора да внимавате да не ја изгубите контролата врз инфраструктурата oVirt.

Логички мрежни поставки ovritmgmt

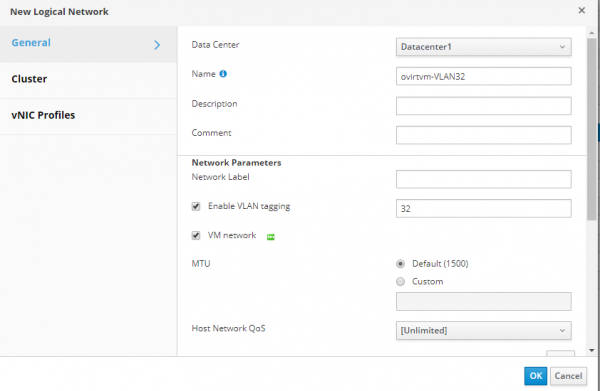

За да креирате нова логичка мрежа за редовните VMs, во административниот портал одете на мрежа >> Мрежи >> Ново, и на јазичето Генерално додадете мрежа со саканиот VLAN ID, а исто така штиклирајте го полето до „VM мрежа“, тоа значи дека може да се користи за доделување на VM.

Слика од екранот на новата логичка мрежа VLAN32

Во јазичето Кластерот за информатичка технологија, ја прикачуваме оваа мрежа на нашиот кластер Кластер1.

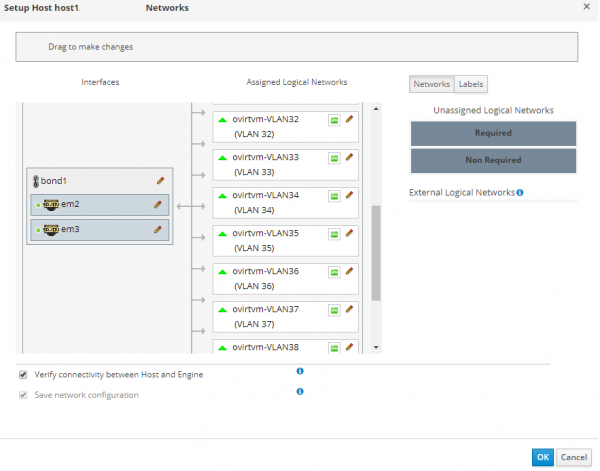

После ова одиме на Пресмета >> Домаќините, одете на секој домаќин по ред, на јазичето Мрежни интерфејси, и стартувајте го волшебникот Поставете мрежи за домаќини, да се поврзе со домаќините на нова логичка мрежа.

Слика од екранот на волшебникот „Поставување мрежи за домаќини“.

Агентот oVirt автоматски ќе ги направи сите потребни мрежни поставки на домаќинот - креирајте VLAN и BRIDGE.

Примери за конфигурациски датотеки за нови мрежи на домаќинот:

cat ifcfg-bond1

# Generated by VDSM version 4.30.17.1

DEVICE=bond1

BONDING_OPTS='mode=1 miimon=100'

MACADDR=00:50:56:82:57:52

ONBOOT=yes

MTU=1500

DEFROUTE=no

NM_CONTROLLED=no

IPV6INIT=no

cat ifcfg-bond1.432

# Generated by VDSM version 4.30.17.1

DEVICE=bond1.432

VLAN=yes

BRIDGE=ovirtvm-vlan432

ONBOOT=yes

MTU=1500

DEFROUTE=no

NM_CONTROLLED=no

IPV6INIT=no

cat ifcfg-ovirtvm-vlan432

# Generated by VDSM version 4.30.17.1

DEVICE=ovirtvm-vlan432

TYPE=Bridge

DELAY=0

STP=off

ONBOOT=yes

MTU=1500

DEFROUTE=no

NM_CONTROLLED=no

IPV6INIT=noДа ве потсетам уште еднаш дека на кластерот домаќин НЕМА ПОТРЕБА креирајте мрежни интерфејси рачно однапред ifcfg-обврзница1.432 и ifcfg-ovirtvm-vlan432.

По додавањето на логичка мрежа и проверката на врската помеѓу домаќинот и хостираниот мотор VM, може да се користи во виртуелната машина.

Создавање слика за инсталација за распоредување на виртуелна машина

Врска до документација - Водич за администрација на oVirt, , дел Поставување слики на домен за складирање податоци.

Без слика за инсталација на ОС, нема да биде возможно да се инсталира виртуелна машина, иако ова се разбира не е проблем ако, на пример, е инсталирана на мрежата со претходно креирани слики.

Во нашиот случај, ова не е можно, така што ќе треба сами да ја внесете оваа слика во oVirt. Претходно, ова бараше создавање ISO домен, но во новата верзија на oVirt тој е застарен и затоа сега можете да прикачувате слики директно во доменот Storage од административниот портал.

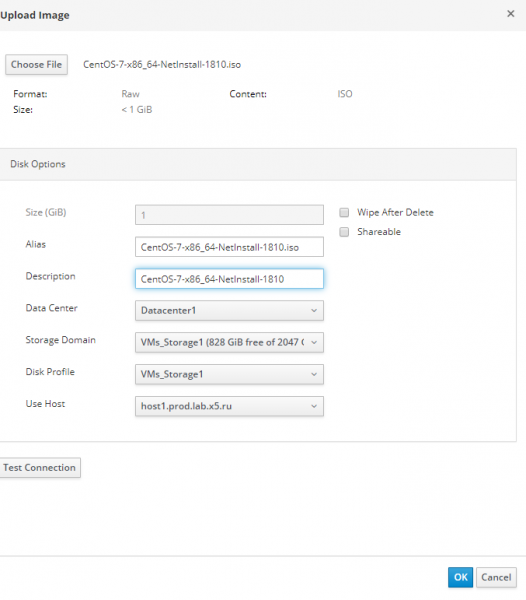

Во административниот портал одете на Мебел за складирање >> дискови >> Внеси >> почеток

Ја додаваме нашата слика на ОС како ISO-датотека, ги пополнуваме сите полиња во формуларот и кликнуваме на копчето "Тест за поврзување".

Слика од екранот на Волшебникот за додавање слика за инсталација

Ако добиеме ваква грешка:

Unable to upload image to disk d6d8fd10-c1e0-4f2d-af15-90f8e636dadc due to a network error. Ensure that ovirt-imageio-proxy service is installed and configured and that ovirt-engine's CA certificate is registered as a trusted CA in the browser. The certificate can be fetched from https://ovirt.test.local/ovirt-engine/services/pki-resource?resource=ca-certificate&format=X509-PEM-CA`

Потоа треба да го додадете сертификатот oVirt на „Доверливи Root CA„(Trusted Root CA) на контролната станица на администраторот, од каде што се обидуваме да ја преземеме сликата.

Откако ќе го додадете сертификатот во Trusted Root CA, кликнете повторно "Тест за поврзување", треба да добие:

Connection to ovirt-imageio-proxy was successful.Откако ќе го завршите дејството за додавање на сертификатот, можете повторно да се обидете да ја поставите ISO сликата на доменот за складирање.

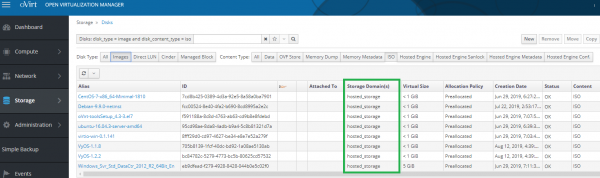

Во принцип, можете да направите посебен Storage Domain со типот Data за да складирате слики и шаблони одделно од VM-дискови, па дури и да ги складирате во Storage Domain за хостираниот мотор, но ова е на дискреција на администраторот.

Слика од екранот со ISO слики во Storage Domain за хостиран мотор

Направете виртуелна машина

Линк за документација:

oVirt Водич за управување со виртуелна машина –>

Откако ќе ја вчитате сликата за инсталација со оперативниот систем во oVirt, можете да продолжите директно до создавање виртуелна машина. Направена е многу работа, но веќе сме во завршна фаза, заради која се започна сето ова - добивање на инфраструктура толерантна за грешки за хостирање на високо достапни виртуелни машини. И сето ова е апсолутно бесплатно - ниту еден денар не беше потрошен за купување на лиценци за софтвер.

Для создания виртуальной машины с CentOS 7, должен быть загружен установочный образ с ОС.

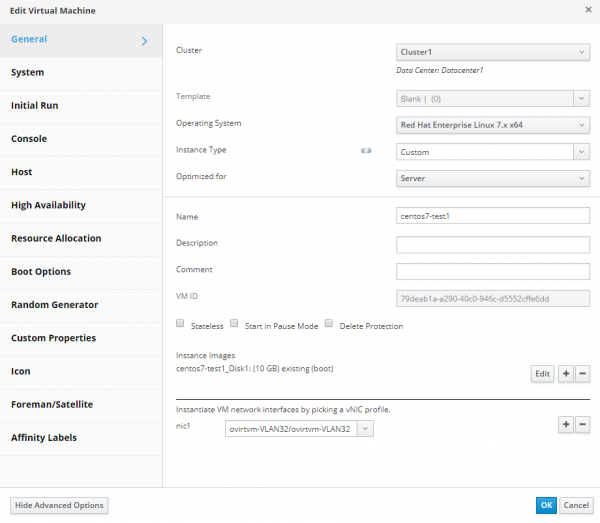

Одиме на административниот портал, одиме на Пресмета >> Виртуелни машини, и стартувајте го волшебникот за создавање VM. Пополнете ги сите параметри и полиња и кликнете OK. Сè е многу едноставно ако ја следите документацијата.

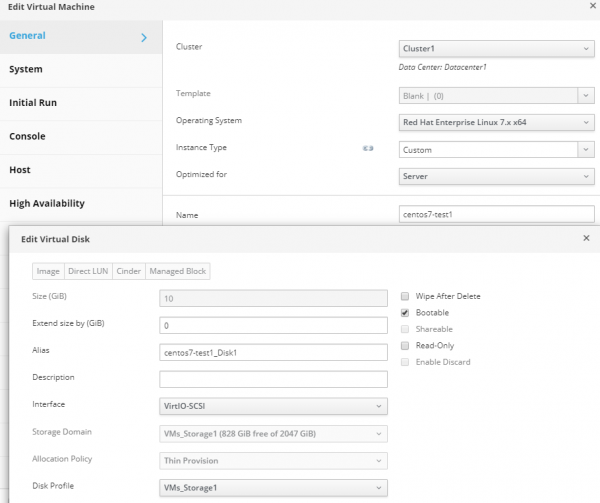

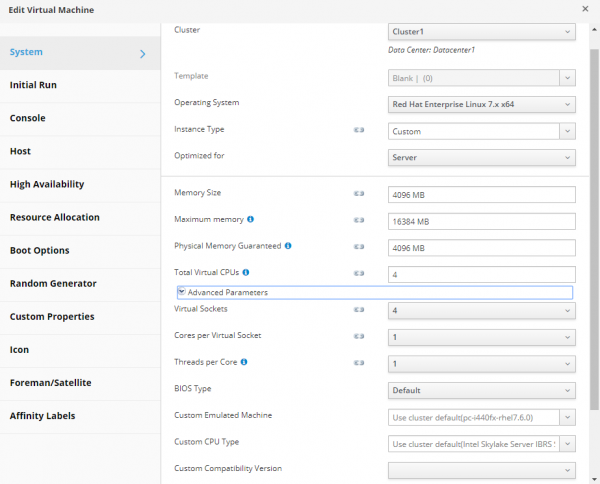

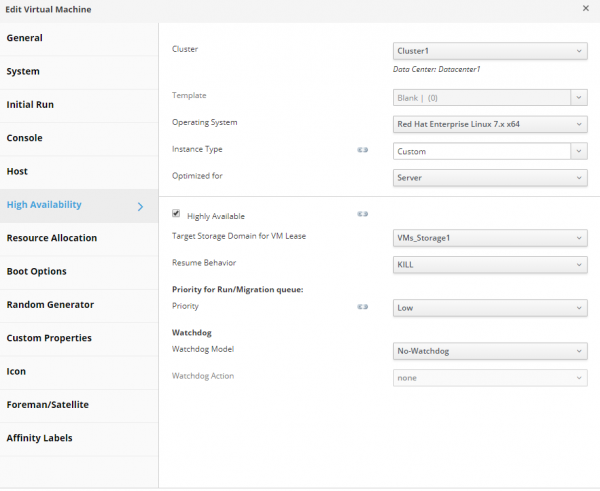

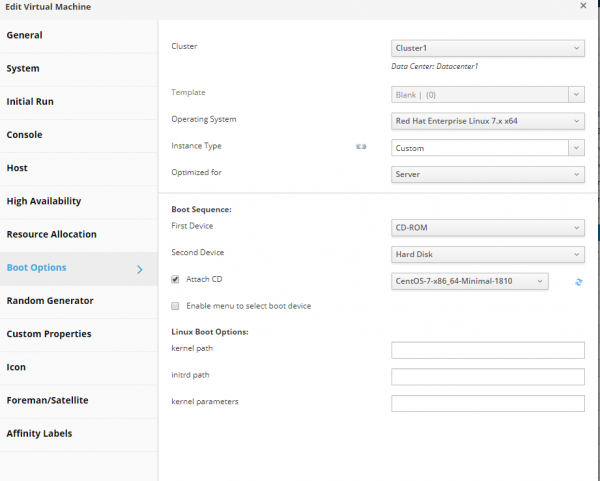

Како пример, ќе ги дадам основните и дополнителните поставки на високо достапна VM, со креиран диск, поврзан на мрежата и подигнување од слика за инсталација:

Слики од екранот со високо достапни поставки за VM

По завршувањето на работата со волшебникот, затворете го, стартувајте нов VM и инсталирајте го оперативниот систем на него.

За да го направите ова, одете во конзолата на овој VM преку административниот портал:

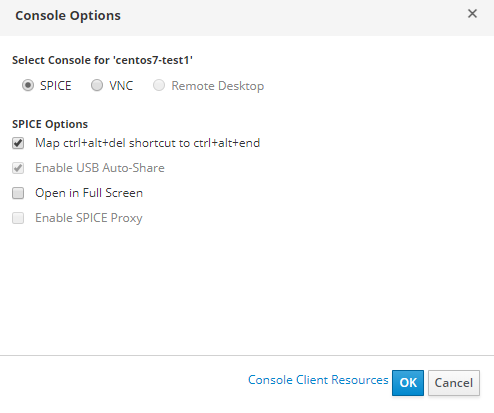

Слика од екранот на поставките на административниот портал за поврзување со VM конзолата

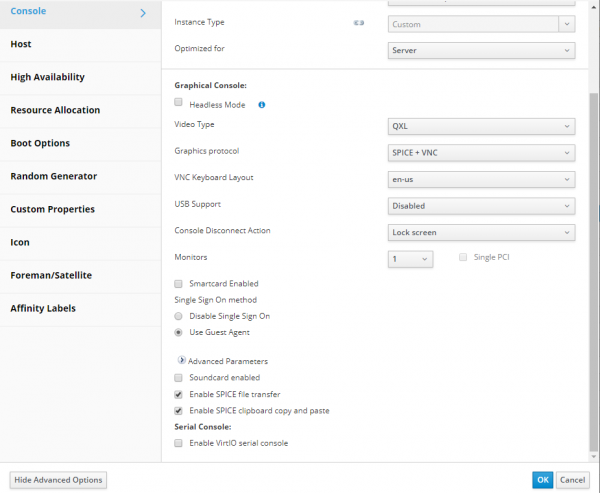

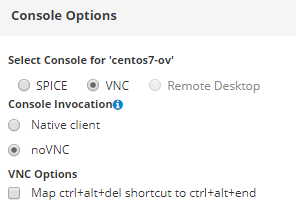

За да се поврзете со конзолата VM, прво мора да ја конфигурирате конзолата во својствата на виртуелната машина.

Слика од екранот на поставките за VM, табот „Конзола“.

За да се поврзете со VM конзолата, можете да користите, на пример, .

За да се поврзете со конзолата VM директно во прозорецот на прелистувачот, поставките за поврзување преку конзолата треба да бидат како што следува:

По инсталирањето на оперативниот систем на VM, препорачливо е да се инсталира oVirt гостин агент:

yum -y install epel-release

yum install -y ovirt-guest-agent-common

systemctl enable ovirt-guest-agent.service && systemctl restart ovirt-guest-agent.service

systemctl status ovirt-guest-agent.serviceТака, како резултат на нашите постапки, креираниот VM ќе биде високо достапен, т.е. ако јазолот на кластерот на кој работи не успее, oVirt автоматски ќе го рестартира на вториот јазол. Овој VM исто така може да се мигрира помеѓу хостовите на кластерот за нивно одржување или други цели.

Заклучок

Се надевам дека овој напис успеа да пренесе дека oVirt е сосема нормална алатка за управување со виртуелна инфраструктура, што не е толку тешко да се распореди - главната работа е да се следат одредени правила и барања опишани и во статијата и во документацијата.

Поради големиот обем на статијата, не беше возможно да се вклучат многу работи во него, како што е чекор-по-чекор извршување на разни волшебници со сите детални објаснувања и слики од екранот, долги заклучоци за некои команди итн. Всушност, ова би барало да се напише цела книга, што нема многу смисла поради новите верзии на софтвер кои постојано се појавуваат со иновации и промени. Најважно е да се разбере принципот како сето тоа функционира заедно и да се добие општ алгоритам за создавање платформа толерантна за грешки за управување со виртуелни машини.

Иако создадовме виртуелна инфраструктура, сега треба да ја научиме да комуницира и помеѓу нејзините поединечни елементи: хостови, виртуелни машини, внатрешни мрежи и со надворешниот свет.

Овој процес е една од главните задачи на администраторот на системот или мрежата, која ќе биде опфатена во следната статија - за употребата на виртуелните рутери на VyOS во инфраструктурата толерантна за грешки на нашето претпријатие (како што претпоставувате, тие ќе работат како виртуелни машини на нашиот oVirt кластер).

Извор: www.habr.com