Atau sedikit tetrisologi gunaan.

Semua yang baru dilupakan lama.

Epigraf.

Pernyataan masalah

Anda perlu memuat turun fail log PostgreSQL semasa secara berkala daripada awan AWS ke pangkalan data setempat Linux hos. Bukan dalam masa nyata, tetapi, katakan, dengan sedikit kelewatan.

Tempoh muat turun kemas kini fail log ialah 5 minit.

Fail log, dalam AWS, diputar setiap jam.

Alat yang digunakan

Untuk memuat naik fail log ke hos, skrip bash digunakan yang memanggil API AWS "'.

Parameter:

- --db-instance-identifier: Nama instance dalam AWS;

- --log-file-name: nama fail log yang sedang dijana

- --max-item: Jumlah bilangan item yang dikembalikan dalam output arahan.Saiz ketulan fail yang dimuat turun.

- --starting-token: Token token permulaan

Dalam kes ini, tugas memuat turun log timbul semasa kerja

Ya, dan ringkas - tugas yang menarik untuk latihan dan variasi semasa waktu bekerja.

Saya menganggap bahawa masalah itu telah diselesaikan berdasarkan rutin. Tetapi Google pantas tidak mencadangkan penyelesaian, dan tidak ada keinginan khusus untuk mencari dengan lebih mendalam. Walau apa pun, ia adalah senaman yang bagus.

Memformalkan tugas

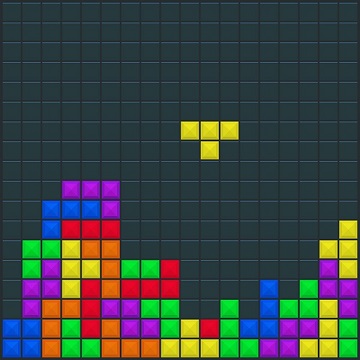

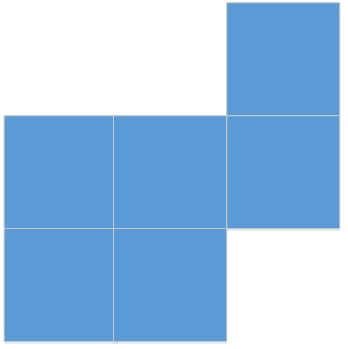

Fail log terakhir ialah satu set baris dengan panjang berubah-ubah. Secara grafik, fail log boleh diwakili seperti ini:

Adakah ia sudah mengingatkan anda tentang sesuatu? Ada apa dengan "tetris"? Dan inilah yang.

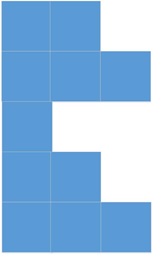

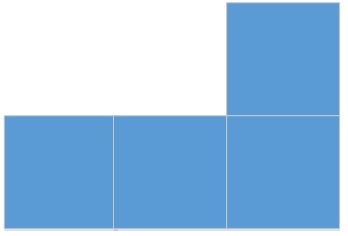

Jika kami mewakili kemungkinan pilihan yang timbul apabila memuatkan fail seterusnya secara grafik (untuk kesederhanaan, dalam kes ini, biarkan garisan mempunyai panjang yang sama), kami mendapat angka tetris standard:

1) Fail dimuat turun secara keseluruhan dan adalah muktamad. Saiz ketulan lebih besar daripada saiz fail akhir:

2) Fail mempunyai sambungan. Saiz ketulan lebih kecil daripada saiz fail akhir:

3) Fail adalah kesinambungan daripada fail sebelumnya dan mempunyai sambungan. Saiz ketulan kurang daripada saiz fail akhir yang lain:

4) Fail adalah kesinambungan daripada fail sebelumnya dan adalah muktamad. Saiz ketulan lebih besar daripada saiz fail akhir yang lain:

Tugasnya adalah untuk memasang segi empat tepat atau bermain Tetris pada tahap yang baru.

Masalah yang timbul semasa menyelesaikan masalah

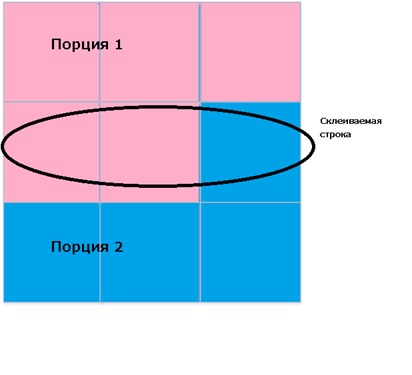

1) Gamkan tali 2 bahagian

Secara umum, tidak ada masalah khusus. Tugas standard dari kursus pengaturcaraan awal.

Saiz hidangan yang optimum

Tetapi ini sedikit lebih menarik.

Malangnya, tiada cara untuk menggunakan offset selepas label bahagian permulaan:

Seperti yang anda sedia maklum, pilihan --starting-token digunakan untuk menentukan tempat untuk memulakan penomboran. Pilihan ini mengambil nilai String yang bermakna jika anda cuba menambah nilai offset di hadapan rentetan Token Seterusnya, pilihan itu tidak akan diambil kira sebagai offset.

Oleh itu, anda perlu membaca dalam bahagian-bahagian.

Jika anda membaca dalam bahagian yang besar, maka bilangan bacaan akan menjadi minimum, tetapi jumlahnya akan maksimum.

Jika anda membaca dalam bahagian kecil, maka sebaliknya, bilangan bacaan akan maksimum, tetapi jumlahnya akan minimum.

Oleh itu, untuk mengurangkan lalu lintas dan untuk keindahan keseluruhan penyelesaian, saya terpaksa menghasilkan beberapa jenis penyelesaian, yang, malangnya, kelihatan sedikit seperti tongkat.

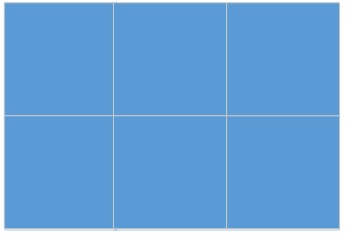

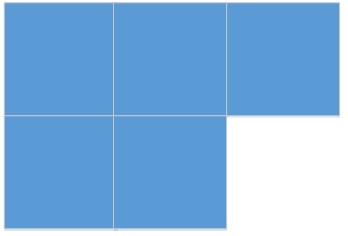

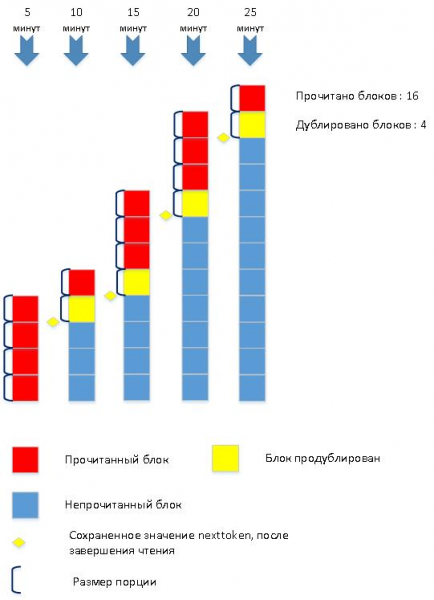

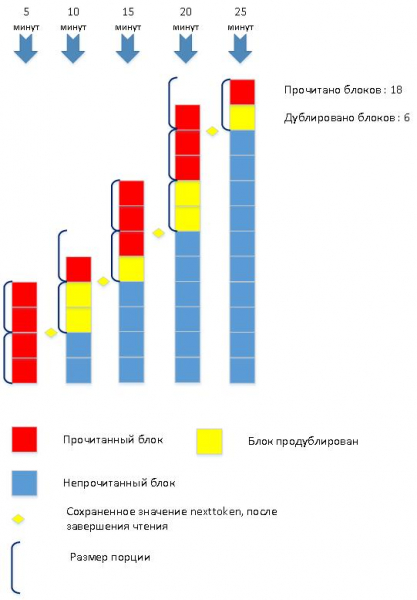

Untuk menggambarkan, mari kita pertimbangkan proses memuat turun fail log dalam 2 versi yang sangat dipermudahkan. Bilangan bacaan dalam kedua-dua kes bergantung pada saiz bahagian.

1) Muatkan dalam bahagian kecil:

2) Muatkan dalam bahagian besar:

Seperti biasa, penyelesaian optimum adalah di tengah.

Saiz bahagian adalah minimum, tetapi dalam proses pembacaan, saiz boleh ditambah untuk mengurangkan bilangan bacaan.

Perlu diingatkan bahawa masalah memilih saiz optimum bahagian bacaan masih belum selesai sepenuhnya dan memerlukan kajian dan analisis yang lebih mendalam. Mungkin sedikit kemudian.

Penerangan umum pelaksanaan

Meja perkhidmatan terpakai

CREATE TABLE endpoint

(

id SERIAL ,

host text

);

TABLE database

(

id SERIAL ,

…

last_aws_log_time text ,

last_aws_nexttoken text ,

aws_max_item_size integer

);

last_aws_log_time — временная метка последнего загруженного лог-файла в формате YYYY-MM-DD-HH24.

last_aws_nexttoken — текстовая метка последней загруженной порции.

aws_max_item_size- эмпирическим путем, подобранный начальный размер порции.

Teks penuh skrip

muat turun_aws_piece.sh

#!/bin/bash

#########################################################

# download_aws_piece.sh

# downloan piece of log from AWS

# version HABR

let min_item_size=1024

let max_item_size=1048576

let growth_factor=3

let growth_counter=1

let growth_counter_max=3

echo $(date +%Y%m%d%H%M)': download_aws_piece.sh:''STARTED'

AWS_LOG_TIME=$1

echo $(date +%Y%m%d%H%M)': download_aws_piece.sh:AWS_LOG_TIME='$AWS_LOG_TIME

database_id=$2

echo $(date +%Y%m%d%H%M)': download_aws_piece.sh:database_id='$database_id

RESULT_FILE=$3

endpoint=`psql -h MONITOR_ENDPOINT.rds.amazonaws.com -U USER -d MONITOR_DATABASE_DATABASE -A -t -c "select e.host from endpoint e join database d on e.id = d.endpoint_id where d.id = $database_id "`

echo $(date +%Y%m%d%H%M)': download_aws_piece.sh:endpoint='$endpoint

db_instance=`echo $endpoint | awk -F"." '{print toupper($1)}'`

echo $(date +%Y%m%d%H%M)': download_aws_piece.sh:db_instance='$db_instance

LOG_FILE=$RESULT_FILE'.tmp_log'

TMP_FILE=$LOG_FILE'.tmp'

TMP_MIDDLE=$LOG_FILE'.tmp_mid'

TMP_MIDDLE2=$LOG_FILE'.tmp_mid2'

current_aws_log_time=`psql -h MONITOR_ENDPOINT.rds.amazonaws.com -U USER -d MONITOR_DATABASE -A -t -c "select last_aws_log_time from database where id = $database_id "`

echo $(date +%Y%m%d%H%M)': download_aws_piece.sh:current_aws_log_time='$current_aws_log_time

if [[ $current_aws_log_time != $AWS_LOG_TIME ]];

then

is_new_log='1'

if ! psql -h MONITOR_ENDPOINT.rds.amazonaws.com -U USER -d MONITOR_DATABASE -v ON_ERROR_STOP=1 -A -t -q -c "update database set last_aws_log_time = '$AWS_LOG_TIME' where id = $database_id "

then

echo $(date +%Y%m%d%H%M)': download_aws_piece.sh: FATAL_ERROR - update database set last_aws_log_time .'

exit 1

fi

else

is_new_log='0'

fi

echo $(date +%Y%m%d%H%M)': download_aws_piece.sh:is_new_log='$is_new_log

let last_aws_max_item_size=`psql -h MONITOR_ENDPOINT.rds.amazonaws.com -U USER -d MONITOR_DATABASE -A -t -c "select aws_max_item_size from database where id = $database_id "`

echo $(date +%Y%m%d%H%M)': download_aws_piece.sh: last_aws_max_item_size='$last_aws_max_item_size

let count=1

if [[ $is_new_log == '1' ]];

then

echo $(date +%Y%m%d%H%M)': download_aws_piece.sh: START DOWNLOADING OF NEW AWS LOG'

if ! aws rds download-db-log-file-portion

--max-items $last_aws_max_item_size

--region REGION

--db-instance-identifier $db_instance

--log-file-name error/postgresql.log.$AWS_LOG_TIME > $LOG_FILE

then

echo $(date +%Y%m%d%H%M)': download_aws_piece.sh: FATAL_ERROR - Could not get log from AWS .'

exit 2

fi

else

next_token=`psql -h MONITOR_ENDPOINT.rds.amazonaws.com -U USER -d MONITOR_DATABASE -v ON_ERROR_STOP=1 -A -t -c "select last_aws_nexttoken from database where id = $database_id "`

if [[ $next_token == '' ]];

then

next_token='0'

fi

echo $(date +%Y%m%d%H%M)': download_aws_piece.sh: CONTINUE DOWNLOADING OF AWS LOG'

if ! aws rds download-db-log-file-portion

--max-items $last_aws_max_item_size

--starting-token $next_token

--region REGION

--db-instance-identifier $db_instance

--log-file-name error/postgresql.log.$AWS_LOG_TIME > $LOG_FILE

then

echo $(date +%Y%m%d%H%M)': download_aws_piece.sh: FATAL_ERROR - Could not get log from AWS .'

exit 3

fi

line_count=`cat $LOG_FILE | wc -l`

let lines=$line_count-1

tail -$lines $LOG_FILE > $TMP_MIDDLE

mv -f $TMP_MIDDLE $LOG_FILE

fi

next_token_str=`cat $LOG_FILE | grep NEXTTOKEN`

next_token=`echo $next_token_str | awk -F" " '{ print $2}' `

grep -v NEXTTOKEN $LOG_FILE > $TMP_FILE

if [[ $next_token == '' ]];

then

cp $TMP_FILE $RESULT_FILE

echo $(date +%Y%m%d%H%M)': download_aws_piece.sh: NEXTTOKEN NOT FOUND - FINISH '

rm $LOG_FILE

rm $TMP_FILE

rm $TMP_MIDDLE

rm $TMP_MIDDLE2

exit 0

else

psql -h MONITOR_ENDPOINT.rds.amazonaws.com -U USER -d MONITOR_DATABASE -v ON_ERROR_STOP=1 -A -t -q -c "update database set last_aws_nexttoken = '$next_token' where id = $database_id "

fi

first_str=`tail -1 $TMP_FILE`

line_count=`cat $TMP_FILE | wc -l`

let lines=$line_count-1

head -$lines $TMP_FILE > $RESULT_FILE

###############################################

# MAIN CIRCLE

let count=2

while [[ $next_token != '' ]];

do

echo $(date +%Y%m%d%H%M)': download_aws_piece.sh: count='$count

echo $(date +%Y%m%d%H%M)': download_aws_piece.sh: START DOWNLOADING OF AWS LOG'

if ! aws rds download-db-log-file-portion

--max-items $last_aws_max_item_size

--starting-token $next_token

--region REGION

--db-instance-identifier $db_instance

--log-file-name error/postgresql.log.$AWS_LOG_TIME > $LOG_FILE

then

echo $(date +%Y%m%d%H%M)': download_aws_piece.sh: FATAL_ERROR - Could not get log from AWS .'

exit 4

fi

next_token_str=`cat $LOG_FILE | grep NEXTTOKEN`

next_token=`echo $next_token_str | awk -F" " '{ print $2}' `

TMP_FILE=$LOG_FILE'.tmp'

grep -v NEXTTOKEN $LOG_FILE > $TMP_FILE

last_str=`head -1 $TMP_FILE`

if [[ $next_token == '' ]];

then

concat_str=$first_str$last_str

echo $concat_str >> $RESULT_FILE

line_count=`cat $TMP_FILE | wc -l`

let lines=$line_count-1

tail -$lines $TMP_FILE >> $RESULT_FILE

echo $(date +%Y%m%d%H%M)': download_aws_piece.sh: NEXTTOKEN NOT FOUND - FINISH '

rm $LOG_FILE

rm $TMP_FILE

rm $TMP_MIDDLE

rm $TMP_MIDDLE2

exit 0

fi

if [[ $next_token != '' ]];

then

let growth_counter=$growth_counter+1

if [[ $growth_counter -gt $growth_counter_max ]];

then

let last_aws_max_item_size=$last_aws_max_item_size*$growth_factor

let growth_counter=1

fi

if [[ $last_aws_max_item_size -gt $max_item_size ]];

then

let last_aws_max_item_size=$max_item_size

fi

psql -h MONITOR_ENDPOINT.rds.amazonaws.com -U USER -d MONITOR_DATABASE -A -t -q -c "update database set last_aws_nexttoken = '$next_token' where id = $database_id "

concat_str=$first_str$last_str

echo $concat_str >> $RESULT_FILE

line_count=`cat $TMP_FILE | wc -l`

let lines=$line_count-1

#############################

#Get middle of file

head -$lines $TMP_FILE > $TMP_MIDDLE

line_count=`cat $TMP_MIDDLE | wc -l`

let lines=$line_count-1

tail -$lines $TMP_MIDDLE > $TMP_MIDDLE2

cat $TMP_MIDDLE2 >> $RESULT_FILE

first_str=`tail -1 $TMP_FILE`

fi

let count=$count+1

done

#

#################################################################

exit 0

Serpihan skrip dengan beberapa penjelasan:

Parameter input skrip:

- Cap masa nama fail log dalam format YYYY-MM-DD-HH24: AWS_LOG_TIME=$1

- ID pangkalan data: database_id=$2

- Nama fail log yang dikumpul: RESULT_FILE=$3

Dapatkan cap masa fail log yang terakhir dimuat naik:

current_aws_log_time=`psql -h MONITOR_ENDPOINT.rds.amazonaws.com -U USER -d MONITOR_DATABASE -A -t -c "select last_aws_log_time from database where id = $database_id "`Jika cap masa fail log yang terakhir dimuatkan tidak sepadan dengan parameter input, fail log baharu dimuatkan:

if [[ $current_aws_log_time != $AWS_LOG_TIME ]];

then

is_new_log='1'

if ! psql -h ENDPOINT.rds.amazonaws.com -U USER -d MONITOR_DATABASE -v ON_ERROR_STOP=1 -A -t -c "update database set last_aws_log_time = '$AWS_LOG_TIME' where id = $database_id "

then

echo '***download_aws_piece.sh -FATAL_ERROR - update database set last_aws_log_time .'

exit 1

fi

else

is_new_log='0'

fi

Kami mendapat nilai label nexttoken daripada fail yang dimuatkan:

next_token_str=`cat $LOG_FILE | grep NEXTTOKEN`

next_token=`echo $next_token_str | awk -F" " '{ print $2}' `

Tanda tamat muat turun ialah nilai kosong nexttoken.

Dalam gelung, kami mengira bahagian fail, sepanjang jalan, menggabungkan baris dan meningkatkan saiz bahagian:

Gelung Utama

# MAIN CIRCLE

let count=2

while [[ $next_token != '' ]];

do

echo $(date +%Y%m%d%H%M)': download_aws_piece.sh: count='$count

echo $(date +%Y%m%d%H%M)': download_aws_piece.sh: START DOWNLOADING OF AWS LOG'

if ! aws rds download-db-log-file-portion

--max-items $last_aws_max_item_size

--starting-token $next_token

--region REGION

--db-instance-identifier $db_instance

--log-file-name error/postgresql.log.$AWS_LOG_TIME > $LOG_FILE

then

echo $(date +%Y%m%d%H%M)': download_aws_piece.sh: FATAL_ERROR - Could not get log from AWS .'

exit 4

fi

next_token_str=`cat $LOG_FILE | grep NEXTTOKEN`

next_token=`echo $next_token_str | awk -F" " '{ print $2}' `

TMP_FILE=$LOG_FILE'.tmp'

grep -v NEXTTOKEN $LOG_FILE > $TMP_FILE

last_str=`head -1 $TMP_FILE`

if [[ $next_token == '' ]];

then

concat_str=$first_str$last_str

echo $concat_str >> $RESULT_FILE

line_count=`cat $TMP_FILE | wc -l`

let lines=$line_count-1

tail -$lines $TMP_FILE >> $RESULT_FILE

echo $(date +%Y%m%d%H%M)': download_aws_piece.sh: NEXTTOKEN NOT FOUND - FINISH '

rm $LOG_FILE

rm $TMP_FILE

rm $TMP_MIDDLE

rm $TMP_MIDDLE2

exit 0

fi

if [[ $next_token != '' ]];

then

let growth_counter=$growth_counter+1

if [[ $growth_counter -gt $growth_counter_max ]];

then

let last_aws_max_item_size=$last_aws_max_item_size*$growth_factor

let growth_counter=1

fi

if [[ $last_aws_max_item_size -gt $max_item_size ]];

then

let last_aws_max_item_size=$max_item_size

fi

psql -h MONITOR_ENDPOINT.rds.amazonaws.com -U USER -d MONITOR_DATABASE -A -t -q -c "update database set last_aws_nexttoken = '$next_token' where id = $database_id "

concat_str=$first_str$last_str

echo $concat_str >> $RESULT_FILE

line_count=`cat $TMP_FILE | wc -l`

let lines=$line_count-1

#############################

#Get middle of file

head -$lines $TMP_FILE > $TMP_MIDDLE

line_count=`cat $TMP_MIDDLE | wc -l`

let lines=$line_count-1

tail -$lines $TMP_MIDDLE > $TMP_MIDDLE2

cat $TMP_MIDDLE2 >> $RESULT_FILE

first_str=`tail -1 $TMP_FILE`

fi

let count=$count+1

done

Apa yang akan datang?

Jadi, tugas perantaraan pertama - "muat turun fail log dari awan" diselesaikan. Apa yang perlu dilakukan dengan log yang dimuat turun?

Mula-mula anda perlu menghuraikan fail log dan mengekstrak permintaan sebenar daripadanya.

Tugas itu tidaklah sukar sangat. Skrip bash yang paling mudah berfungsi dengan baik.

upload_log_query.sh

#!/bin/bash

#########################################################

# upload_log_query.sh

# Upload table table from dowloaded aws file

# version HABR

###########################################################

echo 'TIMESTAMP:'$(date +%c)' Upload log_query table '

source_file=$1

echo 'source_file='$source_file

database_id=$2

echo 'database_id='$database_id

beginer=' '

first_line='1'

let "line_count=0"

sql_line=' '

sql_flag=' '

space=' '

cat $source_file | while read line

do

line="$space$line"

if [[ $first_line == "1" ]]; then

beginer=`echo $line | awk -F" " '{ print $1}' `

first_line='0'

fi

current_beginer=`echo $line | awk -F" " '{ print $1}' `

if [[ $current_beginer == $beginer ]]; then

if [[ $sql_flag == '1' ]]; then

sql_flag='0'

log_date=`echo $sql_line | awk -F" " '{ print $1}' `

log_time=`echo $sql_line | awk -F" " '{ print $2}' `

duration=`echo $sql_line | awk -F" " '{ print $5}' `

#replace ' to ''

sql_modline=`echo "$sql_line" | sed 's/'''/''''''/g'`

sql_line=' '

################

#PROCESSING OF THE SQL-SELECT IS HERE

if ! psql -h ENDPOINT.rds.amazonaws.com -U USER -d DATABASE -v ON_ERROR_STOP=1 -A -t -c "select log_query('$ip_port',$database_id , '$log_date' , '$log_time' , '$duration' , '$sql_modline' )"

then

echo 'FATAL_ERROR - log_query '

exit 1

fi

################

fi #if [[ $sql_flag == '1' ]]; then

let "line_count=line_count+1"

check=`echo $line | awk -F" " '{ print $8}' `

check_sql=${check^^}

#echo 'check_sql='$check_sql

if [[ $check_sql == 'SELECT' ]]; then

sql_flag='1'

sql_line="$sql_line$line"

ip_port=`echo $sql_line | awk -F":" '{ print $4}' `

fi

else

if [[ $sql_flag == '1' ]]; then

sql_line="$sql_line$line"

fi

fi #if [[ $current_beginer == $beginer ]]; then

done

Kini anda boleh bekerja dengan pertanyaan yang diekstrak daripada fail log.

Dan terdapat beberapa kemungkinan berguna.

Pertanyaan yang dihuraikan mesti disimpan di suatu tempat. Untuk ini, jadual perkhidmatan digunakan. log_query

CREATE TABLE log_query

(

id SERIAL ,

queryid bigint ,

query_md5hash text not null ,

database_id integer not null ,

timepoint timestamp without time zone not null,

duration double precision not null ,

query text not null ,

explained_plan text[],

plan_md5hash text ,

explained_plan_wo_costs text[],

plan_hash_value text ,

baseline_id integer ,

ip text ,

port text

);

ALTER TABLE log_query ADD PRIMARY KEY (id);

ALTER TABLE log_query ADD CONSTRAINT queryid_timepoint_unique_key UNIQUE (queryid, timepoint );

ALTER TABLE log_query ADD CONSTRAINT query_md5hash_timepoint_unique_key UNIQUE (query_md5hash, timepoint );

CREATE INDEX log_query_timepoint_idx ON log_query (timepoint);

CREATE INDEX log_query_queryid_idx ON log_query (queryid);

ALTER TABLE log_query ADD CONSTRAINT database_id_fk FOREIGN KEY (database_id) REFERENCES database (id) ON DELETE CASCADE ;

Permintaan yang dihuraikan diproses dalam plpgsql fungsi "log_query'.

log_query.sql

--log_query.sql

--verison HABR

CREATE OR REPLACE FUNCTION log_query( ip_port text ,log_database_id integer , log_date text , log_time text , duration text , sql_line text ) RETURNS boolean AS $$

DECLARE

result boolean ;

log_timepoint timestamp without time zone ;

log_duration double precision ;

pos integer ;

log_query text ;

activity_string text ;

log_md5hash text ;

log_explain_plan text[] ;

log_planhash text ;

log_plan_wo_costs text[] ;

database_rec record ;

pg_stat_query text ;

test_log_query text ;

log_query_rec record;

found_flag boolean;

pg_stat_history_rec record ;

port_start integer ;

port_end integer ;

client_ip text ;

client_port text ;

log_queryid bigint ;

log_query_text text ;

pg_stat_query_text text ;

BEGIN

result = TRUE ;

RAISE NOTICE '***log_query';

port_start = position('(' in ip_port);

port_end = position(')' in ip_port);

client_ip = substring( ip_port from 1 for port_start-1 );

client_port = substring( ip_port from port_start+1 for port_end-port_start-1 );

SELECT e.host , d.name , d.owner_pwd

INTO database_rec

FROM database d JOIN endpoint e ON e.id = d.endpoint_id

WHERE d.id = log_database_id ;

log_timepoint = to_timestamp(log_date||' '||log_time,'YYYY-MM-DD HH24-MI-SS');

log_duration = duration:: double precision;

pos = position ('SELECT' in UPPER(sql_line) );

log_query = substring( sql_line from pos for LENGTH(sql_line));

log_query = regexp_replace(log_query,' +',' ','g');

log_query = regexp_replace(log_query,';+','','g');

log_query = trim(trailing ' ' from log_query);

log_md5hash = md5( log_query::text );

--Explain execution plan--

EXECUTE 'SELECT dblink_connect(''LINK1'',''host='||database_rec.host||' dbname='||database_rec.name||' user=DATABASE password='||database_rec.owner_pwd||' '')';

log_explain_plan = ARRAY ( SELECT * FROM dblink('LINK1', 'EXPLAIN '||log_query ) AS t (plan text) );

log_plan_wo_costs = ARRAY ( SELECT * FROM dblink('LINK1', 'EXPLAIN ( COSTS FALSE ) '||log_query ) AS t (plan text) );

PERFORM dblink_disconnect('LINK1');

--------------------------

BEGIN

INSERT INTO log_query

(

query_md5hash ,

database_id ,

timepoint ,

duration ,

query ,

explained_plan ,

plan_md5hash ,

explained_plan_wo_costs ,

plan_hash_value ,

ip ,

port

)

VALUES

(

log_md5hash ,

log_database_id ,

log_timepoint ,

log_duration ,

log_query ,

log_explain_plan ,

md5(log_explain_plan::text) ,

log_plan_wo_costs ,

md5(log_plan_wo_costs::text),

client_ip ,

client_port

);

activity_string = 'New query has logged '||

' database_id = '|| log_database_id ||

' query_md5hash='||log_md5hash||

' , timepoint = '||to_char(log_timepoint,'YYYYMMDD HH24:MI:SS');

RAISE NOTICE '%',activity_string;

PERFORM pg_log( log_database_id , 'log_query' , activity_string);

EXCEPTION

WHEN unique_violation THEN

RAISE NOTICE '*** unique_violation *** query already has logged';

END;

SELECT queryid

INTO log_queryid

FROM log_query

WHERE query_md5hash = log_md5hash AND

timepoint = log_timepoint;

IF log_queryid IS NOT NULL

THEN

RAISE NOTICE 'log_query with query_md5hash = % and timepoint = % has already has a QUERYID = %',log_md5hash,log_timepoint , log_queryid ;

RETURN result;

END IF;

------------------------------------------------

RAISE NOTICE 'Update queryid';

SELECT *

INTO log_query_rec

FROM log_query

WHERE query_md5hash = log_md5hash AND timepoint = log_timepoint ;

log_query_rec.query=regexp_replace(log_query_rec.query,';+','','g');

FOR pg_stat_history_rec IN

SELECT

queryid ,

query

FROM

pg_stat_db_queries

WHERE

database_id = log_database_id AND

queryid is not null

LOOP

pg_stat_query = pg_stat_history_rec.query ;

pg_stat_query=regexp_replace(pg_stat_query,'n+',' ','g');

pg_stat_query=regexp_replace(pg_stat_query,'t+',' ','g');

pg_stat_query=regexp_replace(pg_stat_query,' +',' ','g');

pg_stat_query=regexp_replace(pg_stat_query,'$.','%','g');

log_query_text = trim(trailing ' ' from log_query_rec.query);

pg_stat_query_text = pg_stat_query;

--SELECT log_query_rec.query like pg_stat_query INTO found_flag ;

IF (log_query_text LIKE pg_stat_query_text) THEN

found_flag = TRUE ;

ELSE

found_flag = FALSE ;

END IF;

IF found_flag THEN

UPDATE log_query SET queryid = pg_stat_history_rec.queryid WHERE query_md5hash = log_md5hash AND timepoint = log_timepoint ;

activity_string = ' updated queryid = '||pg_stat_history_rec.queryid||

' for log_query with id = '||log_query_rec.id

;

RAISE NOTICE '%',activity_string;

EXIT ;

END IF ;

END LOOP ;

RETURN result ;

END

$$ LANGUAGE plpgsql;

Semasa memproses, jadual perkhidmatan digunakan pg_stat_db_queriesA yang mengandungi petikan pertanyaan semasa daripada jadual pg_stat_sejarah (Penggunaan jadual diterangkan di sini − )

TABLE pg_stat_db_queries

(

database_id integer,

queryid bigint ,

query text ,

max_time double precision

);

TABLE pg_stat_history

(

…

database_id integer ,

…

queryid bigint ,

…

max_time double precision ,

…

);

Fungsi ini membolehkan anda melaksanakan beberapa ciri berguna untuk memproses permintaan daripada fail log. Iaitu:

Peluang #1 - Sejarah Pelaksanaan Pertanyaan

Sangat berguna untuk memulakan insiden persembahan. Mula-mula, berkenalan dengan sejarah - dan bila kelembapan bermula?

Kemudian, mengikut klasik, cari sebab luaran. Mungkin sahaja beban pangkalan data telah meningkat secara mendadak dan permintaan khusus tidak ada kena mengena dengannya.

Tambahkan entri baharu pada jadual log_query

port_start = position('(' in ip_port);

port_end = position(')' in ip_port);

client_ip = substring( ip_port from 1 for port_start-1 );

client_port = substring( ip_port from port_start+1 for port_end-port_start-1 );

SELECT e.host , d.name , d.owner_pwd

INTO database_rec

FROM database d JOIN endpoint e ON e.id = d.endpoint_id

WHERE d.id = log_database_id ;

log_timepoint = to_timestamp(log_date||' '||log_time,'YYYY-MM-DD HH24-MI-SS');

log_duration = to_number(duration,'99999999999999999999D9999999999');

pos = position ('SELECT' in UPPER(sql_line) );

log_query = substring( sql_line from pos for LENGTH(sql_line));

log_query = regexp_replace(log_query,' +',' ','g');

log_query = regexp_replace(log_query,';+','','g');

log_query = trim(trailing ' ' from log_query);

RAISE NOTICE 'log_query=%',log_query ;

log_md5hash = md5( log_query::text );

--Explain execution plan--

EXECUTE 'SELECT dblink_connect(''LINK1'',''host='||database_rec.host||' dbname='||database_rec.name||' user=DATABASE password='||database_rec.owner_pwd||' '')';

log_explain_plan = ARRAY ( SELECT * FROM dblink('LINK1', 'EXPLAIN '||log_query ) AS t (plan text) );

log_plan_wo_costs = ARRAY ( SELECT * FROM dblink('LINK1', 'EXPLAIN ( COSTS FALSE ) '||log_query ) AS t (plan text) );

PERFORM dblink_disconnect('LINK1');

--------------------------

BEGIN

INSERT INTO log_query

(

query_md5hash ,

database_id ,

timepoint ,

duration ,

query ,

explained_plan ,

plan_md5hash ,

explained_plan_wo_costs ,

plan_hash_value ,

ip ,

port

)

VALUES

(

log_md5hash ,

log_database_id ,

log_timepoint ,

log_duration ,

log_query ,

log_explain_plan ,

md5(log_explain_plan::text) ,

log_plan_wo_costs ,

md5(log_plan_wo_costs::text),

client_ip ,

client_port

);

Ciri #2 - Simpan Pelan Pelaksanaan Pertanyaan

Pada ketika ini, bantahan-penjelasan-komen mungkin timbul: “Tetapi sudah ada autoexplain". Ya, memang, tetapi apa gunanya jika pelan pelaksanaan disimpan dalam fail log yang sama dan untuk menyimpannya untuk analisis lanjut, anda perlu menghuraikan fail log?

Walau bagaimanapun, saya memerlukan:

pertama: simpan pelan pelaksanaan dalam jadual perkhidmatan pangkalan data pemantauan;

kedua: untuk dapat membandingkan rancangan pelaksanaan antara satu sama lain untuk segera melihat bahawa rancangan pelaksanaan pertanyaan telah berubah.

Permintaan dengan parameter pelaksanaan tertentu tersedia. Mendapatkan dan menyimpan pelan pelaksanaannya menggunakan EXPLAIN ialah tugas asas.

Selain itu, menggunakan ungkapan EXPLAIN (COSTS FALSE), anda boleh mendapatkan rangka kerja pelan, yang akan digunakan untuk mendapatkan nilai cincang pelan, yang akan membantu dalam analisis seterusnya sejarah perubahan pelan pelaksanaan.

Dapatkan templat pelan pelaksanaan

--Explain execution plan--

EXECUTE 'SELECT dblink_connect(''LINK1'',''host='||database_rec.host||' dbname='||database_rec.name||' user=DATABASE password='||database_rec.owner_pwd||' '')';

log_explain_plan = ARRAY ( SELECT * FROM dblink('LINK1', 'EXPLAIN '||log_query ) AS t (plan text) );

log_plan_wo_costs = ARRAY ( SELECT * FROM dblink('LINK1', 'EXPLAIN ( COSTS FALSE ) '||log_query ) AS t (plan text) );

PERFORM dblink_disconnect('LINK1');

Peluang #3 - Menggunakan Log Pertanyaan untuk Pemantauan

Memandangkan metrik prestasi dikonfigurasikan bukan untuk teks permintaan, tetapi untuk IDnya, anda perlu mengaitkan permintaan daripada fail log dengan permintaan yang metrik prestasi dikonfigurasikan.

Nah, sekurang-kurangnya untuk mempunyai masa yang tepat kejadian insiden persembahan.

Oleh itu, apabila insiden prestasi berlaku untuk ID permintaan, akan terdapat pautan kepada permintaan khusus dengan nilai parameter tertentu dan masa pelaksanaan yang tepat serta tempoh permintaan. Dapatkan maklumat yang diberikan hanya menggunakan paparan pg_stat_statements - ia dilarang.

Cari id pertanyaan pertanyaan dan kemas kini entri dalam jadual log_query

SELECT *

INTO log_query_rec

FROM log_query

WHERE query_md5hash = log_md5hash AND timepoint = log_timepoint ;

log_query_rec.query=regexp_replace(log_query_rec.query,';+','','g');

FOR pg_stat_history_rec IN

SELECT

queryid ,

query

FROM

pg_stat_db_queries

WHERE

database_id = log_database_id AND

queryid is not null

LOOP

pg_stat_query = pg_stat_history_rec.query ;

pg_stat_query=regexp_replace(pg_stat_query,'n+',' ','g');

pg_stat_query=regexp_replace(pg_stat_query,'t+',' ','g');

pg_stat_query=regexp_replace(pg_stat_query,' +',' ','g');

pg_stat_query=regexp_replace(pg_stat_query,'$.','%','g');

log_query_text = trim(trailing ' ' from log_query_rec.query);

pg_stat_query_text = pg_stat_query;

--SELECT log_query_rec.query like pg_stat_query INTO found_flag ;

IF (log_query_text LIKE pg_stat_query_text) THEN

found_flag = TRUE ;

ELSE

found_flag = FALSE ;

END IF;

IF found_flag THEN

UPDATE log_query SET queryid = pg_stat_history_rec.queryid WHERE query_md5hash = log_md5hash AND timepoint = log_timepoint ;

activity_string = ' updated queryid = '||pg_stat_history_rec.queryid||

' for log_query with id = '||log_query_rec.id

;

RAISE NOTICE '%',activity_string;

EXIT ;

END IF ;

END LOOP ;

afterword

Akibatnya, kaedah yang diterangkan telah menemui aplikasinya dalam , membolehkan anda mempunyai lebih banyak maklumat untuk analisis semasa menyelesaikan insiden prestasi pertanyaan yang muncul.

Walaupun, sudah tentu, pada pendapat peribadi saya, masih perlu untuk bekerja pada algoritma untuk memilih dan menukar saiz bahagian yang dimuat turun. Masalahnya masih belum diselesaikan dalam kes umum. Ia mungkin akan menarik.

Tetapi itu cerita yang sama sekali berbeza...

Sumber: www.habr.com