, projetado para coletar, transformar e enviar dados de log, métricas e eventos.

→

Por ser escrito na linguagem Rust, caracteriza-se por alto desempenho e baixo consumo de RAM em comparação com seus análogos. Além disso, muita atenção é dada às funções relacionadas à correção, em particular, à capacidade de salvar eventos não enviados em um buffer no disco e girar arquivos.

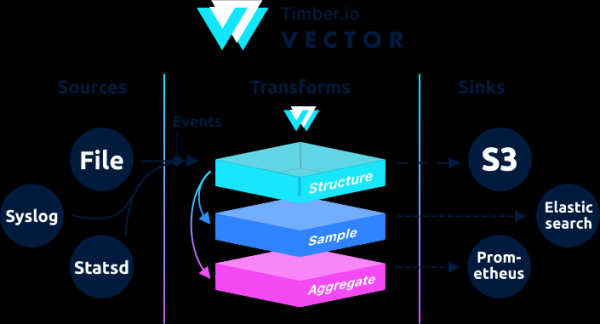

Arquitetonicamente, Vector é um roteador de eventos que recebe mensagens de um ou mais de fontes, opcionalmente aplicando-se a essas mensagens transformaçõese enviá-los para um ou mais drenos.

Vector é um substituto para filebeat e logstash, pode atuar nas duas funções (receber e enviar logs), mais detalhes sobre eles .

Se no Logstash a cadeia é construída como entrada → filtro → saída então no Vector é → →

Exemplos podem ser encontrados na documentação.

Esta instrução é uma instrução revisada de . As instruções originais contêm processamento geoip. Ao testar o geoip de uma rede interna, o vetor apresentou um erro.

Aug 05 06:25:31.889 DEBUG transform{name=nginx_parse_rename_fields type=rename_fields}: vector::transforms::rename_fields: Field did not exist field=«geoip.country_name» rate_limit_secs=30Se alguém precisar processar geoip, consulte as instruções originais de .

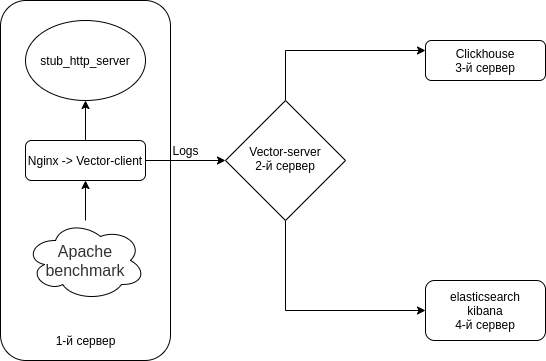

Iremos configurar a combinação de Nginx (Logs de acesso) → Vector (Cliente | Filebeat) → Vector (Servidor | Logstash) → separadamente no Clickhouse e separadamente no Elasticsearch. Instalaremos 4 servidores. Embora você possa contorná-lo com 3 servidores.

O esquema é algo assim.

Desative o Selinux em todos os seus servidores

sed -i 's/^SELINUX=.*/SELINUX=disabled/g' /etc/selinux/config

rebootInstalamos um emulador de servidor HTTP + utilitários em todos os servidores

Como emulador de servidor HTTP usaremos de

Nodejs-stub-server não possui rpm. crie rpm para ele. rpm será compilado usando

Adicione o repositório antonpatsev/nodejs-stub-server

yum -y install yum-plugin-copr epel-release

yes | yum copr enable antonpatsev/nodejs-stub-serverInstale nodejs-stub-server, benchmark Apache e multiplexador de terminal de tela em todos os servidores

yum -y install stub_http_server screen mc httpd-tools screenCorrigi o tempo de resposta stub_http_server no arquivo /var/lib/stub_http_server/stub_http_server.js para que houvesse mais logs.

var max_sleep = 10;Vamos lançar stub_http_server.

systemctl start stub_http_server

systemctl enable stub_http_serverno servidor 3

ClickHouse usa o conjunto de instruções SSE 4.2, portanto, a menos que especificado de outra forma, o suporte para ele no processador usado torna-se um requisito adicional do sistema. Aqui está o comando para verificar se o processador atual suporta SSE 4.2:

grep -q sse4_2 /proc/cpuinfo && echo "SSE 4.2 supported" || echo "SSE 4.2 not supported"Primeiro você precisa conectar o repositório oficial:

sudo yum install -y yum-utils

sudo rpm --import https://repo.clickhouse.tech/CLICKHOUSE-KEY.GPG

sudo yum-config-manager --add-repo https://repo.clickhouse.tech/rpm/stable/x86_64Para instalar pacotes você precisa executar os seguintes comandos:

sudo yum install -y clickhouse-server clickhouse-clientPermitir que o clickhouse-server escute a placa de rede no arquivo /etc/clickhouse-server/config.xml

<listen_host>0.0.0.0</listen_host>Alterando o nível de log de rastreamento para depuração

depurar

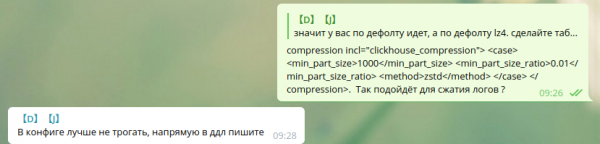

Configurações de compactação padrão:

min_compress_block_size 65536

max_compress_block_size 1048576Para ativar a compactação Zstd, foi aconselhável não mexer na configuração, mas sim usar DDL.

Não consegui descobrir como usar a compactação zstd via DDL no Google. Então deixei como está.

Colegas que usam compactação zstd no Clickhouse, compartilhem as instruções.

Para iniciar o servidor como um daemon, execute:

service clickhouse-server startAgora vamos configurar o Clickhouse

Vá para Clickhouse

clickhouse-client -h 172.26.10.109 -m172.26.10.109 — IP do servidor onde o Clickhouse está instalado.

Vamos criar um banco de dados vetorial

CREATE DATABASE vector;Vamos verificar se o banco de dados existe.

show databases;Crie uma tabela vector.logs.

/* Это таблица где хранятся логи как есть */

CREATE TABLE vector.logs

(

`node_name` String,

`timestamp` DateTime,

`server_name` String,

`user_id` String,

`request_full` String,

`request_user_agent` String,

`request_http_host` String,

`request_uri` String,

`request_scheme` String,

`request_method` String,

`request_length` UInt64,

`request_time` Float32,

`request_referrer` String,

`response_status` UInt16,

`response_body_bytes_sent` UInt64,

`response_content_type` String,

`remote_addr` IPv4,

`remote_port` UInt32,

`remote_user` String,

`upstream_addr` IPv4,

`upstream_port` UInt32,

`upstream_bytes_received` UInt64,

`upstream_bytes_sent` UInt64,

`upstream_cache_status` String,

`upstream_connect_time` Float32,

`upstream_header_time` Float32,

`upstream_response_length` UInt64,

`upstream_response_time` Float32,

`upstream_status` UInt16,

`upstream_content_type` String,

INDEX idx_http_host request_http_host TYPE set(0) GRANULARITY 1

)

ENGINE = MergeTree()

PARTITION BY toYYYYMMDD(timestamp)

ORDER BY timestamp

TTL timestamp + toIntervalMonth(1)

SETTINGS index_granularity = 8192;Verificamos se as tabelas foram criadas. Vamos lançar clickhouse-client e faça um pedido.

Vamos para o banco de dados vetorial.

use vector;

Ok.

0 rows in set. Elapsed: 0.001 sec.Vejamos as tabelas.

show tables;

┌─name────────────────┐

│ logs │

└─────────────────────┘Instalando o elasticsearch no 4º servidor para enviar os mesmos dados ao Elasticsearch para comparação com Clickhouse

Adicione uma chave rpm pública

rpm --import https://artifacts.elastic.co/GPG-KEY-elasticsearchVamos criar 2 repositórios:

/etc/yum.repos.d/elasticsearch.repo

[elasticsearch]

name=Elasticsearch repository for 7.x packages

baseurl=https://artifacts.elastic.co/packages/7.x/yum

gpgcheck=1

gpgkey=https://artifacts.elastic.co/GPG-KEY-elasticsearch

enabled=0

autorefresh=1

type=rpm-md/etc/yum.repos.d/kibana.repo

[kibana-7.x]

name=Kibana repository for 7.x packages

baseurl=https://artifacts.elastic.co/packages/7.x/yum

gpgcheck=1

gpgkey=https://artifacts.elastic.co/GPG-KEY-elasticsearch

enabled=1

autorefresh=1

type=rpm-mdInstale o elasticsearch e o kibana

yum install -y kibana elasticsearchComo estará em 1 cópia, você precisa adicionar o seguinte ao arquivo /etc/elasticsearch/elasticsearch.yml:

discovery.type: single-nodePara que esse vetor possa enviar dados para o elasticsearch de outro servidor, vamos alterar network.host.

network.host: 0.0.0.0Para se conectar ao kibana, altere o parâmetro server.host no arquivo /etc/kibana/kibana.yml

server.host: "0.0.0.0"Antigo e inclui elasticsearch na inicialização automática

systemctl enable elasticsearch

systemctl start elasticsearche kibana

systemctl enable kibana

systemctl start kibanaConfigurando o Elasticsearch para modo de nó único 1 fragmento, 0 réplica. Muito provavelmente você terá um cluster com um grande número de servidores e não precisará fazer isso.

Para índices futuros, atualize o modelo padrão:

curl -X PUT http://localhost:9200/_template/default -H 'Content-Type: application/json' -d '{"index_patterns": ["*"],"order": -1,"settings": {"number_of_shards": "1","number_of_replicas": "0"}}' Instalação como um substituto para o Logstash no servidor 2

yum install -y https://packages.timber.io/vector/0.9.X/vector-x86_64.rpm mc httpd-tools screenVamos configurar o Vector como substituto do Logstash. Editando o arquivo /etc/vector/vector.toml

# /etc/vector/vector.toml

data_dir = "/var/lib/vector"

[sources.nginx_input_vector]

# General

type = "vector"

address = "0.0.0.0:9876"

shutdown_timeout_secs = 30

[transforms.nginx_parse_json]

inputs = [ "nginx_input_vector" ]

type = "json_parser"

[transforms.nginx_parse_add_defaults]

inputs = [ "nginx_parse_json" ]

type = "lua"

version = "2"

hooks.process = """

function (event, emit)

function split_first(s, delimiter)

result = {};

for match in (s..delimiter):gmatch("(.-)"..delimiter) do

table.insert(result, match);

end

return result[1];

end

function split_last(s, delimiter)

result = {};

for match in (s..delimiter):gmatch("(.-)"..delimiter) do

table.insert(result, match);

end

return result[#result];

end

event.log.upstream_addr = split_first(split_last(event.log.upstream_addr, ', '), ':')

event.log.upstream_bytes_received = split_last(event.log.upstream_bytes_received, ', ')

event.log.upstream_bytes_sent = split_last(event.log.upstream_bytes_sent, ', ')

event.log.upstream_connect_time = split_last(event.log.upstream_connect_time, ', ')

event.log.upstream_header_time = split_last(event.log.upstream_header_time, ', ')

event.log.upstream_response_length = split_last(event.log.upstream_response_length, ', ')

event.log.upstream_response_time = split_last(event.log.upstream_response_time, ', ')

event.log.upstream_status = split_last(event.log.upstream_status, ', ')

if event.log.upstream_addr == "" then

event.log.upstream_addr = "127.0.0.1"

end

if (event.log.upstream_bytes_received == "-" or event.log.upstream_bytes_received == "") then

event.log.upstream_bytes_received = "0"

end

if (event.log.upstream_bytes_sent == "-" or event.log.upstream_bytes_sent == "") then

event.log.upstream_bytes_sent = "0"

end

if event.log.upstream_cache_status == "" then

event.log.upstream_cache_status = "DISABLED"

end

if (event.log.upstream_connect_time == "-" or event.log.upstream_connect_time == "") then

event.log.upstream_connect_time = "0"

end

if (event.log.upstream_header_time == "-" or event.log.upstream_header_time == "") then

event.log.upstream_header_time = "0"

end

if (event.log.upstream_response_length == "-" or event.log.upstream_response_length == "") then

event.log.upstream_response_length = "0"

end

if (event.log.upstream_response_time == "-" or event.log.upstream_response_time == "") then

event.log.upstream_response_time = "0"

end

if (event.log.upstream_status == "-" or event.log.upstream_status == "") then

event.log.upstream_status = "0"

end

emit(event)

end

"""

[transforms.nginx_parse_remove_fields]

inputs = [ "nginx_parse_add_defaults" ]

type = "remove_fields"

fields = ["data", "file", "host", "source_type"]

[transforms.nginx_parse_coercer]

type = "coercer"

inputs = ["nginx_parse_remove_fields"]

types.request_length = "int"

types.request_time = "float"

types.response_status = "int"

types.response_body_bytes_sent = "int"

types.remote_port = "int"

types.upstream_bytes_received = "int"

types.upstream_bytes_send = "int"

types.upstream_connect_time = "float"

types.upstream_header_time = "float"

types.upstream_response_length = "int"

types.upstream_response_time = "float"

types.upstream_status = "int"

types.timestamp = "timestamp"

[sinks.nginx_output_clickhouse]

inputs = ["nginx_parse_coercer"]

type = "clickhouse"

database = "vector"

healthcheck = true

host = "http://172.26.10.109:8123" # Адрес Clickhouse

table = "logs"

encoding.timestamp_format = "unix"

buffer.type = "disk"

buffer.max_size = 104900000

buffer.when_full = "block"

request.in_flight_limit = 20

[sinks.elasticsearch]

type = "elasticsearch"

inputs = ["nginx_parse_coercer"]

compression = "none"

healthcheck = true

# 172.26.10.116 - сервер где установен elasticsearch

host = "http://172.26.10.116:9200"

index = "vector-%Y-%m-%d"Você pode ajustar a seção transforms.nginx_parse_add_defaults.

Como usa essas configurações para um CDN pequeno e pode haver vários valores em upstream_*

Por exemplo:

"upstream_addr": "128.66.0.10:443, 128.66.0.11:443, 128.66.0.12:443"

"upstream_bytes_received": "-, -, 123"

"upstream_status": "502, 502, 200"Se esta não for a sua situação, esta seção pode ser simplificada

Vamos criar configurações de serviço para systemd /etc/systemd/system/vector.service

# /etc/systemd/system/vector.service

[Unit]

Description=Vector

After=network-online.target

Requires=network-online.target

[Service]

User=vector

Group=vector

ExecStart=/usr/bin/vector

ExecReload=/bin/kill -HUP $MAINPID

Restart=no

StandardOutput=syslog

StandardError=syslog

SyslogIdentifier=vector

[Install]

WantedBy=multi-user.targetDepois de criar as tabelas, você pode executar o Vector

systemctl enable vector

systemctl start vectorOs logs vetoriais podem ser visualizados assim:

journalctl -f -u vectorDeve haver entradas como esta nos logs

INFO vector::topology::builder: Healthcheck: Passed.

INFO vector::topology::builder: Healthcheck: Passed.No cliente (servidor Web) - 1º servidor

No servidor com nginx, é necessário desabilitar o ipv6, pois a tabela de logs no clickhouse utiliza o campo upstream_addr IPv4, já que não uso ipv6 dentro da rede. Se o ipv6 não estiver desligado, haverá erros:

DB::Exception: Invalid IPv4 value.: (while read the value of key upstream_addr)Talvez leitores, adicionem suporte a ipv6.

Crie o arquivo /etc/sysctl.d/98-disable-ipv6.conf

net.ipv6.conf.all.disable_ipv6 = 1

net.ipv6.conf.default.disable_ipv6 = 1

net.ipv6.conf.lo.disable_ipv6 = 1Aplicando as configurações

sysctl --systemVamos instalar o nginx.

Adicionado arquivo de repositório nginx /etc/yum.repos.d/nginx.repo

[nginx-stable]

name=nginx stable repo

baseurl=http://nginx.org/packages/centos/$releasever/$basearch/

gpgcheck=1

enabled=1

gpgkey=https://nginx.org/keys/nginx_signing.key

module_hotfixes=trueInstale o pacote nginx

yum install -y nginxPrimeiro, precisamos configurar o formato de log no Nginx no arquivo /etc/nginx/nginx.conf

user nginx;

# you must set worker processes based on your CPU cores, nginx does not benefit from setting more than that

worker_processes auto; #some last versions calculate it automatically

# number of file descriptors used for nginx

# the limit for the maximum FDs on the server is usually set by the OS.

# if you don't set FD's then OS settings will be used which is by default 2000

worker_rlimit_nofile 100000;

error_log /var/log/nginx/error.log warn;

pid /var/run/nginx.pid;

# provides the configuration file context in which the directives that affect connection processing are specified.

events {

# determines how much clients will be served per worker

# max clients = worker_connections * worker_processes

# max clients is also limited by the number of socket connections available on the system (~64k)

worker_connections 4000;

# optimized to serve many clients with each thread, essential for linux -- for testing environment

use epoll;

# accept as many connections as possible, may flood worker connections if set too low -- for testing environment

multi_accept on;

}

http {

include /etc/nginx/mime.types;

default_type application/octet-stream;

log_format main '$remote_addr - $remote_user [$time_local] "$request" '

'$status $body_bytes_sent "$http_referer" '

'"$http_user_agent" "$http_x_forwarded_for"';

log_format vector escape=json

'{'

'"node_name":"nginx-vector",'

'"timestamp":"$time_iso8601",'

'"server_name":"$server_name",'

'"request_full": "$request",'

'"request_user_agent":"$http_user_agent",'

'"request_http_host":"$http_host",'

'"request_uri":"$request_uri",'

'"request_scheme": "$scheme",'

'"request_method":"$request_method",'

'"request_length":"$request_length",'

'"request_time": "$request_time",'

'"request_referrer":"$http_referer",'

'"response_status": "$status",'

'"response_body_bytes_sent":"$body_bytes_sent",'

'"response_content_type":"$sent_http_content_type",'

'"remote_addr": "$remote_addr",'

'"remote_port": "$remote_port",'

'"remote_user": "$remote_user",'

'"upstream_addr": "$upstream_addr",'

'"upstream_bytes_received": "$upstream_bytes_received",'

'"upstream_bytes_sent": "$upstream_bytes_sent",'

'"upstream_cache_status":"$upstream_cache_status",'

'"upstream_connect_time":"$upstream_connect_time",'

'"upstream_header_time":"$upstream_header_time",'

'"upstream_response_length":"$upstream_response_length",'

'"upstream_response_time":"$upstream_response_time",'

'"upstream_status": "$upstream_status",'

'"upstream_content_type":"$upstream_http_content_type"'

'}';

access_log /var/log/nginx/access.log main;

access_log /var/log/nginx/access.json.log vector; # Новый лог в формате json

sendfile on;

#tcp_nopush on;

keepalive_timeout 65;

#gzip on;

include /etc/nginx/conf.d/*.conf;

}Para não quebrar sua configuração atual, o Nginx permite que você tenha diversas diretivas access_log

access_log /var/log/nginx/access.log main; # Стандартный лог

access_log /var/log/nginx/access.json.log vector; # Новый лог в формате jsonNão se esqueça de adicionar uma regra ao logrotate para novos logs (se o arquivo de log não terminar com .log)

Remova default.conf de /etc/nginx/conf.d/

rm -f /etc/nginx/conf.d/default.confAdicione o host virtual /etc/nginx/conf.d/vhost1.conf

server {

listen 80;

server_name vhost1;

location / {

proxy_pass http://172.26.10.106:8080;

}

}Adicione o host virtual /etc/nginx/conf.d/vhost2.conf

server {

listen 80;

server_name vhost2;

location / {

proxy_pass http://172.26.10.108:8080;

}

}Adicione o host virtual /etc/nginx/conf.d/vhost3.conf

server {

listen 80;

server_name vhost3;

location / {

proxy_pass http://172.26.10.109:8080;

}

}Adicione o host virtual /etc/nginx/conf.d/vhost4.conf

server {

listen 80;

server_name vhost4;

location / {

proxy_pass http://172.26.10.116:8080;

}

}Adicione hosts virtuais (172.26.10.106 ip do servidor onde o nginx está instalado) a todos os servidores no arquivo /etc/hosts:

172.26.10.106 vhost1

172.26.10.106 vhost2

172.26.10.106 vhost3

172.26.10.106 vhost4E se tudo estiver pronto então

nginx -t

systemctl restart nginxAgora vamos instalar nós mesmos

yum install -y https://packages.timber.io/vector/0.9.X/vector-x86_64.rpmVamos criar um arquivo de configurações para systemd /etc/systemd/system/vector.service

[Unit]

Description=Vector

After=network-online.target

Requires=network-online.target

[Service]

User=vector

Group=vector

ExecStart=/usr/bin/vector

ExecReload=/bin/kill -HUP $MAINPID

Restart=no

StandardOutput=syslog

StandardError=syslog

SyslogIdentifier=vector

[Install]

WantedBy=multi-user.targetE configure a substituição do Filebeat na configuração /etc/vector/vector.toml. O endereço IP 172.26.10.108 é o endereço IP do servidor de log (Vector-Server)

data_dir = "/var/lib/vector"

[sources.nginx_file]

type = "file"

include = [ "/var/log/nginx/access.json.log" ]

start_at_beginning = false

fingerprinting.strategy = "device_and_inode"

[sinks.nginx_output_vector]

type = "vector"

inputs = [ "nginx_file" ]

address = "172.26.10.108:9876"Não se esqueça de adicionar o vetor de usuário ao grupo apropriado para que ele possa ler os arquivos de log. Por exemplo, nginx em centos Cria registros com direitos de grupo de administradores.

usermod -a -G adm vectorVamos iniciar o serviço vetorial

systemctl enable vector

systemctl start vectorOs logs vetoriais podem ser visualizados assim:

journalctl -f -u vectorDeveria haver uma entrada como esta nos logs

INFO vector::topology::builder: Healthcheck: Passed.Teste de estresse

Realizamos testes usando o benchmark Apache.

O pacote httpd-tools foi instalado em todos os servidores

Começamos os testes usando o benchmark Apache de 4 servidores diferentes na tela. Primeiro, iniciamos o multiplexador do terminal de tela e, em seguida, iniciamos os testes usando o benchmark Apache. Como trabalhar com tela você pode encontrar em .

Do 1º servidor

while true; do ab -H "User-Agent: 1server" -c 100 -n 10 -t 10 http://vhost1/; sleep 1; doneDo 2º servidor

while true; do ab -H "User-Agent: 2server" -c 100 -n 10 -t 10 http://vhost2/; sleep 1; doneDo 3º servidor

while true; do ab -H "User-Agent: 3server" -c 100 -n 10 -t 10 http://vhost3/; sleep 1; doneDo 4º servidor

while true; do ab -H "User-Agent: 4server" -c 100 -n 10 -t 10 http://vhost4/; sleep 1; doneVamos verificar os dados no Clickhouse

Vá para Clickhouse

clickhouse-client -h 172.26.10.109 -mFazendo uma consulta SQL

SELECT * FROM vector.logs;

┌─node_name────┬───────────timestamp─┬─server_name─┬─user_id─┬─request_full───┬─request_user_agent─┬─request_http_host─┬─request_uri─┬─request_scheme─┬─request_method─┬─request_length─┬─request_time─┬─request_referrer─┬─response_status─┬─response_body_bytes_sent─┬─response_content_type─┬───remote_addr─┬─remote_port─┬─remote_user─┬─upstream_addr─┬─upstream_port─┬─upstream_bytes_received─┬─upstream_bytes_sent─┬─upstream_cache_status─┬─upstream_connect_time─┬─upstream_header_time─┬─upstream_response_length─┬─upstream_response_time─┬─upstream_status─┬─upstream_content_type─┐

│ nginx-vector │ 2020-08-07 04:32:42 │ vhost1 │ │ GET / HTTP/1.0 │ 1server │ vhost1 │ / │ http │ GET │ 66 │ 0.028 │ │ 404 │ 27 │ │ 172.26.10.106 │ 45886 │ │ 172.26.10.106 │ 0 │ 109 │ 97 │ DISABLED │ 0 │ 0.025 │ 27 │ 0.029 │ 404 │ │

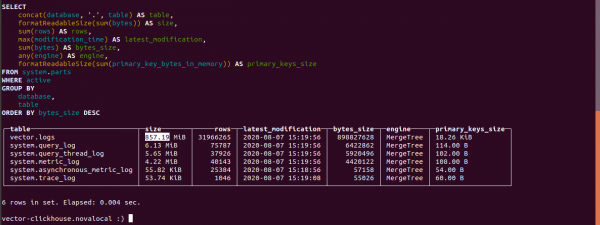

└──────────────┴─────────────────────┴─────────────┴─────────┴────────────────┴────────────────────┴───────────────────┴─────────────┴────────────────┴────────────────┴────────────────┴──────────────┴──────────────────┴─────────────────┴──────────────────────────┴───────────────────────┴───────────────┴─────────────┴─────────────┴───────────────┴───────────────┴─────────────────────────┴─────────────────────┴───────────────────────┴───────────────────────┴──────────────────────┴──────────────────────────┴────────────────────────┴─────────────────┴───────────────────────Descubra o tamanho das mesas no Clickhouse

select concat(database, '.', table) as table,

formatReadableSize(sum(bytes)) as size,

sum(rows) as rows,

max(modification_time) as latest_modification,

sum(bytes) as bytes_size,

any(engine) as engine,

formatReadableSize(sum(primary_key_bytes_in_memory)) as primary_keys_size

from system.parts

where active

group by database, table

order by bytes_size desc;Vamos descobrir quantos logs ocuparam no Clickhouse.

O tamanho da tabela de logs é 857.19 MB.

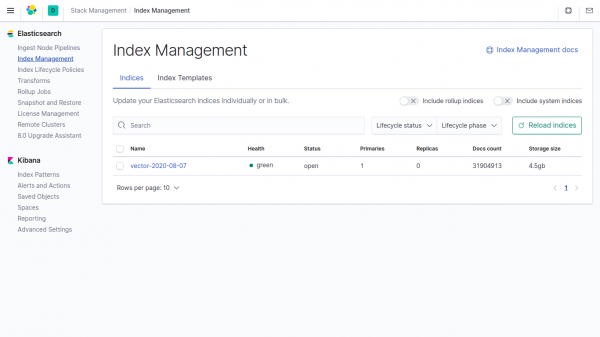

O tamanho dos mesmos dados no índice no Elasticsearch é de 4,5 GB.

Se você não especificar os dados do vetor nos parâmetros, o Clickhouse leva 4500/857.19 = 5.24 vezes menos que no Elasticsearch.

No vetor, o campo de compressão é usado por padrão.

Bate-papo por telegrama por

Bate-papo por telegrama por

Bate-papo por telegrama por ""

Fonte: habr.com