Naglathala ang Google ng isang bagong pamilya ng malalaking modelo ng wika, ang Gemma 4, batay sa modelong Gemini 3. Ang Gemma 4 ay ipinamamahagi sa ilalim ng Apache License sa mga variant na may 2.3, 4.5, 25.2, at 30.7 bilyong parameter (E2B, E4B, 31B, at 26B A4B). Ang mga variant na E2B at E4B ay angkop gamitin sa mga mobile device, Internet of Things (IoT) system, at mga board na parang Raspberry Pi, habang ang iba pang mga variant ay angkop gamitin sa mga workstation at system na may mga consumer GPU. Ang context size na isinasaalang-alang ng modelo ay 128 token para sa mga modelong E2B at E4B, at 256 token para sa mga modelong 31B at 26B A4B.

Ang mga modelo ay multilingual at multimodal: 35 na wika ang sinusuportahan agad (mahigit 140 na wika ang ginamit sa pagsasanay), at maaaring iproseso ang teksto at mga imahe bilang input (sinusuportahan din ng mga modelong E2B at E4B ang pagproseso ng audio). Ang modelong 26B A4B ay batay sa arkitekturang Mixture-of-Experts (MoE), kung saan ang modelo ay nahahati sa isang serye ng mga network ng eksperto (ang pagbuo ng tugon ay maaari lamang gumamit ng 3.8 bilyong parameter, ngunit ang bilis ay mas mataas nang malaki kaysa sa mga klasikong malalaking modelo), habang ang iba pang mga variant ay gumagamit ng klasikong monolitikong arkitektura.

Sinusuportahan ng mga modelo ang mga paraan ng pangangatwiran at napapasadyang deliberasyon, at sinusuportahan ang isang System Role para sa pagproseso ng mga tagubilin (mga panuntunan, mga limitasyon) nang hiwalay sa data. Maaaring gamitin ang mga modelo para sa pagsulat ng code, pagkilala ng mga bagay sa mga imahe, pagsusuri ng video sa bawat frame, pag-parse ng mga dokumento at PDF, optical character recognition (OCR) ng naka-print at sulat-kamay na teksto, pagkilala ng pagsasalita, at pagsasalin sa pagitan ng mga wika. Maaari rin itong gamitin bilang mga autonomous agent na nakikipag-ugnayan sa iba't ibang tool at API.

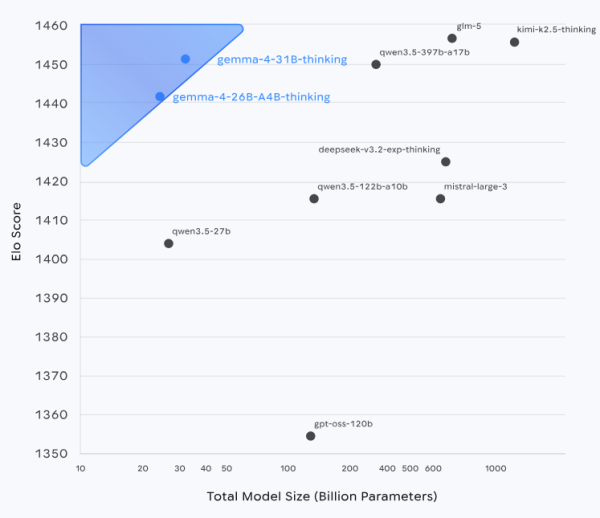

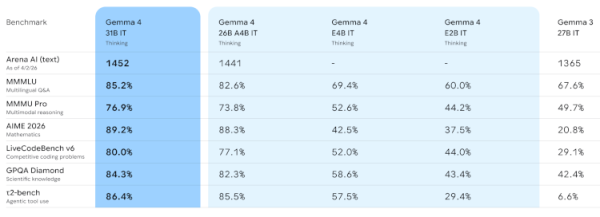

Sa karamihan ng mga pagsubok, ang mga modelong Gemma 4 ay mas mahusay kaysa sa modelong Gemma 3 na may 27 bilyong parameter. Sinusuportahan ng Gemma 4 ang LiteRT-LM, vLLM, llama.cpp, MLX, Ollama, NVIDIA NIM at NeMo, LM Studio, Unsloth, SGLang, Cactus, Basetan, MaxText, Tunix, at Keras.

Pinagmulan: opennet.ru