Šis straipsnis yra ankstesnio tęsinys - "".

Ji apims pagrindinio oVirt 4.3 klasterio, skirto didelio prieinamumo virtualioms mašinoms talpinti, diegimo ir konfigūravimo procesą, atsižvelgiant į tai, kad visi parengiamieji infrastruktūros paruošimo veiksmai jau buvo atlikti anksčiau.

Įvadas

Pagrindinis straipsnio tikslas – pateikti nuoseklias instrukcijas, tokias kaip „Sekantis -> Taip -> apdaila"Kaip parodyti kai kurias funkcijas diegiant ir konfigūruojant. Dėl infrastruktūros ir aplinkos ypatumų jūsų klasterio diegimo procesas ne visada gali sutapti su jame aprašytu, tačiau bendrieji principai bus tokie patys.

Iš subjektyvios pusės, jo funkcionalumas yra panašus į VMware vSphere 5.x versiją, bet, žinoma, turi savo konfigūracijos ir veikimo ypatybes.

Tiems, kurie domisi, visus skirtumus tarp RHEV (dar žinomas kaip oVirt) ir VMware vSphere galima rasti internete, pvz. , bet vis tiek retkarčiais pastebėsiu kai kuriuos jų skirtumus ar panašumus, kai straipsnis tęsiasi.

Atskirai norėčiau šiek tiek palyginti darbą su virtualių mašinų tinklais. oVirt įgyvendina panašų tinklo valdymo principą virtualioms mašinoms (toliau – VM), kaip ir VMware vSphere:

- с помощью стандартного Linux bridge (в VMware — Standartinis vSwitch), veikia virtualizacijos pagrindiniuose kompiuteriuose;

- naudojant „Open vSwitch“ (OVS) („VMware“ - Paskirstytas vSwitch) yra paskirstytas virtualus jungiklis, susidedantis iš dviejų pagrindinių komponentų: centrinio OVN serverio ir OVN valdiklių valdomuose pagrindiniuose kompiuteriuose.

Необходимо отметить, что из-за простоты реализации, в статье будет описана настройка сетей в oVirt’е для ВМ с помощью стандартного Linux bridge, который является стандартным выбором, при использовании гипервизора KVM.

Šiuo atžvilgiu yra keletas pagrindinių darbo su tinklu klasteryje taisyklių, kurių geriausia nepažeisti:

- Visi prieglobos tinklo nustatymai prieš įtraukiant juos į oVirt turi būti identiški, išskyrus IP adresus.

- Kai priegloba buvo perimta į oVirt valdymą, labai nerekomenduojama nieko keisti tinklo nustatymuose rankiniu būdu visiškai nepasitikinus savo veiksmais, nes oVirt agentas tiesiog grąžins juos į ankstesnius iš naujo paleisdamas pagrindinį kompiuterį arba agentas.

- Naujo VM tinklo pridėjimas ir darbas su juo turėtų būti atliekamas tik naudojant oVirt valdymo pultą.

Dar vieną svarbi pastaba — labai kritinei aplinkai (labai jautriai piniginiams nuostoliams) vis tiek būtų rekomenduota naudotis mokama parama ir naudojimu . Veikiant oVirt klasteriui gali iškilti tam tikrų problemų, dėl kurių patartina kuo greičiau gauti kvalifikuotą pagalbą, o ne spręsti pačiam.

Pagaliau, rekomenduojama Prieš diegdami oVirt klasterį, susipažinkite su , kad žinotumėte bent pagrindines sąvokas ir apibrėžimus, kitaip bus šiek tiek sunku perskaityti likusią straipsnio dalį.

Norint suprasti straipsnį ir oVirt klasterio veikimo principus, yra šie rekomendaciniai dokumentai:

Apimtis ten nėra labai didelė, per valandą ar dvi jau gana gerai įsisavinsi pagrindinius principus, bet mėgstantiems smulkmenas rekomenduojama paskaityti — RHEV ir oVirt iš esmės yra tas pats dalykas.

Taigi, jei visi pagrindiniai pagrindinių kompiuterių, jungiklių ir saugojimo sistemų nustatymai buvo atlikti, mes pereiname tiesiai prie „oVirt“ diegimo.

2 dalis. oVirt 4.3 klasterio diegimas ir konfigūravimas

Kad būtų lengviau orientuotis, šiame straipsnyje išvardysiu pagrindinius skyrius, kuriuos reikia pildyti po vieną:

- oVirt valdymo serverio diegimas

- Naujo duomenų centro sukūrimas

- Naujo klasterio kūrimas

- Papildomų prieglobų diegimas savarankiškai priglobtoje aplinkoje

- Saugyklos srities arba saugyklos domenų kūrimas

- Tinklų kūrimas ir konfigūravimas virtualioms mašinoms

- Sukuriamas diegimo vaizdas, skirtas virtualiai mašinai įdiegti

- Sukurkite virtualią mašiną

oVirt valdymo serverio diegimas

oVirt valdymo serveris yra svarbiausias oVirt infrastruktūros elementas, virtualios mašinos, pagrindinio kompiuterio ar virtualaus įrenginio, valdančio visą oVirt infrastruktūrą, pavidalu.

Jo artimi analogai iš virtualizacijos pasaulio yra:

- VMware vSphere – vCenter serveris

- „Microsoft Hyper-V“ – „System Center Virtual Machine Manager“ (VMM).

Norėdami įdiegti oVirt valdymo serverį, turime dvi parinktis:

Parinktis 1

Serverio diegimas specializuoto VM arba pagrindinio kompiuterio pavidalu.

Ši parinktis veikia gana gerai, tačiau su sąlyga, kad tokia VM veikia nepriklausomai nuo klasterio, t.y. neveikia jokiame klasterio priegloboje kaip įprasta virtuali mašina, kurioje veikia KVM.

Kodėl tokios VM negalima įdiegti klasterio prieglobose?

В самом начале процесса развёртывания управляющего сервера oVirt, у нас имеется дилемма — управляющую ВМ ставить нужно, но самого кластера фактически ещё нет, и поэтому что можно с ходу придумать? Правильно – установить KVM на будущий узел кластера, далее на нём создать виртуальную машину, например, с ОС CentOS и в ней развернуть oVirt engine. Это может делаться обычно из соображений полного контроля над такой ВМ, но это ошибочное намерение, потому что в таком случае, в дальнейшем 100% будут проблемы с такой управляющей ВМ:

- jo negalima perkelti oVirt konsolėje tarp klasterio pagrindinių kompiuterių (mazgų);

- migruojant naudojant KVM per virsh migruoti, šios VM nebus galima valdyti naudojant „oVirt“ konsolę.

- klasterio prieglobos negali būti rodomos Priežiūros režimo (priežiūros režimas), jei perkeliate šią VM iš pagrindinio kompiuterio į prieglobą naudodami virsh migruoti.

Taigi darykite viską pagal taisykles – naudokite arba atskirą hostą oVirt valdymo serveriui, arba jame veikiantį nepriklausomą VM, o dar geriau – darykite taip, kaip parašyta antrame variante.

Parinktis 2

„oVirt Engine Appliance“ diegimas jos valdomame klasterio priegloboje.

Būtent ši parinktis bus laikoma teisingesne ir tinkamesnė mūsų atveju.

Reikalavimai tokiai VM aprašomi toliau, tik pridursiu, kad infrastruktūroje, kurioje būtų galima paleisti valdymo VM, rekomenduojama turėti bent du pagrindinius kompiuterius, kad būtų atsparus gedimams. Čia norėčiau pridurti, kad, kaip jau rašiau komentaruose ankstesniame straipsnyje, man niekada nepavyko gauti suskaidytos smegenys dviejų pagrindinių kompiuterių oVirt klasteryje su galimybe juose paleisti priglobto variklio VM.

„oVirt Engine Appliance“ diegimas pirmajame klasterio pagrindiniame kompiuteryje

Nuoroda į oficialius dokumentus - , skyrius "»

Dokumente nurodytos būtinos sąlygos, kurias reikia įvykdyti prieš diegiant priglobto variklio VM, taip pat išsamiai aprašomas pats diegimo procesas, todėl nėra prasmės jį kartoti pažodžiui, todėl sutelksime dėmesį į kai kurias svarbias detales.

- Prieš pradėdami visus veiksmus, būtinai įgalinkite virtualizacijos palaikymą pagrindinio kompiuterio BIOS nustatymuose.

- Įdiekite prieglobos variklio diegimo programos paketą pagrindiniame kompiuteryje:

yum -y install http://resources.ovirt.org/pub/yum-repo/ovirt-release43.rpm

yum -y install epel-release

yum install screen ovirt-hosted-engine-setup- Pradedame „oVirt Hosted Engine“ diegimo procedūrą pagrindinio kompiuterio ekrane (iš jo galite išeiti paspausdami Ctrl-A + D, uždarykite naudodami Ctrl-D):

screen

hosted-engine --deployJei norite, galite paleisti diegimą naudodami iš anksto paruoštą atsakymo failą:

hosted-engine --deploy --config-append=/var/lib/ovirt-hosted-engine-setup/answers/answers-ohe.conf- Diegdami priglobtą variklį nurodome visus būtinus parametrus:

- имя кластера

- количество vCPU и vRAM (рекомендуется 4 vCPU и 16 Гб)

- пароли

- тип хранилища для hosted engine ВМ – в нашем случае FC

- номер LUN для установки hosted engine

- где будет находиться база данных для hosted engine – рекомендую для простоты выбрать Local (это БД PostgreSQL работающая внутри этой ВМ)

и др. параметры. - Norėdami įdiegti labai prieinamą VM su priglobtu varikliu, anksčiau saugojimo sistemoje sukūrėme specialų 4 ir 150 GB dydžio LUN, kuris vėliau buvo pristatytas klasterio prieglobai – žr. .

Anksčiau taip pat tikrinome jo matomumą prieglobose:

multipath -ll

…

3600a098000e4b4b3000003c95d171065 dm-3 DELL , MD38xxf

size=150G features='3 queue_if_no_path pg_init_retries 50' hwhandler='1 rdac' wp=rw

|-+- policy='service-time 0' prio=14 status=active

| `- 15:0:0:4 sdc 8:32 active ready running

`-+- policy='service-time 0' prio=9 status=enabled

`- 18:0:0:4 sdj 8:144 active ready running- Pats prieglobos variklio diegimo procesas nėra sudėtingas, galų gale turėtume gauti maždaug taip:

[ INFO ] Generating answer file '/var/lib/ovirt-hosted-engine-setup/answers/answers-20191129131846.conf'

[ INFO ] Generating answer file '/etc/ovirt-hosted-engine/answers.conf'

[ INFO ] Stage: Pre-termination

[ INFO ] Stage: Termination

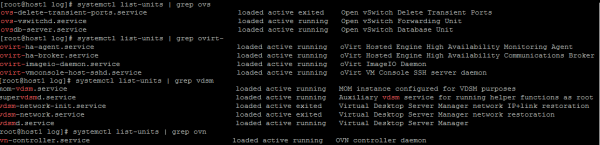

[ INFO ] Hosted Engine successfully deployedMes patikriname, ar pagrindiniame kompiuteryje yra oVirt paslaugų:

Jei viskas buvo padaryta teisingai, tada, kai diegimas bus baigtas, eikite į žiniatinklio naršyklę iš administratoriaus kompiuterio ir spustelėkite [Administravimo portalas].

„Administravimo portalo“ ekrano kopija

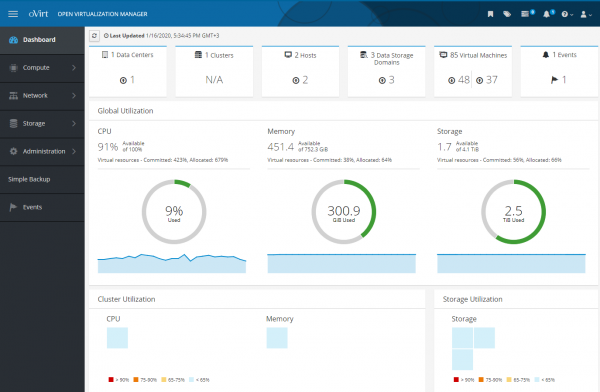

Įvedę prisijungimo vardą ir slaptažodį (nustatytus diegimo proceso metu) į langą, kaip ir ekrano kopijoje, patenkame į Open Virtualization Manager valdymo skydelį, kuriame galite atlikti visus veiksmus su virtualia infrastruktūra:

- pridėti duomenų centrą

- pridėti ir sukonfigūruoti klasterį

- pridėti ir valdyti pagrindinius kompiuterius

- pridėti saugyklos sritis arba saugyklos domenus virtualiosios mašinos diskams

- pridėti ir konfigūruoti virtualių mašinų tinklus

- pridėti ir valdyti virtualias mašinas, diegimo vaizdus, VM šablonus

Visi šie veiksmai bus aptarti toliau, kai kurie didelėse ląstelėse, kiti išsamiau ir su niuansais.

Tačiau pirmiausia rekomenduočiau perskaityti šį priedą, kuris tikriausiai bus naudingas daugeliui.

Papildymas

1) Iš esmės, jei yra toks poreikis, niekas netrukdo jums iš anksto įdiegti KVM hipervizorių klasterio mazguose naudojant paketus libvirt и qemu-kvm (Arba qemu-kvm-ev) norimos versijos, nors diegdamas oVirt klasterio mazgą jis gali tai padaryti pats.

Bet jei libvirt и qemu-kvm Jei neįdiegėte naujausios versijos, diegdami priglobtą variklį galite gauti šią klaidą:

error: unsupported configuration: unknown CPU feature: md-clearTie. privalo turėti libvirt su apsauga nuo , kuri palaiko šią politiką:

<feature policy='require' name='md-clear'/>Įdiekite libvirt v.4.5.0-10.el7_6.12 su md-clear palaikymu:

yum-config-manager --disable mirror.centos.org_centos-7_7_virt_x86_64_libvirt-latest_

yum install centos-release-qemu-ev

yum update

yum install qemu-kvm qemu-img virt-manager libvirt libvirt-python libvirt-client virt-install virt-viewer libguestfs libguestfs-tools dejavu-lgc-sans-fonts virt-top libvirt libvirt-python libvirt-client

systemctl enable libvirtd

systemctl restart libvirtd && systemctl status libvirtdPatikrinkite, ar nėra „md-clear“ palaikymo:

virsh domcapabilities kvm | grep require

<feature policy='require' name='ss'/>

<feature policy='require' name='hypervisor'/>

<feature policy='require' name='tsc_adjust'/>

<feature policy='require' name='clflushopt'/>

<feature policy='require' name='pku'/>

<feature policy='require' name='md-clear'/>

<feature policy='require' name='stibp'/>

<feature policy='require' name='ssbd'/>

<feature policy='require' name='invtsc'/>Po to galite tęsti priglobto variklio diegimą.

2) oVirt 4.3 versijoje ugniasienės buvimas ir naudojimas užkarda yra privalomas reikalavimas.

Jei diegdami VM, skirtą priglobtam varikliui, gauname šią klaidą:

[ ERROR ] fatal: [localhost]: FAILED! => {"changed": false, "msg": "firewalld is required to be enabled and active in order to correctly deploy hosted-engine. Please check, fix accordingly and re-deploy.n"}

[ ERROR ] Failed to execute stage 'Closing up': Failed executing ansible-playbook

[https://bugzilla.redhat.com/show_bug.cgi?id=1608467Tada reikia išjungti kitą ugniasienę (jei ji naudojama), įdiegti ir paleisti užkarda:

yum install firewalld

systemctl enable firewalld

systemctl start firewalld

firewall-cmd --state

firewall-cmd --get-default-zone

firewall-cmd --get-active-zones

firewall-cmd --get-zonesVėliau, diegiant ovirt agentą naujame klasterio pagrindiniame kompiuteryje, jis sukonfigūruos reikiamus prievadus užkarda automatiškai.

3) Pagrindinio kompiuterio, kuriame veikia VM, paleidimas iš naujo su priglobtu varikliu.

Kaip visada, и į reglamentuojančius dokumentus.

Visas priglobto variklio VM valdymas atliekamas TIK naudojant komandą priglobtas variklis ant pagrindinio kompiuterio, kuriame jis veikia, apie Virsh turime pamiršti, taip pat tai, kad galite prisijungti prie šios VM per SSH ir paleisti komandą „uždarymas".

VM įjungimo į priežiūros režimą procedūra:

hosted-engine --set-maintenance --mode=global

hosted-engine --vm-status

!! Cluster is in GLOBAL MAINTENANCE mode !!

--== Host host1.test.local (id: 1) status ==--

conf_on_shared_storage : True

Status up-to-date : True

Hostname : host1.test.local

Host ID : 1

Engine status : {"health": "good", "vm": "up", "detail": "Up"}

Score : 3400

stopped : False

Local maintenance : False

crc32 : dee1a774

local_conf_timestamp : 1821

Host timestamp : 1821

Extra metadata (valid at timestamp):

metadata_parse_version=1

metadata_feature_version=1

timestamp=1821 (Sat Nov 29 14:25:19 2019)

host-id=1

score=3400

vm_conf_refresh_time=1821 (Sat Nov 29 14:25:19 2019)

conf_on_shared_storage=True

maintenance=False

state=GlobalMaintenance

stopped=False

hosted-engine --vm-shutdownIš naujo paleidžiame pagrindinį kompiuterį naudodami priglobto variklio agentą ir darome su juo tai, ko reikia.

Paleidę iš naujo patikrinkite VM būseną naudodami priglobtą variklį:

hosted-engine --vm-statusJei mūsų VM su priglobtuoju varikliu nepasileidžia ir jei paslaugų žurnale matome panašias klaidas:

Klaida paslaugų žurnale:

journalctl -u ovirt-ha-agent

...

Jun 29 14:34:44 host1 journal: ovirt-ha-agent ovirt_hosted_engine_ha.agent.hosted_engine.HostedEngine ERROR Failed to start necessary monitors

Jun 29 14:34:44 host1 journal: ovirt-ha-agent ovirt_hosted_engine_ha.agent.agent.Agent ERROR Traceback (most recent call last):#012 File "/usr/lib/python2.7/site-packages/ovirt_hosted_engine_ha/agent/agent.py", line 131, in _run_agent#012 return action(he)#012 File "/usr/lib/python2.7/site-packages/ovirt_hosted_engine_ha/agent/agent.py", line 55, in action_proper#012 return he.start_monitoring()#012 File "/usr/lib/python2.7/site-packages/ovirt_hosted_engine_ha/agent/hosted_engine.py", line 413, in start_monitoring#012 self._initialize_broker()#012 File "/usr/lib/python2.7/site-packages/ovirt_hosted_engine_ha/agent/hosted_engine.py", line 537, in _initialize_broker#012 m.get('options', {}))#012 File "/usr/lib/python2.7/site-packages/ovirt_hosted_engine_ha/lib/brokerlink.py", line 86, in start_monitor#012 ).format(t=type, o=options, e=e)#012RequestError: brokerlink - failed to start monitor via ovirt-ha-broker: [Errno 2] No such file or directory, [monitor: 'ping', options: {'addr': '172.20.32.32'}]

Jun 29 14:34:44 host1 journal: ovirt-ha-agent ovirt_hosted_engine_ha.agent.agent.Agent ERROR Trying to restart agentTada prijungiame saugyklą ir iš naujo paleidžiame agentą:

hosted-engine --connect-storage

systemctl restart ovirt-ha-agent

systemctl status ovirt-ha-agent

hosted-engine --vm-start

hosted-engine --vm-statusPaleidę VM su priglobtuoju varikliu, išjungiame jį iš priežiūros režimo:

VM pašalinimo iš priežiūros režimo procedūra:

hosted-engine --check-liveliness

hosted-engine --set-maintenance --mode=none

hosted-engine --vm-status

--== Host host1.test.local (id: 1) status ==--

conf_on_shared_storage : True

Status up-to-date : True

Hostname : host1.test.local

Host ID : 1

Engine status : {"health": "good", "vm": "up", "detail": "Up"}

Score : 3400

stopped : False

Local maintenance : False

crc32 : 6d1eb25f

local_conf_timestamp : 6222296

Host timestamp : 6222296

Extra metadata (valid at timestamp):

metadata_parse_version=1

metadata_feature_version=1

timestamp=6222296 (Fri Jan 17 11:40:43 2020)

host-id=1

score=3400

vm_conf_refresh_time=6222296 (Fri Jan 17 11:40:43 2020)

conf_on_shared_storage=True

maintenance=False

state=EngineUp

stopped=False4) Priglobto variklio ir visko, kas su juo susiję, pašalinimas.

Kartais reikia tinkamai pašalinti anksčiau įdiegtą priglobtą variklį - į rekomendacinį dokumentą.

Tiesiog paleiskite komandą pagrindiniame kompiuteryje:

/usr/sbin/ovirt-hosted-engine-cleanupTada pašaliname nereikalingus paketus, prieš tai sukuriame atsargines kai kurių konfigūracijų kopijas, jei reikia:

yum autoremove ovirt* qemu* virt* libvirt* libguestfs Naujo duomenų centro sukūrimas

Nuorodinė dokumentacija – oVirt administravimo vadovas.

Pirmiausia išsiaiškinkime, kas tai yra duomenų centras (cituoju iš žinyno) yra loginis subjektas, apibrėžiantis konkrečioje aplinkoje naudojamų išteklių rinkinį.

Duomenų centras yra tam tikras konteineris, kurį sudaro:

- loginiai ištekliai klasterių ir pagrindinių kompiuterių pavidalu

- klasterio tinklo išteklius loginių tinklų ir fizinių adapterių pavidalu pagrindiniuose kompiuteriuose,

- saugojimo ištekliai (VM diskams, šablonams, vaizdams) saugojimo sričių (Storage Domains) pavidalu.

Duomenų centre gali būti kelios grupės, susidedančios iš kelių pagrindinių kompiuterių ir juose veikiančių virtualių mašinų, taip pat su juo gali būti susietos kelios saugojimo zonos.

Gali būti keli duomenų centrai, jie veikia nepriklausomai vienas nuo kito. „Ovirt“ galios skirstomos pagal vaidmenį, o leidimus galite konfigūruoti atskirai tiek duomenų centro lygiu, tiek atskiruose jo loginiuose elementuose.

Duomenų centras arba duomenų centrai, jei jų yra keli, valdomi iš vienos administracinės konsolės arba portalo.

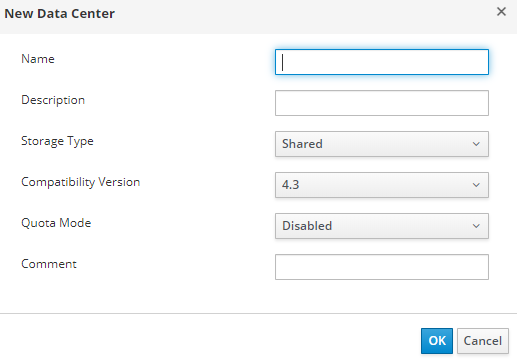

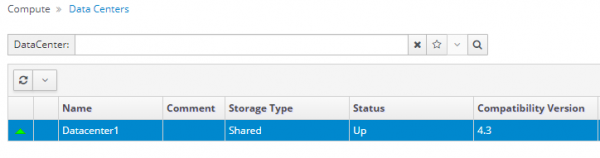

Norėdami sukurti duomenų centrą, eikite į administracinį portalą ir sukurkite naują duomenų centrą:

Apskaičiuoti >> duomenų centrai >> Naujienos

Kadangi saugojimo sistemoje naudojame bendrą saugyklą, saugyklos tipas turėtų būti bendrinamas:

Duomenų centro kūrimo vedlio ekrano kopija

Diegiant virtualią mašiną su prieglobos varikliu, duomenų centras sukuriamas pagal numatytuosius nustatymus - Duomenų centras1, tada, jei reikia, galite pakeisti jo saugyklos tipą į kitą.

Duomenų centro sukūrimas yra nesudėtinga užduotis, be jokių keblių niuansų, o visi papildomi veiksmai su juo aprašyti dokumentacijoje. Vienintelis dalykas, kurį pastebėsiu, yra tai, kad pavieniai kompiuteriai, turintys tik vietinę VM saugyklą (diską), negalės patekti į duomenų centrą su Storage Type - Shared (jų ten negalima pridėti), o jiems reikia sukurti atskiras duomenų centras – t.y. Kiekvienam atskiram kompiuteriui su vietine saugykla reikia atskiro duomenų centro.

Naujo klasterio kūrimas

Nuoroda į dokumentaciją – oVirt administravimo vadovas.

Be nereikalingų detalių, klasteris – tai logiška pagrindinių kompiuterių, turinčių bendrą saugojimo sritį, grupuotė (bendrai saugojimo sistemoje esančių diskų pavidalu, kaip ir mūsų atveju). Taip pat pageidautina, kad klasterio pagrindiniai kompiuteriai būtų identiški aparatine įranga ir turėtų tokio paties tipo procesorių (Intel arba AMD). Žinoma, geriausia, kad klasteryje esantys serveriai būtų visiškai identiški.

Klasteris yra duomenų centro dalis (su tam tikro tipo saugykla – Vietinis arba Bendri), ir visi pagrindiniai kompiuteriai turi priklausyti tam tikram klasteriui, atsižvelgiant į tai, ar jie turi bendrą saugyklą, ar ne.

Diegiant virtualią mašiną su prieglobos varikliu pagrindiniame kompiuteryje, duomenų centras sukuriamas pagal numatytuosius nustatymus - Duomenų centras1, kartu su klasteriumi – Klasteris1, o ateityje galėsite konfigūruoti jo parametrus, įjungti papildomas parinktis, pridėti prie jo pagrindinius kompiuterius ir pan.

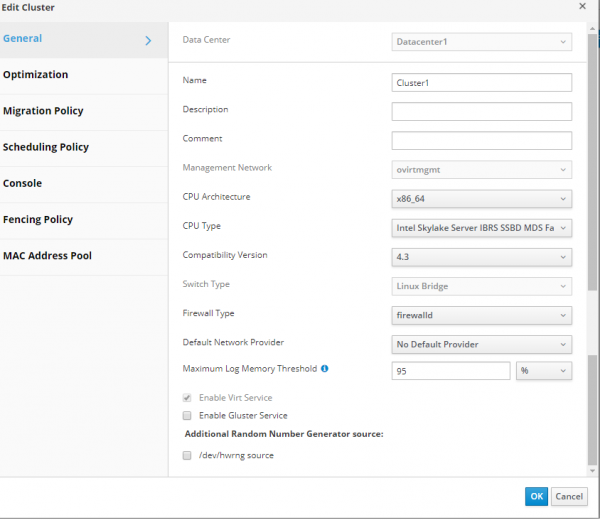

Kaip įprasta, norėdami sužinoti daugiau apie visus klasterio nustatymus, patartina žiūrėti oficialią dokumentaciją. Iš kai kurių klasterio nustatymo funkcijų pridursiu tik tai, kad ją kuriant pakanka sukonfigūruoti tik pagrindinius parametrus skirtuke. bendras.

Atkreipsiu dėmesį į svarbiausius parametrus:

- Procesoriaus tipas — parenkama pagal tai, kokie procesoriai yra įdiegti klasterio pagrindiniuose kompiuteriuose, kokio gamintojo jie yra ir kuris procesorius pagrindiniuose kompiuteriuose yra seniausias, todėl, atsižvelgiant į tai, būtų naudojamos visos turimos klasterio procesoriaus instrukcijos.

- Jungiklio tipas – у нас в кластере используется только Linux bridge, поэтому его и выбираем.

- Ugniasienės tipas – čia viskas aišku, tai ugniasienė, kuri turi būti įjungta ir sukonfigūruota pagrindiniuose kompiuteriuose.

Ekrano kopija su klasterio parametrais

Papildomų prieglobų diegimas savarankiškai priglobtoje aplinkoje

dokumentacijai.

Papildomi prieglobos kompiuteriai, skirti savarankiškai priglobtai aplinkai, pridedami taip pat, kaip ir įprastos prieglobos, su papildomu žingsniu diegiant VM su priglobtu varikliu – Pasirinkite priglobto variklio diegimo veiksmą >> Pasinaudokite. Kadangi papildomam pagrindiniam kompiuteriui taip pat turi būti pateiktas VM su priglobtu varikliu LUN, tai reiškia, kad prireikus šis pagrindinis kompiuteris gali būti naudojamas VM su priglobtu varikliu prieglobai.

Gedimų tolerancijos tikslais labai rekomenduojama, kad būtų bent du pagrindiniai kompiuteriai, kuriuose būtų galima įdėti priglobto variklio VM.

Papildomame pagrindiniame kompiuteryje išjunkite iptables (jei įjungta), įjunkite ugniasienę

systemctl stop iptables

systemctl disable iptables

systemctl enable firewalld

systemctl start firewalldĮdiekite reikiamą KVM versiją (jei reikia):

yum-config-manager --disable mirror.centos.org_centos-7_7_virt_x86_64_libvirt-latest_

yum install centos-release-qemu-ev

yum update

yum install qemu-kvm qemu-img virt-manager libvirt libvirt-python libvirt-client virt-install virt-viewer libguestfs libguestfs-tools dejavu-lgc-sans-fonts virt-top libvirt libvirt-python libvirt-client

systemctl enable libvirtd

systemctl restart libvirtd && systemctl status libvirtd

virsh domcapabilities kvm | grep md-clearĮdiekite reikiamas saugyklas ir priglobtą variklio montuotoją:

yum -y install http://resources.ovirt.org/pub/yum-repo/ovirt-release43.rpm

yum -y install epel-release

yum update

yum install screen ovirt-hosted-engine-setupTada eikite į konsolę Atidarykite virtualizacijos tvarkyklę, pridėkite naują prieglobą ir atlikite viską žingsnis po žingsnio, kaip parašyta .

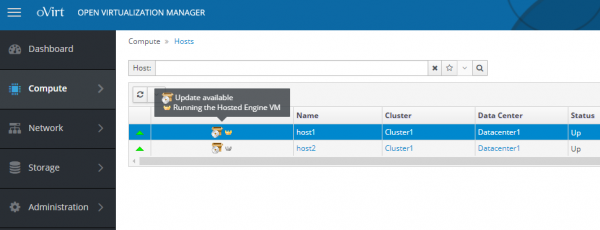

Dėl to, pridėję papildomą pagrindinį kompiuterį, turėtume gauti kažką panašaus į paveikslėlį administracinėje konsolėje, kaip ir ekrano kopijoje.

Administracinio portalo ekrano kopija – prieglobos

Priegloba, kurioje šiuo metu veikia priglobto variklio VM, turi auksinę karūną ir užrašą „Priglobto variklio VM paleidimas", priegloba, kurioje prireikus galima paleisti šią VM - užrašas "Gali paleisti Hosted Engine VM".

Priimančiojo kompiuterio gedimo atveju, kai "Priglobto variklio VM paleidimas“, jis bus automatiškai paleistas iš naujo antrajame pagrindiniame kompiuteryje. Šią VM taip pat galima perkelti iš aktyvaus pagrindinio kompiuterio į budėjimo pagrindinį kompiuterį, kad jis būtų prižiūrimas.

Energijos valdymo / tvoros nustatymas oVirt pagrindiniuose kompiuteriuose

Dokumentacijos nuorodos:

- Red Hat Virtualizacija 4.3 –> Techninė nuoroda ->

- oVirt administravimo vadovas ->

Nors gali atrodyti, kad baigėte pridėti ir konfigūruoti pagrindinį kompiuterį, tai nėra visiškai tiesa.

Norint normaliai veikti pagrindinius kompiuterius ir nustatyti/išspręsti bet kurio iš jų gedimus, reikalingi maitinimo valdymo / tvoros nustatymai.

Tvoros, arba aptvėrimas, yra sugedusio arba sugedusio pagrindinio kompiuterio laikino pašalinimo iš klasterio procesas, kurio metu iš naujo paleidžiamos arba jame esančios oVirt paslaugos, arba pats pagrindinis kompiuteris.

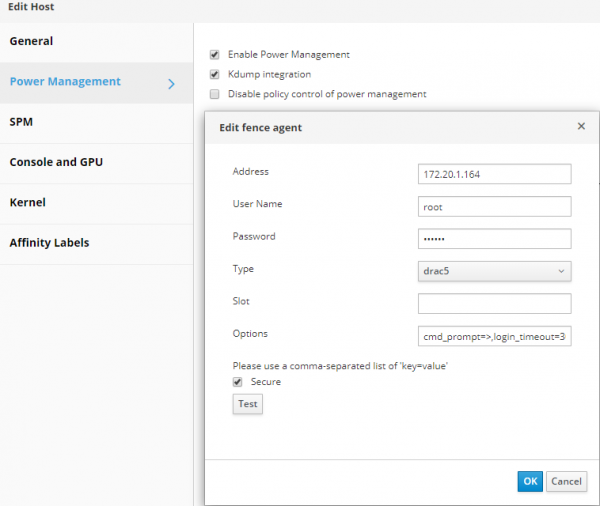

Visa informacija apie energijos valdymo / tvoros apibrėžimus ir parametrus, kaip įprasta, pateikiama dokumentacijoje, pateiksiu tik pavyzdį, kaip sukonfigūruoti šį svarbų parametrą, taikomą „Dell R640“ serveriams su „iDRAC 9“.

- Eikite į administracinį portalą, spustelėkite Apskaičiuoti >> kompiuteriai pasirinkite šeimininką.

- Spustelėkite Redaguoti.

- Spustelėkite skirtuką Maitinimo valdymas.

- Pažymėkite langelį šalia parinkties Įgalinti energijos valdymą.

- Pažymėkite langelį šalia parinkties Kdump integracijaneleisti pagrindiniam kompiuteriui pereiti į tvoros režimą, kai įrašomas branduolio gedimo iškrovimas.

Pastaba.

Įjungus Kdump integravimą jau veikiančiame pagrindiniame kompiuteryje, jis turi būti įdiegtas iš naujo pagal procedūrą oVirt administravimo vadove -> -> Iš naujo įdiegti pagrindinius kompiuterius.

- Pasirinktinai galite pažymėti langelį Išjungti energijos valdymo politikos valdymą, jei nenorime, kad pagrindinio kompiuterio energijos valdymas būtų valdomas pagal klasterio planavimo politiką.

- Spustelėkite mygtuką (+), kad pridėtumėte naują energijos valdymo įrenginį, atsidarys agento ypatybių redagavimo langas.

Jei naudojate iDRAC9, užpildykite laukus:- Adresas – iDRAC9 adresas

- Vartotojo vardas Slaptažodis – atitinkamai prisijungimo vardas ir slaptažodis prisijungimui prie iDRAC9

- Tipas -Drac5

- ženklas Užtikrinkite

- pridėkite šias parinktis: cmd_prompt=>,login_timeout=30

Ekrano kopija su „Power Management“ parametrais pagrindinio kompiuterio ypatybėse

Saugyklos srities arba saugyklos domenų kūrimas

Nuoroda į dokumentaciją – oVirt administravimo vadovas, .

Saugojimo domenas, arba saugyklos sritis, yra centralizuota vieta, kurioje saugomi virtualios mašinos diskai, diegimo vaizdai, šablonai ir momentinės nuotraukos.

Saugyklos gali būti prijungtos prie duomenų centro naudojant įvairius protokolus, klasterių ir tinklo failų sistemas.

„oVirt“ turi trijų tipų saugyklas:

- Duomenų domenas – saugoti visus duomenis, susijusius su virtualiomis mašinomis (diskus, šablonus). Duomenų domenas negali būti bendrinamas tarp skirtingų duomenų centrų.

- ISO domenas (pasenęs saugyklos tipas) – OS diegimo vaizdams saugoti. ISO domenas gali būti bendrinamas tarp skirtingų duomenų centrų.

- Eksportuoti domeną (pasenęs saugyklos tipas) – laikinai saugoti vaizdus, perkeliamus tarp duomenų centrų.

Mūsų konkrečiu atveju saugojimo sritis su duomenų domeno tipu naudoja pluošto kanalo protokolą (FCP), kad prisijungtų prie saugojimo sistemos LUN.

oVirt požiūriu, naudojant saugojimo sistemas (FC arba iSCSI), kiekvienas virtualus diskas, momentinė nuotrauka ar šablonas yra loginis diskas.

Blokų įrenginiai surenkami į vieną vienetą (klasterių pagrindiniuose kompiuteriuose), naudojant tūrių grupę, o paskui suskirstomi naudojant LVM į loginius tomus, kurie naudojami kaip virtualūs VM diskai.

Visas šias grupes ir daugelį LVM tomų galima pamatyti klasterio pagrindiniame kompiuteryje naudojant komandas ir tt и LVs. Natūralu, kad visi veiksmai su tokiais diskais turėtų būti atliekami tik iš oVirt konsolės, išskyrus ypatingus atvejus.

Virtualūs diskai VM gali būti dviejų tipų – QCOW2 arba RAW. Diskai gali būti "plonas"arba"storas". Momentinės nuotraukos visada sukuriamos kaip "plonas".

Būdas valdyti Storage domenus arba saugojimo sritis, pasiekiamas per FC, yra gana logiškas – kiekvienam VM virtualiam diskui yra atskiras loginis tomas, kurį gali įrašyti tik vienas kompiuteris. FC ryšiams oVirt naudoja kažką panašaus į sugrupuotą LVM.

Virtualios mašinos, esančios toje pačioje saugyklos srityje, gali būti perkeltos tarp kompiuterių, priklausančių tai pačiai klasteriui.

Kaip matome iš aprašymo, oVirt klasteris, kaip ir VMware vSphere ar Hyper-V klasteris, iš esmės reiškia tą patį – tai logiška prieglobų grupė, pageidautina identiška aparatinės įrangos sudėtimi ir turinti bendrą virtualios atminties saugyklą. mašinų diskai.

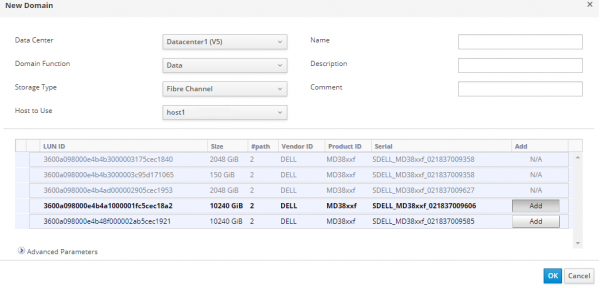

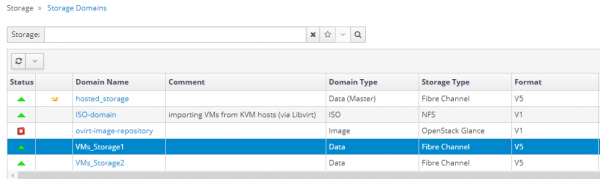

Pereikime tiesiai prie duomenų saugojimo srities (VM diskų) kūrimo, nes be jos duomenų centras nebus inicijuotas.

Leiskite jums priminti, kad visi saugojimo sistemos klasterio pagrindiniams kompiuteriams pateikti LUN turi būti matomi juose naudojant komandą „kelių kelių -ll".

Pagal , eikite į portalą eikite į saugojimas >> Domenai -> Naujas domenas ir vadovaukitės skiltyje „FCP saugyklos pridėjimas“ pateiktomis instrukcijomis.

Paleidę vedlį, užpildykite reikiamus laukus:

- Jūsų vardas — nustatyti klasterio pavadinimą

- Domeno funkcija — Duomenys

- Saugojimo tipas - pluošto kanalas

- Priegloba naudoti — pasirinkite pagrindinį kompiuterį, kuriame yra mūsų reikalingas LUN

LUN sąraše pažymėkite mums reikalingą, spustelėkite papildyti ir tada ОК. Jei reikia, spustelėdami galite koreguoti papildomus saugojimo zonos parametrus Išplėstiniai parametrai.

„Saugyklos domeno“ pridėjimo vedlio ekrano kopija

Remiantis vedlio rezultatais, turėtume gauti naują saugojimo sritį, o mūsų duomenų centras turėtų pereiti į būseną UP, arba inicijuotas:

Duomenų centro ir jame esančių saugojimo zonų ekrano kopijos:

Tinklų kūrimas ir konfigūravimas virtualioms mašinoms

Nuoroda į dokumentaciją – oVirt administravimo vadovas,

Tinklai arba tinklai skirti grupuoti loginius tinklus, naudojamus oVirt virtualioje infrastruktūroje.

Для взаимодействия сетевого адаптера на виртуальной машине, с физическим адаптером на хосте, используются логические интерфейсы типа Linux tiltas

Norint grupuoti ir padalinti srautą tarp tinklų, VLAN sukonfigūruojami jungikliuose.

Kuriant loginį tinklą virtualioms mašinoms oVirt, jam turi būti priskirtas identifikatorius, atitinkantis VLAN numerį ant jungiklio, kad VM galėtų bendrauti tarpusavyje, net jei jos veikia skirtinguose klasterio mazguose.

Reikėjo atlikti išankstinius tinklo adapterių nustatymus pagrindiniuose kompiuteriuose, kad būtų galima prijungti virtualias mašinas – sukonfigūruota loginė sąsaja 1, tada visi tinklo nustatymai turėtų būti atliekami tik per oVirt administracinį portalą.

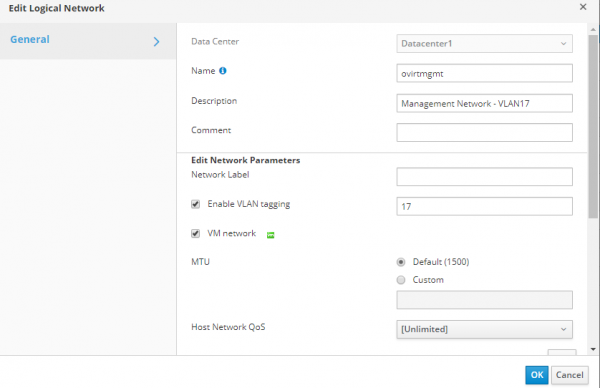

Sukūrus VM su prieglobos varikliu, be automatinio duomenų centro ir klasterio sukūrimo, taip pat buvo automatiškai sukurtas loginis tinklas, skirtas valdyti mūsų klasterį - ovritmgmt, prie kurios buvo prijungta ši VM.

Jei reikia, galite peržiūrėti loginio tinklo nustatymus ovritmgmt ir juos koreguoti, tačiau turite būti atsargūs, kad neprarastumėte oVirt infrastruktūros kontrolės.

Loginiai tinklo nustatymai ovritmgmt

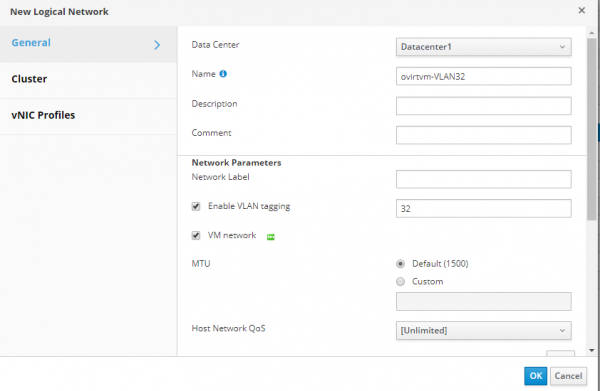

Norėdami sukurti naują loginį tinklą įprastoms VM, administraciniame portale eikite į tinklas >> Tinklai >> Naujienosir skirtuke bendras pridėkite tinklą su norimu VLAN ID, taip pat pažymėkite langelį šalia „VM tinklas“, tai reiškia, kad jis gali būti naudojamas priskirti VM.

Naujojo VLAN32 loginio tinklo ekrano kopija

Skirtuke Klasteris, prijungiame šį tinklą prie savo klasterio Klasteris1.

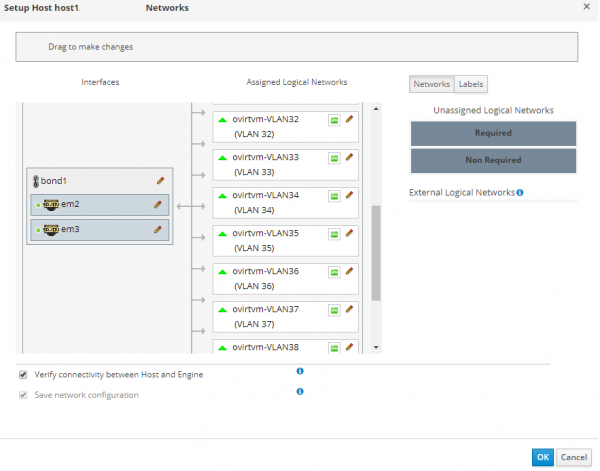

Po to einame į Apskaičiuoti >> kompiuteriai, eikite į kiekvieną pagrindinį kompiuterį paeiliui į skirtuką Tinklo sąsajosir paleiskite vedlį Nustatykite pagrindinius tinklus, prisijungti prie naujo loginio tinklo pagrindinio kompiuterio.

„Prieglobos tinklų sąrankos“ vedlio ekrano kopija

oVirt agentas automatiškai atliks visus reikiamus tinklo nustatymus pagrindiniame kompiuteryje – sukurs VLAN ir TILTĄ.

Naujų pagrindinio kompiuterio tinklų konfigūracijos failų pavyzdžiai:

cat ifcfg-bond1

# Generated by VDSM version 4.30.17.1

DEVICE=bond1

BONDING_OPTS='mode=1 miimon=100'

MACADDR=00:50:56:82:57:52

ONBOOT=yes

MTU=1500

DEFROUTE=no

NM_CONTROLLED=no

IPV6INIT=no

cat ifcfg-bond1.432

# Generated by VDSM version 4.30.17.1

DEVICE=bond1.432

VLAN=yes

BRIDGE=ovirtvm-vlan432

ONBOOT=yes

MTU=1500

DEFROUTE=no

NM_CONTROLLED=no

IPV6INIT=no

cat ifcfg-ovirtvm-vlan432

# Generated by VDSM version 4.30.17.1

DEVICE=ovirtvm-vlan432

TYPE=Bridge

DELAY=0

STP=off

ONBOOT=yes

MTU=1500

DEFROUTE=no

NM_CONTROLLED=no

IPV6INIT=noLeiskite dar kartą priminti, kad klasterio priegloboje NEREIKIA iš anksto rankiniu būdu sukurkite tinklo sąsajas ifcfg-bond1.432 и ifcfg-ovirtvm-vlan432.

Pridėjus loginį tinklą ir patikrinus ryšį tarp pagrindinio kompiuterio ir priglobto variklio VM, jį galima naudoti virtualioje mašinoje.

Sukuriamas diegimo vaizdas, skirtas virtualiai mašinai įdiegti

Nuoroda į dokumentaciją – oVirt administravimo vadovas, , skyrių Vaizdų įkėlimas į duomenų saugojimo domeną.

Be OS diegimo vaizdo nebus įmanoma įdiegti virtualios mašinos, nors tai, žinoma, nėra problema, jei, pavyzdžiui, įdiegta tinkle su iš anksto sukurtais vaizdais.

Mūsų atveju tai neįmanoma, todėl šį vaizdą į oVirt turėsite importuoti patys. Anksčiau tam reikėjo sukurti ISO domeną, tačiau naujoje oVirt versijoje jis buvo nebenaudojamas, todėl dabar galite įkelti vaizdus tiesiai į saugyklos domeną iš administracinio portalo.

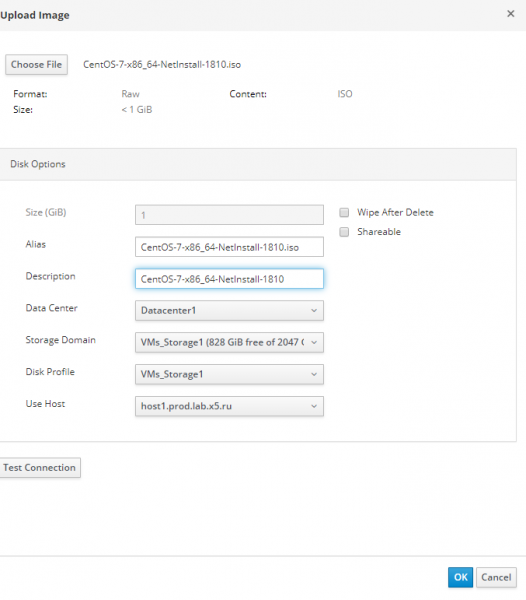

Administraciniame portale eikite į saugojimas >> Diskų >> Įkelti >> pradžia

Pridedame savo OS vaizdą kaip ISO failą, užpildome visus formos laukus ir spustelėkite mygtuką "Bandomasis ryšys".

Pridėti diegimo vaizdo vedlio ekrano kopija

Jei gauname tokią klaidą:

Unable to upload image to disk d6d8fd10-c1e0-4f2d-af15-90f8e636dadc due to a network error. Ensure that ovirt-imageio-proxy service is installed and configured and that ovirt-engine's CA certificate is registered as a trusted CA in the browser. The certificate can be fetched from https://ovirt.test.local/ovirt-engine/services/pki-resource?resource=ca-certificate&format=X509-PEM-CA`

Tada turite pridėti oVirt sertifikatą prie „Patikimi šakniniai CA„(Trusted Root CA) administratoriaus valdymo pulte, iš kurio bandome atsisiųsti vaizdą.

Pridėję sertifikatą prie patikimos šakninės CA, spustelėkite dar kartą "Bandomasis ryšys", turėtų gauti:

Connection to ovirt-imageio-proxy was successful.Atlikę sertifikato pridėjimo veiksmą, galite dar kartą pabandyti įkelti ISO atvaizdą į saugyklos domeną.

Iš esmės galite sukurti atskirą saugyklos domeną su duomenų tipu, kad galėtumėte saugoti vaizdus ir šablonus atskirai nuo VM diskų arba net saugoti juos talpinamo variklio saugyklos domene, tačiau tai priklauso nuo administratoriaus nuožiūra.

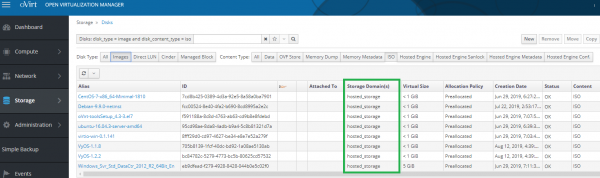

Ekrano kopija su ISO vaizdais talpyklos domene

Sukurkite virtualią mašiną

Dokumentacijos nuoroda:

oVirt virtualios mašinos valdymo vadovas –>

Įkėlę diegimo vaizdą su OS į oVirt, galite pereiti tiesiai prie virtualios mašinos kūrimo. Nuveikta daug darbo, bet jau esame baigiamajame etape, dėl kurio visa tai ir buvo pradėta – gauti gedimams atsparią infrastruktūrą, skirtą didelio prieinamumo virtualioms mašinoms talpinti. Ir visa tai visiškai nemokama – nei vienas centas nebuvo išleistas jokiai programinės įrangos licencijai įsigyti.

Для создания виртуальной машины с CentOS 7, должен быть загружен установочный образ с ОС.

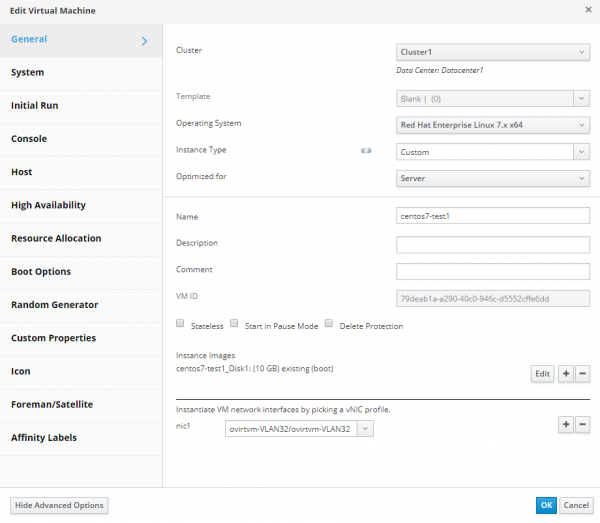

Einame į administracinį portalą, einame į Apskaičiuoti >> Virtuali mašinair paleiskite VM kūrimo vedlį. Užpildykite visus parametrus ir laukus ir spustelėkite ОК. Viskas labai paprasta, jei laikotės dokumentacijos.

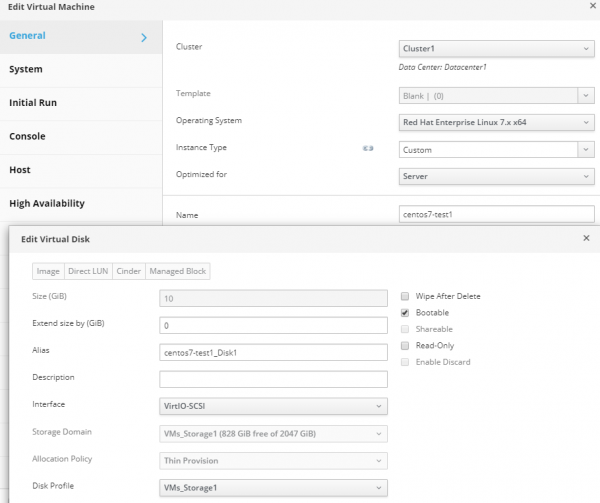

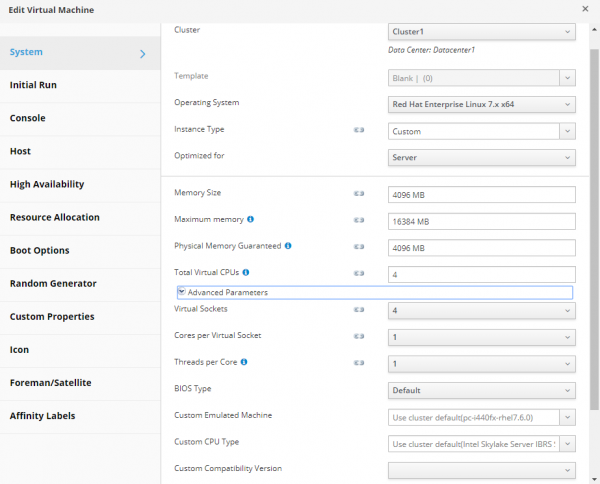

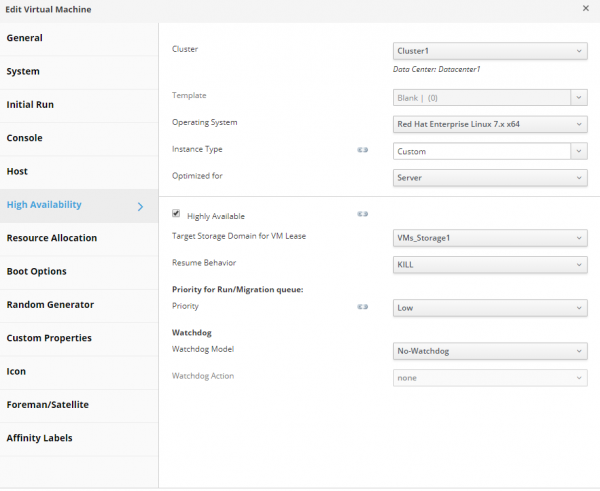

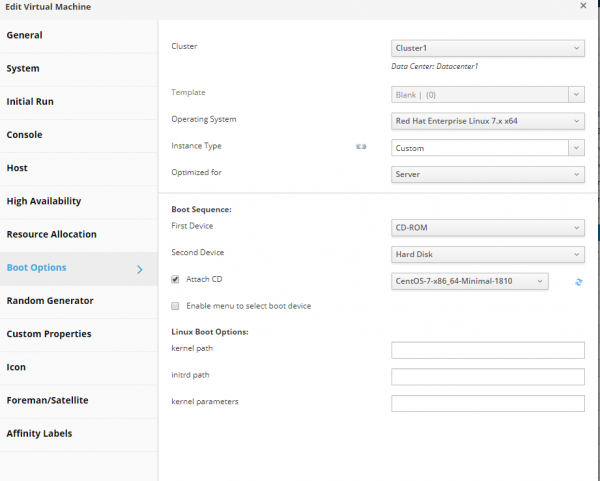

Kaip pavyzdį pateiksiu pagrindinius ir papildomus labai prieinamos VM su sukurtu disku, prijungtu prie tinklo ir paleidžiant iš diegimo vaizdo nustatymus:

Ekrano kopijos su labai prieinamais VM nustatymais

Baigę darbą su vedliu uždarykite jį, paleiskite naują VM ir įdiekite joje OS.

Norėdami tai padaryti, eikite į šios VM konsolę per administracinį portalą:

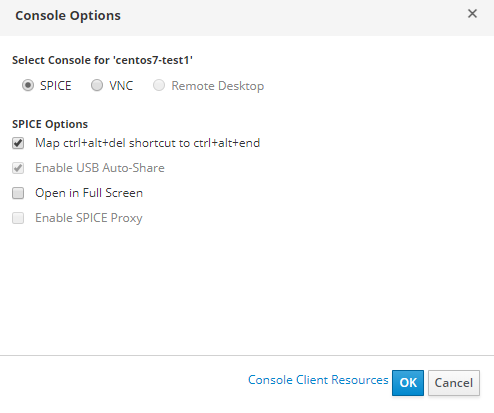

Prisijungimo prie VM konsolės administracinio portalo nustatymų ekrano kopija

Norėdami prisijungti prie VM konsolės, pirmiausia turite sukonfigūruoti konsolę virtualiosios mašinos ypatybėse.

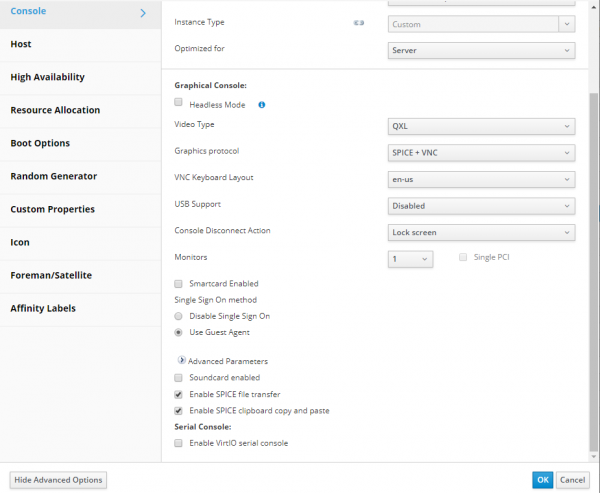

VM nustatymų ekrano kopija, skirtukas „Konsolė“.

Norėdami prisijungti prie VM konsolės, galite naudoti, pvz. .

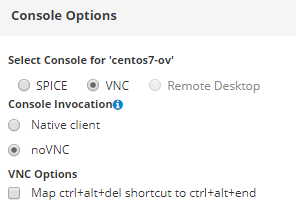

Norėdami prisijungti prie VM konsolės tiesiogiai naršyklės lange, ryšio nustatymai per konsolę turi būti tokie:

Įdiegus OS VM, patartina įdiegti oVirt svečių agentą:

yum -y install epel-release

yum install -y ovirt-guest-agent-common

systemctl enable ovirt-guest-agent.service && systemctl restart ovirt-guest-agent.service

systemctl status ovirt-guest-agent.serviceTaigi mūsų veiksmų dėka sukurta VM bus itin prieinama, t.y. jei klasterio mazgas, kuriame jis veikia, sugenda, oVirt automatiškai paleis jį iš naujo antrajame mazge. Šią VM taip pat galima perkelti iš vienos klasterio prieglobos į kitą jų priežiūros ar kitais tikslais.

išvada

Tikiuosi, kad šiame straipsnyje pavyko perteikti, kad oVirt yra visiškai įprastas virtualios infrastruktūros valdymo įrankis, kurį nėra taip sunku įdiegti – svarbiausia laikytis tam tikrų taisyklių ir reikalavimų, aprašytų tiek straipsnyje, tiek dokumentacijoje.

Dėl didelės straipsnio apimties į jį nebuvo įmanoma įtraukti daugelio dalykų, pvz., Žingsnis po žingsnio įvairių vedlių vykdymas su visais išsamiais paaiškinimais ir ekrano nuotraukomis, ilgos kai kurių komandų išvados ir pan. Tiesą sakant, tam reikėtų parašyti visą knygą, o tai neturi didelės prasmės dėl nuolat atsirandančių naujų programinės įrangos versijų su naujovėmis ir pakeitimais. Svarbiausia suprasti, kaip visa tai veikia kartu, ir gauti bendrą algoritmą, kaip sukurti gedimams atsparią virtualių mašinų valdymo platformą.

Nors sukūrėme virtualią infrastruktūrą, dabar turime išmokyti ją sąveikauti tiek tarp atskirų jos elementų: pagrindinių kompiuterių, virtualių mašinų, vidinių tinklų, tiek su išoriniu pasauliu.

Šis procesas yra viena iš pagrindinių sistemos ar tinklo administratoriaus užduočių, apie kurią bus kalbama kitame straipsnyje – apie VyOS virtualių maršrutizatorių naudojimą mūsų įmonės gedimams atsparioje infrastruktūroje (kaip atspėjote, jie veiks kaip virtualūs mašinos mūsų oVirt klasteryje).

Šaltinis: www.habr.com