Google vừa công bố một dòng mô hình ngôn ngữ quy mô lớn mới, Gemma 4, dựa trên mô hình Gemini 3. Gemma 4 được phân phối theo Giấy phép Apache với các biến thể có 2.3, 4.5, 25.2 và 30.7 tỷ tham số (E2B, E4B, 31B và 26B A4B). Các biến thể E2B và E4B phù hợp để sử dụng trên thiết bị di động, hệ thống Internet vạn vật (IoT) và các bo mạch tương tự Raspberry Pi, trong khi các biến thể khác phù hợp để sử dụng trên máy trạm và hệ thống có GPU dành cho người tiêu dùng. Kích thước ngữ cảnh được mô hình xem xét là 128 token đối với các mô hình E2B và E4B, và 256 token đối với các mô hình 31B và 26B A4B.

Các mô hình này hỗ trợ đa ngôn ngữ và đa phương thức: 35 ngôn ngữ được hỗ trợ ngay từ đầu (hơn 140 ngôn ngữ đã được sử dụng trong quá trình huấn luyện), và có thể xử lý văn bản và hình ảnh làm đầu vào (các mô hình E2B và E4B còn hỗ trợ thêm xử lý âm thanh). Mô hình 26B A4B dựa trên kiến trúc Mixture-of-Experts (MoE), trong đó mô hình được chia thành một loạt các mạng chuyên gia (việc tạo phản hồi chỉ có thể sử dụng 3.8 tỷ tham số, nhưng tốc độ nhanh hơn đáng kể so với các mô hình lớn cổ điển), trong khi các biến thể khác sử dụng kiến trúc nguyên khối cổ điển.

Các mô hình hỗ trợ suy luận và các chế độ cân nhắc có thể tùy chỉnh, đồng thời hỗ trợ Vai trò Hệ thống để xử lý các hướng dẫn (quy tắc, ràng buộc) một cách riêng biệt với dữ liệu. Các mô hình có thể được sử dụng để viết mã, nhận dạng đối tượng trong hình ảnh, phân tích video từng khung hình, phân tích cú pháp tài liệu và PDF, nhận dạng ký tự quang học (OCR) của văn bản in và viết tay, nhận dạng giọng nói và dịch thuật giữa các ngôn ngữ. Chúng cũng có thể được sử dụng như các tác nhân tự động tương tác với nhiều công cụ và API khác nhau.

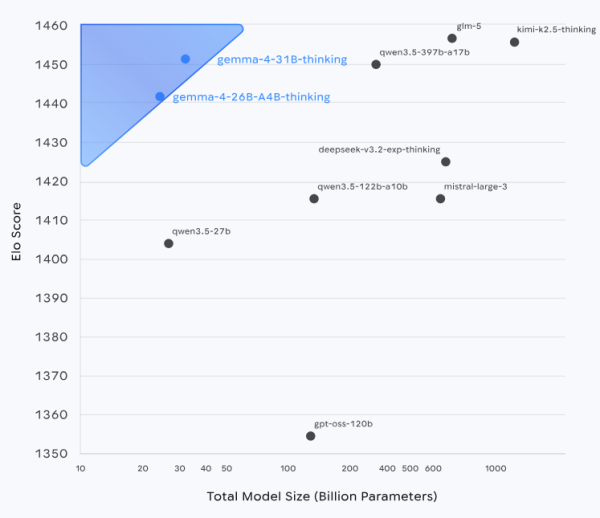

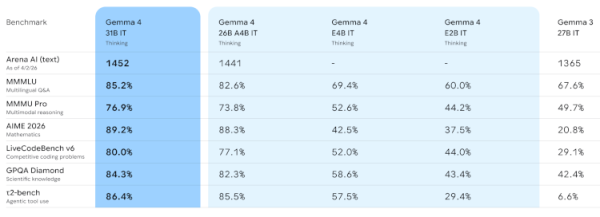

Trong hầu hết các bài kiểm tra, mô hình Gemma 4 cho hiệu suất vượt trội hơn hẳn so với mô hình Gemma 3 có 27 tỷ tham số. Gemma 4 hỗ trợ LiteRT-LM, vLLM, llama.cpp, MLX, Ollama, NVIDIA NIM và NeMo, LM Studio, Unsloth, SGLang, Cactus, Basetan, MaxText, Tunix và Keras.

Nguồn: opennet.ru