Google ha pubblicato una nuova famiglia di modelli linguistici su larga scala, Gemma 4, basata sul modello Gemini 3. Gemma 4 è distribuito con licenza Apache in varianti con 2.3, 4.5, 25.2 e 30.7 miliardi di parametri (E2B, E4B, 31B e 26B A4B). Le varianti E2B ed E4B sono adatte all'uso su dispositivi mobili, sistemi Internet of Things (IoT) e schede simili a Raspberry Pi, mentre le altre varianti sono adatte all'uso su workstation e sistemi con GPU di fascia consumer. La dimensione del contesto considerata dal modello è di 128 token per i modelli E2B ed E4B e di 256 token per i modelli 31B e 26B A4B.

I modelli sono multilingue e multimodali: supportano 35 lingue di default (oltre 140 lingue sono state utilizzate durante l'addestramento) e possono elaborare testo e immagini come input (i modelli E2B ed E4B supportano anche l'elaborazione audio). Il modello A4B a 26 miliardi di elementi si basa sull'architettura Mixture-of-Experts (MoE), in cui il modello è suddiviso in una serie di reti di esperti (la generazione della risposta può utilizzare solo 3.8 miliardi di parametri, ma la velocità è significativamente superiore a quella dei classici modelli di grandi dimensioni), mentre le altre varianti utilizzano una classica architettura monolitica.

I modelli supportano il ragionamento e modalità di deliberazione personalizzabili, e prevedono un ruolo di sistema per l'elaborazione separata delle istruzioni (regole, vincoli) dai dati. I modelli possono essere utilizzati per scrivere codice, riconoscere oggetti nelle immagini, analizzare video fotogramma per fotogramma, analizzare documenti e PDF, eseguire il riconoscimento ottico dei caratteri (OCR) di testo stampato e manoscritto, il riconoscimento vocale e la traduzione tra lingue. Possono inoltre essere utilizzati come agenti autonomi che interagiscono con diversi strumenti e API.

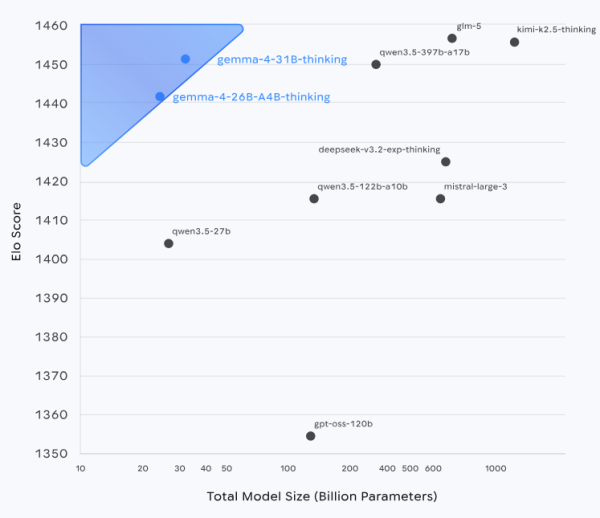

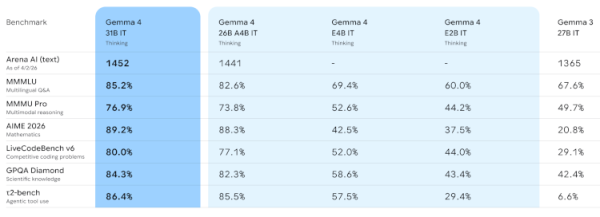

Nella maggior parte dei test, i modelli Gemma 4 hanno superato significativamente le prestazioni del modello Gemma 3 da 27 miliardi di parametri. Gemma 4 supporta LiteRT-LM, vLLM, llama.cpp, MLX, Ollama, NVIDIA NIM e NeMo, LM Studio, Unsloth, SGLang, Cactus, Basetan, MaxText, Tunix e Keras.

Fonte: opennet.ru